Pytanie 1

Karta rozszerzeń przedstawiona na zdjęciu dysponuje systemem chłodzenia

Wynik: 33/40 punktów (82,5%)

Wymagane minimum: 20 punktów (50%)

Karta rozszerzeń przedstawiona na zdjęciu dysponuje systemem chłodzenia

Jakie jest oznaczenie sieci, w której funkcjonuje host o IP 10.10.10.6 klasy A?

Emisja przez BIOS firmy AMI jednego długiego oraz dwóch krótkich sygnałów dźwiękowych oznacza

Czym jest klaster komputerowy?

Metoda zwana rytownictwem dotyczy zasady działania plotera

Który z komponentów NIE JEST zgodny z płytą główną MSI A320M Pro-VD-S socket AM4, 1x PCI-Ex16, 2x PCI-Ex1, 4x SATA III, 2x DDR4- max 32 GB, 1x D-SUB, 1x DVI-D, ATX?

W którym trybie działania procesora Intel x86 uruchamiane były aplikacje 16-bitowe?

Który przyrząd należy wykorzystać do uzyskania wyników testu POST dla modułów płyty głównej?

W systemie operacyjnym Ubuntu konto użytkownika student można wyeliminować przy użyciu komendy

Adres IP 192.168.2.0/24 został podzielony na cztery mniejsze podsieci. Jaką maskę mają te nowe podsieci?

Najlepszym sposobem na zabezpieczenie domowej sieci Wi-Fi jest

Komputer prawdopodobnie jest zainfekowany wirusem typu boot. Jakie działanie umożliwi usunięcie wirusa w najbardziej nieinwazyjny sposób dla systemu operacyjnego?

Który z poniższych programów NIE służy do testowania sieci komputerowej w celu wykrywania problemów?

Jak wielu hostów można maksymalnie zaadresować w sieci lokalnej, mając do dyspozycji jeden blok adresów klasy C protokołu IPv4?

Jakie oprogramowanie należy zainstalować, aby serwer Windows mógł obsługiwać usługi katalogowe?

ACPI to interfejs, który umożliwia

Przygotowując ranking dostawców łączy internetowych należy zwrócić uwagę, aby jak najmniejsze wartości miały parametry

Płyta główna wyposażona w gniazdo G2 będzie współpracowała z procesorem

Administrator systemu Linux wydał polecenie mount /dev/sda2 /mnt/flash . Spowoduje ono

Jaką prędkość przesyłu danych określa standard sieci Ethernet IEEE 802.3z?

Norma IEEE 802.11 określa typy sieci

Jak można skonfigurować interfejs sieciowy w systemie Linux, modyfikując plik

Aby zminimalizować różnice w kolorach pomiędzy zeskanowanymi obrazami prezentowanymi na monitorze a ich wersjami oryginalnymi, należy przeprowadzić

Urządzenie trwale zainstalowane u abonenta, które zawiera zakończenie poziomego okablowania strukturalnego, to

Jaki protokół do obsługi poczty elektronicznej pozwala na przykład na przechowywanie odebranych e-maili na serwerze, zarządzanie różnymi folderami, usuwanie wiadomości oraz przenoszenie ich pomiędzy folderami?

Dane z twardego dysku HDD, którego sterownik silnika SM jest uszkodzony, można odzyskać

W systemach Linux, aby wprowadzić nowe repozytorium, należy wykorzystać komendy

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jaką konfigurację sieciową może posiadać komputer, który należy do tej samej sieci LAN co komputer z adresem 192.168.1.10/24?

W sieciach bezprzewodowych typu Ad-Hoc IBSS (Independent Basic Service Set) wykorzystywana jest topologia fizyczna

Która licencja pozwala na darmowe korzystanie z programu, pod warunkiem, że użytkownik dba o środowisko naturalne?

W IPv6 odpowiednikiem adresu pętli zwrotnej jest adres

W systemie Linux komenda cd ~ umożliwia

Cechą charakterystyczną pojedynczego konta użytkownika w systemie Windows Serwer jest

Wszystkie ustawienia użytkowników komputera są przechowywane w gałęzi rejestru oznaczonej akronimem

Dokumentacja końcowa zaprojektowanej sieci LAN powinna zawierać między innymi

Program, który nie jest przeznaczony do analizy stanu komputera to

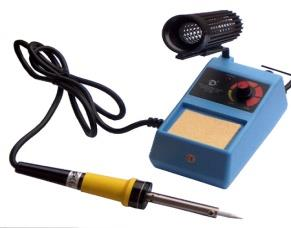

Urządzenie pokazane na ilustracji ma na celu

Jaką rolę pełni serwer plików w sieciach komputerowych LAN?

Co to jest urządzenie sieciowe most (ang. bridge)?