Pytanie 1

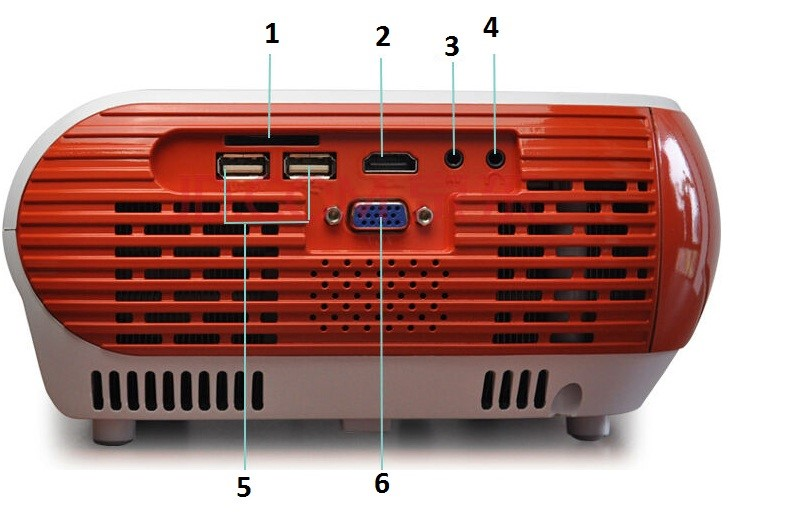

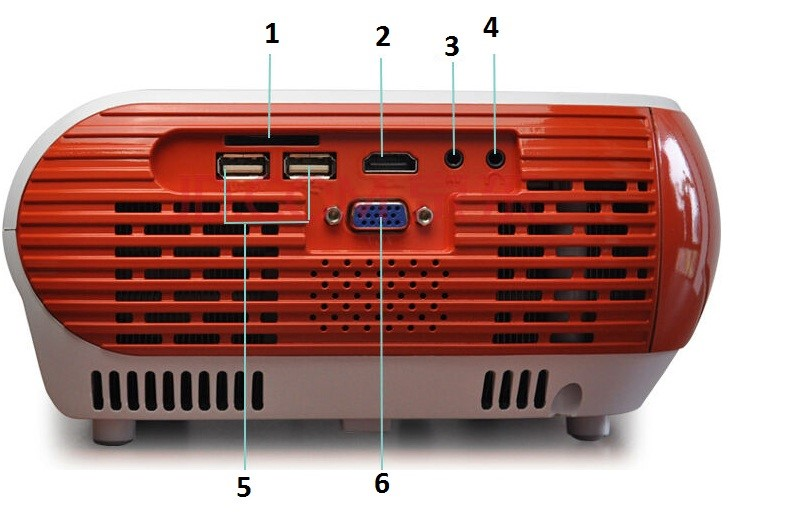

Aby za pomocą złącza DE-15F podłączyć przedstawiony projektor do laptopa, należy wykorzystać gniazdo oznaczone numerem

Wynik: 18/40 punktów (45,0%)

Wymagane minimum: 20 punktów (50%)

Aby za pomocą złącza DE-15F podłączyć przedstawiony projektor do laptopa, należy wykorzystać gniazdo oznaczone numerem

Skaner antywirusowy zidentyfikował niechciane oprogramowanie. Z opisu wynika, że jest to dialer, który pozostawiony w systemie

Który z podanych adresów IP należy do kategorii adresów prywatnych?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Profil mobilny staje się profilem obowiązkowym użytkownika po

Podczas uruchamiania (krótko po zakończeniu testu POST) komputer się zawiesza. Jakie mogą być możliwe przyczyny tej awarii?

Jakie urządzenie powinno się zastosować do pomiaru topologii okablowania strukturalnego w sieci lokalnej?

Jakie napięcie jest obniżane z 230 V w zasilaczu komputerowym w standardzie ATX dla różnych podzespołów komputera?

W systemie Linux polecenie touch jest używane do

W systemie Linux można uzyskać listę wszystkich założonych kont użytkowników, wykorzystując polecenie

Aby zredukować kluczowe zagrożenia związane z bezpieczeństwem podczas pracy na komputerze podłączonym do sieci Internet, należy przede wszystkim

Na ilustracji zaprezentowano końcówkę wkrętaka typu

Jak nazywa się współpracujące z monitorami CRT urządzenie wskazujące z końcówką wyposażoną w światłoczuły element, która poprzez dotknięcie ekranu monitora powoduje przesłanie sygnału do komputera, umożliwiając w ten sposób lokalizację kursora?

W celu zrealizowania instalacji sieciowej na stacjach roboczych z systemem operacyjnym Windows, należy na serwerze zainstalować usługi

Zgodnie z normą PN-EN 50173, minimalna liczba punktów rozdzielczych, które należy zainstalować, wynosi

Po wykonaniu podanego polecenia w systemie Windows:

net accounts /MINPWLEN:11liczba 11 zostanie przydzielona dla:

Jakie korzyści płyną z zastosowania systemu plików NTFS?

Użytkownik systemu Windows napotyka komunikaty o zbyt małej ilości pamięci wirtualnej. W jaki sposób można rozwiązać ten problem?

Firma zamierza zrealizować budowę lokalnej sieci komputerowej, która będzie zawierać serwer, drukarkę oraz 10 stacji roboczych, które nie mają kart bezprzewodowych. Połączenie z Internetem umożliwia ruter z wbudowanym modemem ADSL oraz czterema portami LAN. Które z poniższych urządzeń sieciowych jest konieczne, aby sieć działała prawidłowo i miała dostęp do Internetu?

Diody LED RGB funkcjonują jako źródło światła w różnych modelach skanerów

Jaką minimalną ilość pamięci RAM powinien mieć komputer, aby zainstalować 32-bitowy system operacyjny Windows 7 i móc efektywnie korzystać z trybu graficznego?

Proces zapisywania kluczy rejestru do pliku określamy jako

Do sprawdzenia, czy zainstalowana karta graficzna komputera przegrzewa się, użytkownik może wykorzystać program

Aby umożliwić transfer danych między siecią w pracowni a siecią ogólnoszkolną o innej adresacji IP, należy zastosować

Jakie polecenie należy wydać, aby skonfigurować statyczny routing do sieci 192.168.10.0?

Standard sieci bezprzewodowej WiFi 802.11 a/n operuje w zakresie

Który z podanych adresów protokołu IPv4 jest adresem klasy D?

Interfejs, którego magistrala kończy się elementem przedstawionym na ilustracji, jest typowy dla

Karta rozszerzeń przedstawiona na ilustracji może być zainstalowana w komputerze, jeśli na płycie głównej znajduje się przynajmniej jeden dostępny slot

Aby odzyskać dane z dysku, który został sformatowany, warto użyć programu typu

Jakie środowisko graficzne zaprojektowane dla systemu Linux ma najniższe wymagania dotyczące pamięci RAM?

W nowoczesnych ekranach dotykowych działanie ekranu jest zapewniane przez mechanizm, który wykrywa zmianę

W systemach operacyjnych z rodziny Windows odpowiednikiem programu fsck z systemu Linux jest aplikacja

Który z parametrów okablowania strukturalnego definiuje stosunek mocy sygnału tekstowego w jednej parze do mocy sygnału wyindukowanego w sąsiedniej parze na tym samym końcu kabla?

Które z poniższych poleceń służy do naprawienia głównego rekordu rozruchowego dysku twardego w systemie Windows?

W przypadku drukarki igłowej, jaki materiał eksploatacyjny jest używany?

Jaką maksymalną długość kabla typu skrętka pomiędzy panelem krosowniczym a gniazdem abonenckim przewiduje norma PN-EN 50174-2?

W systemie operacyjnym Ubuntu konto użytkownika student można wyeliminować przy użyciu komendy

Impulsator pozwala na testowanie uszkodzonych systemów logicznych w komputerze, między innymi poprzez

Zarządzanie konfiguracją karty sieciowej w systemie Windows 7 realizuje polecenie