Pytanie 1

Narzędziem do monitorowania wydajności i niezawodności w systemach Windows 7, Windows Server 2008 R2 oraz Windows Vista jest

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

Narzędziem do monitorowania wydajności i niezawodności w systemach Windows 7, Windows Server 2008 R2 oraz Windows Vista jest

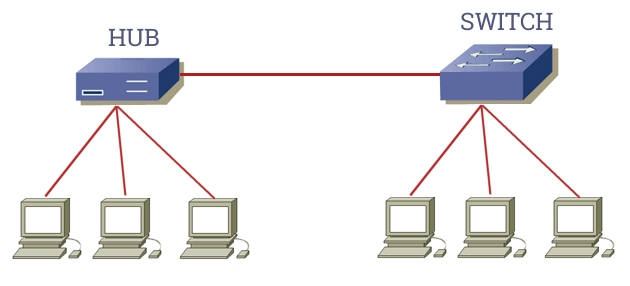

Ile kolizji domenowych występuje w sieci przedstawionej na ilustracji?

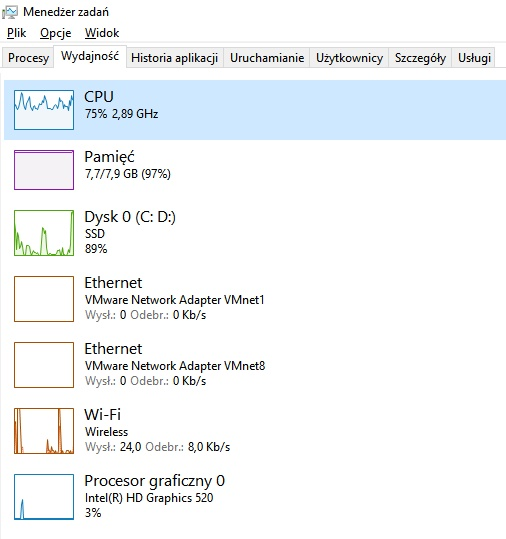

Grafik komputerowy sygnalizuje bardzo wolną pracę komputera. Z ilustracji przedstawiającej okno wydajności komputera wynika, że przyczyną tego może być

Jakiego rekordu DNS należy użyć w strefie wyszukiwania do przodu, aby powiązać nazwę domeny DNS z adresem IP?

Zarządzanie partycjami w systemach operacyjnych Windows

Wskaż rysunek ilustrujący symbol używany do oznaczania portu równoległego LPT?

Urządzenie, które pozwala na połączenie hostów w jednej sieci z hostami w różnych sieciach, to

Jaką maksymalną prędkość danych można osiągnąć w sieci korzystającej z skrętki kategorii 5e?

Która z wymienionych czynności konserwacyjnych drukarek dotyczy tylko drukarki laserowej?

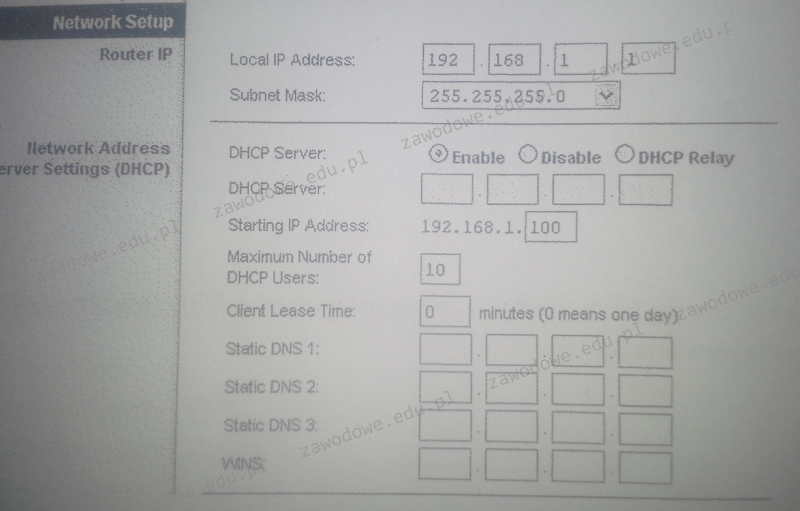

Na przedstawionym zrzucie panelu ustawień rutera można zauważyć, że serwer DHCP

Napięcie dostarczane do poszczególnych elementów komputera w zasilaczu komputerowym w standardzie ATX jest zmniejszane z wartości 230V między innymi do wartości

Narzędzie przedstawione do nadzorowania sieci LAN to

C:\Users\egzamin>nmap localhost Starting Nmap 7.80 ( https://nmap.org ) at 2019-11-26 20:23 ?rodkowoeuropejski czas stand. Nmap scan report for localhost (127.0.0.1) Host is up (0.00s latency). Other addresses for localhost (not scanned): ::1 Not shown: 988 closed ports PORT STATE SERVICE 135/tcp open msrpc 445/tcp open microsoft-ds 1025/tcp open NFS-or-IIS 1026/tcp open LSA-or-nterm 1027/tcp open IIS 1029/tcp open ms-lsa 1030/tcp open iad1 1031/tcp open iad2 1044/tcp open dcutility 1234/tcp open hotline 2869/tcp open icslap 16992/tcp open amt-soap-http Nmap done: 1 IP address (1 host up) scanned in 0.94 seconds

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jakie polecenie należy zastosować, aby zamontować pierwszą partycję logiczną dysku primary slave w systemie Linux?

Aby zdalnie i jednocześnie bezpiecznie zarządzać systemem Linux, należy zastosować protokół

Obrazek ilustruje rezultat działania programu

│ ├── Checkbox_checked.svg │ └── Checkbox_unchecked.svg │ ├── revisions.txt │ ├── tools │ │ ├── howto.txt │ │ ├── Mangler │ │ │ ├── make.sh │ │ │ └── src │ │ │ └── Mangler.java │ │ └── WiFi101 │ │ ├── tool │ │ │ └── firmwares │ │ │ ├── 19.4.4 │ │ │ │ ├── m2m_aio_2b0.bin │ │ │ │ └── m2m_aio_3a0.bin │ │ │ └── 19.5.2 │ │ │ └── m2m_aio_3a0.bin │ │ └── WiFi101.jar │ ├── tools-builder │ │ └── ctags │ │ └── 5.8-arduino11 │ │ └── ctags │ └── uninstall.sh └── brother └── PTouch └── ql570 └── cupswrapper ├── brcupsconfpt1 └── cupswrapperql570pt1

Przydzielaniem adresów IP w sieci zajmuje się serwer

Jaka jest binarna reprezentacja adresu IP 192.168.1.12?

Farad to jednostka

Wskaź, które z poniższych stwierdzeń dotyczących zapory sieciowej jest nieprawdziwe?

Zgodnie z podanym cennikiem, przeciętny koszt zakupu wyposażenia stanowiska komputerowego wynosi:

| Nazwa sprzętu | Cena minimalna | Cena maksymalna |

|---|---|---|

| Jednostka centralna | 1300,00 zł | 4550,00 zł |

| Monitor | 650,00 zł | 2000,00 zł |

| Klawiatura | 28,00 zł | 100,00 zł |

| Myszka | 22,00 zł | 50,00 zł |

Jaką długość ma adres IP wersji 4?

Aby podłączyć drukarkę z portem równoległym do komputera, który dysponuje jedynie złączami USB, konieczne jest zainstalowanie adaptera

Na podstawie danych przedstawionych w tabeli dotyczącej twardego dysku, ustal, który z wniosków jest poprawny?

Tester strukturalnego okablowania umożliwia weryfikację

Komenda "mmc" w systemach Windows 2000 oraz Windows XP uruchamia aplikację do tworzenia, zapisywania i otwierania

Który procesor jest kompatybilny z płytą główną o przedstawionej specyfikacji?

ASUS micro-ATX, socket 1150, VT-d, DDR3 `1333, 1600 MHz), ATI Radeon X1250, 3 x PCI-Express x1, 3 x PCI-Express x16, 2 x Serial ATA III, USB 3.0, VGA, HDMI, DVI-D

Matryce monitorów typu charakteryzują się najmniejszymi kątami widzenia

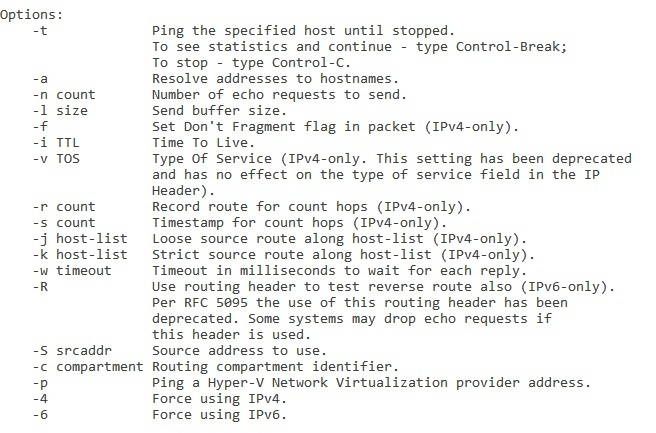

Aby wyświetlić przedstawione opcje polecenia ping, należy w wierszu polecenia systemu Windows zapisać

Złącze zasilacza ATX12V jest przeznaczone do zasilania

Protokół, który zajmuje się identyfikowaniem i usuwaniem kolizji w sieciach Ethernet, to

Analiza tłumienia w kablowym systemie przesyłowym umożliwia ustalenie

Według normy JEDEC, standardowe napięcie zasilające dla modułów pamięci RAM DDR3L o niskim napięciu wynosi

Jaki pasywny komponent sieciowy powinno się wykorzystać do podłączenia przewodów z wszystkich gniazd abonenckich do panelu krosowniczego umieszczonego w szafie rack?

Sieć komputerowa, która obejmuje wyłącznie urządzenia jednej organizacji, w której dostępne są usługi realizowane przez serwery w sieci LAN, takie jak strony WWW czy poczta elektroniczna to

Zainstalowanie serwera WWW w środowisku Windows Server zapewnia rola

Jakie polecenie trzeba wydać w systemie Windows, aby zweryfikować tabelę mapowania adresów IP na adresy MAC wykorzystywane przez protokół ARP?

Standard sieci bezprzewodowej WiFi 802.11 a/n operuje w zakresie

Lokalny komputer dysponuje adresem 192.168.0.5. Po otwarciu strony internetowej z tego urządzenia, która identyfikuje adresy w sieci, uzyskano informację, że adresem komputera jest 195.182.130.24. Co to oznacza?

Do zarządzania konfiguracją grup komputerowych oraz użytkowników w systemach Windows Server, należy wykorzystać narzędzie