Pytanie 1

Adres IP jest przypisywany przełącznikowi warstwy drugiej w celu

Wynik: 28/40 punktów (70,0%)

Wymagane minimum: 20 punktów (50%)

Adres IP jest przypisywany przełącznikowi warstwy drugiej w celu

Gdy użytkownik zauważy, że ważne pliki zniknęły z dysku twardego, powinien

Oprogramowanie przypisane do konkretnego komputera lub jego podzespołów, które uniemożliwia instalację na nowym sprzęcie zakupionym przez tego samego użytkownika, to

Aby użytkownicy lokalnej sieci mogli korzystać z przeglądarek do odwiedzania stron WWW za pomocą protokołów HTTP i HTTPS, brama internetowa musi umożliwiać ruch na portach

Jakim adresem IPv6 charakteryzuje się autokonfiguracja łącza?

Jakie polecenie w systemie Windows dedykowane dla stacji roboczej, umożliwia skonfigurowanie wymagań dotyczących logowania dla wszystkich użytkowników tej stacji roboczej?

Przed przystąpieniem do modernizacji komputerów osobistych oraz serwerów, polegającej na dodaniu nowych modułów pamięci RAM, konieczne jest sprawdzenie

Czynnikiem zagrażającym bezpieczeństwu systemu operacyjnego, który zmusza go do automatycznej aktualizacji, są

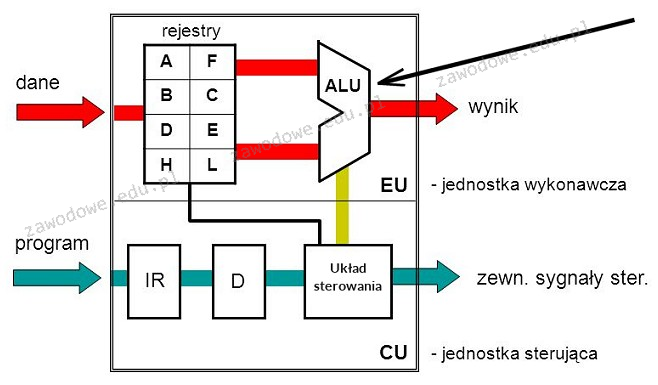

Na diagramie mikroprocesora blok wskazany strzałką pełni rolę

Który element pasywny sieci powinien być użyty do połączenia okablowania ze wszystkich gniazd abonenckich z panelem krosowniczym umieszczonym w szafie rack?

Jak określamy atak na sieć komputerową, który polega na łapaniu pakietów przesyłanych w sieci?

Narzędzie systemów operacyjnych Windows używane do zmiany ustawień interfejsów sieciowych, na przykład przekształcenie dynamicznej konfiguracji karty sieciowej w konfigurację statyczną, to

Podczas uruchamiania komputera ukazuje się komunikat "CMOS checksum error press F1 to continue press DEL to setup". Naciśnięcie klawisza DEL skutkuje

Oblicz koszt wykonania okablowania strukturalnego od 5 punktów abonenckich do panelu krosowego wraz z wykonaniem kabli połączeniowych dla stacji roboczych. W tym celu wykorzystano 50 m skrętki UTP. Punkt abonencki składa się z 2 gniazd typu RJ

| Materiał | Jednostka | Cena |

|---|---|---|

| Gniazdo podtynkowe 45x45, bez ramki, UTP 2xRJ45 kat.5e | szt. | 17 zł |

| UTP kabel kat.5e PVC 4PR 305m | karton | 305 zł |

| RJ wtyk UTP kat.5e beznarzędziowy | szt. | 6 zł |

Na podstawie oznaczenia pamięci DDR3 PC3-16000 można określić, że ta pamięć

Po wykonaniu instalacji z domyślnymi parametrami system Windows XP NIE OBSŁUGUJE formatu systemu plików

Narzędziem do monitorowania wydajności i niezawodności w systemach Windows 7, Windows Server 2008 R2 oraz Windows Vista jest

Jaki rodzaj kabla powinien być użyty do podłączenia komputera w miejscu, gdzie występują zakłócenia elektromagnetyczne?

Użytkownicy sieci Wi-Fi zauważyli zakłócenia oraz częste przerwy w połączeniu. Przyczyną tej sytuacji może być

Mysz bezprzewodowa jest podłączona do komputera, jednak kursor nie porusza się gładko i „skacze” po ekranie. Możliwą przyczyną problemu z urządzeniem może być

Każdorazowo automatycznie szyfrowany staje się plik, który został zaszyfrowany przez użytkownika za pomocą systemu NTFS 5.0, w momencie

Narzędziem do monitorowania, które umożliwia przechwytywanie, rejestrowanie oraz dekodowanie różnych pakietów sieciowych, jest

Lokalny komputer posiada adres 192.168.0.5. Po otwarciu strony internetowej z tego urządzenia, która rozpoznaje adresy w sieci, wyświetla się informacja, że jego adres to 195.182.130.24. Co to oznacza?

Jakie polecenie jest wysyłane do serwera DHCP, aby zwolnić wszystkie adresy przypisane do interfejsów sieciowych?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

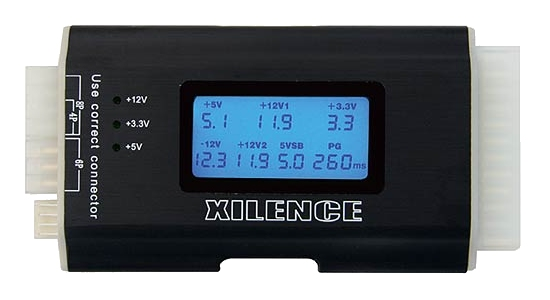

Przy użyciu urządzenia przedstawionego na ilustracji można sprawdzić działanie

Administrator powinien podzielić sieć o adresie 193.115.95.0 z maską 255.255.255.0 na 8 równych podsieci. Jaką maskę sieci powinien wybrać administrator?

Ataki na systemy komputerowe, które odbywają się poprzez podstępne pozyskiwanie od użytkowników ich danych osobowych, często wykorzystywane są w postaci fałszywych komunikatów z różnych instytucji lub od dostawców usług e-płatności i innych znanych organizacji, to

Komputer ma podłączoną mysz bezprzewodową, a kursor podczas pracy nie porusza się płynnie, „skacze” po ekranie. Przyczyną usterki urządzenia może być

Jakie polecenie w systemie Linux nie pozwala na diagnozowanie sprzętu komputerowego?

Na początku procesu uruchamiania sprzętowego komputera, wykonywany jest test

W dwóch sąsiadujących pomieszczeniach pewnej firmy występują znaczne zakłócenia elektromagnetyczne. Aby zapewnić maksymalną przepustowość w istniejącej sieci LAN, jakie medium transmisyjne powinno być użyte?

Na ilustracji przedstawiona jest karta

Jakie polecenie w systemie Linux umożliwia wyświetlenie zawartości katalogu?

Jakie urządzenie w sieci lokalnej NIE ROZDZIELA obszaru sieci komputerowej na domeny kolizyjne?

Jak nazywa się standard podstawki procesora bez nóżek?

Sieć 192.200.100.0 z maską 255.255.255.128 podzielono na 4 równe podsieci. Ile maksymalnie adresów hostów jest dostępnych w każdej podsieci?

Jaką długość ma maska sieci dla adresów z klasy B?

Aby załadować projekt wydruku bezpośrednio z komputera do drukarki 3D, której parametry przedstawiono w tabeli, można użyć złącza

| Technologia pracy | FDM (Fused Deposition Modeling) |

| Głowica drukująca | Podwójny ekstruder z unikalnym systemem unoszenia dyszy i wymiennymi modułami drukującymi (PrintCore) |

| Średnica filamentu | 2,85 mm |

| Platforma drukowania | Szklana, podgrzewana |

| Temperatura platformy | 20°C – 100°C |

| Temperatura dyszy | 180°C – 280°C |

| Łączność | WiFi, Ethernet, USB |

| Rozpoznawanie materiału | Skaner NFC |

Dysk z systemem plików FAT32, na którym regularnie przeprowadza się działania usuwania starych plików oraz dodawania nowych plików, doświadcza