Pytanie 1

Kolonoskopia to badanie, które ma na celu ocenę błony śluzowej

Wynik: 32/40 punktów (80,0%)

Wymagane minimum: 20 punktów (50%)

Kolonoskopia to badanie, które ma na celu ocenę błony śluzowej

DSA to cyfrowa

Audiometria impedancyjna polega na pomiarze

Gadolin jako dożylny środek kontrastowy stosowany w MR powoduje

Która struktura może być oknem akustycznym w badaniu ultrasonograficznym?

W celu wykonania badania scyntygraficznego układu kostnego radiofarmaceutyk należy podać pacjentowi

Który radiofarmaceutyk może zostać podany pacjentowi w scyntygrafii perfuzyjnej mózgu?

Teleradioterapia 4D na etapie planowania leczenia wykorzystuje obrazy

Która składowa prawidłowej krzywej EKG odpowiada powolnej repolaryzacji komór mięśnia sercowego?

Które środki kontrastujące wykorzystywane są w diagnostyce rezonansem magnetycznym?

Które informacje należy zamieścić na strzykawce z radiofarmaceutykiem przygotowanym przez technika elektroradiologa?

Którą strukturę anatomiczną oznaczono na skanie TK głowy?

Zadaniem technika elektroradiologa w pracowni naczyniowej jest

W brachyterapii MDR stosowane są dawki promieniowania

W medycznym przyspieszaczu liniowym jest generowana wiązka fotonów o energii w zakresie

Hiperfrakcjonowanie dawki w teleradioterapii polega na napromienianiu 2 do 3 razy dziennie dawką frakcyjną

Testy specjalistyczne aparatów rentgenowskich do zdjęć wewnątrzustnych są przeprowadzane

Więzka promieniowania X to

Który radioizotop stosuje się do badania scyntygraficznego kości?

Na obrazie MR kręgosłupa lędźwiowego strzałką wskazano

Na obrazie radiologicznym nadgarstka uwidoczniono złamanie nasady

W badaniu PET stosuje się tylko radioizotopy emitujące

Wyniosłość międzykłykciowa znajduje się na nasadzie

Na obrazie radiologicznym nadgarstka strzałką zaznaczona jest kość

Do wczesnych odczynów popromiennych po radioterapii zalicza się

Które środki kontrastujące wykorzystywane są w diagnostyce rezonansem magnetycznym?

Zdjęcie rentgenowskie nadgarstka w przywiedzeniu dołokciowym jest wykonywane w celu uwidocznienia kości

Jak określa się rekonstrukcję obrazów TK, której wynikiem są obrazy dwuwymiarowe tworzone w dowolnej płaszczyźnie przez wtórną obróbkę zestawionych ze sobą wielu przekrojów poprzecznych?

Cholangiografia to badanie radiologiczne

Które zdjęcie RTG stawu łokciowego zostało wykonane w projekcji skośnej w rotacji zewnętrznej?

Na obrazie rentgenowskim strzałką zaznaczono

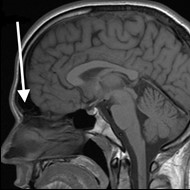

Na obrazie rezonansu magnetycznego głowy strzałką wskazano zatokę

Parametrem krwi, który powinien zostać oznaczony u pacjenta przed wykonaniem badania MR z kontrastem jest

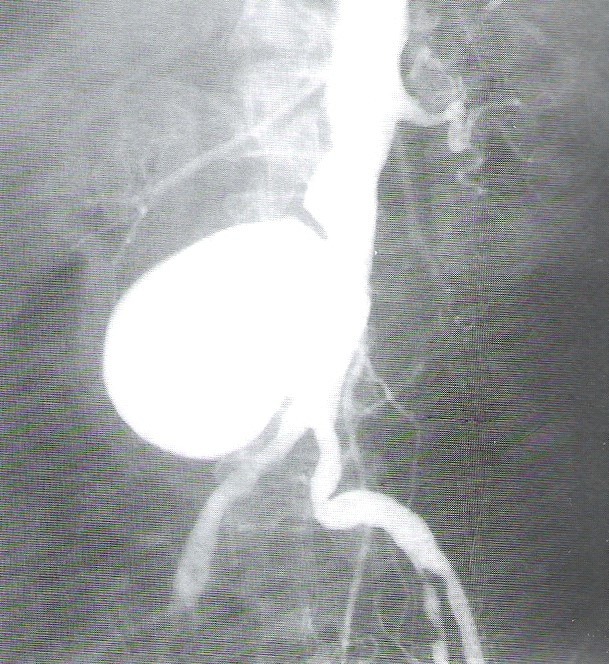

Przedstawiony obraz radiologiczny został zarejestrowany podczas badania jelita

W standardowym badaniu elektrokardiograficznym elektrodę C4 należy umieścić

W standardowym badaniu elektrokardiologicznym elektrodę C4 należy umocować

HRCT (high-resolution computed tomography) jest metodą obrazowania TK

Jaki czas należy ustawić do wykonania zdjęcia rentgenowskiego dwójki górnej lewej?

| Tabela ekspozycji | |||

|---|---|---|---|

| wartości | czasu (s) | napięcia (kV) | natężenia (mA) |

| zęby przedtrzonowe i kły | 0,160 | 60 | 8 |

| siekacze | 0,120 | 60 | 8 |

| zęby trzonowe | 0,200 | 60 | 8 |

| ekspozycja zgryzowo-skrzydełkowa | 0,180 | 66 | 6 |

Podczas badania EEG otwarcie oczu powoduje

Ile razy i jak zmieni się wartość natężenia promieniowania X przy zwiększeniu odległości OF ze 100 cm do 200 cm?