Pytanie 1

Aby chronić konto użytkownika przed nieautoryzowanymi zmianami w systemie Windows 7, 8 lub 10, które wymagają uprawnień administratora, należy ustawić

Wynik: 13/40 punktów (32,5%)

Wymagane minimum: 20 punktów (50%)

Aby chronić konto użytkownika przed nieautoryzowanymi zmianami w systemie Windows 7, 8 lub 10, które wymagają uprawnień administratora, należy ustawić

Którego z poniższych zadań nie wykonują serwery plików?

Do jakiej grupy w systemie Windows Server 2008 powinien być przypisany użytkownik odpowiedzialny wyłącznie za archiwizację danych przechowywanych na serwerowym dysku?

Co jest przyczyną wysokiego poziomu przesłuchu zdalnego w kablu?

Który z protokołów umożliwia szyfrowane połączenia?

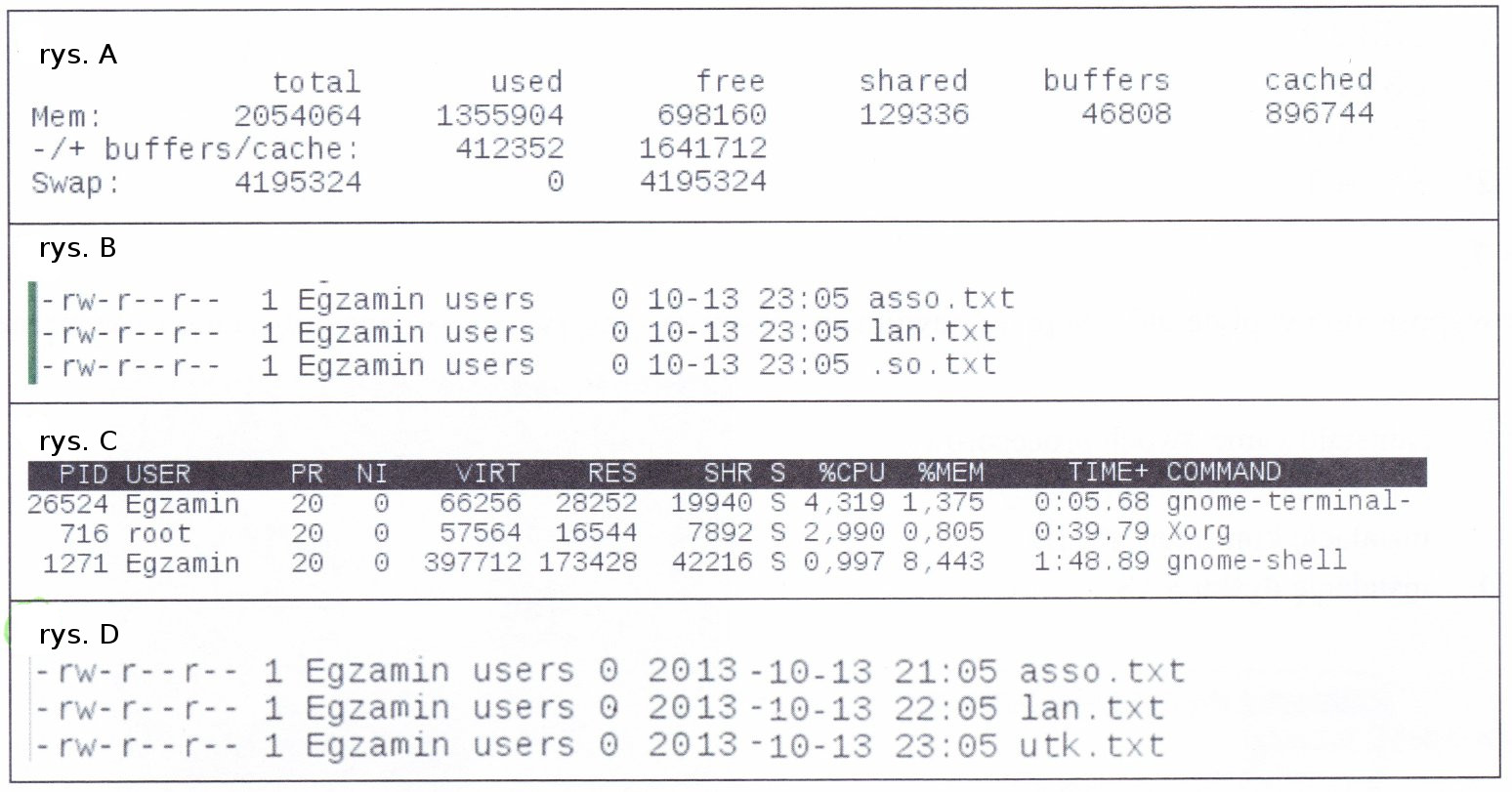

Jaką funkcję pełni mechanizm umożliwiający przechowywanie fragmentów dużych plików programów i danych, które nie mogą być w pełni załadowane do pamięci?

Okablowanie strukturalne klasyfikuje się jako część infrastruktury

W celu zapewnienia jakości usługi QoS, w przełącznikach warstwy dostępu stosuje się mechanizm

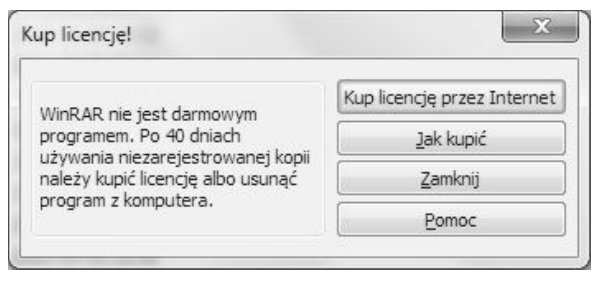

Rezultat wykonania komendy ls -l w systemie Linux ilustruje poniższy rysunek

Najskuteczniejszym sposobem na ochronę komputera przed wirusami jest zainstalowanie

Do efektywnego zrealizowania macierzy RAID 1 wymagane jest minimum

Program WinRAR pokazał okno informacyjne widoczne na ilustracji. Jakiego rodzaju licencją posługiwał się do tej pory użytkownik?

Add-Computer -DomainName egzamin.local -Restart

Przedstawione polecenie jest sposobem dodania stacji roboczej do domeny egzamin.local za pomocą

Jakie polecenie powinno być użyte do obserwacji lokalnych połączeń?

Klient dostarczył wadliwy sprzęt komputerowy do serwisu. W trakcie procedury przyjmowania sprzętu, ale przed rozpoczęciem jego naprawy, serwisant powinien

Dysk znajdujący się w komputerze ma zostać podzielony na partycje. Jaką maksymalną liczbę partycji rozszerzonych można utworzyć na jednym dysku?

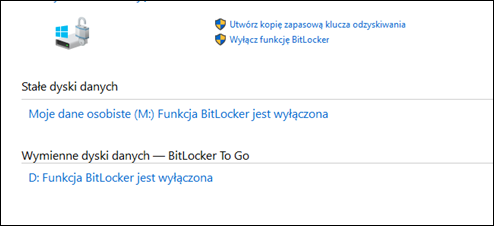

Przedstawione wbudowane narzędzie systemów Windows w wersji Enterprise lub Ultimate służy do

Wypukłe kondensatory elektrolityczne w module zasilania monitora LCD mogą doprowadzić do uszkodzenia

Jaka usługa, opracowana przez firmę Microsoft, pozwala na konwersję nazw komputerów na adresy URL?

Jak przywrócić stan rejestru systemowego w edytorze Regedit, wykorzystując wcześniej utworzoną kopię zapasową?

W systemie Linux, aby przejść do głównego katalogu w strukturze drzewiastej, używa się komendy

Który protokół służy do wymiany danych o trasach oraz dostępności sieci pomiędzy routerami w ramach tego samego systemu autonomicznego?

W komputerze połączonym z Internetem, w oprogramowaniu antywirusowym aktualizację bazy wirusów powinno się przeprowadzać minimum

Który z podanych programów pozwoli na stworzenie technicznego rysunku ilustrującego plan instalacji logicznej sieci lokalnej w budynku?

W systemie Linux polecenie chmod 321 start spowoduje przyznanie poniższych uprawnień plikowi start:

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Który z parametrów okablowania strukturalnego definiuje stosunek mocy sygnału tekstowego w jednej parze do mocy sygnału wyindukowanego w sąsiedniej parze na tym samym końcu kabla?

Aby zweryfikować połączenia kabla U/UTP Cat. 5e w systemie okablowania strukturalnego, jakiego urządzenia należy użyć?

Jakie urządzenie sieciowe zostało przedstawione na diagramie sieciowym?

Który z podanych adresów IPv4 stanowi adres publiczny?

Jakie polecenie w systemie Windows pozwala na zmianę zarówno nazwy pliku, jak i jego lokalizacji?

Na zdjęciu widać

Jeden długi oraz dwa krótkie sygnały dźwiękowe BIOS POST od firm AMI i AWARD wskazują na wystąpienie błędu

Administrator sieci komputerowej z adresem 192.168.1.0/24 podzielił ją na 8 równych podsieci. Ile adresów hostów będzie dostępnych w każdej z nich?

W jakiej fizycznej topologii sieci komputerowej każdy węzeł ma łączność fizyczną z każdym innym węzłem w sieci?

W metodzie archiwizacji danych nazwanej Dziadek – Ojciec – Syn na poziomie Dziadek przeprowadza się kopię danych na koniec

W dokumentacji płyty głównej zapisano „Wsparcie dla S/PDIF Out”. Co to oznacza w kontekście tego modelu płyty głównej?

W przypadku, gdy w tej samej przestrzeni będą funkcjonować jednocześnie dwie sieci WLAN zgodne ze standardem 802.11g, w celu zminimalizowania ryzyka wzajemnych zakłóceń, powinny one otrzymać kanały o numerach różniących się o

Jakie parametry można śledzić w przypadku urządzenia przy pomocy S.M.A.R.T.?

Aby poprawić bezpieczeństwo zasobów sieciowych, administrator sieci komputerowej w firmie otrzymał zadanie podziału aktualnej lokalnej sieci komputerowej na 16 podsieci. Obecna sieć posiada adres IP 192.168.20.0 i maskę 255.255.255.0. Jaką maskę sieci powinien zastosować administrator?