Pytanie 1

Najczęstszą przyczyną niskiej jakości wydruku z drukarki laserowej, która objawia się widocznym rozmazywaniem tonera, jest

Wynik: 20/40 punktów (50,0%)

Wymagane minimum: 20 punktów (50%)

Najczęstszą przyczyną niskiej jakości wydruku z drukarki laserowej, która objawia się widocznym rozmazywaniem tonera, jest

Parametr pamięci RAM określany czasem jako opóźnienie definiuje się jako

Jak skrót wskazuje na rozległą sieć komputerową, która obejmuje swoim zasięgiem miasto?

Aby zrealizować transfer danych pomiędzy siecią w pracowni a siecią ogólnoszkolną, która ma inną adresację IP, należy zastosować

Ataki mające na celu zakłócenie funkcjonowania aplikacji oraz procesów działających w urządzeniu sieciowym określane są jako ataki typu

Które narzędzie jest przeznaczone do lekkiego odgięcia blachy obudowy komputera oraz zamocowania śruby montażowej w trudno dostępnym miejscu?

Który z poniższych elementów jest częścią mechanizmu drukarki atramentowej?

Po zainstalowaniu systemu Linux, użytkownik pragnie skonfigurować kartę sieciową poprzez wprowadzenie ustawień dotyczących sieci. Jakie działanie należy podjąć, aby to osiągnąć?

NIEWŁAŚCIWE podłączenie taśmy sygnałowej do napędu dyskietek skutkuje

Czym jest postcardware?

Switch jako kluczowy komponent występuje w sieci o strukturze

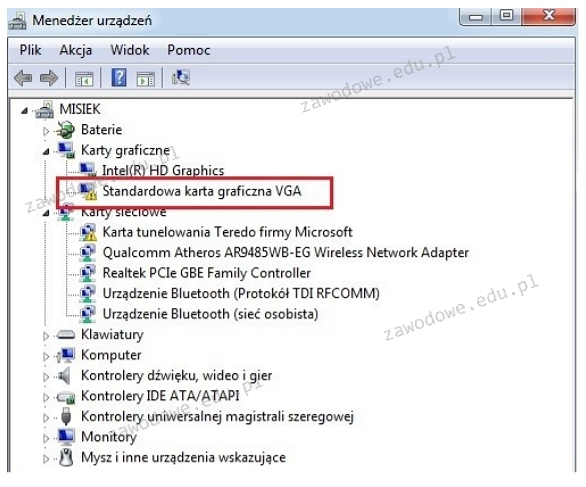

Technologia opisana w systemach należących do rodziny Windows to

| Jest to technologia obsługująca automatyczną konfigurację komputera PC i wszystkich zainstalowanych w nim urządzeń. Umożliwia ona rozpoczęcie korzystania z nowego urządzenia (na przykład karty dźwiękowej lub modemu) natychmiast po jego zainstalowaniu bez konieczności przeprowadzania ręcznej jego konfiguracji. Technologia ta jest implementowana w warstwach sprzętowej i systemu operacyjnego, a także przy użyciu sterowników urządzeń i BIOS-u. |

Podaj polecenie w systemie Linux, które umożliwia określenie aktualnego katalogu użytkownika.

Na podstawie jakiego adresu przełącznik podejmuje decyzję o przesyłaniu ramek?

Który protokół zajmuje się konwersją adresów IP na adresy MAC (kontroli dostępu do nośnika)?

Jaką funkcję pełni polecenie tee w systemie Linux?

W architekturze sieci lokalnych opartej na modelu klient-serwer

Jaką minimalną ilość pamięci RAM powinien posiadać komputer, aby możliwe było zainstalowanie 32-bitowego systemu operacyjnego Windows 7 i praca w trybie graficznym?

Oprogramowanie, które regularnie przerywa działanie przez pokazanie komunikatu o konieczności uiszczenia opłaty, co prowadzi do zniknięcia tego komunikatu, jest dystrybuowane na podstawie licencji

Co oznacza określenie średni czas dostępu w dyskach twardych?

Do przeprowadzenia ręcznej konfiguracji interfejsu sieciowego w systemie Linux konieczne jest użycie polecenia

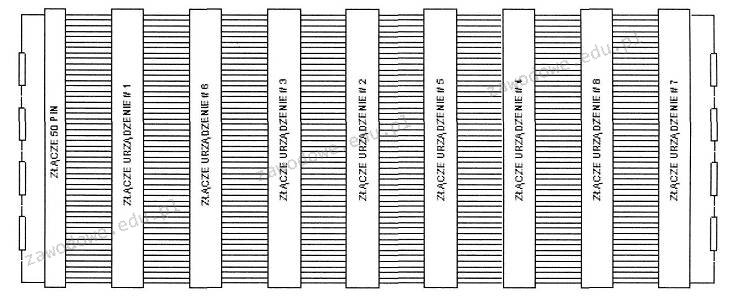

Za pomocą taśmy 60-pinowej pokazanej na ilustracji łączy się z płytą główną komputera

Do instalacji i usuwania oprogramowania w systemie Ubuntu wykorzystywany jest menedżer

Osoba korzystająca z systemu Windows zdecydowała się na przywrócenie systemu do określonego punktu. Które pliki utworzone po tym punkcie NIE zostaną zmienione w wyniku tej operacji?

Aby użytkownik notebooka z systemem Windows 7 lub nowszym mógł używać drukarki za pośrednictwem sieci WiFi, powinien zainstalować drukarkę na porcie

Na zdjęciu przedstawiono

Który z standardów implementacji sieci Ethernet określa sieć opartą na kablu koncentrycznym, gdzie długość segmentu nie może przekraczać 185 m?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Która edycja systemu operacyjnego Windows Server 2008 charakteryzuje się najmniej rozbudowanym interfejsem graficznym?

Który adres IP jest najwyższy w sieci 196.10.20.0/26?

Jakie oznaczenie wskazuje adres witryny internetowej oraz przypisany do niej port?

W którym trybie działania procesora Intel x86 uruchamiane były aplikacje 16-bitowe?

Jakie narzędzie wraz z odpowiednimi parametrami należy zastosować w systemie Windows, aby uzyskać przedstawione informacje o dysku twardym?

ST9500420AS Identyfikator dysku : A67B7C06 Typ : ATA Stan : Online Ścieżka : 0 Element docelowy : 0 Identyfikator jednostki LUN: 0 Ścieżka lokalizacji : PCIROOT(0)#ATA(C00T00L00) Bieżący stan tylko do odczytu : Nie Tylko do odczytu: Nie Dysk rozruchowy : Tak Dysk plików stronicowania: Tak Dysk plików hibernacji: Nie Dysk zrzutów awaryjnych: Tak Dysk klastrowany: Nie Wolumin ### Lit Etykieta Fs Typ Rozmiar Stan Info ----------- --- ----------- ----- ------------ ------- ------- -------- Wolumin 1 SYSTEM NTFS Partycja 300 MB Zdrowy System Wolumin 2 C NTFS Partycja 445 GB Zdrowy Rozruch Wolumin 3 D HP_RECOVERY NTFS Partycja 15 GB Zdrowy Wolumin 4 E HP_TOOLS FAT32 Partycja 5122 MB Zdrowy

Główną czynnością serwisową w drukarce igłowej jest zmiana pojemnika

Na ilustracji ukazany jest komunikat systemowy. Jakie kroki powinien podjąć użytkownik, aby naprawić błąd?

W procedurze Power-On Self-Test w pierwszej kolejności wykonywane jest sprawdzanie

W standardzie Ethernet 100BaseTX konieczne jest użycie kabli skręconych

W laserowej drukarce do utrwalania wydruku na papierze stosuje się

Każdorazowo automatycznie szyfrowany staje się plik, który został zaszyfrowany przez użytkownika za pomocą systemu NTFS 5.0, w momencie

Jakie są zasadnicze różnice pomiędzy poleceniem ps a poleceniem top w systemie Linux?