Pytanie 1

Jaką maksymalną prędkość transferu danych pozwala osiągnąć interfejs USB 3.0?

Wynik: 27/40 punktów (67,5%)

Wymagane minimum: 20 punktów (50%)

Jaką maksymalną prędkość transferu danych pozwala osiągnąć interfejs USB 3.0?

W topologii gwiazdy każde urządzenie działające w sieci jest

Złącze IrDA służy do bezprzewodowej komunikacji i jest

Jak nazywa się protokół oparty na architekturze klient-serwer oraz modelu żądanie-odpowiedź, wykorzystywany do przesyłania plików?

Usługa w systemie Windows Server, która umożliwia zdalną instalację systemów operacyjnych na komputerach zarządzanych przez serwer, to

Aby przekształcić serwer w kontroler domeny w systemach Windows Server, konieczne jest użycie komendy

Termin gorącego podłączenia (hot-plug) wskazuje, że podłączane urządzenie działa

Kto jest odpowiedzialny za alokację czasu procesora dla konkretnych zadań?

Na ilustracji ukazano narzędzie systemowe w Windows 7, które jest używane do

Polecenie grep w systemie Linux pozwala na

Jeżeli w konfiguracji karty graficznej zostanie wybrane odświeżanie obrazu większe od zalecanego, monitor CRT spełniający normy TCO 99

Moc zasilacza wynosi 450 W, co oznacza, że

Najwyższą prędkość przesyłania danych w sieci bezprzewodowej można osiągnąć używając urządzeń o standardzie

Na ilustracji widoczne jest urządzenie służące do

Jakim protokołem komunikacyjnym w warstwie transportowej, który zapewnia niezawodność przesyłania pakietów, jest protokół

Jaki wydruk w systemie rodziny Linux uzyskamy po wprowadzeniu komendy

dr-x------ 2 root root 0 lis 28 12:39 .gvfs -rw-rw-r-- 1 root root 361016 lis 8 2012 history.dat -rw-r--r-- 1 root root 97340 lis 28 12:39 .ICEauthority drwxrwxr-x 5 root root 4096 paź 7 2012 .icedtea drwx------ 3 root root 4096 cze 27 18:40 .launchpadlib drwxr-xr-x 3 root root 4096 wrz 2 2012 .local

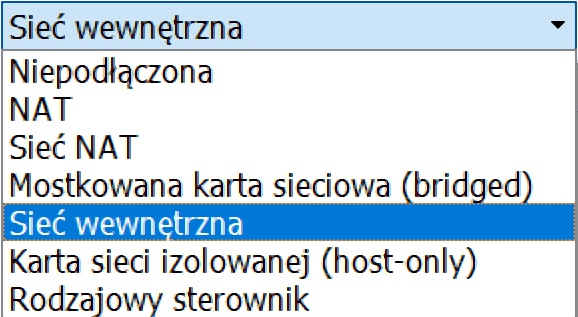

Na ilustracji przedstawiono opcje karty sieciowej w oprogramowaniu VirtualBox. Ustawienie na wartość sieć wewnętrzna, spowoduje, że

Komputery K1, K2, K3, K4 są podłączone do interfejsów przełącznika, które są przypisane do VLAN-ów wymienionych w tabeli. Które z tych komputerów mają możliwość komunikacji ze sobą?

| Nazwa komputera | Adres IP | Nazwa interfejsu | VLAN |

| K1 | 10.10.10.1/24 | F1 | VLAN 10 |

| K2 | 10.10.10.2/24 | F2 | VLAN 11 |

| K3 | 10.10.10.3/24 | F3 | VLAN 10 |

| K4 | 10.10.11.4/24 | F4 | VLAN 11 |

Jaką maksymalną prędkość danych można osiągnąć w sieci korzystającej z skrętki kategorii 5e?

Który kabel powinien być użyty do budowy sieci w lokalach, gdzie występują intensywne pola zakłócające?

Przy pomocy testów statycznych okablowania można zidentyfikować

Aby ustalić fizyczny adres karty sieciowej, w terminalu systemu Microsoft Windows należy wpisać komendę

W systemie Linux do bieżącego śledzenia działających procesów wykorzystuje się polecenie:

W systemie Windows ochrona polegająca na ostrzeganiu przed uruchomieniem nierozpoznanych aplikacji i plików pobranych z Internetu jest realizowana przez

Który z poniższych protokołów reprezentuje protokół warstwy aplikacji w modelu ISO/OSI?

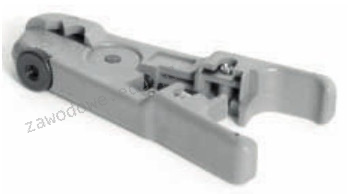

Na ilustracji zaprezentowane jest urządzenie do

Urządzenie pokazane na ilustracji ma na celu

Która struktura partycji pozwala na stworzenie do 128 partycji podstawowych na pojedynczym dysku?

Jaką maskę trzeba zastosować, aby podzielić sieć z adresem 192.168.1.0 na 4 podsieci?

W których nośnikach pamięci masowej uszkodzenia mechaniczne są najbardziej prawdopodobne?

Ile par kabli jest używanych w standardzie 100Base-TX do obustronnej transmisji danych?

Jakie polecenie w systemie Linux pokazuje czas działania systemu oraz jego średnie obciążenie?

Jaki adres stanowi adres rozgłoszeniowy dla hosta o IP 171.25.172.29 oraz masce sieci 255.255.0.0?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jakie polecenie w terminalu systemu operacyjnego Microsoft Windows umożliwi wyświetlenie szczegółów wszystkich zasobów udostępnionych na komputerze lokalnym?

Protokół, który pozwala na ściąganie wiadomości e-mail z serwera, to

Transmisja danych typu półduplex to transmisja

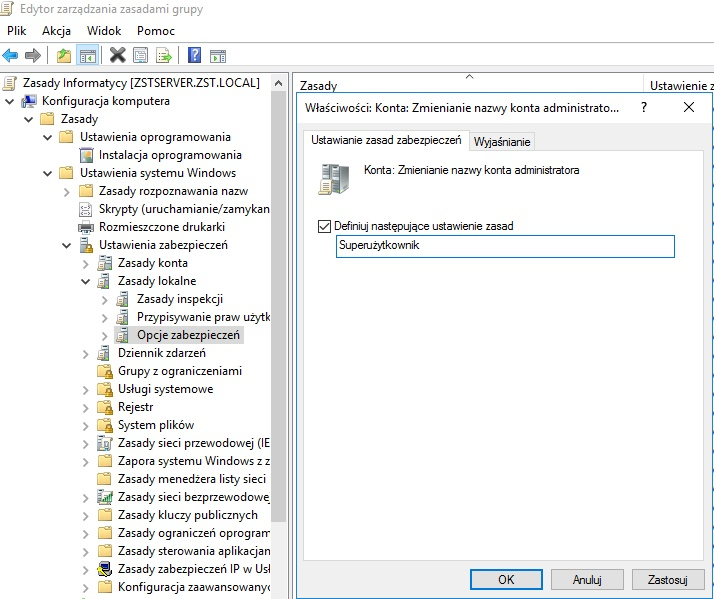

Rezultatem działania przedstawionego na ilustracji okna jest

Aby sprawdzić minimalny czas ważności hasła w systemie Windows, stosuje się polecenie

W nagłówku ramki standardu IEEE 802.3, który należy do warstwy łącza danych, znajduje się