Pytanie 1

Jaką szerokość ma magistrala pamięci DDR SDRAM?

Wynik: 20/40 punktów (50,0%)

Wymagane minimum: 20 punktów (50%)

Jaką szerokość ma magistrala pamięci DDR SDRAM?

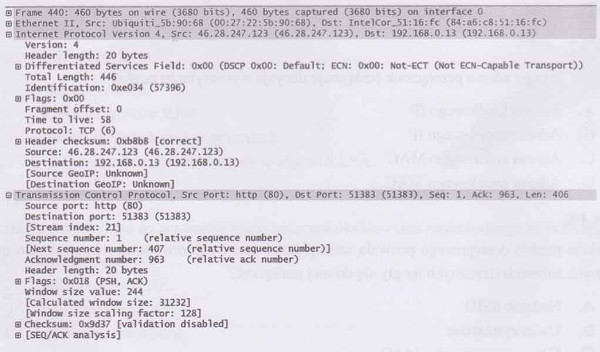

Na podstawie analizy pakietów sieciowych, określ adres IP oraz numer portu, z którego urządzenie otrzymuje odpowiedź?

Ile adresów można przypisać urządzeniom działającym w sieci o adresie IP 192.168.20.0/26?

W celu poprawy efektywności procesora Intel można wykorzystać procesor oznaczony literą

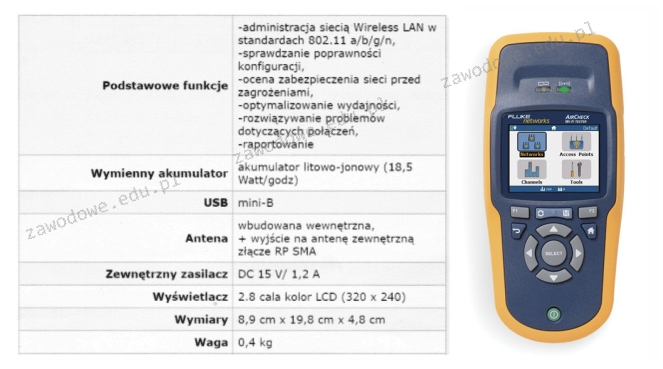

Za pomocą przedstawionego urządzenia można przeprowadzić diagnostykę działania

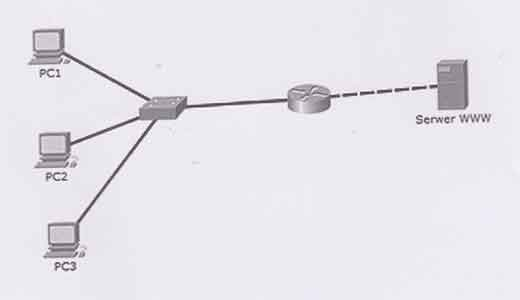

Użytkownicy w sieci lokalnej mogą się komunikować między sobą, lecz nie mają możliwości połączenia z serwerem WWW. Wynik polecenia ping z komputerów do bramy jest pozytywny. Który element sieci nie może być źródłem problemu?

W hurtowni materiałów budowlanych zachodzi potrzeba równoczesnego wydruku faktur w kilku kopiach. Jakiej drukarki należy użyć?

Podanie nieprawidłowych napięć do płyty głównej może skutkować

Czym jest parametr, który określa, o ile moc sygnału w danej parze przewodów zmniejszy się po przejściu przez cały tor kablowy?

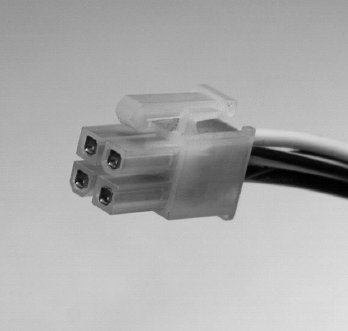

Na ilustracji ukazano złącze zasilające

Aby określić rozmiar wolnej oraz zajętej pamięci RAM w systemie Linux, można skorzystać z polecenia

Technologia procesorów z serii Intel Core, wykorzystywana w układach i5, i7 oraz i9, umożliwiająca podniesienie częstotliwości w sytuacji, gdy komputer potrzebuje większej mocy obliczeniowej, to

Jakie urządzenie diagnostyczne zostało zaprezentowane na ilustracji oraz opisane w specyfikacji zawartej w tabeli?

Który z parametrów należy użyć w poleceniu netstat, aby uzyskać statystyki interfejsu sieciowego dotyczące liczby przesłanych oraz odebranych bajtów i pakietów?

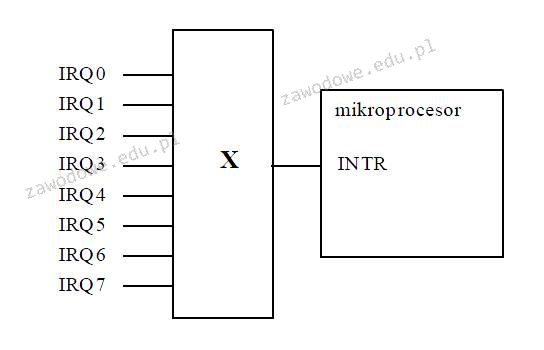

Na podstawie nazw sygnałów sterujących zidentyfikuj funkcję komponentu komputera oznaczonego na schemacie symbolem X?

Jakiego rodzaju złącze powinna mieć płyta główna, aby użytkownik był w stanie zainstalować kartę graficzną przedstawioną na rysunku?

Kiedy dysze w drukarce atramentowej wyschną z powodu długotrwałych przerw w użytkowaniu, co powinno się najpierw wykonać?

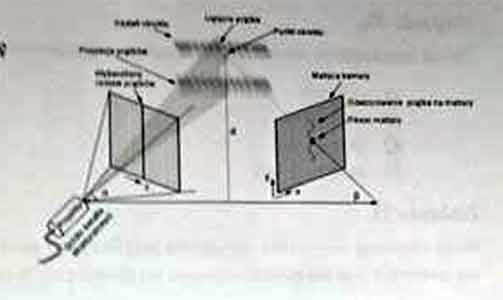

Zamieszczony poniżej diagram ilustruje zasadę działania skanera

Jakie elementy wchodzą w skład dokumentacji powykonawczej?

W dokumentacji technicznej wydajność głośnika połączonego z komputerem wyraża się w jednostce:

Który program umożliwia sprawdzanie stanów portów i wykonuje próby połączeń z nimi?

ping 192.168.11.3 Jaką komendę należy wpisać w miejsce kropek, aby w systemie Linux wydłużyć domyślny odstęp czasowy między pakietami podczas używania polecenia ping?

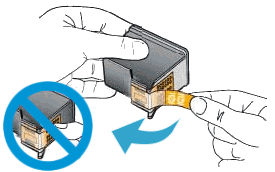

Przedstawiona czynność jest związana z eksploatacją drukarki

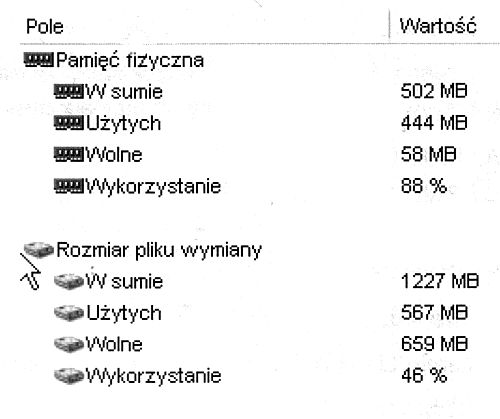

Zgodnie z zamieszczonym fragmentem testu w systemie komputerowym zainstalowane są

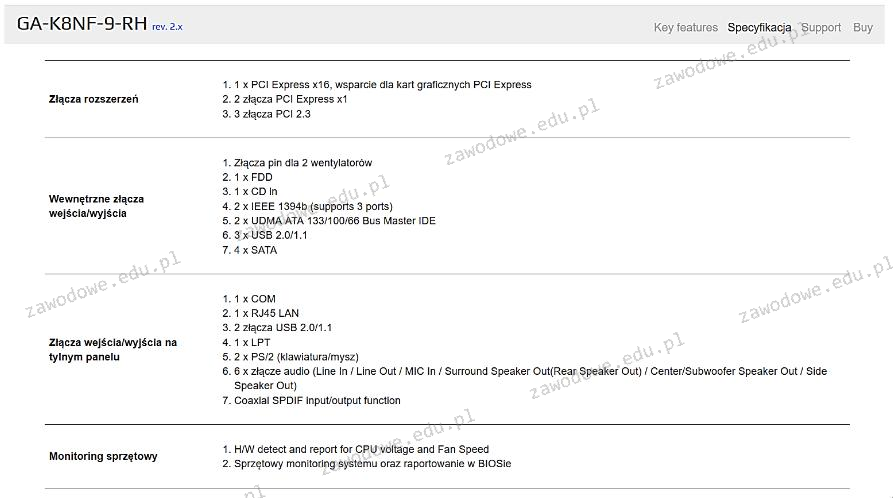

Na przedstawionym rysunku znajduje się fragment dokumentacji technicznej płyty głównej GA-K8NF-9-RH rev. 2.x. Z tego wynika, że maksymalna liczba kart rozszerzeń, które można zamontować (pomijając interfejs USB), wynosi

Które z urządzeń nie powinno być serwisowane podczas korzystania z urządzeń antystatycznych?

Plik ma rozmiar 2 KiB. Jest to

Wtyczka zaprezentowana na fotografie stanowi element obwodu elektrycznego zasilającego

Płyta główna serwerowa potrzebuje pamięci z rejestrem do prawidłowego funkcjonowania. Który z poniższych modułów pamięci będzie zgodny z tą płytą?

Zamiana taśmy barwiącej wiąże się z eksploatacją drukarki

Na wyświetlaczu drukarki pojawił się komunikat „PAPER JAM”. Aby usunąć usterkę, należy w pierwszej kolejności

Zastosowanie programu Wireshark polega na

Program testujący wydajność sprzętu komputerowego to

Który z parametrów twardego dysku NIE ma wpływu na jego wydajność?

Program CHKDSK jest wykorzystywany do

Aby osiągnąć przepustowość wynoszącą 4 GB/s w obie strony, konieczne jest zainstalowanie w komputerze karty graficznej korzystającej z interfejsu

W tablecie graficznym bez wyświetlacza pióro nie ustala położenia kursora ekranowego, można jedynie korzystać z jego końcówki do przesuwania kursora ekranowego oraz klikania. Wskaż możliwą przyczynę nieprawidłowej pracy urządzenia.

Co należy zrobić, gdy podczas uruchamiania komputera procedura POST sygnalizuje błąd odczytu lub zapisu pamięci CMOS?

Jaki instrument służy do określania długości oraz tłumienności kabli miedzianych?

Zidentyfikuj najprawdopodobniejszą przyczynę pojawienia się komunikatu "CMOS checksum error press F1 to continue press DEL to setup" podczas uruchamiania systemu komputerowego?