Pytanie 1

Na ilustracji przedstawiono

Wynik: 11/40 punktów (27,5%)

Wymagane minimum: 20 punktów (50%)

Na ilustracji przedstawiono

Jaką liczbę dziesiętną reprezentuje liczba 11110101U2)?

Diagnozowanie uszkodzonych komponentów komputera przez sprawdzenie stanu wyjściowego układu cyfrowego umożliwia

Jakiego typu dane są przesyłane przez interfejs komputera osobistego, jak pokazano na ilustracji?

| Bit startu | Bit danych | Bit danych | Bit stopu | Bit startu | Bit danych | Bit startu | Bit danych | Bit danych | Bit stopu | Bit startu | Bit danych | Bit stopu |

Jakie jest nominalne wyjście mocy (ciągłe) zasilacza o parametrach przedstawionych w tabeli?

| Napięcie wyjściowe | +5 V | +3.3 V | +12 V1 | +12 V2 | -12 V | +5 VSB |

|---|---|---|---|---|---|---|

| Prąd wyjściowy | 18,0 A | 22,0 A | 18,0 A | 17,0 A | 0,3 A | 2,5 A |

| Moc wyjściowa | 120 W | 336 W | 3,6 W | 12,5 W |

Administrator dostrzegł, że w sieci LAN występuje znaczna ilość kolizji. Jakie urządzenie powinien zainstalować, aby podzielić sieć lokalną na mniejsze domeny kolizji?

Aby zwiększyć efektywność komputera, można w nim zainstalować procesor wspierający technologię Hyper-Threading, co umożliwia

Termin określający wyrównanie tekstu do prawego i lewego marginesu to

Symbol graficzny zaprezentowany na rysunku oznacza opakowanie

Jakie zagrożenia eliminują programy antyspyware?

Jakie polecenie w systemie Linux jest używane do sprawdzania wielkości katalogu?

Jaki standard szyfrowania powinien być wybrany przy konfiguracji karty sieciowej, aby zabezpieczyć transmisję w sieci bezprzewodowej?

Komputer powinien działać jako serwer w sieci lokalnej, umożliwiając innym komputerom dostęp do Internetu poprzez podłączenie do gniazda sieci rozległej za pomocą kabla UTP Cat 5e. Na chwilę obecną komputer jest jedynie połączony ze switchem sieci lokalnej również kablem UTP Cat 5e oraz nie dysponuje innymi portami 8P8C. Jakiego komponentu musi on koniecznie nabrać?

Licencja grupowa na oprogramowanie Microsoft należy do typu

Jakie są poszczególne elementy adresu globalnego IPv6 typu unicast pokazane na ilustracji?

| IPv6 | ||

|---|---|---|

| 1 | 2 | 3 |

| 48 bitów | 16 bitów | 64 bity |

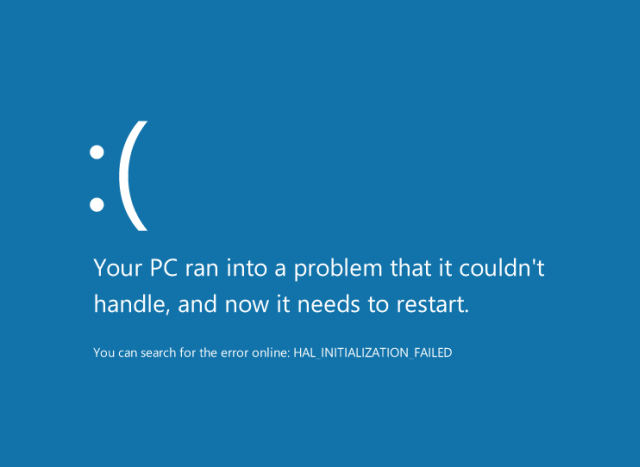

Zamieszczony komunikat tekstowy wyświetlony na ekranie komputera z zainstalowanym systemem Windows wskazuje na

W doborze zasilacza do komputera kluczowe znaczenie

Narzędzie, które chroni przed nieautoryzowanym dostępem do sieci lokalnej, to

Podane dane katalogowe odnoszą się do routera z wbudowaną pamięcią masową

| CPU | AtherosAR7161 680MHz |

| Memory | 32MB DDR SDRAM onboard memory |

| Boot loader | RouterBOOT |

| Data storage | 64MB onboard NAND memory chip |

| Ethernet | One 10/100 Mbit/s Fast Ethernet port with Auto-MDI/X |

| miniPCI | One MiniPCI Type IIIA/IIIB slot One MiniPCIe slot for 3G modem only (onboard SIM connector) |

| Wireless | Built in AR2417 802. 11 b/g wireless, 1x MMCX connector |

| Expansion | One USB 2.0 ports (without powering, needs power adapter, available separately) |

| Serial port | One DB9 RS232C asynchronous serial port |

| LEDs | Power, NAND activity, 5 user LEDs |

| Power options | Power over Ethernet: 10..28V DC (except power over datalines). Power jack: 10..28V DC. Includes voltage monitor |

| Dimensions | 105 mm x 105 mm, Weight: 82 g |

| Power consumption | Up to 5W with wireless at full activity |

| Operating System | MikroTik RouterOS v3, Level4 license |

Zjawisko crosstalk, które występuje w sieciach komputerowych, polega na

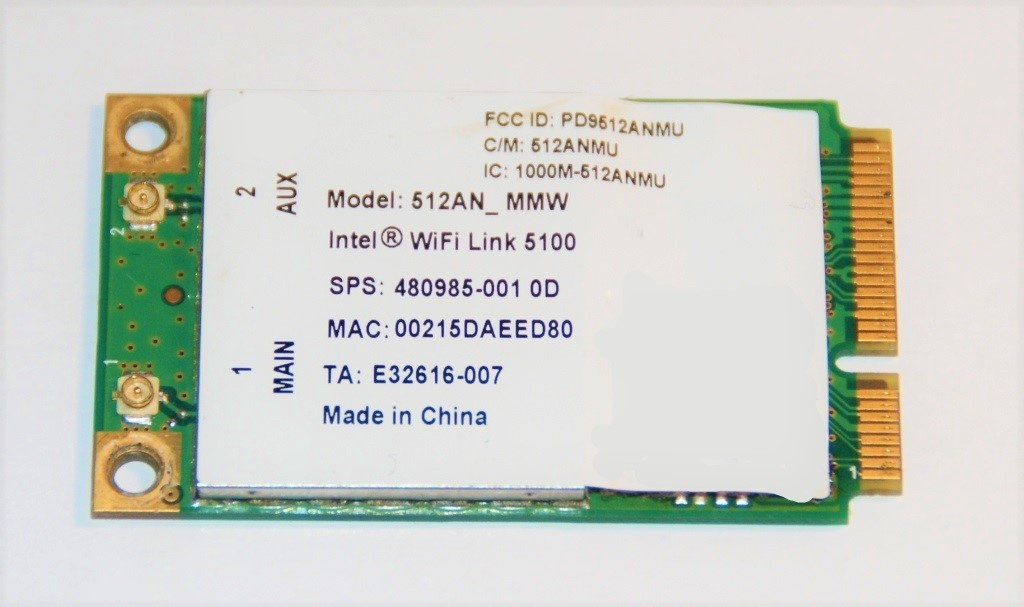

Karta sieciowa przedstawiona na ilustracji jest w stanie przesyłać dane z maksymalną szybkością

Trzech użytkowników komputera z systemem operacyjnym Windows XP Pro posiada swoje foldery z dokumentami w głównym katalogu dysku C:. Na dysku znajduje się system plików NTFS. Użytkownicy mają utworzone konta z ograniczonymi uprawnieniami. Jak można zabezpieczyć folder każdego z użytkowników, aby inni nie mieli możliwości modyfikacji jego zawartości?

Jakie oprogramowanie można wykorzystać do wykrywania problemów w pamięciach RAM?

W architekturze sieci lokalnych opartej na modelu klient-serwer

W systemie Windows harmonogram zadań umożliwia przydzielenie

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jakie jest zadanie usługi DNS?

Najwyższą prędkość transmisji danych w sieci bezprzewodowej zapewnia standard

Jaki protokół komunikacyjny jest używany do przesyłania plików w modelu klient-serwer oraz może funkcjonować w dwóch trybach: aktywnym i pasywnym?

Jak nazywa się rodzaj licencji, który sprawia, że program jest w pełni funkcjonalny, ale można go uruchomić jedynie określoną, niewielką liczbę razy od momentu instalacji?

Jakie są nazwy licencji, które umożliwiają korzystanie z programu w pełnym zakresie, ale ograniczają liczbę uruchomień do określonej, niewielkiej ilości od momentu instalacji?

Jakie urządzenie ilustruje ten rysunek?

Kondygnacyjny punkt dystrybucji jest połączony z

Klient dostarczył niesprawny sprzęt komputerowy do serwisu. Serwisant w trakcie procedury przyjęcia sprzętu, lecz przed przystąpieniem do jego naprawy, powinien

Organizacja zajmująca się międzynarodową normalizacją, która stworzyła 7-warstwowy Model Referencyjny Połączonych Systemów Otwartych, to

W systemie Windows do przeprowadzania aktualizacji oraz przywracania sterowników sprzętowych należy wykorzystać narzędzie

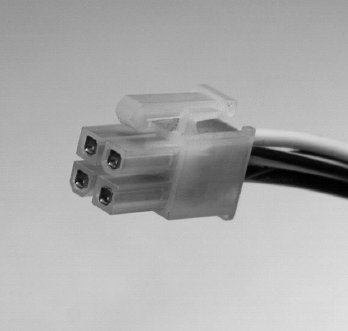

Wtyczka zaprezentowana na fotografie stanowi element obwodu elektrycznego zasilającego

W systemie Linux plik ma przypisane uprawnienia 765. Jakie działania może wykonać grupa związana z tym plikiem?

Jak nazywa się materiał używany w drukarkach 3D?

Rodzajem macierzy RAID, która nie jest odporna na awarię dowolnego z dysków wchodzących w jej skład, jest