Pytanie 1

W systemie Ubuntu, które polecenie umożliwia bieżące monitorowanie działających procesów i aplikacji?

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

W systemie Ubuntu, które polecenie umożliwia bieżące monitorowanie działających procesów i aplikacji?

Jaką kwotę będzie trzeba zapłacić za wymianę karty graficznej w komputerze, jeżeli jej koszt wynosi 250zł, czas wymiany to 80 minut, a każda rozpoczęta roboczogodzina to 50zł?

W protokole IPv4 adres broadcastowy, zapisany w formacie binarnym, bez podziału na podsieci, w sekcji przeznaczonej dla hosta zawiera

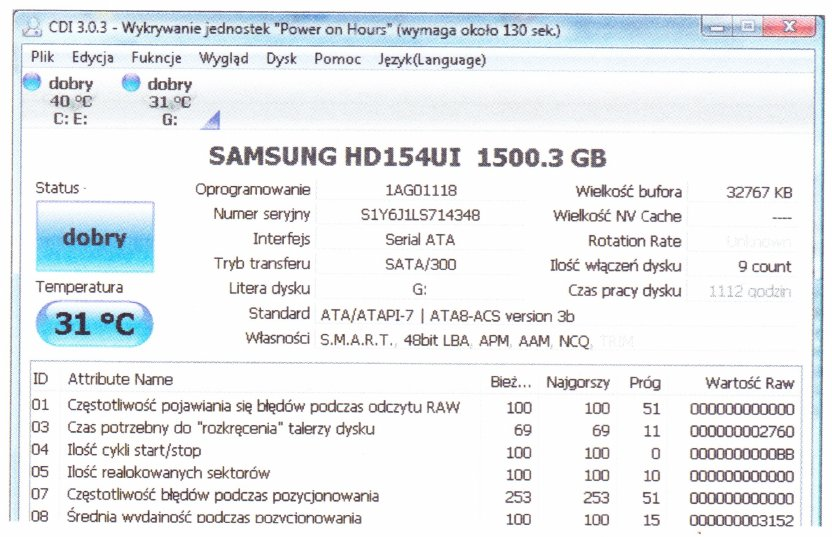

Na ilustracji zaprezentowano system monitorujący

Jakie jest znaczenie jednostki dpi, która występuje w specyfikacjach skanerów i drukarek?

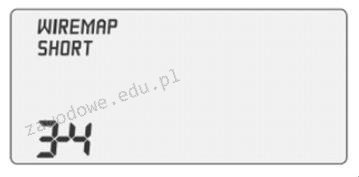

Na rysunku ukazano rezultat testu okablowania. Jakie jest znaczenie uzyskanego wyniku pomiaru?

Które z poniższych stwierdzeń odnosi się do sieci P2P – peer to peer?

Która licencja pozwala na darmowe korzystanie z programu, pod warunkiem, że użytkownik dba o środowisko naturalne?

Cechą oprogramowania służącego do monitorowania zdarzeń metodą Out-Of-Band w urządzeniach sieciowych jest

Jakim materiałem eksploatacyjnym dysponuje ploter solwentowy?

Do przeprowadzenia aktualizacji systemów Linux można zastosować aplikacje

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jak należy rozmieszczać gniazda komputerowe RJ45 w odniesieniu do przestrzeni biurowej zgodnie z normą PN-EN 50174?

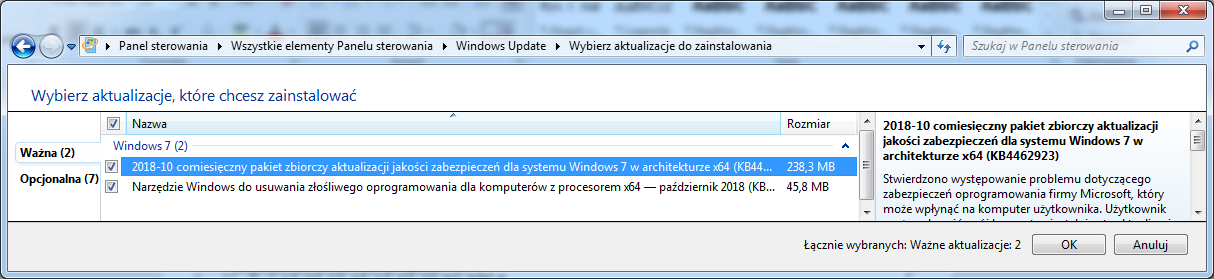

Głównie które aktualizacje zostaną zainstalowane po kliknięciu na przycisk OK prezentowany na zrzucie ekranu?

Jakie parametry otrzyma interfejs sieciowy eth0 po wykonaniu poniższych poleceń w systemie Linux?

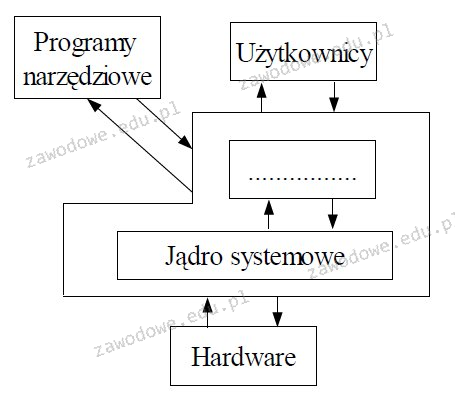

Jaki termin powinien zostać umieszczony w miejscu z kropkami na schemacie blokowym przedstawiającym strukturę systemu operacyjnego?

Który z protokołów zapewnia bezpieczne połączenie między klientem a witryną internetową banku, zachowując prywatność użytkownika?

Który z wymienionych protokołów jest szyfrowanym protokołem do zdalnego dostępu?

Na ilustracji ukazana jest karta

W jakiej technologii produkcji projektorów stosowany jest system mikroskopijnych luster, przy czym każde z nich odpowiada jednemu pikselowi wyświetlanego obrazu?

Programem w systemie Linux, który umożliwia nadzorowanie systemu za pomocą zcentralizowanego mechanizmu, jest narzędzie

Określ adres sieci, do której przypisany jest host o adresie 172.16.0.123/27?

Korzystając z podanego urządzenia, możliwe jest przeprowadzenie analizy działania

Jakie medium transmisyjne charakteryzuje się najmniejszym ryzykiem zakłóceń elektromagnetycznych sygnału przesyłanego?

W wyniku wykonania komendy: net user w terminalu systemu Windows, pojawi się

Mamy do czynienia z siecią o adresie 192.168.100.0/24. Ile podsieci można utworzyć, stosując maskę 255.255.255.224?

Jaki pakiet powinien zostać zainstalowany na serwerze Linux, aby umożliwić stacjom roboczym z systemem Windows dostęp do plików i drukarek udostępnianych przez ten serwer?

Który algorytm służy do weryfikacji, czy ramka Ethernet jest wolna od błędów?

Usługa RRAS serwera Windows 2019 jest przeznaczona do

Za co odpowiada protokół DNS?

Aby poprawić bezpieczeństwo zasobów sieciowych, administrator sieci komputerowej w firmie otrzymał zadanie podziału aktualnej lokalnej sieci komputerowej na 16 podsieci. Obecna sieć posiada adres IP 192.168.20.0 i maskę 255.255.255.0. Jaką maskę sieci powinien zastosować administrator?

Który adres IP jest powiązany z nazwą mnemoniczna localhost?

Zaproponowany fragment ustawień zapory sieciowej umożliwia przesył danych przy użyciu protokołów ```iptables -A INPUT --protocol tcp --dport 443 -j ACCEPT iptables -A INPUT --protocol tcp --dport 143 -j ACCEPT iptables -A OUTPUT --protocol tcp --dport 443 -j ACCEPT iptables -A OUTPUT --protocol tcp --dport 143 -j ACCEPT```

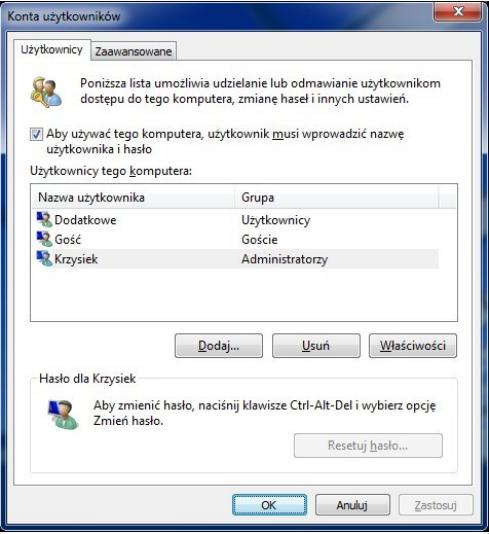

Aby aktywować zaprezentowane narzędzie systemu Windows, konieczne jest użycie komendy

Użytkownik systemu Windows doświadcza komunikatów o niewystarczającej pamięci wirtualnej. Jak można rozwiązać ten problem?

W zestawieniu przedstawiono istotne parametry techniczne dwóch typów interfejsów. Z powyższego wynika, że SATA w porównaniu do ATA charakteryzuje się

| Table Comparison of parallel ATA and SATA | ||

|---|---|---|

| Parallel ATA | SATA 1.5 Gb/s | |

| Bandwidth | 133 MB/s | 150 MB/s |

| Volts | 5V | 250 mV |

| Number of pins | 40 | 7 |

| Cable length | 18 in. (45.7 cm) | 39 in. (1 m) |

Komenda dsadd pozwala na

Jakie polecenie należy wykorzystać w systemie Windows, aby usunąć bufor nazw domenowych?

W ustawieniach haseł w systemie Windows Server aktywowano opcję, że hasło musi spełniać wymagania dotyczące złożoności. Z jakiej minimalnej liczby znaków musi składać się hasło użytkownika?

Czytnik w napędzie optycznym, który jest zanieczyszczony, należy oczyścić