Pytanie 1

Wskaź, które z poniższych stwierdzeń dotyczących zapory sieciowej jest nieprawdziwe?

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

Wskaź, które z poniższych stwierdzeń dotyczących zapory sieciowej jest nieprawdziwe?

W systemie Windows harmonogram zadań umożliwia przydzielenie

Aby zrealizować usługę zdalnego uruchamiania systemów operacyjnych na komputerach stacjonarnych, należy w Windows Server zainstalować rolę

Parametr pamięci RAM określany czasem jako opóźnienie definiuje się jako

Jak nazywa się urządzenie wskazujące, które współpracuje z monitorami CRT i ma końcówkę z elementem światłoczułym, a jego dotknięcie ekranu monitora skutkuje przesłaniem sygnału do komputera, co umożliwia lokalizację kursora?

W jakim systemie występuje jądro hybrydowe (kernel)?

Jakie polecenie w systemie Linux pozwala na wyświetlenie oraz edytowanie tablicy trasowania pakietów sieciowych?

Problemy z laptopem, objawiające się zmienionymi barwami lub brakiem określonego koloru na ekranie, mogą być spowodowane uszkodzeniem

Cechą charakterystyczną pojedynczego konta użytkownika w systemie Windows Serwer jest

W systemie Windows pamięć wirtualna ma na celu

Na ilustracji zaprezentowano porty, które są częścią karty

Która pula adresów IPv6 jest odpowiednikiem adresów prywatnych w IPv4?

Cechą charakterystyczną transmisji za pomocą interfejsu równoległego synchronicznego jest to, że

Na komputerze z zainstalowanymi systemami operacyjnymi Windows i Linux, po przeprowadzeniu reinstalacji systemu Windows, drugi system przestaje się uruchamiać. Aby przywrócić możliwość uruchamiania systemu Linux oraz zachować dane i ustawienia w nim zgromadzone, co należy zrobić?

Jakie korzyści płyną z zastosowania systemu plików NTFS?

Użytkownik chce zabezpieczyć mechanicznie dane na karcie pamięci przed przypadkowym skasowaniem. Takie zabezpieczenie umożliwia karta

Jakie oprogramowanie chroni komputer przed niechcianym softwarem pochodzącym z sieci?

Jakie stwierdzenie o routerach jest poprawne?

Program CHKDSK jest wykorzystywany do

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Ikona błyskawicy widoczna na ilustracji służy do identyfikacji złącza

Który z protokołów służy do weryfikacji poprawności połączenia między dwoma hostami?

Jakie medium transmisyjne jest związane z adapterem przedstawionym na ilustracji?

Aby utworzyć obraz dysku twardego, można skorzystać z programu

Która z licencji pozwala każdemu użytkownikowi na wykorzystywanie programu bez ograniczeń związanych z prawami autorskimi?

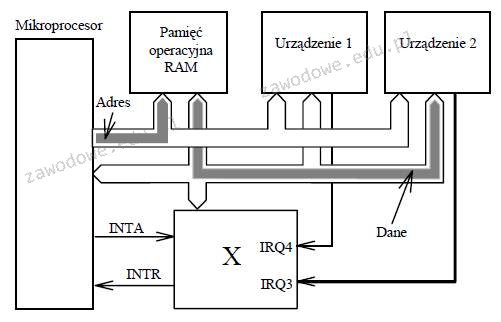

Na przedstawionym schemacie blokowym fragmentu systemu mikroprocesorowego, co oznacza symbol X?

Ile par przewodów w standardzie 100Base-TX jest używanych do przesyłania danych w obie strony?

W systemie Linux komenda cd ~ umożliwia

Najskuteczniejszym sposobem na dodanie skrótu do konkretnego programu na pulpitach wszystkich użytkowników w domenie jest

Jakie polecenie w systemie Linux rozpoczyna weryfikację dysku oraz pozwala na usunięcie jego usterek?

Który standard z rodziny IEEE 802 odnosi się do sieci bezprzewodowych, zwanych Wireless LAN?

Jakiego narzędzia należy użyć do montażu końcówek kabla UTP w gnieździe keystone z zaciskami typu 110?

Użytkownik systemu Windows wybrał opcję powrót do punktu przywracania. Które pliki powstałe po wybranym punkcie nie zostaną naruszone przez tę akcję?

Składnikiem systemu Windows 10, który zapewnia ochronę użytkownikom przed zagrożeniami ze strony złośliwego oprogramowania, jest program

Po zauważeniu przypadkowego skasowania istotnych danych na dysku, najlepszym sposobem na odzyskanie usuniętych plików jest

Jakie polecenie w systemie Linux umożliwia wyświetlenie listy zawartości katalogu?

Regulacje dotyczące konstrukcji systemu okablowania strukturalnego, parametry kabli oraz procedury testowania obowiązujące w Polsce są opisane w normach

Wynikiem mnożenia dwóch liczb binarnych 11100110 oraz 00011110 jest liczba

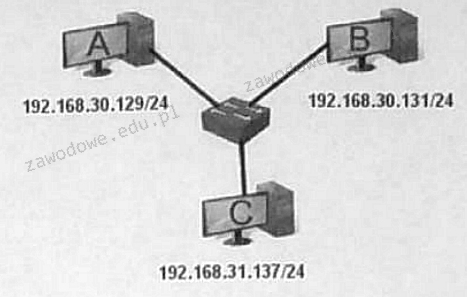

Hosty A i B nie są w stanie nawiązać komunikacji z hostem C. Między hostami A i B wszystko działa poprawnie. Jakie mogą być powody, dla których hosty A i C oraz B i C nie mogą się komunikować?

Jakie jest IPv4 urządzenia znajdującego się w sieci 10.100.0.0/18?