Pytanie 1

W systemach Windows XP Pro/Windows Vista Business/Windows 7 Pro/Windows 8 Pro, funkcją zapewniającą ochronę danych dla użytkowników dzielących ten sam komputer, których informacje mogą być wykorzystywane wyłącznie przez nich, jest

Wynik: 17/40 punktów (42,5%)

Wymagane minimum: 20 punktów (50%)

W systemach Windows XP Pro/Windows Vista Business/Windows 7 Pro/Windows 8 Pro, funkcją zapewniającą ochronę danych dla użytkowników dzielących ten sam komputer, których informacje mogą być wykorzystywane wyłącznie przez nich, jest

Jakie urządzenie powinno być zainstalowane w serwerze, aby umożliwić automatyczne archiwizowanie danych na taśmach magnetycznych?

Który standard IEEE 802.3 powinien być użyty w sytuacji z zakłóceniami elektromagnetycznymi, jeżeli odległość między punktem dystrybucyjnym a punktem abonenckim wynosi 200 m?

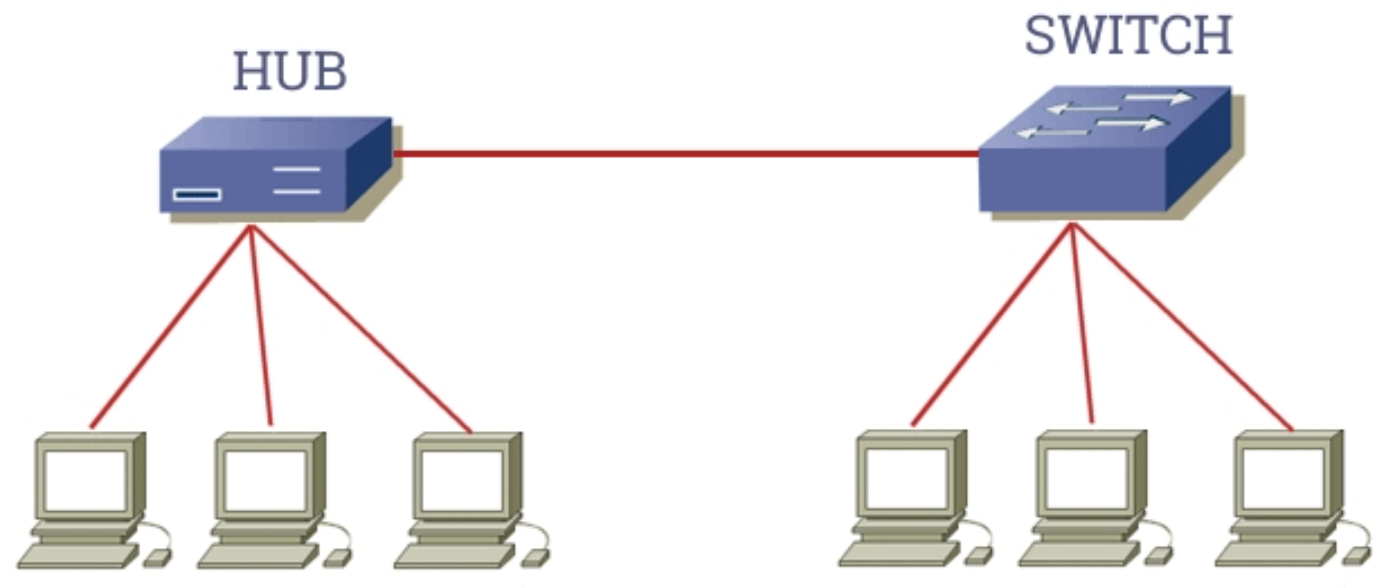

Ile domen kolizyjnych występuje w sieci pokazanej na rysunku?

Jakie materiały eksploatacyjne wykorzystuje się w rzutniku multimedialnym?

Poprzez użycie polecenia ipconfig /flushdns można przeprowadzić konserwację urządzenia sieciowego, która polega na

Oprogramowanie, które jest przypisane do konkretnego komputera lub jego komponentu i nie pozwala na reinstalację na nowszym sprzęcie zakupionym przez tego samego użytkownika, nosi nazwę

Aby serwer z systemem Linux mógł udostępniać pliki i drukarki komputerom klienckim z systemem Windows, należy zainstalować na nim

Korzystając z programu Cipher, użytkownik systemu Windows ma możliwość

Jaką licencję ma wolne i otwarte oprogramowanie?

Po włączeniu komputera wyświetlił się komunikat: Non-system disk or disk error. Replace and strike any key when ready. Co może być tego przyczyną?

W standardzie Ethernet 100Base-TX do przesyłania danych używane są żyły kabla UTP przypisane do pinów

Układ na karcie graficznej, którego zadaniem jest zamiana cyfrowego sygnału generowanego poprzez kartę na sygnał analogowy, który może być wyświetlony poprzez monitor to

Przy zmianach w rejestrze Windows w celu zapewnienia bezpieczeństwa należy najpierw

Główną rolą serwera FTP jest

W technologii Ethernet 100Base-TX do przesyłania danych używane są żyły kabla UTP podłączone do pinów:

Notacja #102816 oznacza zapis w systemie liczbowym

Jakie oprogramowanie jest wykorzystywane do kontrolowania stanu dysków twardych?

W wyniku polecenia net accounts /MINPWLEN:11 w systemie Windows, wartość 11 będzie przypisana do

Atak typu hijacking na serwer internetowy charakteryzuje się

Jakim procesem jest nieodwracalne usunięcie możliwości odzyskania danych z hard dysku?

Aby przywrócić dane, które zostały usunięte dzięki kombinacji klawiszy Shift+Delete, trzeba

Aby w systemie Windows ustawić właściwości wszystkich zainstalowanych urządzeń lub wyświetlić ich listę, należy użyć narzędzia

Który z protokołów jest używany podczas rozpoczynania sesji VoIP?

Po włączeniu komputera na ekranie wyświetlił się komunikat "Non-system disk or disk error. Replace and strike any key when ready". Możliwą przyczyną tego może być

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Protokół Datagramów Użytkownika (UDP) należy do kategorii

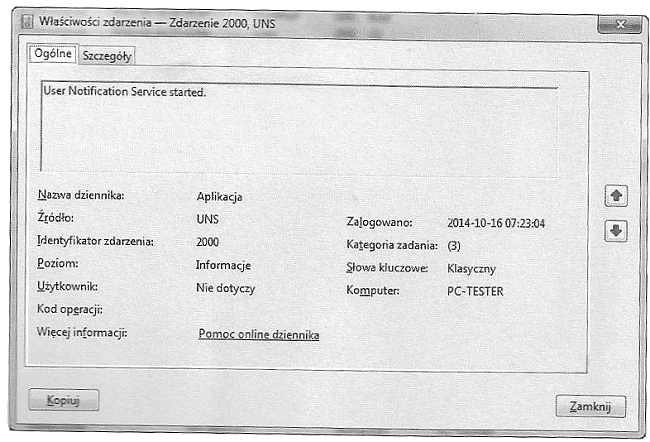

Wpis przedstawiony na ilustracji w dzienniku zdarzeń klasyfikowany jest jako zdarzenie typu

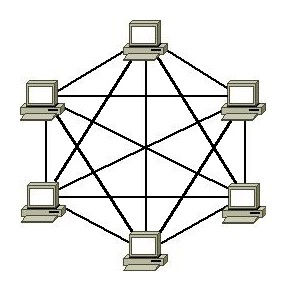

Jakiego rodzaju fizyczna topologia sieci komputerowej jest zobrazowana na rysunku?

Urządzenie, które pozwala na połączenie hostów w jednej sieci z hostami w różnych sieciach, to

Do usunięcia kurzu z wnętrza obudowy drukarki fotograficznej zaleca się zastosowanie

Analiza tłumienia w kablowym systemie przesyłowym umożliwia ustalenie

Jaką kwotę trzeba będzie zapłacić za wymianę karty graficznej w komputerze, jeśli koszt karty wynosi 250 zł, czas wymiany to 80 minut, a cena za każdą rozpoczętą roboczogodzinę to 50 zł?

Jak nazywa się kod kontrolny, który służy do wykrywania błędów oraz potwierdzania poprawności danych odbieranych przez stację końcową?

Jakiego typu kopię zapasową należy wykonać, aby zarchiwizować wszystkie informacje, niezależnie od daty ich ostatniej archiwizacji?

Rodzajem macierzy RAID, która nie jest odporna na awarię dowolnego z dysków wchodzących w jej skład, jest

Standard IEEE 802.11b dotyczy sieci

Polecenie df w systemie Linux umożliwia

Ile gniazd RJ45 podwójnych powinno być zainstalowanych w pomieszczeniu o wymiarach 8 x 5 m, aby spełniały wymagania normy PN-EN 50173?

Który symbol przedstawia przełącznik?