Pytanie 1

Dysk z systemem plików FAT32, na którym regularnie przeprowadza się działania usuwania starych plików oraz dodawania nowych plików, doświadcza

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

Dysk z systemem plików FAT32, na którym regularnie przeprowadza się działania usuwania starych plików oraz dodawania nowych plików, doświadcza

Jakim modułem pamięci RAM, który jest zgodny z płytą główną GIGABYTE GA-X99-ULTRA GAMING/ X99/8xDDR4 2133, ECC, maksymalnie 128GB/ 4x PCI-E 16x/ RAID/ USB 3.1/ S-2011-V3/ATX, jest pamięć?

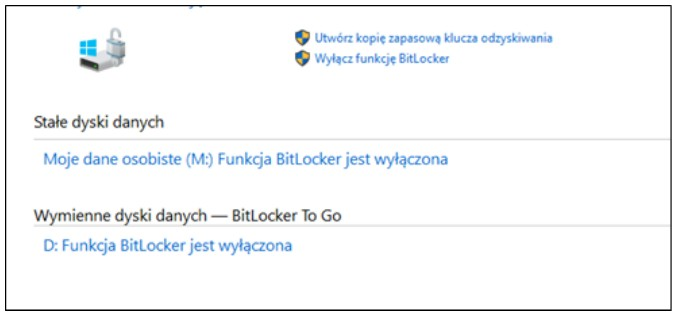

Narzędzie wbudowane w systemy Windows w edycji Enterprise lub Ultimate ma na celu

Jakie napięcie zasilające mogą mieć urządzenia wykorzystujące port USB 2.0?

Jakiego kodu numerycznego należy użyć w komendzie zmiany uprawnień do katalogu w systemie Linux, aby właściciel folderu miał prawa do zapisu i odczytu, grupa posiadała prawa do odczytu i wykonywania, a pozostali użytkownicy jedynie prawa do odczytu?

W przypadku dłuższego nieużytkowania drukarki atramentowej, pojemniki z tuszem powinny

Licencja Windows OEM nie zezwala na wymianę

Kabel sieciowy z końcówkami RJ45 był testowany za pomocą diodowego urządzenia do sprawdzania okablowania. Na tym urządzeniu diody LED włączały się po kolei, z wyjątkiem diod oznaczonych numerami 2 i 3, które świeciły jednocześnie na jednostce głównej testera, natomiast nie świeciły na jednostce zdalnej. Jaka była tego przyczyna?

Urządzenie, które zamienia otrzymane ramki na sygnały przesyłane w sieci komputerowej, to

Aby utworzyć ukryty, udostępniony folder w systemie Windows Serwer, należy dodać na końcu jego nazwy odpowiedni znak

Który z standardów korzysta z częstotliwości 5 GHz?

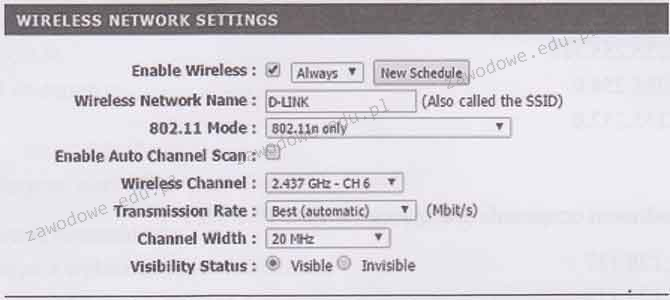

Który z parametrów w ustawieniach punktu dostępowego działa jako login używany podczas próby połączenia z punktem dostępowym w sieci bezprzewodowej?

Protokół stosowany do rozgłaszania w grupie, dzięki któremu hosty informują o swoim członkostwie, to

Skrót określający translację adresów w sieciach to

Użytkownicy z grupy Pracownicy nie mają możliwości drukowania dokumentów za pomocą serwera wydruku w systemie Windows Server. Posiadają oni jedynie uprawnienia do „Zarządzania dokumentami”. Jakie kroki należy podjąć, aby naprawić ten problem?

W systemach Windows, aby określić, w którym miejscu w sieci zatrzymał się pakiet, stosuje się komendę

Jakie polecenie w systemie operacyjnym Linux służy do monitorowania komunikacji protokołów TCP/IP lub innych przesyłanych lub odbieranych w sieci komputerowej, do której jest podłączony komputer użytkownika?

Jaki zakres grupy jest automatycznie przypisywany dla nowo stworzonej grupy w kontrolerze domeny systemu Windows Serwer?

Jaka licencja ma charakter zbiorowy i pozwala instytucjom komercyjnym oraz organizacjom edukacyjnym, rządowym, charytatywnym na nabycie większej liczby programów firmy Microsoft na korzystnych warunkach?

Polecenie to zostało wydane przez Administratora systemu operacyjnego w trakcie ręcznej konfiguracji sieciowego interfejsu. Wynikiem wykonania tego polecenia jest ```netsh interface ip set address name="Glowna" static 151.10.10.2 255.255.0.0 151.10.0.1```

W systemie Windows można przeprowadzić analizę wpływu uruchomionych aplikacji na wydajność komputera, korzystając z polecenia

Narzędziem wykorzystywanym do diagnozowania połączeń między komputerami w systemie Windows jest

Jakie będą łączne wydatki na wymianę karty graficznej w komputerze, jeżeli nowa karta kosztuje 250 zł, czas wymiany wynosi 80 minut, a każda rozpoczęta robocza godzina to koszt 50 zł?

Który z poniższych elementów jest częścią mechanizmu drukarki atramentowej?

Użytkownik dysponuje komputerem o podanej konfiguracji i systemie Windows 7 Professional 32bit. Która z opcji modernizacji komputera NIE przyczyni się do zwiększenia wydajności?

| Płyta główna | ASRock Z97 Anniversary Z97 DualDDR3-1600 SATA3 RAID HDMI ATX z czterema slotami DDR3 i obsługą RAID poziomu 0,1 |

| Procesor | i3 |

| Pamięć | 1 x 4 GB DDR3 |

| HDD | 2 x 1 TB |

Aby podłączyć kabel w module Keystone, jakie narzędzie należy zastosować?

Jakie narzędzie powinno się wykorzystać w systemie Windows, aby uzyskać informacje o problemach z systemem?

Protokół pakietów użytkownika, który zapewnia dostarczanie datagramów w trybie bezpołączeniowym, to

Użytkownik systemu Linux, który pragnie usunąć konto innego użytkownika wraz z jego katalogiem domowym, powinien wykonać polecenie

Zarządzanie pasmem (ang. bandwidth control) w switchu to funkcjonalność

Osoba korzystająca z lokalnej sieci musi mieć możliwość dostępu do dokumentów umieszczonych na serwerze. W tym celu powinna

Aby zdalnie i jednocześnie bezpiecznie zarządzać systemem Linux, należy zastosować protokół

Użytkownik systemu Windows doświadcza komunikatów o niewystarczającej pamięci wirtualnej. Jak można rozwiązać ten problem?

Jakie jest najwyższe możliwe tempo odczytu płyt CD-R w urządzeniu o oznaczeniu x48?

Aby użytkownik systemu Linux mógł sprawdzić zawartość katalogu, wyświetlając pliki i katalogi, oprócz polecenia ls może skorzystać z polecenia

Aby uzyskać na ekranie monitora odświeżanie obrazu 85 razy w ciągu sekundy, trzeba częstotliwość jego odświeżania ustawić na

W systemie Linux program top umożliwia

Podczas skanowania reprodukcji obrazu z czasopisma, na skanie obrazu pojawiły się regularne wzory, tak zwana mora. Z jakiej funkcji skanera należy skorzystać, aby usunąć morę?

Co jest przyczyną wysokiego poziomu przesłuchu zdalnego w kablu?

Którego polecenia należy użyć, aby w ruterze skonfigurować trasę statyczną dla adresu następnego skoku 192.168.1.1?