Pytanie 1

Wskaż porty płyty głównej przedstawione na ilustracji.

Wynik: 28/40 punktów (70,0%)

Wymagane minimum: 20 punktów (50%)

Wskaż porty płyty głównej przedstawione na ilustracji.

Który z protokołów służy do weryfikacji poprawności połączenia między dwoma hostami?

Do dynamicznej obsługi sprzętu w Linuxie jest stosowany system

Użytkownicy sieci Wi-Fi zauważyli zakłócenia oraz częste przerwy w połączeniu. Przyczyną tej sytuacji może być

Jakie będą łączne wydatki na wymianę karty graficznej w komputerze, jeżeli nowa karta kosztuje 250 zł, czas wymiany wynosi 80 minut, a każda rozpoczęta robocza godzina to koszt 50 zł?

Serwer, który realizuje żądania w protokole komunikacyjnym HTTP, to serwer

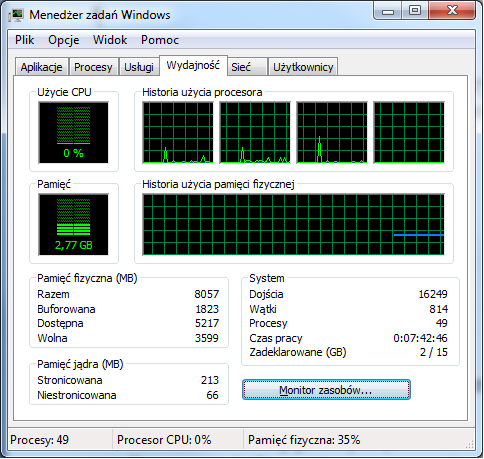

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Termin "PIO Mode" odnosi się do trybu operacyjnego

W systemie Windows przy użyciu polecenia assoc można

W systemie Linux plik messages zawiera

Jakie polecenie wykorzystano do analizy zaprezentowanej konfiguracji interfejsów sieciowych w systemie Linux?

enp0s25 Link encap:Ethernet HWaddr a0:b3:cc:28:8f:37 UP BROADCAST MULTICAST MTU:1500 Metric:1 RX packets:0 errors:0 dropped:0 overruns:0 frame:0 TX packets:0 errors:0 dropped:0 overruns:0 carrier:0 collisions:0 txqueuelen:1000 RX bytes:0 (0.0 B) TX bytes:0 (0.0 B) Interrupt:20 Memory:d4700000-d4720000 lo Link encap:Local Loopback inet addr:127.0.0.1 Mask:255.0.0.0 inet6 addr: ::1/128 Scope:Host UP LOOPBACK RUNNING MTU:65536 Metric:1 RX packets:172 errors:0 dropped:0 overruns:0 frame:0 TX packets:172 errors:0 dropped:0 overruns:0 carrier:0 collisions:0 txqueuelen:1000 RX bytes:13728 (13.7 KB) TX bytes:13728 (13.7 KB) wlo1 Link encap:Ethernet HWaddr 60:67:20:3f:91:22 inet addr:192.168.1.11 Bcast:192.168.1.255 Mask:255.255.255.0 inet6 addr: fe80::dcf3:c20b:57f7:21b4/64 Scope:Link UP BROADCAST RUNNING MULTICAST MTU:1500 Metric:1 RX packets:7953 errors:0 dropped:0 overruns:0 frame:0 TX packets:4908 errors:0 dropped:0 overruns:0 carrier:0 collisions:0 txqueuelen:1000 RX bytes:9012314 (9.0 MB) TX bytes:501345 (501.3 KB)

Protokół ARP (Address Resolution Protocol) pozwala na przypisanie logicznych adresów warstwy sieciowej do rzeczywistych adresów warstwy

Jakie polecenie w systemie Linux jest używane do planowania zadań?

Komputer stracił łączność z siecią. Jakie działanie powinno być podjęte w pierwszej kolejności, aby naprawić problem?

Ile urządzeń jest w stanie współpracować z portem IEEE1394?

Złącze umieszczone na płycie głównej, które umożliwia podłączanie kart rozszerzeń o różnych ilościach pinów, w zależności od wersji, nazywane jest

Wskaż rysunek ilustrujący kondensator stały?

Nośniki informacji, takie jak dyski twarde, zapisują dane w jednostkach zwanych sektorami, które mają wielkość

Licencja Windows OEM nie zezwala na wymianę

Aby sprawdzić minimalny czas ważności hasła w systemie Windows, stosuje się polecenie

Jakie zastosowanie ma przedstawione narzędzie?

Jakie zakresy zostaną przydzielone przez administratora do adresów prywatnych w klasie C, przy użyciu maski 24 bitowej dla komputerów w lokalnej sieci?

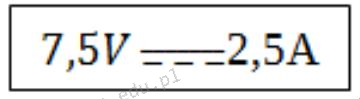

Na urządzeniu zasilanym prądem stałym znajduje się wskazane oznaczenie. Co można z niego wywnioskować o pobieranej mocy urządzenia, która wynosi około

W którym systemie operacyjnym może pojawić się komunikat podczas instalacji sterowników dla nowego urządzenia?

| System.......nie może zweryfikować wydawcy tego sterownika. Ten sterownik nie ma podpisu cyfrowego albo podpis nie został zweryfikowany przez urząd certyfikacji. Nie należy instalować tego sterownika, jeżeli nie pochodzi z oryginalnego dysku producenta lub od administratora systemu. |

W sytuacji, gdy nie ma możliwości uruchomienia programu BIOS Setup, jak przywrócić domyślne ustawienia płyty głównej?

Na zdjęciu przedstawiono

Na nowym urządzeniu komputerowym program antywirusowy powinien zostać zainstalowany

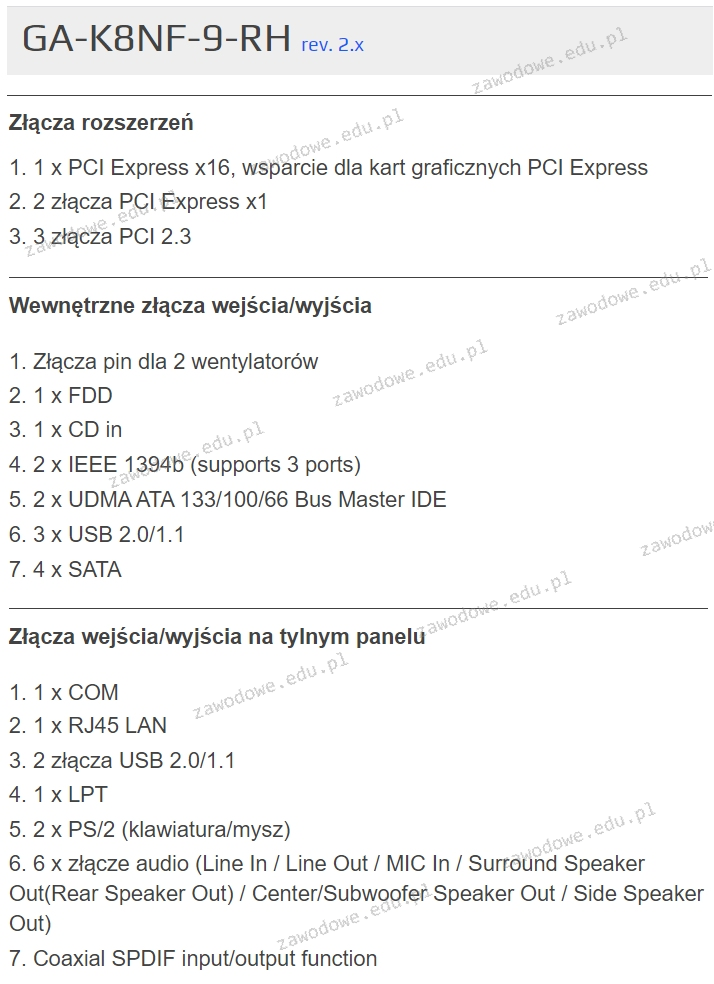

Do pokazanej na ilustracji płyty głównej nie da się podłączyć urządzenia korzystającego z interfejsu

Na ilustracji ukazano fragment dokumentacji technicznej płyty głównej GA-K8NF-9-RH rev. 2.x. Z informacji wynika, że maksymalna liczba kart rozszerzeń, które można zainstalować (pomijając złącza USB), wynosi

Jakiego rodzaju adresację stosuje protokół IPv6?

W systemie Linux plik ma przypisane uprawnienia 765. Jakie działania może wykonać grupa związana z tym plikiem?

W systemie Windows do uruchomienia przedstawionego narzędzia należy użyć polecenia

Algorytm wykorzystywany do weryfikacji, czy ramka Ethernet jest wolna od błędów, to

Element na karcie graficznej, który ma za zadanie przekształcenie cyfrowego sygnału wytwarzanego przez kartę na analogowy sygnał, zdolny do wyświetlenia na monitorze to

Wynikiem poprawnego pomnożenia dwóch liczb binarnych 111001102 oraz 000111102 jest wartość

Interfejs HDMI w komputerze umożliwia transfer sygnału

Jaką długość ma adres IP wersji 4?

Podczas procesu zamykania systemu operacyjnego na wyświetlaczu pojawił się błąd, znany jako bluescreen 0x000000F3 Bug Check 0xF3 DISORDERLY_SHUTDOWN - nieudane zakończenie pracy systemu, spowodowane brakiem pamięci. Co może sugerować ten błąd?

Narzędzie systemów operacyjnych Windows używane do zmiany ustawień interfejsów sieciowych, na przykład przekształcenie dynamicznej konfiguracji karty sieciowej w konfigurację statyczną, to

Złośliwe oprogramowanie, które może umożliwić atak na zainfekowany komputer, np. poprzez otwarcie jednego z portów, to