Pytanie 1

Która kategoria kabla UTP pozwala na przesył danych z prędkością 1 000 Mbit/s?

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

Która kategoria kabla UTP pozwala na przesył danych z prędkością 1 000 Mbit/s?

To pytanie jest dostępne tylko dla uczniów i nauczycieli. Zaloguj się lub utwórz konto aby zobaczyć pełną treść pytania.

Odpowiedzi dostępne po zalogowaniu.

Wyjaśnienie dostępne po zalogowaniu.

Programem umożliwiającym przechwytywanie i przeglądanie ruchu w sieci jest

To pytanie jest dostępne tylko dla uczniów i nauczycieli. Zaloguj się lub utwórz konto aby zobaczyć pełną treść pytania.

Odpowiedzi dostępne po zalogowaniu.

Wyjaśnienie dostępne po zalogowaniu.

Tony DTMF powstają z nałożenia na siebie dwóch sygnałów o różnych częstotliwościach przypisanych danemu przyciskowi (patrz tabela). Naciśnięcie 6 powoduje wytworzenie tonu, którego składowe to

| 1209 Hz | 1336 Hz | 1477 Hz | 1633 Hz | |

|---|---|---|---|---|

| 697 Hz | 1 | 2 | 3 | A |

| 770 Hz | 4 | 5 | 6 | B |

| 852 Hz | 7 | 8 | 9 | C |

| 941 Hz | * | 0 | # | D |

W metodzie tworzenia kopii zapasowych według schematu Dziadek - Ojciec - Syn nośnik oznaczony jako "Ojciec" służy do tworzenia kopii zapasowej

Przypisanie wartości sygnału skwantowanego do słów binarnych to

Funkcja MSN pozwala użytkownikowi

Jaki filtr tłumi składowe widma sygnału o wysokich częstotliwościach, a jednocześnie przepuszcza składowe o niskich częstotliwościach?

Jakie skutki dla ustawień systemu BIOS ma zwarcie zworki na płycie głównej oznaczonej jako CLR lub CLRTC albo CLE?

W jakiej technologii stosuje się kanał o przepustowości 64 kb/s, wąskopasmowy, określany mianem BRA?

W celu zainstalowania 64-bitowej wersji systemu Windows 7 na komputerze z:

- procesorem Intel Core 2 Duo 2.00 GHz 64-bit,

- pamięcią RAM 512 MB,

- dyskiem twardym o pojemności 80 GB,

- kartą graficzną Intel GMA X4500 obsługującą DirectX 10, co należy zrobić?

Co to jest QPSK w kontekście modulacji?

Który element osprzętu telekomunikacyjnego jest przedstawiony na zdjęciach?

Które z opcji w menu głównym BIOS-u należy wybrać, aby poprawić efektywność energetyczną systemu komputerowego?

Przedstawione na rysunku narzędzie jest stosowane do montażu

Która z poniższych właściwości światłowodów wpływa na ich wybór podczas projektowania sieci informatycznych?

Asynchroniczny układ sekwencyjny to cyfrowy system, w którym stan wyjść zależy

Jakie polecenie pozwala na wyświetlenie oraz modyfikację tabeli translacji adresów IP do adresów MAC?

Jaką wartość ma przepływność binarna w systemie PCM 30/32?

Ile wynosi nominalna przepływność systemu transmisyjnego oznaczonego symbolem E4?

W firmie drukuje się średnio około 1 800 stron miesięcznie. Która drukarka będzie najtańsza ze względu na koszty zakupu i eksploatacji w pierwszym miesiącu pracy?

| Oferta cenowa drukarek i tuszu do nich | ||||

|---|---|---|---|---|

| Drukarka A | Drukarka B | Drukarka C | Drukarka D | |

| Cena drukarki w zł | 350 | 200 | 300 | 150 |

| Cena tuszu w zł | 90 | 50 | 30 | 70 |

| Wydajność tuszu w stronach | 900 | 450 | 180 | 300 |

Która z wymienionych cech nie jest typowa dla komutacji pakietów?

Który z dostępnych standardów zapewnia najszybszy transfer danych?

Której metody kodowania dotyczy podany opis?

| Na początku sygnał przyjmuje stan odpowiadający jego wartości binarnej, w środku czasu transmisji bitu następuje zmiana sygnału na przeciwny. Dla zera poziom zmienia się z niskiego na wysoki, dla jedynki – z wysokiego na niski. Konwencja ta została wprowadzona przez G. E. Thomasa w 1949 roku. |

Zapora sieciowa typu filtra

Który element struktury GSM działa jako stacja bazowa, łącząca za pośrednictwem fal radiowych telefon (terminal mobilny) z całym systemem?

To pytanie jest dostępne tylko dla uczniów i nauczycieli. Zaloguj się lub utwórz konto aby zobaczyć pełną treść pytania.

Odpowiedzi dostępne po zalogowaniu.

Wyjaśnienie dostępne po zalogowaniu.

Metryka rutingu to wartość stosowana przez algorytmy rutingu do wyboru najbardziej efektywnej ścieżki. Wartość metryki nie jest uzależniona od

To pytanie jest dostępne tylko dla uczniów i nauczycieli. Zaloguj się lub utwórz konto aby zobaczyć pełną treść pytania.

Odpowiedzi dostępne po zalogowaniu.

Wyjaśnienie dostępne po zalogowaniu.

Jakie medium transmisyjne charakteryzuje się najwyższą odpornością na zakłócenia elektromagnetyczne?

To pytanie jest dostępne tylko dla uczniów i nauczycieli. Zaloguj się lub utwórz konto aby zobaczyć pełną treść pytania.

Odpowiedzi dostępne po zalogowaniu.

Wyjaśnienie dostępne po zalogowaniu.

Jaki rodzaj wykresu w programie do arkuszy kalkulacyjnych powinno się zastosować, aby zaprezentować procentowy udział poszczególnych wartości w całości?

Która z technologii umożliwia przesyłanie od 4 do 16 sygnałów w jednym włóknie światłowodowym z odstępem 20 nm w zakresie 1270-1610 nm?

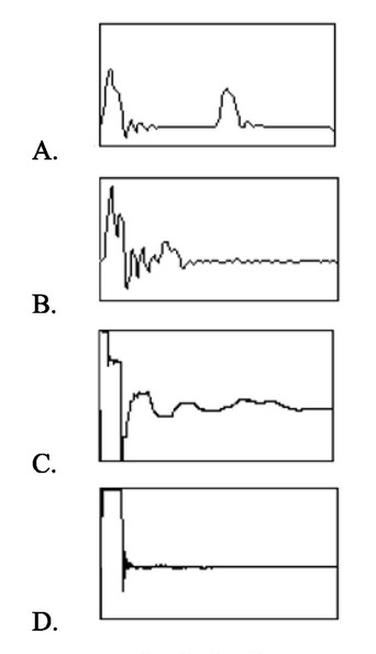

Który z zamieszczonych reflektogramów toru zamkniętego impedancją dopasowującą na odległym końcu, przedstawia wynik pomiaru kabla telefonicznego bez defektów?

To pytanie jest dostępne tylko dla uczniów i nauczycieli. Zaloguj się lub utwórz konto aby zobaczyć pełną treść pytania.

Odpowiedzi dostępne po zalogowaniu.

Wyjaśnienie dostępne po zalogowaniu.

Z jakiego surowca jest zbudowany rdzeń kabla RG?

Który z protokołów pozwala na dokładną synchronizację czasu między komputerami?

W kablach telekomunikacyjnych para przewodów jest ze sobą skręcana w celu

Urządzenie, które do asynchronicznej transmisji danych stosuje podział pasma częstotliwości linii abonenckiej 1100 kHz na poszczególne kanały, to