Pytanie 1

W sieciach komputerowych, gniazdo, które jednoznacznie wskazuje na dany proces na urządzeniu, stanowi połączenie

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

W sieciach komputerowych, gniazdo, które jednoznacznie wskazuje na dany proces na urządzeniu, stanowi połączenie

W cenniku usług informatycznych znajdują się poniższe wpisy. Jaki będzie koszt dojazdu serwisanta do klienta, który mieszka poza miastem, w odległości 15km od siedziby firmy?

| Dojazd do klienta na terenie miasta – 25 zł netto |

| Dojazd do klienta poza miastem – 2 zł netto za każdy km odległości od siedziby firmy liczony w obie strony. |

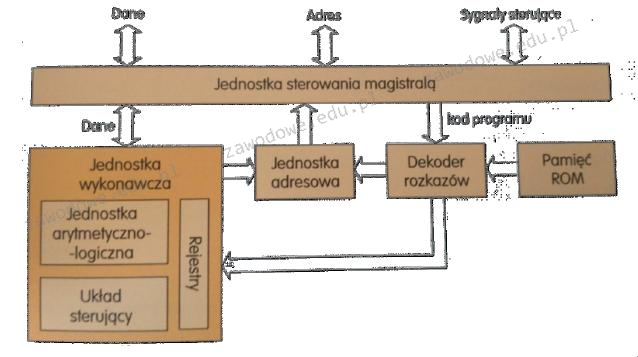

Na ilustracji przedstawiono schemat konstrukcji logicznej

Zgodnie z aktualnymi przepisami BHP, odległość oczu od ekranu monitora powinna wynosić

Symbol zaprezentowany powyżej, używany w dokumentacji technicznej, wskazuje na

Jakie urządzenie powinno być użyte w sieci Ethernet, aby zredukować liczbę kolizji pakietów?

Do wykonywania spawów włókien światłowodowych nie jest konieczne:

Cechą charakterystyczną transmisji w interfejsie równoległym synchronicznym jest to, że

W dokumentacji technicznej procesora Intel Xeon Processor E3-1220, producent przedstawia następujące dane: # rdzeni: 4 # wątków: 4 Częstotliwość zegara: 3.1 GHz Maksymalna częstotliwość Turbo: 3.4 GHz Intel Smart Cache: 8 MB DMI: 5 GT/s Zestaw instrukcji: 64 bit Rozszerzenia zestawu instrukcji: SSE4.1/4.2, AVX Opcje wbudowane: Nie Litografia: 32 nm Maksymalne TDP: 80 W. Co to oznacza dla Menedżera zadań systemu Windows, jeśli chodzi o historię użycia?

| # of Cores: | 4 |

| # of Threads: | 4 |

| Clock Speed: | 3.1 GHz |

| Max Turbo Frequency: | 3.4 GHz |

| Intel® Smart Cache: | 8 MB |

| DMI: | 5 GT/s |

| Instruction Set: | 64-bit |

| Instruction Set Extensions: | SSE4.1/4.2, AVX |

| Embedded Options Available: | No |

| Lithography: | 32 nm |

| Max TDP: | 80 W |

Na zdjęciu pokazano złącza

W dokumentacji technicznej procesora znajdującego się na płycie głównej komputera, jaką jednostkę miary stosuje się do określenia szybkości zegara?

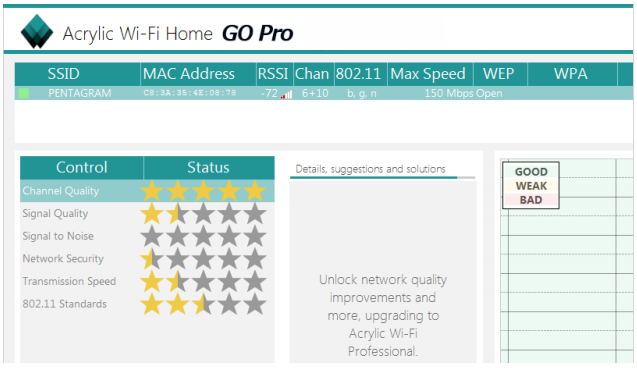

W programie Acrylic Wi-Fi Home przeprowadzono test, którego rezultaty ukazano na zrzucie ekranu. Na ich podstawie można stwierdzić, że sieć bezprzewodowa dostępna w danym momencie

Jeżeli rozmiar jednostki alokacji wynosi 1024 bajty, to ile klastrów zajmą pliki umieszczone w tabeli na dysku?

| Nazwa | Wielkość |

|---|---|

| Ala.exe | 50 B |

| Dom.bat | 1024 B |

| Wirus.exe | 2 kB |

| Domes.exr | 350 B |

Celem złocenia styków złącz HDMI jest

Co umożliwia zachowanie jednolitego rozkładu temperatury pomiędzy procesorem a radiatorem?

Aby osiągnąć optymalną prędkość przesyłu danych, gdy domowy ruter działa w paśmie 5 GHz, do laptopa należy zainstalować kartę sieciową bezprzewodową obsługującą standard

W tabeli zaprezentowano specyfikacje czterech twardych dysków. Dysk, który oferuje najwyższą średnią prędkość odczytu danych, to

| Pojemność | 320 GB | 320 GB | 320 GB | 320 GB |

| Liczba talerzy | 2 | 3 | 2 | 2 |

| Liczba głowic | 4 | 6 | 4 | 4 |

| Prędkość obrotowa | 7200 obr./min | 7200 obr./min | 7200 obr./min | 7200 obr./min |

| Pamięć podręczna | 16 MB | 16 MB | 16 MB | 16 MB |

| Czas dostępu | 8.3 ms | 8.9 ms | 8.5 ms | 8.6 ms |

| Interfejs | SATA II | SATA II | SATA II | SATA II |

| Obsługa NCQ | TAK | NIE | TAK | TAK |

| Dysk | A. | B. | C. | D. |

Protokół ARP (Address Resolution Protocol) służy do konwersji adresu IP na

Który protokół zajmuje się konwersją adresów IP na adresy MAC (kontroli dostępu do nośnika)?

Protokół poczty elektronicznej, który umożliwia zarządzanie wieloma skrzynkami pocztowymi oraz pobieranie i manipulowanie na wiadomościach przechowywanych na zdalnym serwerze, to

Wartość wyrażana w decybelach, będąca różnicą pomiędzy mocą sygnału przekazywanego w parze zakłócającej a mocą sygnału generowanego w parze zakłócanej to

W przypadku dłuższych przestojów drukarki atramentowej, pojemniki z tuszem powinny

Jakie aktywne urządzenie pozwoli na nawiązanie połączenia z lokalną siecią dla 15 komputerów, drukarki sieciowej oraz rutera, wykorzystując kabel UTP?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jaką topologię fizyczną sieci komputerowej przedstawia załączony rysunek?

Standard magistrali komunikacyjnej PCI w wersji 2.2 (Peripheral Component Interconnect) definiuje maksymalną szerokość szyny danych na

Jaki protokół jest używany przez komendę ping?

Diody LED RGB pełnią funkcję źródła światła w skanerach

Określenie najlepszej trasy dla połączenia w sieci to

Którą kartę rozszerzeń w komputerze przedstawia to zdjęcie?

Który z standardów Gigabit Ethernet pozwala na stworzenie segmentów sieci o długości 550 m/5000 m przy szybkości przesyłu danych 1 Gb/s?

Który z symboli wskazuje na zastrzeżenie praw autorskich?

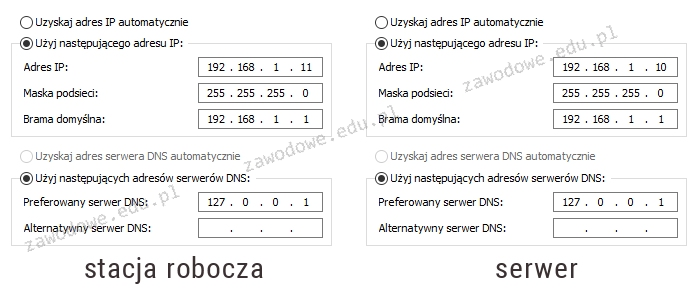

Na schemacie przedstawiono konfigurację protokołu TCP/IP pomiędzy serwerem a stacją roboczą. Na serwerze zainstalowano rolę DNS. Wykonanie polecenia ping www.cke.edu.pl na serwerze zwraca pozytywny wynik, natomiast na stacji roboczej jest on negatywny. Jakie zmiany należy wprowadzić w konfiguracji, aby usługa DNS na stacji funkcjonowała poprawnie?

Zgodnie z podanym cennikiem, przeciętny koszt zakupu wyposażenia stanowiska komputerowego wynosi:

| Nazwa sprzętu | Cena minimalna | Cena maksymalna |

|---|---|---|

| Jednostka centralna | 1300,00 zł | 4550,00 zł |

| Monitor | 650,00 zł | 2000,00 zł |

| Klawiatura | 28,00 zł | 100,00 zł |

| Myszka | 22,00 zł | 50,00 zł |

Procesem nieodwracalnym, całkowicie uniemożliwiającym odzyskanie danych z dysku twardego, jest

Z jakiego oprogramowania NIE można skorzystać, aby przywrócić dane w systemie Windows na podstawie wcześniej wykonanej kopii?

Na dysku konieczne jest zapisanie 100 tysięcy pojedynczych plików, każdy o wielkości 2570 bajtów. Zajętość zapisanych plików będzie minimalna na dysku o jednostce alokacji wynoszącej

Na przedstawionym schemacie wtyk (złącze męskie modularne) stanowi zakończenie kabla

Jaką konfigurację sieciową może mieć komputer, który należy do tej samej sieci LAN, co komputer z adresem 10.8.1.10/24?

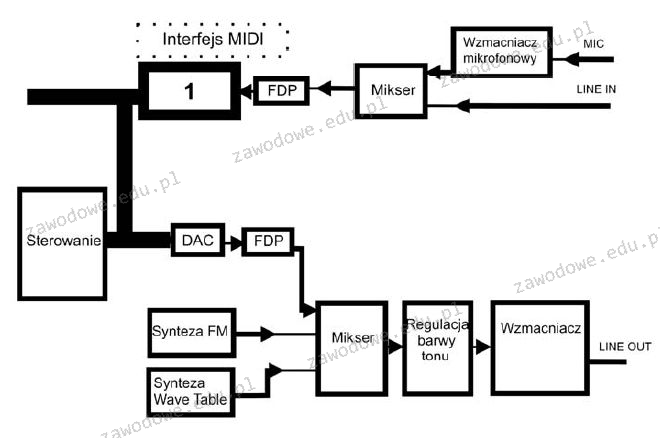

Schemat blokowy karty dźwiękowej jest przedstawiony na rysunku. Jaką rolę odgrywa układ oznaczony numerem 1?