Pytanie 1

Jakie polecenie oprócz ls może być użyte przez użytkownika systemu Linux do wyświetlenia zawartości katalogu, w tym plików i podkatalogów?

Wynik: 21/40 punktów (52,5%)

Wymagane minimum: 20 punktów (50%)

Jakie polecenie oprócz ls może być użyte przez użytkownika systemu Linux do wyświetlenia zawartości katalogu, w tym plików i podkatalogów?

Magistrala PCI-Express stosuje do przesyłania danych metodę komunikacji

Podanie nieprawidłowych napięć do płyty głównej może skutkować

Podaj właściwy sposób zapisu liczby -1210 w metodzie znak-moduł na ośmiobitowej liczbie binarnej.

Ile maksymalnie hostów można przydzielić w sieci o masce 255.255.255.192?

Który typ rekordu w bazie DNS (Domain Name System) umożliwia ustalenie aliasu dla rekordu A?

Który z wymienionych elementów stanowi część mechanizmu drukarki igłowej?

Część programu antywirusowego działająca w tle jako kluczowy element zabezpieczeń, mająca na celu nieustanne monitorowanie ochrony systemu komputerowego, to

Co jest przyczyną wysokiego poziomu przesłuchu zdalnego w kablu?

Jak należy ustawić w systemie Windows Server 2008 parametry protokołu TCP/IP karty sieciowej, aby komputer mógł jednocześnie łączyć się z dwiema różnymi sieciami lokalnymi posiadającymi odrębne adresy IP?

Aby uzyskać optymalną wydajność, karta sieciowa w komputerze stosuje transmisję szeregową.

W topologii elementem centralnym jest switch

Kiedy użytkownik wpisuje w przeglądarkę adres www.egzamin.pl, nie ma on możliwości otwarcia strony WWW, natomiast wpisujący adres 211.0.12.41 zyskuje dostęp do tej strony. Problem ten wynika z nieprawidłowej konfiguracji serwera

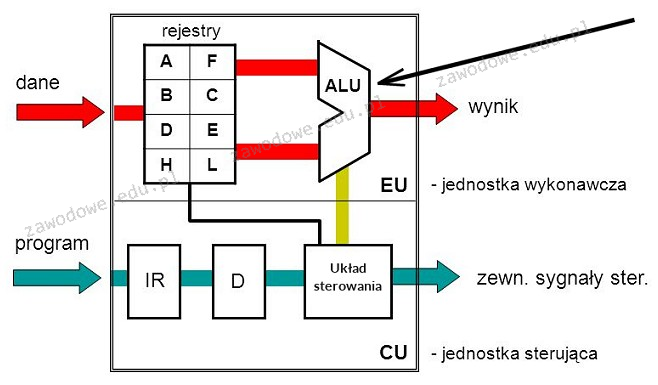

Na diagramie mikroprocesora blok wskazany strzałką pełni rolę

Jak sprawdzić, który z programów w systemie Windows generuje największe obciążenie dla procesora?

Aby zweryfikować schemat połączeń kabla UTP Cat 5e w sieci lokalnej, należy zastosować

Na komputerze, na którym zainstalowane są dwa systemy – Windows i Linux, po przeprowadzeniu reinstalacji systemu Windows drugi system przestaje się uruchamiać. Aby ponownie umożliwić uruchamianie systemu Linux oraz aby zachować wszystkie dane i ustawienia w nim zawarte, co należy zrobić?

Atak DDoS (z ang. Distributed Denial of Service) na serwer może spowodować

Który z poniższych interfejsów powinien być wybrany do podłączenia dysku SSD do płyty głównej komputera stacjonarnego, aby uzyskać najwyższą szybkość zapisu oraz odczytu danych?

Jakie jednostki stosuje się do wyrażania przesłuchu zbliżonego NEXT?

Który z wymienionych protokołów przekształca 48-bitowy adres MAC na 32-bitowy adres IP?

Wymiana baterii należy do czynności związanych z eksploatacją

Która usługa pozwala na zdalne zainstalowanie systemu operacyjnego?

W architekturze sieci lokalnych opartej na modelu klient - serwer

W schemacie logicznym okablowania strukturalnego, zgodnie z terminologią polską zawartą w normie PN-EN 50174, cechą kondygnacyjnego punktu dystrybucyjnego jest to, że

Aby zidentyfikować, który program najbardziej obciąża CPU w systemie Windows, należy otworzyć program

Na podstawie oznaczenia pamięci DDR3 PC3-16000 można określić, że ta pamięć

Jakim protokołem jest realizowana kontrola poprawności transmisji danych w sieciach Ethernet?

Przerywając działalność na komputerze, możemy szybko wrócić do pracy, wybierając w systemie Windows opcję:

Jaką inną formą można zapisać 2^32 bajtów?

Które polecenie pozwala na mapowanie zasobów sieciowych w systemie Windows Serwer?

Która z podanych właściwości kabla koncentrycznego RG-58 sprawia, że obecnie nie jest on używany do tworzenia lokalnych sieci komputerowych?

Która z licencji ma charakter grupowy i pozwala instytucjom komercyjnym oraz organizacjom edukacyjnym, państwowym i charytatywnym na zakup większej ilości oprogramowania firmy Microsoft na korzystnych zasadach?

Po przeprowadzeniu eksportu klucza HKCR zostanie utworzona kopia rejestru, zawierająca dane dotyczące konfiguracji

Przy realizacji projektu dotyczącego sieci LAN wykorzystano medium transmisyjne standardu Ethernet 1000Base-T. Które z poniższych stwierdzeń jest prawdziwe?

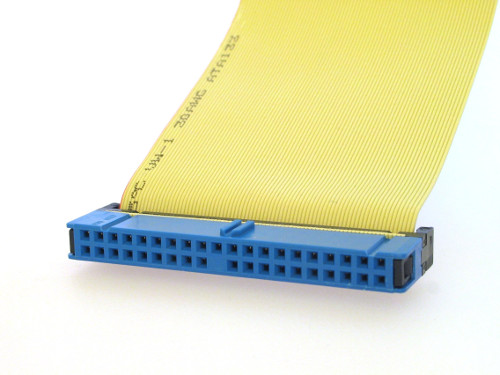

Na ilustracji pokazano wtyczkę taśmy kabel)

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Gdzie w systemie Linux umieszczane są pliki specjalne urządzeń, które są tworzone podczas instalacji sterowników?

Jak nazywa się system, który pozwala na konwersję nazwy komputera na adres IP w danej sieci?

Możliwą przyczyną usterki drukarki igłowej może być awaria