Pytanie 1

Co należy zrobić w pierwszej kolejności, gdy dysza w drukarce atramentowej jest zaschnięta z powodu długotrwałych przestojów?

Wynik: 15/40 punktów (37,5%)

Wymagane minimum: 20 punktów (50%)

Co należy zrobić w pierwszej kolejności, gdy dysza w drukarce atramentowej jest zaschnięta z powodu długotrwałych przestojów?

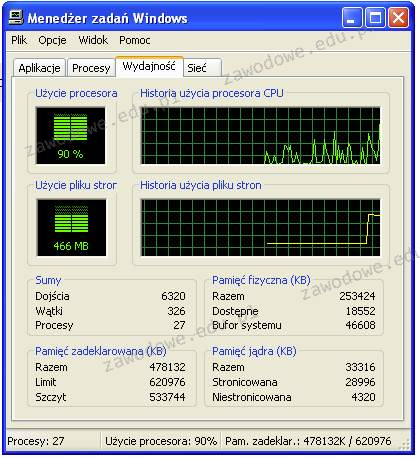

Przyglądając się przedstawionemu obrazkowi, można dostrzec, że deklarowany limit pamięci wynosi 620976 KB. Zauważamy również, że zainstalowana pamięć fizyczna w badanym systemie jest mniejsza niż pamięć zadeklarowana. Który typ pamięci wpływa na podniesienie limitu pamięci zadeklarowanej powyżej rozmiaru zainstalowanej pamięci fizycznej?

Urządzenie przedstawione na ilustracji, wraz z podanymi danymi technicznymi, może być zastosowane do pomiarów systemów okablowania

Elementem eksploatacyjnym drukarki laserowej jest wszystko oprócz

Symbol umieszczony na obudowie komputera stacjonarnego wskazuje na ostrzeżenie dotyczące

Termin gorącego podłączenia (hot-plug) wskazuje, że podłączane urządzenie działa

Bez zgody właściciela praw autorskich do oprogramowania jego legalny użytkownik, zgodnie z ustawą o prawie autorskim i prawach pokrewnych, co może zrobić?

Użytkownicy sieci WiFi zauważyli problemy oraz częste zrywanie połączenia z internetem. Co może być przyczyną tej sytuacji?

Zamiana taśmy barwiącej jest związana z eksploatacją drukarki

Jakie polecenie należy wydać, aby uzyskać listę plików spełniających dane kryteria?

Który protokół jest używany do zdalnego zarządzania komputerem przez terminal w systemach Linux?

Rodzajem macierzy RAID, która nie jest odporna na awarię dowolnego z dysków wchodzących w jej skład, jest

Symbol zaprezentowany powyżej, używany w dokumentacji technicznej, wskazuje na

Diagnostykę systemu Linux można przeprowadzić za pomocą komendy

| Thread(s) per core: | 1 |

| Core(s) per socket: | 4 |

| Socket(s): | 1 |

| NUMA node(s): | 1 |

Urządzenie, które zamienia otrzymane ramki na sygnały przesyłane w sieci komputerowej, to

Na przedstawionym panelu tylnym płyty głównej znajdują się między innymi następujące interfejsy:

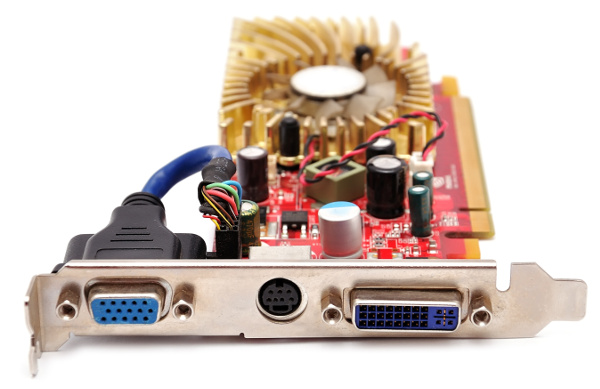

Na przedstawionej fotografii karta graficzna ma widoczne złącza

Jaki adres IP należy do grupy A?

Jak można zwolnić miejsce na dysku, nie tracąc przy tym danych?

W systemie Linux do bieżącego śledzenia działających procesów wykorzystuje się polecenie:

Przerywając działalność na komputerze, możemy szybko wrócić do pracy, wybierając w systemie Windows opcję:

Która z poniższych opcji nie jest wykorzystywana do zdalnego zarządzania stacjami roboczymi?

Aby telefon VoIP działał poprawnie, należy skonfigurować adres

Jakie korzyści płyną z zastosowania systemu plików NTFS?

W systemie Linux polecenie chown służy do

Jakie są korzyści płynące z użycia systemu plików NTFS?

Które polecenie systemu Linux służy do wyświetlenia informacji o zainstalowanych podzespołach?

Jaka jest maksymalna prędkość transferu danych w sieci lokalnej, w której zastosowano przewód UTP kat.5e do budowy okablowania strukturalnego?

Adres IP jest przypisywany przełącznikowi warstwy drugiej w celu

W jakim protokole komunikacyjnym adres nadawcy ma długość 128 bitów?

Użytkownik chce tak zmodernizować komputer, aby działały na nim gry wymagające DirectX12. Jaki system operacyjny powinien zakupić do modernizowanego komputera, aby wspierał DX12?

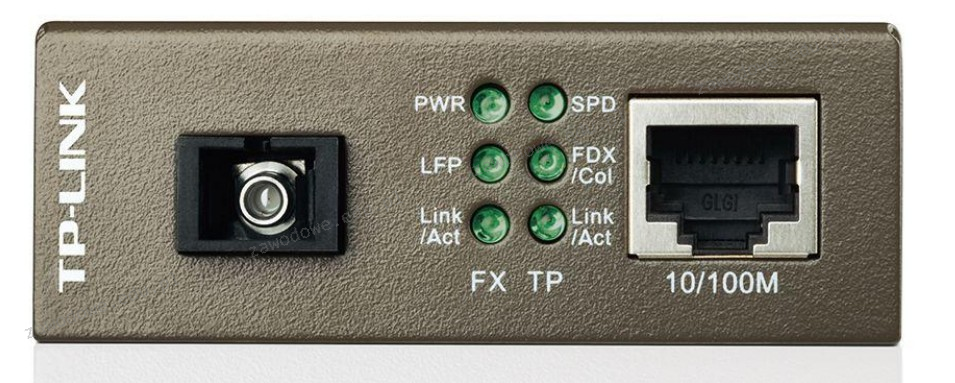

Urządzenie pokazane na grafice służy do

Licencja CAL (Client Access License) uprawnia użytkownika do

Drukarką przeznaczoną do druku etykiet i kodów kreskowych, która drukuje poprzez roztapianie pokrycia specjalnej taśmy, w wyniku czego barwnik z niej zostaje przyklejony do materiału, na którym następuje drukowanie jest drukarka

Po podłączeniu działającej klawiatury do któregokolwiek z portów USB nie ma możliwości wyboru awaryjnego trybu uruchamiania systemu Windows. Jednakże, klawiatura funkcjonuje prawidłowo po uruchomieniu systemu w standardowym trybie. Co to sugeruje?

Zastosowanie programu Wireshark polega na

Jak należy rozmieszczać gniazda komputerowe RJ45 w odniesieniu do przestrzeni biurowej zgodnie z normą PN-EN 50174?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Zasilacz UPS o mocy nominalnej 480 W nie powinien być używany do zasilania

Aby połączyć dwa przełączniki oddalone o 200 m i osiągnąć minimalną przepustowość 200 Mbit/s, jakie rozwiązanie należy zastosować?