Pytanie 1

Jak nazywa się magistrala, która w komputerze łączy procesor z kontrolerem pamięci i składa się z szyny adresowej, szyny danych oraz linii sterujących?

Wynik: 15/40 punktów (37,5%)

Wymagane minimum: 20 punktów (50%)

Jak nazywa się magistrala, która w komputerze łączy procesor z kontrolerem pamięci i składa się z szyny adresowej, szyny danych oraz linii sterujących?

Stacja robocza powinna znajdować się w tej samej podsieci co serwer o adresie IP 192.168.10.150 i masce 255.255.255.192. Który adres IP powinien być skonfigurowany w ustawieniach protokołu TCP/IP karty sieciowej stacji roboczej?

Płyta główna serwerowa potrzebuje pamięci z rejestrem do prawidłowego funkcjonowania. Który z poniższych modułów pamięci będzie zgodny z tą płytą?

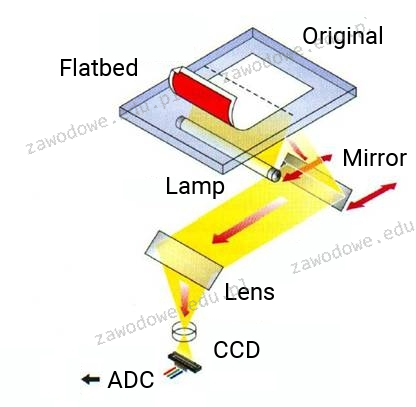

Na załączonym rysunku przedstawiono

Podstawowym zadaniem mechanizmu Plug and Play jest

Jakie jest najwyższe możliwe tempo odczytu płyt CD-R w urządzeniu o oznaczeniu x48?

Przy zgrywaniu filmu kamera cyfrowa przesyła na dysk 220 MB na minutę. Wybierz z diagramu interfejs o najniższej prędkości transferu, który umożliwia taką transmisję

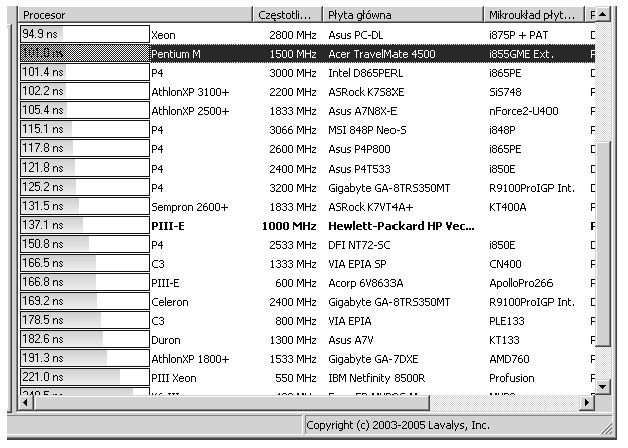

Na ilustracji zaprezentowano zrzut ekranu z wykonanej analizy

Jaką wartość dziesiętną ma liczba 11110101(U2)?

Tworzenie obrazu dysku ma na celu

W zestawieniu przedstawiono istotne parametry techniczne dwóch typów interfejsów. Z powyższego wynika, że SATA w porównaniu do ATA charakteryzuje się

| Table Comparison of parallel ATA and SATA | ||

|---|---|---|

| Parallel ATA | SATA 1.5 Gb/s | |

| Bandwidth | 133 MB/s | 150 MB/s |

| Volts | 5V | 250 mV |

| Number of pins | 40 | 7 |

| Cable length | 18 in. (45.7 cm) | 39 in. (1 m) |

Notacja #102816 oznacza zapis w systemie liczbowym

Jaką długość ma maska sieci dla adresów z klasy B?

Do akumulatora w jednostce ALU wprowadzono liczbę dziesiętną 253. Jak wygląda jej reprezentacja binarna?

Które urządzenie poprawi zasięg sieci bezprzewodowej?

Komputer, którego serwis ma być wykonany u klienta, nie odpowiada na naciśnięcie przycisku POWER. Jakie powinno być pierwsze zadanie w planie działań związanych z identyfikacją i naprawą tej awarii?

Najmniejszy czas dostępu charakteryzuje się

Jaką wartość ma liczba 5638 zapisana w systemie szesnastkowym?

Komunikat "BIOS checksum error" pojawiający się w trakcie startu komputera zazwyczaj wskazuje na

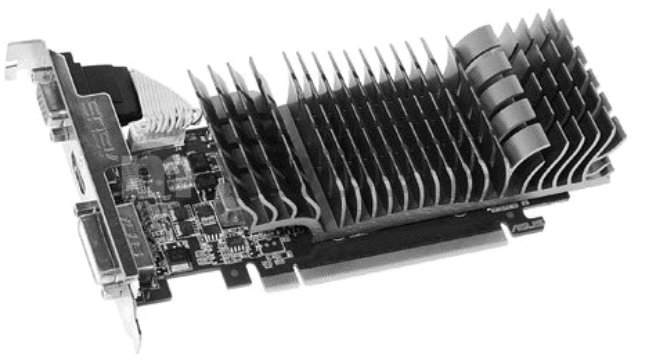

Karta rozszerzeń zaprezentowana na rysunku ma system chłodzenia

Aby bezpośrednio połączyć dwa komputery w przewodowej sieci LAN, należy zastosować

Aby wymienić uszkodzony moduł pamięci RAM, najpierw trzeba

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jakiego rodzaju interfejsem jest UDMA?

Do efektywnego zrealizowania macierzy RAID 1 wymagane jest minimum

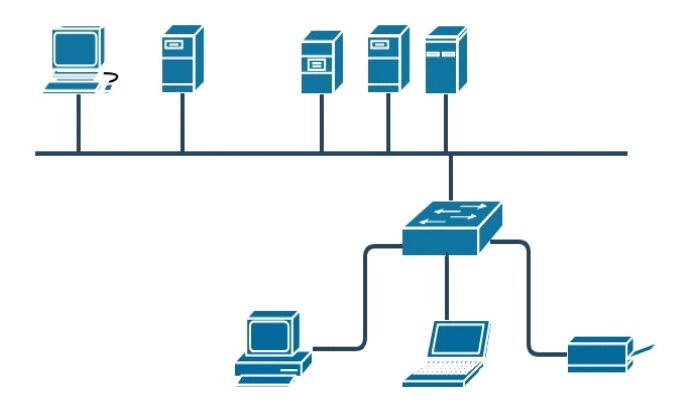

Ilustracja pokazuje schemat fizycznej topologii będącej kombinacją topologii

Urządzenie peryferyjne, które jest kontrolowane przez komputer i służy do pracy z dużymi, płaskimi powierzchniami, a do produkcji druku odpornego na warunki atmosferyczne wykorzystuje farby na bazie rozpuszczalników, nosi nazwę ploter

Wypukłe kondensatory elektrolityczne w module zasilania monitora LCD mogą doprowadzić do uszkodzenia

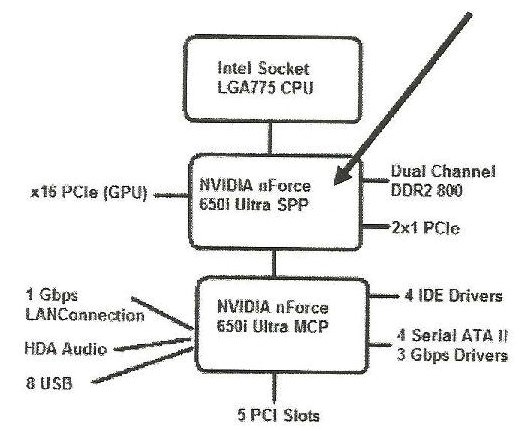

Jaką rolę pełni komponent wskazany strzałką na schemacie chipsetu płyty głównej?

Jeśli jednostka alokacji ma 1024 bajty, to pliki podane w tabeli zajmują na dysku:

Nazwa Wielkość

Ala.exe 50B

Dom.bat 1024B

Wirus.exe 2kB

Domes.exr 350B

Jak na diagramach sieciowych LAN oznaczane są punkty dystrybucyjne znajdujące się na różnych kondygnacjach budynku, zgodnie z normą PN-EN 50173?

Liczba 205(10) w zapisie szesnastkowym wynosi

Wskaź na błędny układ dysku z użyciem tablicy partycji MBR?

Spuchnięte kondensatory elektrolityczne w sekcji zasilania monitora LCD mogą spowodować uszkodzenie

Zaprezentowany schemat ilustruje funkcjonowanie

W instalacjach kablowych z wykorzystaniem skrętki UTP kat. 6, jakie gniazda sieciowe powinny być stosowane?

Napięcie dostarczane do poszczególnych elementów komputera w zasilaczu komputerowym w standardzie ATX jest zmniejszane z wartości 230V między innymi do wartości

Użytkownik uszkodził płytę główną z gniazdem procesora AM2. Uszkodzoną płytę można zastąpić, bez konieczności wymiany procesora i pamięci, modelem z gniazdem

Graficzny symbol odnosi się do standardów sprzętowych

Karta rozszerzeń przedstawiona na zdjęciu dysponuje systemem chłodzenia