Pytanie 1

Co należy zrobić, gdy podczas uruchamiania komputera procedura POST sygnalizuje błąd odczytu lub zapisu pamięci CMOS?

Wynik: 24/40 punktów (60,0%)

Wymagane minimum: 20 punktów (50%)

Co należy zrobić, gdy podczas uruchamiania komputera procedura POST sygnalizuje błąd odczytu lub zapisu pamięci CMOS?

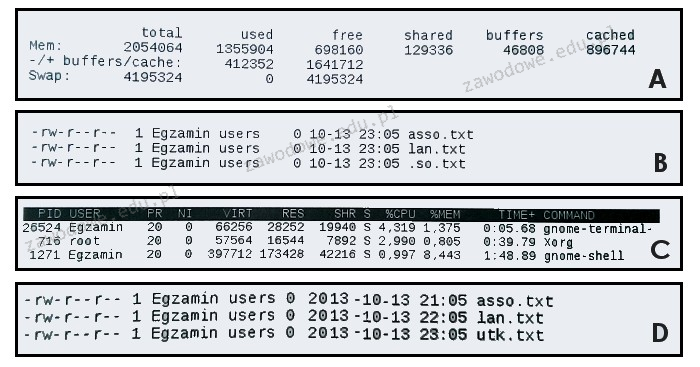

Wynik wykonania polecenia ```ls -l``` w systemie Linux przedstawia poniższy rysunek

Według specyfikacji JEDEC, napięcie zasilania dla modułów pamięci RAM DDR3L wynosi

Urządzenie peryferyjne, które jest kontrolowane przez komputer i służy do pracy z dużymi, płaskimi powierzchniami, a do produkcji druku odpornego na warunki atmosferyczne wykorzystuje farby na bazie rozpuszczalników, nosi nazwę ploter

Administrator powinien podzielić sieć o adresie 193.115.95.0 z maską 255.255.255.0 na 8 równych podsieci. Jaką maskę sieci powinien wybrać administrator?

Watomierz jest stosowany do pomiaru

Jakim protokołem jest realizowana kontrola poprawności transmisji danych w sieciach Ethernet?

W dokumentacji powykonawczej dotyczącej fizycznej oraz logicznej struktury sieci lokalnej powinny być zawarte

Zamiana taśmy barwiącej wiąże się z eksploatacją drukarki

Zastosowanie programu Wireshark polega na

Podczas realizacji procedury POST na wyświetlaczu ukazuje się komunikat "CMOS Battery State Low". Jakie kroki należy podjąć, aby uniknąć pojawiania się tego komunikatu w przyszłości?

Użytkownik drukarki samodzielnie i prawidłowo napełnił pojemnik z tonerem. Po jego zamontowaniu drukarka nie podejmuje próby drukowania. Przyczyną tej usterki może być

Wtyczka zasilająca SATA ma uszkodzony żółty przewód. Jakie to niesie za sobą konsekwencje dla napięcia na złączu?

Na stronie wydrukowanej przez drukarkę laserową występują jaśniejsze i ciemniejsze fragmenty. W celu usunięcia problemów z jakością oraz nieciągłościami w wydruku, należy

Po włączeniu komputera wyświetlił się komunikat "Non-system disk or disk error. Replace and strike any key when ready". Może to być spowodowane

Wskaż procesor współpracujący z przedstawioną płytą główną.

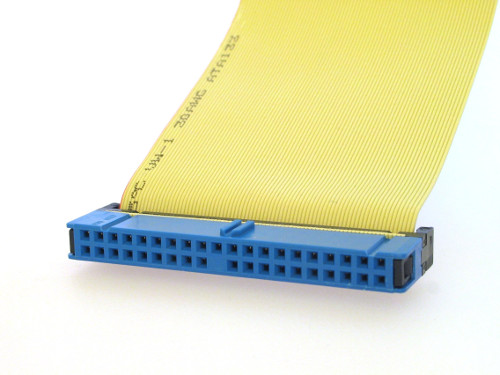

Na ilustracji pokazano wtyczkę taśmy kabel)

Jaką wartość ma moc wyjściowa (ciągła) zasilacza według parametrów przedstawionych w tabeli?

| Napięcie wyjściowe | +5 V | +3.3 V | +12 V1 | +12 V2 | -12 V | +5 VSB |

| Prąd wyjściowy | 18,0 A | 22,0 A | 18,0 A | 17,0 A | 0,3 A | 2,5 A |

| Moc wyjściowa | 120 W | 336W | 3,6 W | 12,5 W |

Ile podsieci obejmują komputery z adresami: 192.168.5.12/25, 192.168.5.200/25 oraz 192.158.5.250/25?

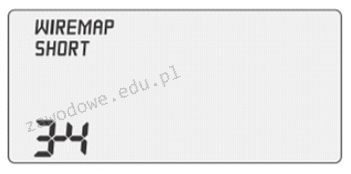

Na ilustracji pokazano wynik pomiaru okablowania. Jaką interpretację można nadać temu wynikowi?

Aby podnieść wydajność komputera w grach, karta graficzna Sapphire Radeon R9 FURY OC, 4GB HBM (4096 Bit), HDMI, DVI, 3xDP została wzbogacona o technologię

Natychmiast po usunięciu ważnych plików na dysku twardym użytkownik powinien

Najmniejszymi kątami widzenia charakteryzują się matryce monitorów typu

Dwie stacje robocze w tej samej sieci nie mają możliwości komunikacji. Która z poniższych okoliczności może być przyczyną tego problemu?

Komputer stracił łączność z siecią. Jakie działanie powinno być podjęte w pierwszej kolejności, aby naprawić problem?

Dostarczanie błędnych napięć do płyty głównej może spowodować

Który z poniższych adresów stanowi adres rozgłoszeniowy dla sieci 172.16.64.0/26?

Komputer, którego serwis ma być wykonany u klienta, nie odpowiada na naciśnięcie przycisku POWER. Jakie powinno być pierwsze zadanie w planie działań związanych z identyfikacją i naprawą tej awarii?

Na stronie wydrukowanej na drukarce laserowej pojawiają się jaśniejsze i ciemniejsze obszary. Aby rozwiązać problemy z nieciągłością i jakością wydruku, należy

Tryb użytkownika w przełączniku CISCO (User EXEC Mode) umożliwia

Parametry katalogowe przedstawione w ramce dotyczą dysku twardego

| ST31000528AS |

| Seagate Barracuda 7200.12 ,32 MB, |

| Serial ATA/300, Heads 4, Capacity 1TB |

W sieciach komputerowych miarą prędkości przesyłu danych jest

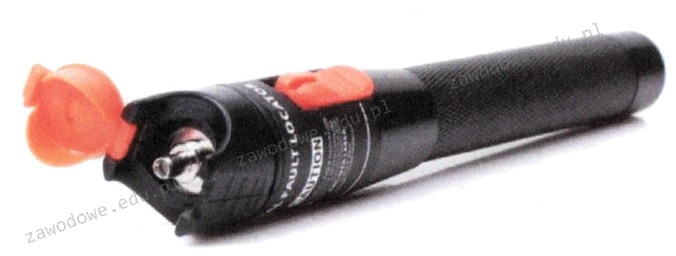

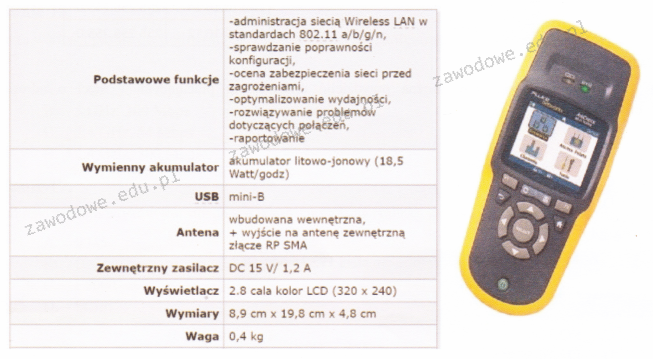

Jakie urządzenie diagnostyczne jest pokazane na ilustracji oraz opisane w specyfikacji zawartej w tabeli?

Jakie znaczenie ma parametr NEXT w kontekście pomiarów systemów okablowania strukturalnego?

Wykonanie komendy perfmon w konsoli systemu Windows spowoduje

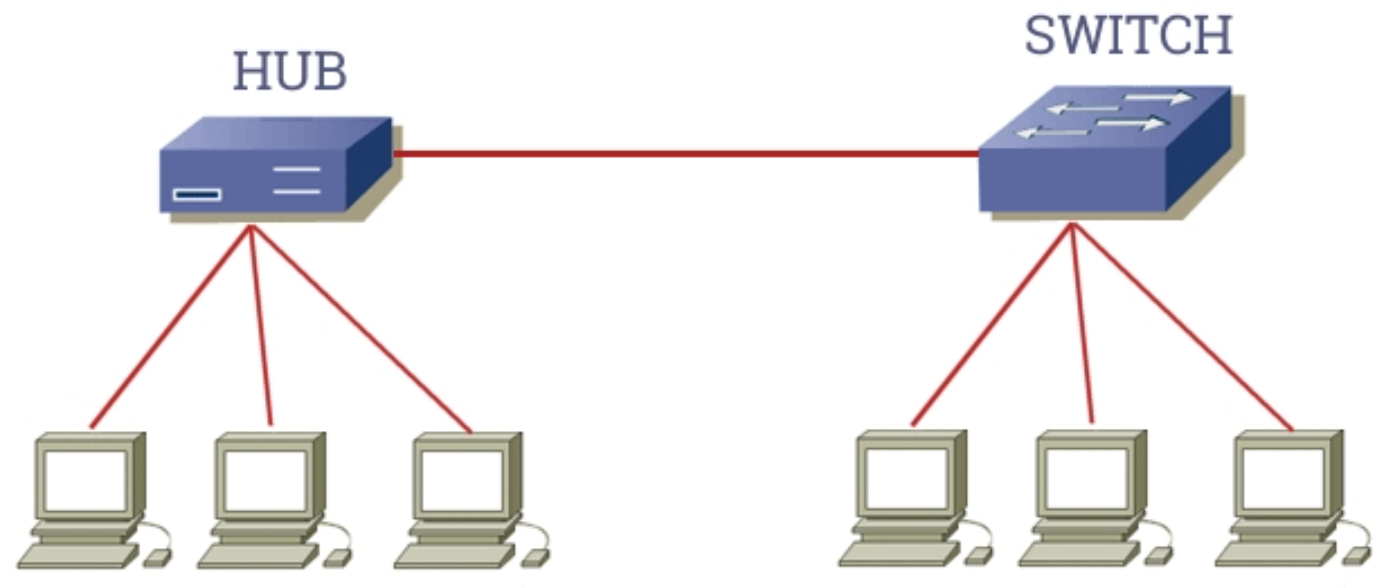

Ile domen kolizyjnych występuje w sieci pokazanej na rysunku?

Administrator sieci komputerowej pragnie zweryfikować na urządzeniu z systemem Windows, które połączenia są aktualnie ustanawiane oraz na jakich portach komputer prowadzi nasłuch. W tym celu powinien użyć polecenia

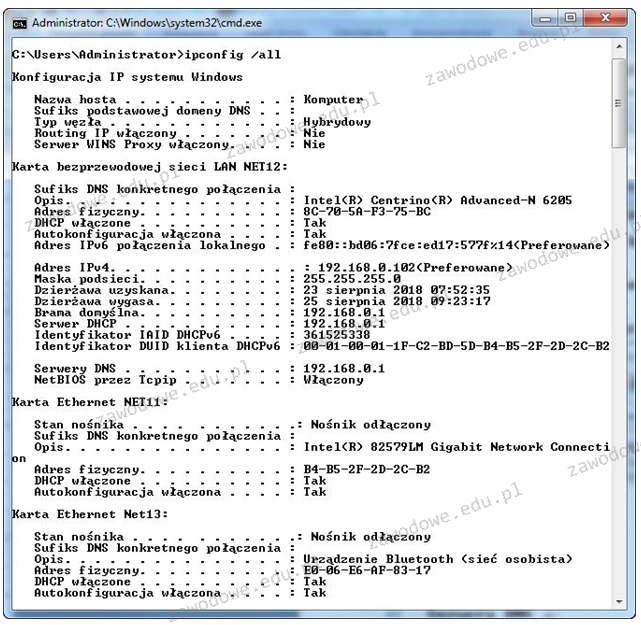

Analizując przedstawione wyniki konfiguracji zainstalowanych kart sieciowych na komputerze, można zauważyć, że

Aby sprawdzić dysk twardy w systemie Linux na obecność uszkodzonych sektorów, użytkownik może zastosować program

Zaprezentowane narzędzie jest wykorzystywane do