Pytanie 1

Osoba planuje unowocześnić swój komputer poprzez zwiększenie pamięci RAM. Zainstalowana płyta główna ma specyfikacje przedstawione w tabeli. Wybierając dodatkowe moduły pamięci, powinien pamiętać, aby

| Parametry płyty głównej | |

|---|---|

| Model | H97 Pro4 |

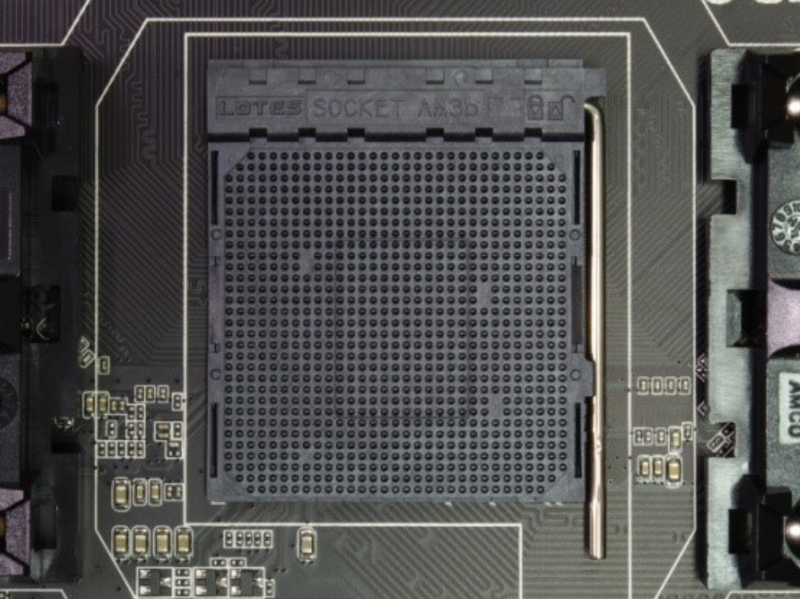

| Typ gniazda procesora | Socket LGA 1150 |

| Obsługiwane procesory | Intel Core i7, Intel Core i5, Intel Core i3, Intel Pentium, Intel Celeron |

| Chipset | Intel H97 |

| Pamięć | 4 x DDR3- 1600 / 1333/ 1066 MHz, max 32 GB, ECC, niebuforowana |

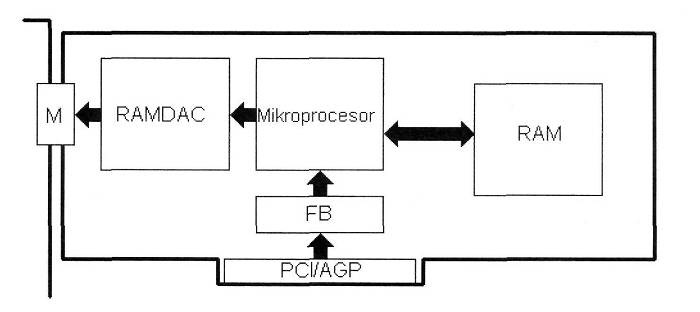

| Porty kart rozszerzeń | 1 x PCI Express 3.0 x16, 3 x PCI Express x1, 2 x PCI |