Pytanie 1

Jaki jest adres rozgłoszeniowy (broadcast) dla hosta z adresem IP 192.168.35.202 oraz 26-bitową maską?

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

Jaki jest adres rozgłoszeniowy (broadcast) dla hosta z adresem IP 192.168.35.202 oraz 26-bitową maską?

Jeden długi oraz dwa krótkie sygnały dźwiękowe BIOS POST od firm AMI i AWARD wskazują na wystąpienie błędu

Do czego służy narzędzie 'ping' w sieciach komputerowych?

Administrator sieci komputerowej pragnie zweryfikować na urządzeniu z systemem Windows, które połączenia są aktualnie ustanawiane oraz na jakich portach komputer prowadzi nasłuch. W tym celu powinien użyć polecenia

Jaką wartość ma transfer danych napędu DVD przy prędkości przesyłu x48?

Który z zapisów adresu IPv4 z maską jest niepoprawny?

Gdy system operacyjny laptopa działa normalnie, na ekranie wyświetla się komunikat o konieczności sformatowania wewnętrznego dysku twardego. Może to sugerować

Aby osiągnąć przepustowość wynoszącą 4 GB/s w obie strony, konieczne jest zainstalowanie w komputerze karty graficznej korzystającej z interfejsu

Jakie polecenie w systemie operacyjnym Linux służy do monitorowania komunikacji protokołów TCP/IP lub innych przesyłanych lub odbieranych w sieci komputerowej, do której jest podłączony komputer użytkownika?

Jakie napięcie jest obniżane z 230 V w zasilaczu komputerowym w standardzie ATX dla różnych podzespołów komputera?

Z wykorzystaniem polecenia dxdiag uruchomionego z linii komend systemu Windows można

Kiedy użytkownik wprowadza w wierszu poleceń komendę ping www.onet.pl, otrzymuje komunikat: "Żądanie polecenia ping nie może znaleźć hosta www.onet.pl. Sprawdź nazwę i ponów próbę." Natomiast po wpisaniu polecenia ping 213.180.141.140 (adres IP serwera www.onet.pl) użytkownik otrzymuje odpowiedź z serwera. Jakie mogą być przyczyny tego zjawiska?

Za pomocą narzędzia diagnostycznego Tracert można ustalić trasę do punktu docelowego. Przez ile routerów przeszedł pakiet wysłany dl hosta 172.16.0.99?

C:\>tracert 172.16.0.99 Trasa śledzenia do 172.16.0.99 z maksymalną liczbą przeskoków 30 | ||||

| 1 | 2 ms | 3 ms | 2 ms | 10.0.0.1 |

| 2 | 12 ms | 8 ms | 8 ms | 192.168.0.1 |

| 3 | 10 ms | 15 ms | 10 ms | 172.17.0.2 |

| 4 | 11 ms | 11 ms | 20 ms | 172.17.48.14 |

| 5 | 21 ms | 16 ms | 24 ms | 172.16.0.99 |

Śledzenie zakończone. | ||||

Drukarką przeznaczoną do druku etykiet i kodów kreskowych, która drukuje poprzez roztapianie pokrycia specjalnej taśmy, w wyniku czego barwnik z niej zostaje przyklejony do materiału, na którym następuje drukowanie jest drukarka

Chusteczki nasączone substancją o właściwościach antystatycznych służą do czyszczenia

Jak można przywrócić domyślne ustawienia płyty głównej, gdy nie ma możliwości uruchomienia BIOS Setup?

Jakie znaczenie ma parametr NEXT w kontekście pomiarów systemów okablowania strukturalnego?

W systemie Windows, z jakiego polecenia można skorzystać, aby sprawdzić bieżące połączenia sieciowe i ich statystyki?

Komunikat biosu POST od firmy Award o treści "Display switch is set incorrectly" sugeruje

Firma uzyskała zakres adresów 10.10.10.0/16. Po podzieleniu na podsieci zawierające 510 hostów, jakie są adresy podsieci z zastosowaną maską?

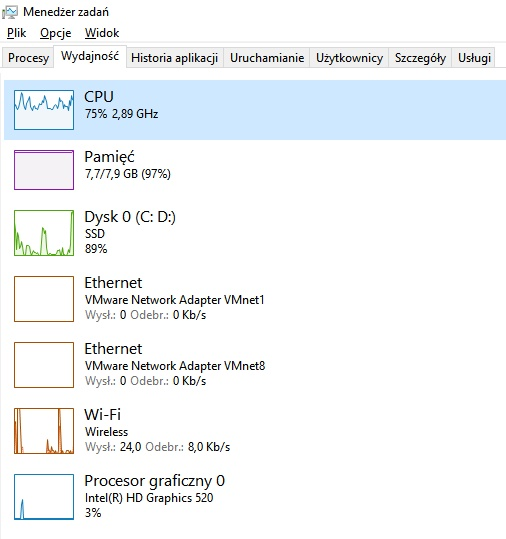

Grafik komputerowy sygnalizuje bardzo wolną pracę komputera. Z ilustracji przedstawiającej okno wydajności komputera wynika, że przyczyną tego może być

Funkcja Intel Turbo Boost w mikroprocesorze umożliwia

Na podstawie danych przedstawionych w tabeli dotyczącej twardego dysku, ustal, który z wniosków jest poprawny?

Do jakiego pomiaru wykorzystywany jest watomierz?

Farad to jednostka

Program, który nie jest przeznaczony do analizy stanu komputera to

Wynikiem wykonania komendy arp -a 192.168.1.1 w systemie MS Windows jest pokazanie

Jeśli podczas podłączania stacji dysków elastycznych 1,44 MB kabel sygnałowy zostanie włożony odwrotnie, to

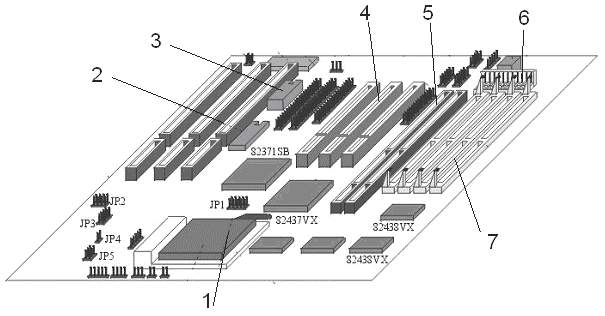

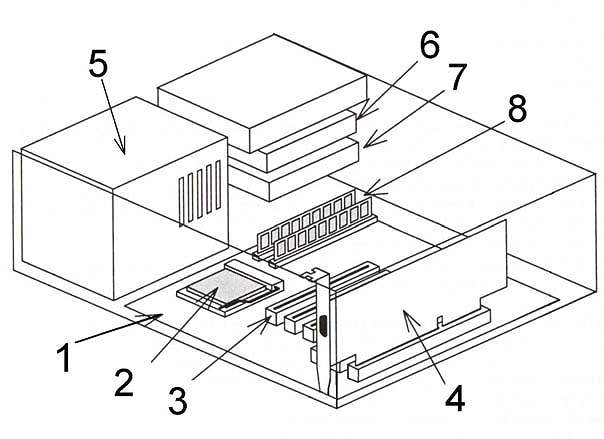

Na schemacie przedstawionej płyty głównej zasilanie powinno być podłączone do gniazda oznaczonego numerem

Rozmiar plamki na ekranie monitora LCD wynosi

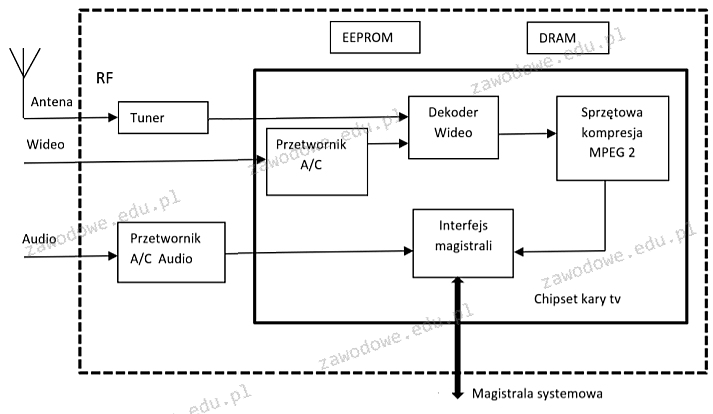

Na ilustracji zaprezentowano schemat blokowy karty

Określ najprawdopodobniejszą przyczynę pojawienia się komunikatu: CMOS checksum error press F1 to continue press DEL to setup podczas uruchamiania systemu

Na podstawie wyników działania narzędzia diagnostycznego chkdsk, które są przedstawione na zrzucie ekranu, jaka jest wielkość pojedynczego klastra na dysku?

Typ systemu plików to FAT32.

Wolumin FTP utworzono 12-11-2005 18:31

Numer seryjny woluminu: 3CED-3B31

Trwa sprawdzanie plików i folderów...

Zakończono sprawdzanie plików i folderów.

Trwa sprawdzanie wolnego miejsca na dysku...

Zakończono sprawdzanie wolnego miejsca na dysku.

System Windows sprawdził system plików i nie znalazł żadnych problemów.

8 233 244 KB całkowitego miejsca na dysku.

1 KB w 13 plikach ukrytych.

2 KB w 520 folderach.

1 537 600 KB w 4 952 plikach.

6 690 048 KB jest dostępnych.

4 096 bajtów w każdej jednostce alokacji.

2 058 311 ogółem jednostek alokacji na dysku.

1 672 512 jednostek alokacji dostępnych na dysku.

C:\>

Co należy zrobić, gdy podczas uruchamiania komputera procedura POST zgłosi błąd odczytu lub zapisu w pamięci CMOS?

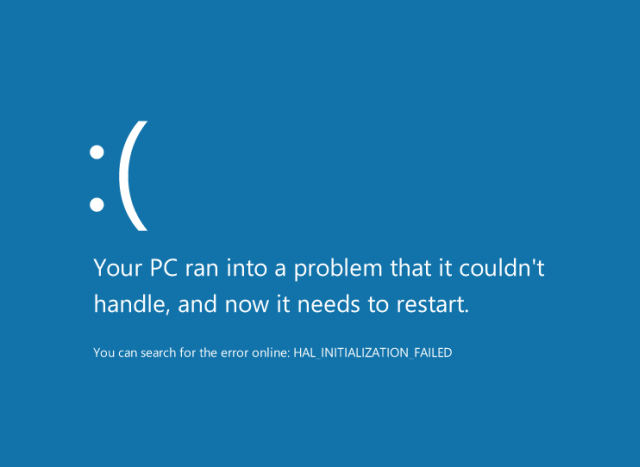

Zamieszczony komunikat tekstowy wyświetlony na ekranie komputera z zainstalowanym systemem Windows wskazuje na

W jakiej technologii produkcji projektorów stosowany jest system mikroskopijnych luster, przy czym każde z nich odpowiada jednemu pikselowi wyświetlanego obrazu?

Na ilustracji karta rozszerzeń jest oznaczona numerem

Dana jest sieć o adresie 172.16.0.0/16. Które z adresów sieci 172.16.0.0/16 są prawidłowe, jeśli zostaną wydzielone cztery podsieci o masce 18 bitowej?

Według przedstawionego cennika, średni wydatek na zakup sprzętu do stanowiska komputerowego wynosi

Jakie urządzenie powinno się zastosować do pomiaru topologii okablowania strukturalnego w sieci lokalnej?