Pytanie 1

Jak nazywa się protokół bazujący na architekturze klient-serwer oraz na modelu żądanie-odpowiedź, który jest używany do transferu plików?

Wynik: 6/40 punktów (15,0%)

Wymagane minimum: 20 punktów (50%)

Jak nazywa się protokół bazujący na architekturze klient-serwer oraz na modelu żądanie-odpowiedź, który jest używany do transferu plików?

Pliki specjalne urządzeń, tworzone podczas instalacji sterowników w systemie Linux, są zapisywane w katalogu

W tabeli przedstawiono numery podzespołów, które są ze sobą kompatybilne

| Lp. | Podzespół | Parametry |

|---|---|---|

| 1. | Procesor | INTEL COREi3-4350- 3.60 GHz, x2/4, 4 MB, 54W, HD 4600, BOX, s-1150 |

| 2. | Procesor | AMD Ryzen 7 1800X, 3.60 GHz, 95W, s-AM4 |

| 3. | Płyta główna | GIGABYTE ATX, X99, 4x DDR3, 4x PCI-E 16x, RAID, HDMI, D-Port, D-SUB, 2x USB 3.1, 8 x USB 2.0, S-AM3+ |

| 4. | Płyta główna | Asus CROSSHAIR VI HERO, X370, SATA3, 4xDDR4, USB3.1, ATX, WI-FI AC, s- AM4 |

| 5. | Pamięć RAM | Corsair Vengeance LPX, DDR4 2x16GB, 3000MHz, CL15 black |

| 6. | Pamięć RAM | Crucial Ballistix DDR3, 2x8GB, 1600MHz, CL9, black |

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Urządzenie warstwy dystrybucji, które umożliwia komunikację pomiędzy różnymi sieciami, to

Który z portów znajdujących się na tylnej części komputera jest oznaczony podanym symbolem?

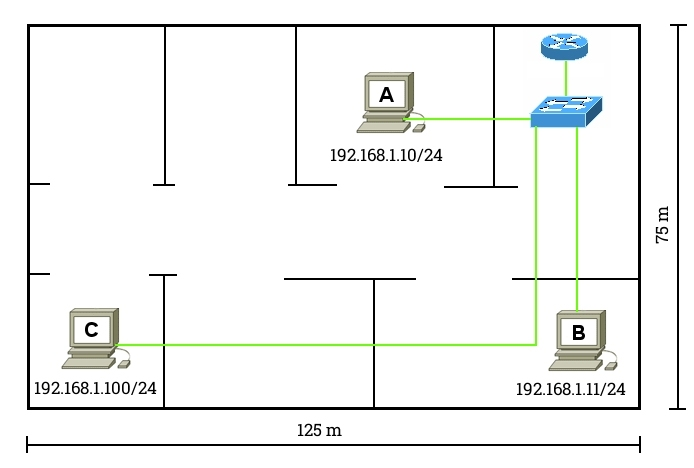

Na schemacie pokazano sieć LAN wykorzystującą okablowanie kategorii 6. Stacja robocza C nie może nawiązać połączenia z siecią. Jaki problem warstwy fizycznej może być przyczyną braku komunikacji?

Aby wykonać ręczne ustawienie interfejsu sieciowego w systemie LINUX, należy użyć polecenia

System limitów dyskowych, umożliwiający kontrolowanie wykorzystania zasobów dyskowych przez użytkowników, nazywany jest

Jakie jest główne zadanie programu Wireshark?

Do wykonywania spawów włókien światłowodowych nie jest konieczne:

Jakie gniazdo w notebooku jest przeznaczone do podłączenia kamery cyfrowej przez interfejs i.Link?

Która z usług serwerowych oferuje automatyczne ustawienie parametrów sieciowych dla stacji roboczych?

Aby zmienić port drukarki zainstalowanej w systemie Windows, która funkcja powinna zostać użyta?

Pamięć podręczna Intel Smart Cache, która znajduje się w procesorach wielordzeniowych, takich jak Intel Core Duo, to pamięć

Komputer A, który musi wysłać dane do komputera B znajdującego się w sieci z innym adresem IP, najpierw przekazuje pakiety do adresu IP

Jaką liczbę punktów abonenckich (2 x RJ45) zgodnie z wytycznymi normy PN-EN 50167 powinno się zainstalować w biurze o powierzchni 49 m2?

Wskaź zestaw wykorzystywany do diagnozowania logicznych systemów elektronicznych na płycie głównej komputera, który nie reaguje na próbę uruchomienia zasilania?

Narzędziem do monitorowania wydajności i niezawodności w systemach Windows 7, Windows Server 2008 R2 oraz Windows Vista jest

Substancją używaną w drukarkach 3D jest

Posiadacz notebooka pragnie zainstalować w nim dodatkowy dysk twardy. Urządzenie ma jedynie jedną zatokę na HDD. Możliwością rozwiązania tego wyzwania może być użycie dysku z interfejsem

Jaki skrót oznacza rodzaj licencji Microsoft dedykowanej dla szkół, uczelni, instytucji rządowych oraz dużych firm?

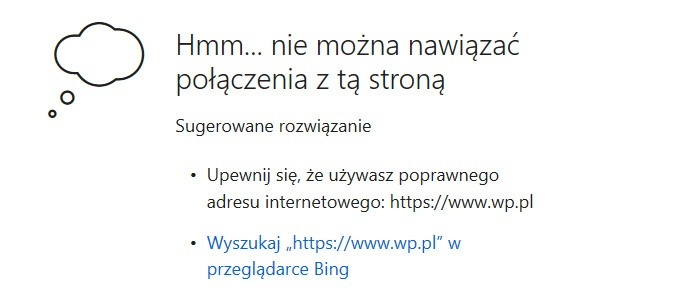

Informacja zawarta na ilustracji może wskazywać na

Na dysku obok systemu Windows zainstalowano system Linux Ubuntu. W celu dostosowania kolejności uruchamiania systemów operacyjnych, należy zmienić zawartość

W systemie Linux program top umożliwia

Wskaż technologię stosowaną do zapewnienia dostępu do Internetu w połączeniu z usługą telewizji kablowej, w której światłowód oraz kabel koncentryczny pełnią rolę medium transmisyjnego

Aby połączyć dwa przełączniki oddalone o 200 m i osiągnąć minimalną przepustowość 200 Mbit/s, jakie rozwiązanie należy zastosować?

Jaki protokół sieciowy używa portu 53?

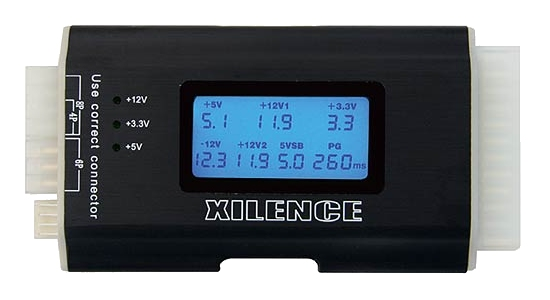

Przy użyciu urządzenia przedstawionego na ilustracji można sprawdzić działanie

Okablowanie strukturalne klasyfikuje się jako część infrastruktury

Profil użytkownika systemu Windows, który można wykorzystać do logowania na dowolnym komputerze w sieci, przechowywany na serwerze i mogący być edytowany przez użytkownika, to profil

Określ najprawdopodobniejszą przyczynę pojawienia się komunikatu: CMOS checksum error press F1 to continue press DEL to setup podczas uruchamiania systemu

Pamięć RAM pokazana na ilustracji jest instalowana na płycie głównej posiadającej gniazdo

Funkcja Intel Turbo Boost w mikroprocesorze umożliwia

W jakiej usłudze wykorzystywany jest protokół RDP?

Interfejs HDMI w komputerze umożliwia transfer sygnału

Jakie są zasadnicze różnice pomiędzy poleceniem ps a poleceniem top w systemie Linux?

Na ilustracji pokazano tylną część panelu

W strukturze sieciowej zaleca się umiejscowienie jednego punktu abonenckiego na powierzchni wynoszącej

Który element pasywny sieci powinien być użyty do połączenia okablowania ze wszystkich gniazd abonenckich z panelem krosowniczym umieszczonym w szafie rack?