Pytanie 1

Który standard implementacji sieci Ethernet określa sieć wykorzystującą kabel koncentryczny, z maksymalną długością segmentu wynoszącą 185 m?

Wynik: 39/40 punktów (97,5%)

Wymagane minimum: 20 punktów (50%)

Który standard implementacji sieci Ethernet określa sieć wykorzystującą kabel koncentryczny, z maksymalną długością segmentu wynoszącą 185 m?

Jaką maksymalną długość kabla typu skrętka pomiędzy panelem krosowniczym a gniazdem abonenckim przewiduje norma PN-EN 50174-2?

Na ilustracji widać

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Na podstawie oznaczenia pamięci DDR3 PC3-16000 można stwierdzić, że pamięć ta

Kiedy użytkownik systemu Windows wybiera opcję przywrócenia do określonego punktu, które pliki utworzone po tym punkcie nie będą podlegać zmianom w wyniku tej operacji?

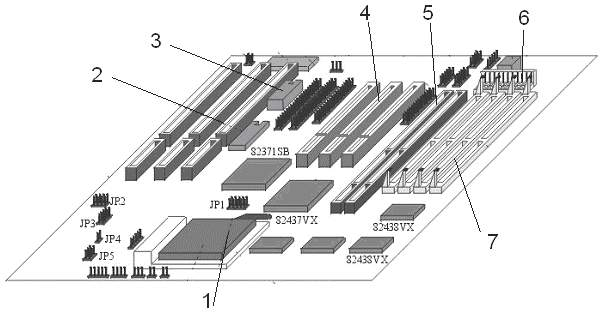

Na schemacie płyty głównej port PCI oznaczony jest numerem

Jakie gniazdo w notebooku jest przeznaczone do podłączenia kamery cyfrowej przez interfejs i.Link?

Fizyczna architektura sieci, inaczej określana jako topologia fizyczna sieci komputerowych, definiuje

Optyczna rozdzielczość to jeden z atrybutów

Które systemy operacyjne są atakowane przez wirusa MS Blaster?

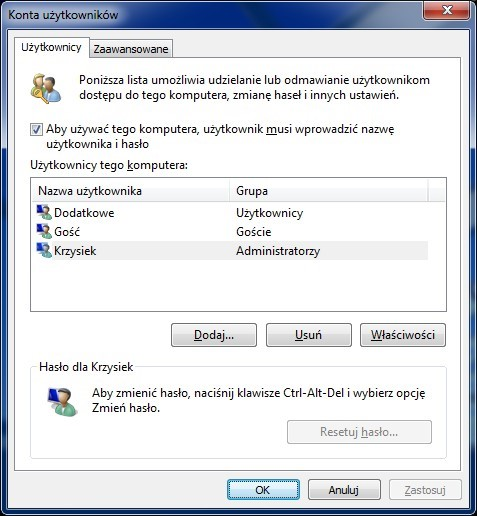

Aby uruchomić przedstawione narzędzie systemu Windows, należy użyć polecenia

Jakie polecenia należy zrealizować, aby zamontować pierwszą partycję logiczną dysku primary slave w systemie Linux?

Trzech użytkowników komputera z systemem operacyjnym Windows XP Pro posiada swoje foldery z dokumentami w głównym katalogu dysku C:. Na dysku znajduje się system plików NTFS. Użytkownicy mają utworzone konta z ograniczonymi uprawnieniami. Jak można zabezpieczyć folder każdego z użytkowników, aby inni nie mieli możliwości modyfikacji jego zawartości?

Narzędzie diagnostyczne tracert służy do ustalania

Zintegrowana karta sieciowa na płycie głównej uległa awarii. Komputer nie może załadować systemu operacyjnego, ponieważ brakuje zarówno dysku twardego, jak i napędów optycznych, a system operacyjny jest uruchamiany z lokalnej sieci. W celu przywrócenia utraconej funkcjonalności, należy zainstalować w komputerze

Monolityczne jądro (kernel) występuje w którym systemie?

Gdy w przeglądarce internetowej wpiszemy adres HTTP, pojawia się błąd "403 Forbidden", co oznacza, że

Jaką operację można wykonać podczas konfiguracji przełącznika CISCO w interfejsie CLI, nie przechodząc do trybu uprzywilejowanego, w zakresie dostępu widocznym w ramce?

| Switch> |

Zasadniczym sposobem zabezpieczenia danych przechowywanych na serwerze jest

Obudowa oraz wyświetlacz drukarki fotograficznej są bardzo brudne. Jakie środki należy zastosować, aby je wyczyścić?

Rodzajem złośliwego oprogramowania będącego programem rezydentnym, który działa, wykonując konkretną operację, nie powiela się przez sieć, a jedną z jego metod jest samoreplikacja aż do wyczerpania pamięci komputera, jest

Który z poniższych protokołów nie jest wykorzystywany do konfiguracji wirtualnej sieci prywatnej?

Na płycie głównej uszkodzona została zintegrowana karta sieciowa. Komputer nie ma zainstalowanego dysku twardego ani żadnych innych napędów, takich jak stacja dysków czy CD-ROM. Klient informuje, że w firmowej sieci komputery nie mają napędów, a wszystko "czyta" się z serwera. W celu przywrócenia utraconej funkcji należy zainstalować

Jak określana jest transmisja w obie strony w sieci Ethernet?

Montaż przedstawionej karty graficznej będzie możliwy na płycie głównej wyposażonej w złącze

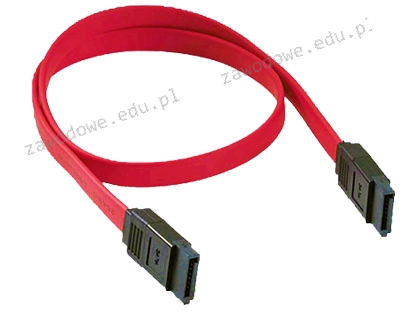

Na ilustracji przedstawiono przewód z wtykami

Jakie narzędzie jest najbardziej odpowiednie do delikatnego zgięcia blachy obudowy komputera oraz przykręcenia śruby montażowej w trudno dostępnej lokalizacji?

Urządzenie funkcjonujące w warstwie łącza danych, które umożliwia połączenie segmentów sieci o różnych architekturach, to

Jakie narzędzie w systemie Windows służy do przeglądania informacji dotyczących problemów z systemem?

Jakie urządzenie należy zastosować do pomiaru mocy zużywanej przez komputer?

W systemie Linux Ubuntu Server, aby przeprowadzić instalację serwera DHCP, należy wykorzystać polecenie

Wskaż właściwą formę maski

Jakość skanowania można poprawić poprzez zmianę

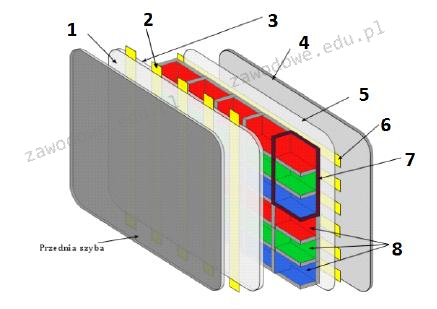

Na diagramie przedstawiającym zasadę funkcjonowania monitora plazmowego numer 6 zaznaczono

Która norma w Polsce definiuje zasady dotyczące okablowania strukturalnego?

W przypadku drukarki igłowej, jaki materiał eksploatacyjny jest używany?

Wymogi działalności przedsiębiorstwa nakładają konieczność używania systemów plików, które zapewniają wysoki poziom zabezpieczeń oraz umożliwiają szyfrowanie informacji. W związku z tym należy wybrać system operacyjny Windows

Aplikacją systemu Windows, która umożliwia analizę wpływu różnych procesów i usług na wydajność CPU oraz oceny stopnia obciążenia pamięci i dysku, jest

Jak nazywa się translacja adresów źródłowych w systemie NAT routera, która zapewnia komputerom w sieci lokalnej dostęp do internetu?