Pytanie 1

Przed rozpoczęciem instalacji sterownika dla urządzenia peryferyjnego system Windows powinien weryfikować, czy dany sterownik ma podpis

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

Przed rozpoczęciem instalacji sterownika dla urządzenia peryferyjnego system Windows powinien weryfikować, czy dany sterownik ma podpis

Jaką prędkość przesyłu danych określa standard sieci Ethernet IEEE 802.3z?

Narzędziem do monitorowania wydajności i niezawodności w systemach Windows 7, Windows Server 2008 R2 oraz Windows Vista jest

W systemie Windows, aby uruchomić usługę związaną z wydajnością komputera, należy użyć polecenia

W podejściu archiwizacji danych określanym jako Dziadek – Ojciec – Syn na poziomie Dziadek wykonuje się kopię danych na koniec

Wskaż błędny sposób podziału dysku MBR na partycje?

Nośniki informacji, takie jak dysk twardy, gromadzą dane w jednostkach określanych jako sektory, których rozmiar wynosi

Jaki element sieci SIP określamy jako telefon IP?

Jaką wartość ma liczba 5638 zapisana w systemie szesnastkowym?

Ile maksymalnie podstawowych partycji możemy stworzyć na dysku twardym używając MBR?

Wykonanie polecenia net use Z:192.168.20.2data /delete spowoduje?

W lokalnej sieci protokołem odpowiedzialnym za dynamiczną konfigurację adresów IP jest

Aby zorganizować pliki na dysku w celu poprawy wydajności systemu, należy:

Podstawowym celem użycia przełącznika /renew w poleceniu ipconfig w systemie Windows jest

Podczas próby nawiązania połączenia z serwerem FTP, uwierzytelnienie anonimowe nie powiodło się, natomiast logowanie za pomocą loginu i hasła zakończyło się sukcesem. Co może być przyczyną tej sytuacji?

Urządzenie peryferyjne, które jest kontrolowane przez komputer i służy do pracy z dużymi, płaskimi powierzchniami, a do produkcji druku odpornego na warunki atmosferyczne wykorzystuje farby na bazie rozpuszczalników, nosi nazwę ploter

Dysk twardy IDE wewnętrzny jest zasilany przez połączenie typu

Jakie narzędzie w systemie Windows umożliwia kontrolę prób logowania do systemu?

W systemie Linux polecenie touch ma na celu

Bez uzyskania zgody właściciela praw autorskich do oprogramowania, jego legalny użytkownik, zgodnie z ustawą o prawie autorskim i prawach pokrewnych, co może uczynić?

W jakiej logicznej topologii działa sieć Ethernet?

Który z wymienionych parametrów procesora AMD APU A10 5700 3400 nie ma bezpośredniego wpływu na jego wydajność?

| Częstotliwość | 3400 MHz |

| Proces technologiczny | 32 nm |

| Architektura | 64 bit |

| Ilość rdzeni | 4 |

| Ilość wątków | 4 |

| Pojemność pamięci L1 (instrukcje) | 2x64 kB |

| Pojemność pamięci L1 (dane) | 4x16 kB |

| Pojemność Pamięci L2 | 2x2 MB |

Plik ma wielkość 2 KiB. Co to oznacza?

Aby przetestować w systemie Windows poprawność działania nowo zainstalowanej drukarki, należy

Protokół SNMP (Simple Network Management Protocol) jest wykorzystywany do

W systemie Windows powiązanie rozszerzeń plików z odpowiednimi programami realizuje się za pomocą polecenia

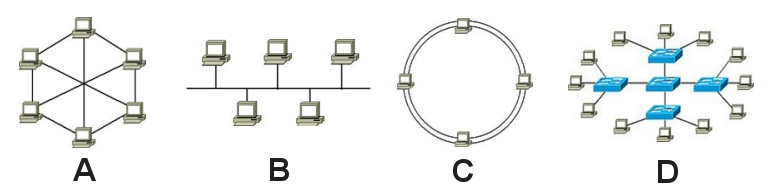

Który z rysunków ilustruje topologię sieci w układzie magistrali?

Co oznacza określenie średni czas dostępu w dyskach twardych?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Według normy JEDEC, standardowe napięcie zasilające dla modułów pamięci RAM DDR3L o niskim napięciu wynosi

Dane dotyczące kont użytkowników w systemie LINUX są zapisane w pliku

Jak nazywa się urządzenie wskazujące, które współpracuje z monitorami CRT i ma końcówkę z elementem światłoczułym, a jego dotknięcie ekranu monitora skutkuje przesłaniem sygnału do komputera, co umożliwia lokalizację kursora?

Który protokół z warstwy aplikacji reguluje przesyłanie wiadomości e-mail?

Symbol umieszczony na obudowie komputera stacjonarnego informuje o zagrożeniu przed

Najwyższy stopień zabezpieczenia sieci bezprzewodowej zapewnia szyfrowanie

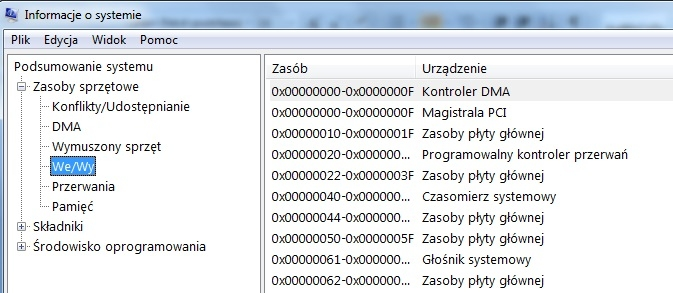

W którym systemie liczbowym zapisano zakresy We/Wy przedstawione na ilustracji?

Menedżer usług IIS (Internet Information Services) w systemie Windows stanowi graficzny interfejs do konfiguracji serwera

Złącze o rozmiarze ferruli 1,25 to jakie?

W przypadku, gdy w tej samej przestrzeni będą funkcjonować jednocześnie dwie sieci WLAN zgodne ze standardem 802.11g, w celu zminimalizowania ryzyka wzajemnych zakłóceń, powinny one otrzymać kanały o numerach różniących się o

Przedstawiony panel tylny płyty głównej jest wyposażony między innymi w interfejsy: