Pytanie 1

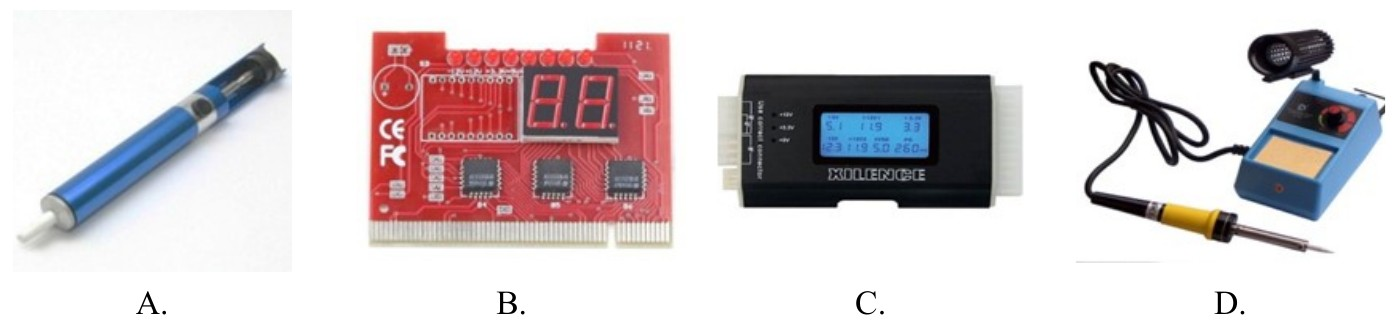

Jakie narzędzie powinno być użyte do zbadania wyników testu POST dla modułów na płycie głównej?

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

Jakie narzędzie powinno być użyte do zbadania wyników testu POST dla modułów na płycie głównej?

Wskaż złącze, które nie jest obecne w zasilaczach ATX?

Jakim wynikiem jest suma liczb binarnych 1001101 oraz 11001?

Na płycie głównej uszkodzona została zintegrowana karta sieciowa. Komputer nie ma możliwości uruchomienia systemu operacyjnego, ponieważ brakuje dysku twardego oraz napędów optycznych, a system operacyjny uruchamia się z lokalnej sieci. W celu odzyskania utraconej funkcjonalności należy zainstalować w komputerze

Podczas wymiany uszkodzonej karty graficznej, która współpracowała z monitorem posiadającym jedynie wejście analogowe, jaką kartę należy wybrać?

Dodatkowe właściwości wyniku operacji przeprowadzanej przez jednostkę arytmetyczno-logiczna ALU zawiera

Najskuteczniejszym sposobem na codzienną archiwizację pojedynczego pliku o objętości 4,8 GB, na jednym komputerze bez dostępu do sieci, jest

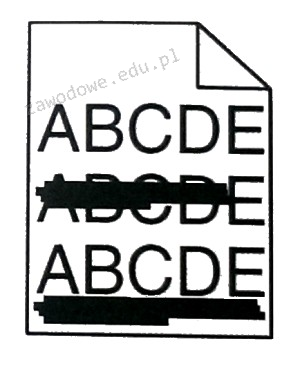

Zainstalowanie w komputerze wskazanej karty pozwoli na

Zgodnie z zamieszczonym cennikiem, średni koszt wyposażenia stanowiska komputerowego wynosi:

| Nazwa sprzętu | Cena minimalna | Cena maksymalna |

|---|---|---|

| Jednostka centralna | 1300,00 zł | 4550,00 zł |

| Monitor | 650,00 zł | 2000,00 zł |

| Klawiatura | 28,00 zł | 100,00 zł |

| Myszka | 22,00 zł | 50,00 zł |

Ile wyniesie całkowity koszt wymiany karty sieciowej w komputerze, jeżeli cena karty to 40 zł, czas pracy serwisanta wyniesie 90 minut, a koszt każdej rozpoczętej roboczogodziny to 60 zł?

Okablowanie pionowe w sieci strukturalnej łączy jakie elementy?

Jakie urządzenie pozwoli na połączenie kabla światłowodowego zastosowanego w okablowaniu pionowym sieci z przełącznikiem, który ma jedynie złącza RJ45?

Jaki typ macierzy dyskowych zapewnia tak zwany mirroring dysków?

Jakiej kategorii skrętka pozwala na przesył danych w zakresie częstotliwości nieprzekraczającym 100 MHz przy szybkości do 1 Gb/s?

Co oznacza oznaczenie kabla skrętkowego U/FTP?

Który z wymienionych składników zalicza się do elementów pasywnych sieci?

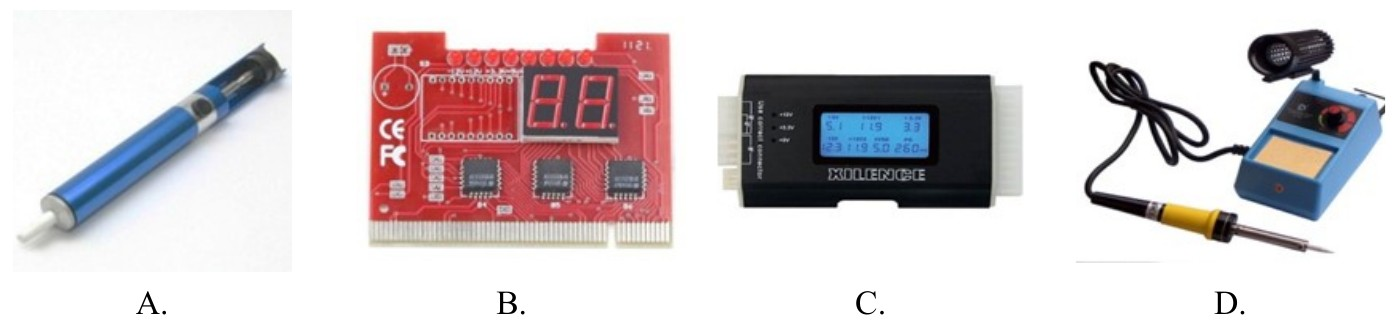

Ile symboli switchy i routerów znajduje się na schemacie?

Który rodzaj złącza nie występuje w instalacjach światłowodowych?

Zainstalowanie gniazda typu keystone w serwerowej szafie jest możliwe w

W jaki sposób oznaczona jest skrętka bez zewnętrznego ekranu, mająca każdą parę w osobnym ekranie folii?

Zjawisko crosstalk, które występuje w sieciach komputerowych, polega na

W biurze należy zamontować 5 podwójnych gniazd abonenckich. Średnia odległość od lokalnego punktu dystrybucyjnego do gniazda abonenckiego wynosi 10m. Jaki będzie przybliżony koszt zakupu kabla UTP kategorii 5e do utworzenia sieci lokalnej, jeśli cena brutto za 1m kabla UTP kategorii 5e wynosi 1,60 zł?

Po przeprowadzeniu diagnostyki komputera stwierdzono, że temperatura pracy karty graficznej z wyjściami HDMI oraz D-SUB, umieszczonej w gnieździe PCI Express stacjonarnego komputera, wynosi 87°C. W takiej sytuacji serwisant powinien

Jaką technologię wykorzystuje się do uzyskania dostępu do Internetu oraz odbioru kanałów telewizyjnych w formie cyfrowej?

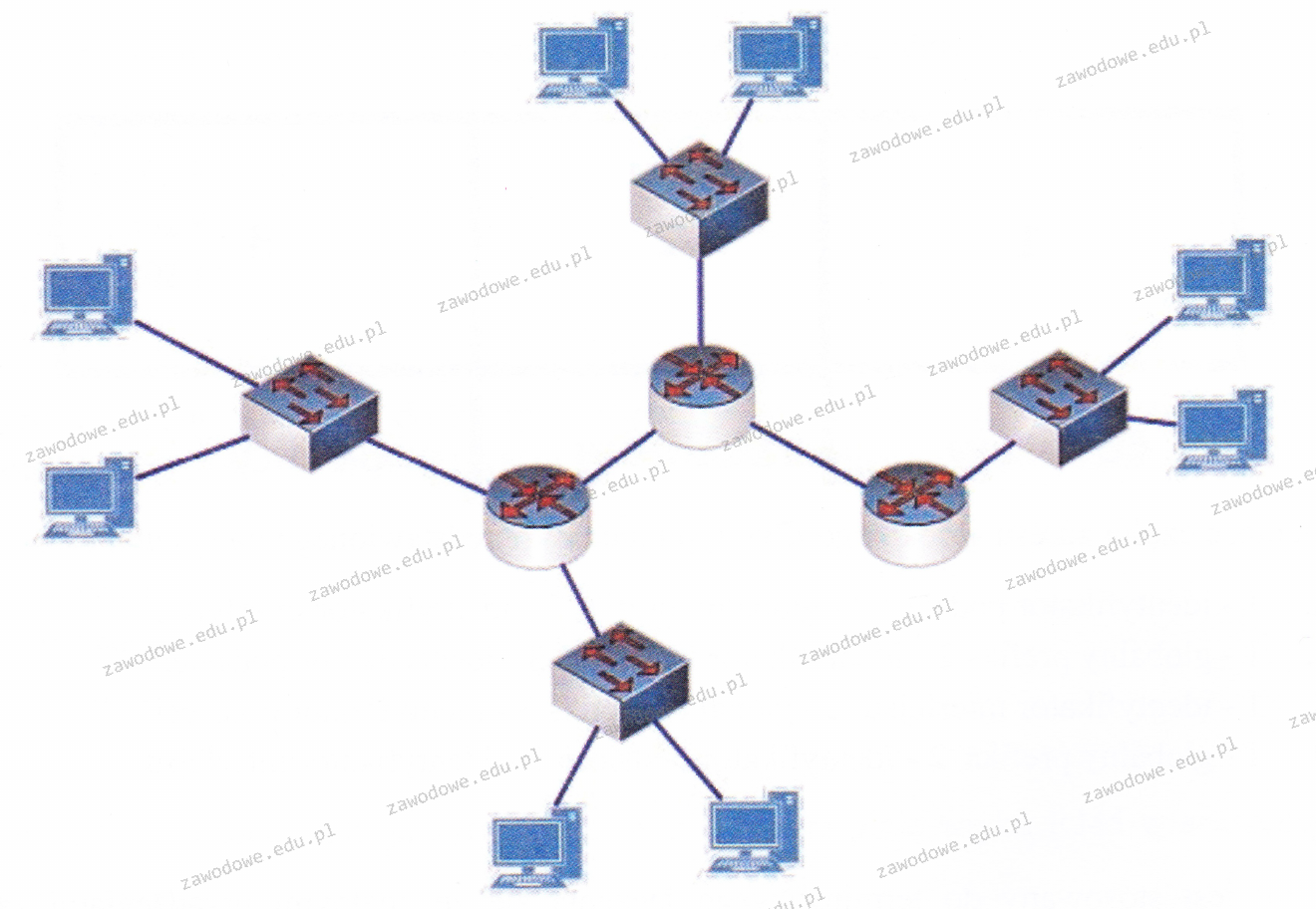

Na diagramie płyty głównej, który znajduje się w dokumentacji laptopa, złącza oznaczone numerami 8 i 9 to

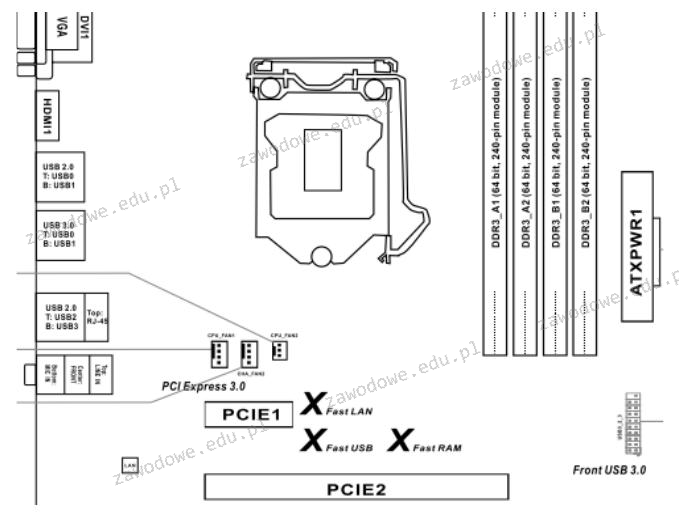

Na wskazanej płycie głównej możliwe jest zainstalowanie procesora w obudowie typu

Źródłem problemu z wydrukiem z przedstawionej na rysunku drukarki laserowej jest

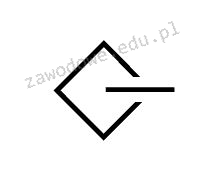

Na ilustracji ukazano złącze zasilające

Jakim interfejsem można osiągnąć przesył danych o maksymalnej przepustowości 6Gb/s?

Podczas realizacji projektu sieci komputerowej, pierwszym krokiem powinno być

Sygnatura (ciąg bitów) 55AA (w systemie szesnastkowym) kończy tablicę partycji. Jaka jest odpowiadająca jej wartość w systemie binarnym?

Na dysku należy umieścić 100 tysięcy oddzielnych plików, z których każdy ma rozmiar 2570 bajtów. W takim przypadku, zapisane pliki będą zajmować najmniej miejsca na dysku z jednostką alokacji wynoszącą

Po włączeniu komputera na ekranie wyświetlił się komunikat "Non-system disk or disk error. Replace and strike any key when ready". Możliwą przyczyną tego może być

Zapisany symbol dotyczy urządzeń

Za przydzielanie czasu procesora do konkretnych zadań odpowiada

Problemy związane z zawieszaniem się systemu operacyjnego w trakcie jego uruchamiania są zazwyczaj spowodowane

Po włączeniu komputera wyświetlił się komunikat: Non-system disk or disk error. Replace and strike any key when ready. Co może być tego przyczyną?

Protokół używany do zarządzania urządzeniami w sieci to

Które stwierdzenie odnoszące się do ruterów jest prawdziwe?

Przesyłanie danych przez router, które wiąże się ze zmianą adresów IP źródłowych lub docelowych, określa się skrótem