Pytanie 1

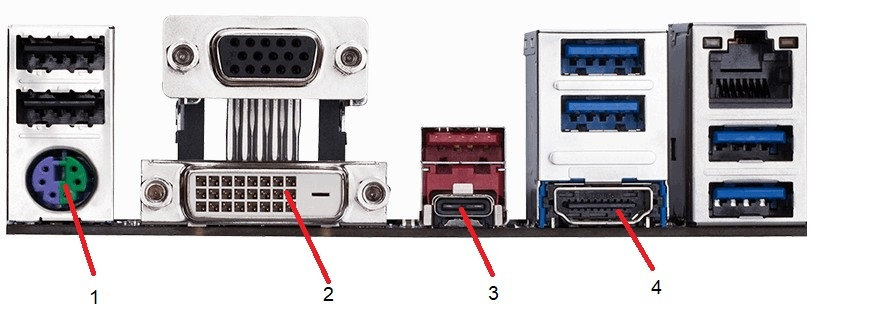

Jakie złącze, które pozwala na podłączenie monitora, znajduje się na karcie graficznej pokazanej na ilustracji?

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

Jakie złącze, które pozwala na podłączenie monitora, znajduje się na karcie graficznej pokazanej na ilustracji?

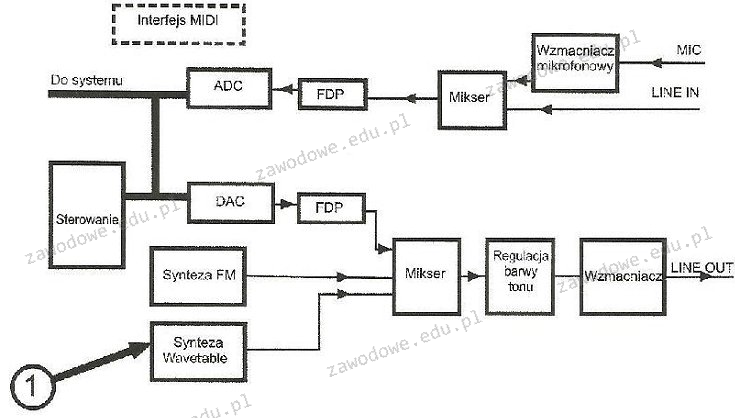

Element wskazany cyfrą 1 na diagramie karty dźwiękowej?

Jaki będzie najniższy koszt zakupu kabla UTP, potrzebnego do okablowania kategorii 5e, aby połączyć panel krosowniczy z dwoma podwójnymi gniazdami natynkowymi 2 x RJ45, które są oddalone odpowiednio o 10 m i 20 m od panelu, jeśli cena 1 m kabla wynosi 1,20 zł?

Magistrala PCI-Express wykorzystuje do transmisji danych metodę komunikacji

Podczas próby nawiązania połączenia z serwerem FTP, uwierzytelnienie anonimowe nie powiodło się, natomiast logowanie za pomocą loginu i hasła zakończyło się sukcesem. Co może być przyczyną tej sytuacji?

Ile par kabli w standardzie 100Base-TX jest używanych do transmisji danych w obie strony?

W jakim typie skanera wykorzystuje się fotopowielacze?

Narzędziem wiersza poleceń w systemie Windows, umożliwiającym zamianę tablicy partycji GPT na MBR, jest program

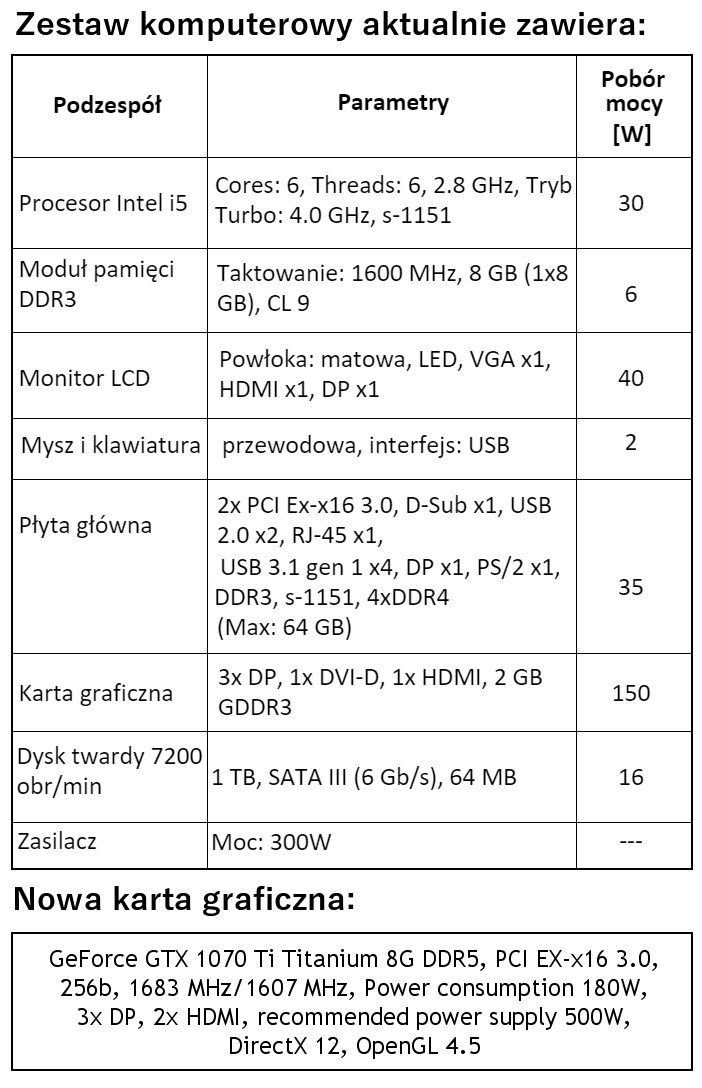

W zestawie komputerowym o parametrach wymienionych w tabeli konieczne jest zastąpienie karty graficznej nową, wskazaną w ramce. W związku z tym modernizacja tego komputera wymaga także wymiany

W systemie Windows do przeprowadzania aktualizacji oraz przywracania sterowników sprzętowych należy wykorzystać narzędzie

Jakie są korzyści płynące z użycia systemu plików NTFS?

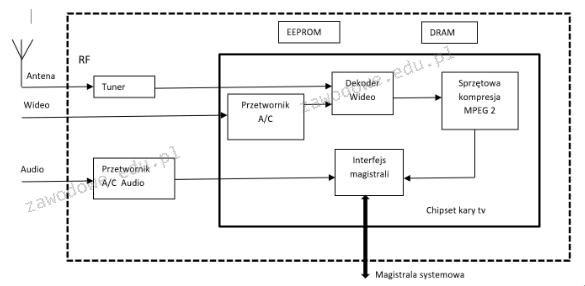

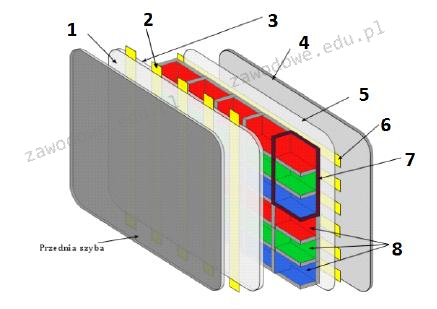

Na ilustracji przedstawiono diagram blokowy karty

Protokół, który pozwala na ściąganie wiadomości e-mail z serwera, to

Który port stosowany jest przez protokół FTP (File Transfer Protocol) do przesyłania danych?

Aby zweryfikować połączenia kabla U/UTP Cat. 5e w systemie okablowania strukturalnego, jakiego urządzenia należy użyć?

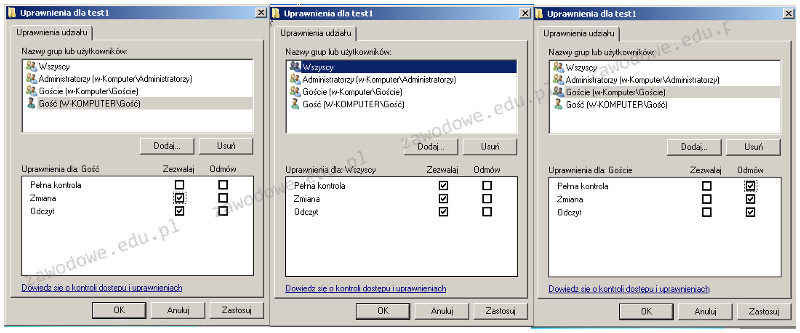

Użytkownik o nazwie Gość należy do grupy o nazwie Goście. Grupa Goście jest częścią grupy Wszyscy. Jakie ma uprawnienia użytkownik Gość w folderze test1?

Każdy następny router IP na ścieżce pakietu

Sieć 192.200.100.0 z maską 255.255.255.128 podzielono na 4 równe podsieci. Ile maksymalnie adresów hostów jest dostępnych w każdej podsieci?

Aby osiągnąć wysoką jakość połączeń głosowych VoIP kosztem innych przesyłanych informacji, konieczne jest włączenie i skonfigurowanie na routerze usługi

Celem złocenia styków złącz HDMI jest

Jakie porty powinny zostać zablokowane w firewallu, aby nie pozwolić na łączenie się z serwerem FTP?

Aby określić długość prefiksu w adresie IPv4, należy ustalić

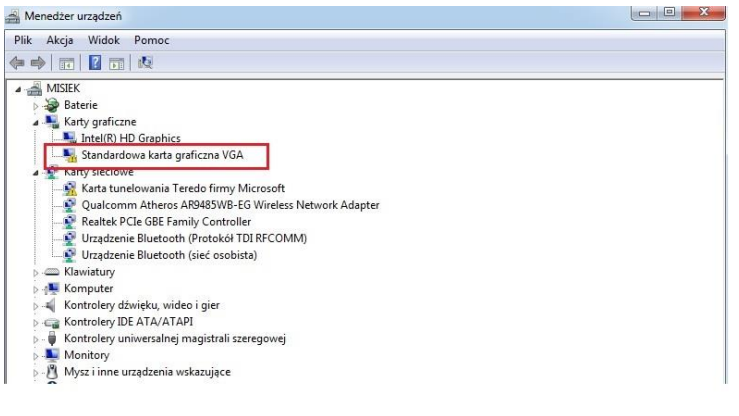

Jakie kroki powinien podjąć użytkownik, aby wyeliminować błąd zaznaczony na rysunku ramką?

W którym programie należy zmodyfikować ustawienia, aby użytkownik komputera mógł wybrać z menu i uruchomić jeden z kilku systemów operacyjnych zainstalowanych na jego komputerze?

Na diagramie przedstawiającym zasadę funkcjonowania monitora plazmowego numer 6 zaznaczono

Drukarka ma przypisany stały adres IP 172.16.0.101 oraz maskę 255.255.255.0. Jaki adres IP powinien być ustawiony dla komputera, aby nawiązać komunikację z drukarką w lokalnej sieci?

Aby przeprowadzić instalację systemu operacyjnego z rodziny Windows na stacjach roboczych, konieczne jest dodanie na serwerze usług

Urządzenie peryferyjne z interfejsem Mini-DIN podłącza się do gniazda oznaczonego na ilustracji

Najczęstszym powodem rozmazywania się tonera na wydrukach z drukarki laserowej jest

W systemie Windows harmonogram zadań umożliwia przydzielenie

Druk z drukarki igłowej realizowany jest z wykorzystaniem zestawu stalowych igieł w liczbie

Jakie informacje można uzyskać na temat konstrukcji skrętki S/FTP?

Który z podanych adresów protokołu IPv4 jest adresem klasy D?

Protokół TCP (Transmission Control Protocol) funkcjonuje w trybie

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jak nazywa się serwer Windows, na którym zainstalowano usługę Active Directory?

Do bezprzewodowego przesyłania danych pomiędzy dwoma urządzeniami, z wykorzystaniem fal radiowych w paśmie ISM 2,4 GHz, służy interfejs

Użytkownicy z grupy Pracownicy nie mają możliwości drukowania dokumentów za pośrednictwem serwera drukarskiego w systemie operacyjnym Windows Server. Przysługuje im jedynie uprawnienie 'Zarządzanie dokumentami'. Co należy uczynić, aby rozwiązać przedstawiony problem?

Nie jest możliwe tworzenie okresowych kopii zapasowych z dysku serwera na przenośnych nośnikach typu

Wskaż nazwę programu stosowanego w systemie Linux do przekrojowego monitorowania parametrów, między innymi takich jak obciążenie sieci, zajętość systemu plików, statystyki partycji, obciążenie CPU czy statystyki IO.