Pytanie 1

Podczas konserwacji i czyszczenia drukarki laserowej, która jest odłączona od zasilania, pracownik serwisu komputerowego może zastosować jako środek ochrony indywidualnej

Wynik: 30/40 punktów (75,0%)

Wymagane minimum: 20 punktów (50%)

Podczas konserwacji i czyszczenia drukarki laserowej, która jest odłączona od zasilania, pracownik serwisu komputerowego może zastosować jako środek ochrony indywidualnej

Do przechowywania fragmentów dużych plików programów oraz danych, które nie mieszczą się w całości w pamięci, wykorzystywany jest

W trakcie użytkowania przewodowej myszy optycznej wskaźnik nie reaguje na ruch urządzenia po podkładce, a kursor zmienia swoje położenie dopiero po właściwym ustawieniu myszy. Te symptomy sugerują uszkodzenie

Jaką maksymalną prędkość transferu danych pozwala osiągnąć interfejs USB 3.0?

W systemie Windows, zainstalowanym w wersji obsługującej przydziały dyskowe, użytkownik o nazwie Gość

Na podstawie danych zawartych w tabeli dotyczącej specyfikacji płyty głównej, wskaż maksymalną liczbę kart rozszerzeń, które można zainstalować w magistrali Peripheral Component Interconnect.

Którego wbudowanego narzędzia w systemie Windows 8 Pro można użyć do szyfrowania danych?

Natychmiast po dostrzeżeniu utraty istotnych plików na dysku twardym, użytkownik powinien

Jakie zabezpieczenie w dokumentacji technicznej określa mechanizm zasilacza komputerowego zapobiegający przegrzaniu urządzenia?

Która struktura partycji pozwala na stworzenie do 128 partycji podstawowych na pojedynczym dysku?

Które polecenie pozwala na mapowanie zasobów sieciowych w systemie Windows Serwer?

Jaką rolę pełni usługa NAT działająca na ruterze?

Protokół, który pozwala na ściąganie wiadomości e-mail z serwera, to

Jakie polecenie w terminalu systemu operacyjnego Microsoft Windows umożliwi wyświetlenie szczegółów wszystkich zasobów udostępnionych na komputerze lokalnym?

Jaki protokół służy do przesyłania plików bez konieczności tworzenia połączenia?

Który adres IP reprezentuje hosta działającego w sieci o adresie 192.168.160.224/28?

Jakie zastosowanie ma oprogramowanie Microsoft Hyper-V?

Domyślnie dostęp anonimowy do zasobów serwera FTP umożliwia

Podczas tworzenia sieci kablowej o maksymalnej prędkości przesyłu danych wynoszącej 1 Gb/s, w której maksymalna odległość między punktami sieci nie przekracza 100 m, należy zastosować jako medium transmisyjne

Który z parametrów okablowania strukturalnego definiuje stosunek mocy sygnału tekstowego w jednej parze do mocy sygnału wyindukowanego w sąsiedniej parze na tym samym końcu kabla?

Jaki typ zabezpieczeń w sieciach WiFi oferuje najwyższy poziom ochrony?

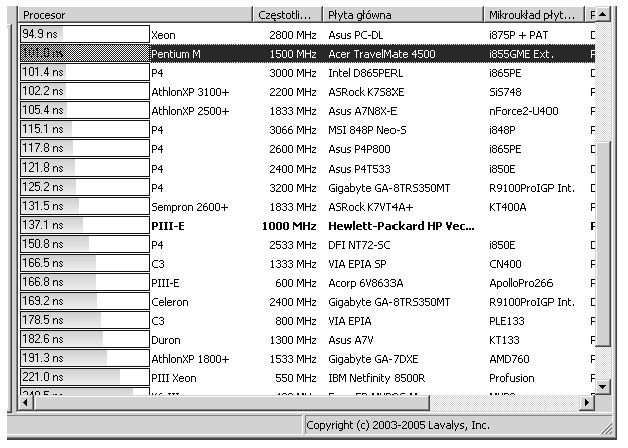

W specyfikacji technicznej płyty głównej znajduje się zapis Supports up to Athlon XP 3000+ processor. Co to oznacza w kontekście obsługi procesorów przez tę płytę główną?

Jaki system operacyjny funkcjonuje w trybie tekstowym i umożliwia uruchomienie środowiska graficznego KDE?

Aby wyjąć dysk twardy zamocowany w laptopie przy użyciu podanych śrub, najlepiej zastosować wkrętak typu

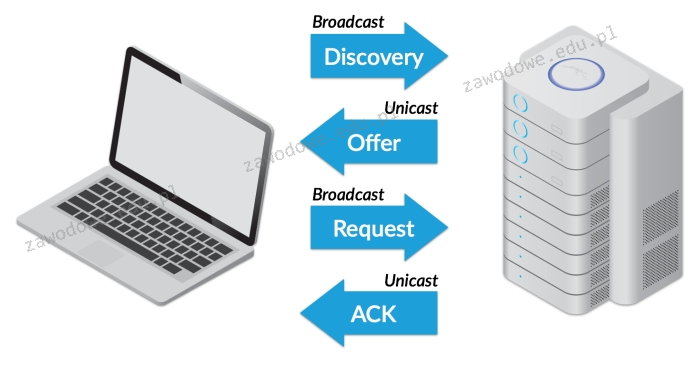

Którego protokołu działanie zostało zaprezentowane na diagramie?

Jakie medium transmisyjne powinno być użyte do połączenia dwóch punktów dystrybucyjnych oddalonych o 600m?

Jakie ustawienia dotyczące protokołu TCP/IP zostały zastosowane dla karty sieciowej, na podstawie rezultatu uruchomienia polecenia IPCONFIG /ALL w systemie Windows?

Karta bezprzewodowej sieci LAN Połączenie sieci bezprzewodowej:

Sufiks DNS konkretnego połączenia :

Opis. . . . . . . . . . . . . . . : Atheros AR5006EG Wireless Network Adapter

Adres fizyczny. . . . . . . . . . : 00-15-AF-35-65-98

DHCP włączone . . . . . . . . . . : Tak

Autokonfiguracja włączona . . . . : Tak

Adres IPv6 połączenia lokalnego . : fe80::8c5e:5e80:f376:fbax9(Preferowane)

Adres IPv4. . . . . . . . . . . . : 192.168.1.102(Preferowane)

Maska podsieci. . . . . . . . . . : 255.255.255.0

Dzierżawa uzyskana. . . . . . . . : 16 lutego 2009 16:51:02

Dzierżawa wygasa. . . . . . . . . : 17 lutego 2009 16:51:01

Brama domyślna. . . . . . . . . . : 192.168.1.1

Serwer DHCP . . . . . . . . . . . : 192.168.1.1

Serwery DNS . . . . . . . . . . . : 194.204.159.1

194.204.152.34

NetBIOS przez Tcpip. . . . . . . : WłączonyW architekturze ISO/OSI protokoły TCP oraz UDP funkcjonują w warstwie

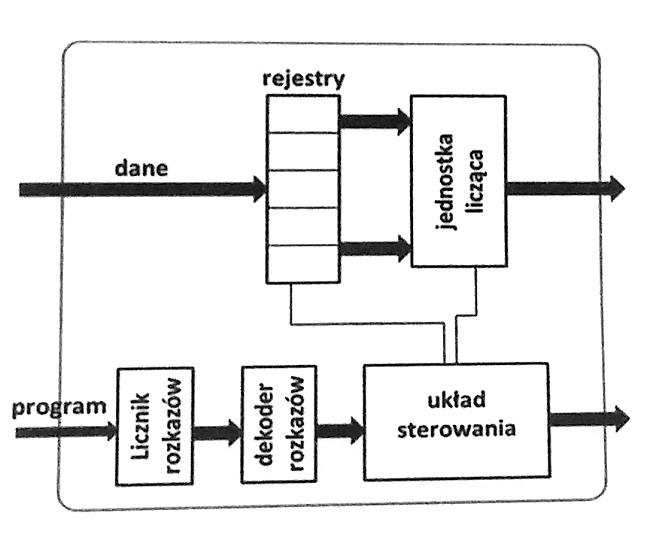

Rejestry przedstawione na diagramie procesora mają zadanie

Aby uzyskać optymalną wydajność, karta sieciowa w komputerze stosuje transmisję szeregową.

Adres fizyczny karty sieciowej AC-72-89-17-6E-B2 jest zapisany w formacie

Na ilustracji zaprezentowano zrzut ekranu z wykonanej analizy

Jak nazywa się złącze wykorzystywane w sieciach komputerowych, pokazane na zamieszczonym obrazie?

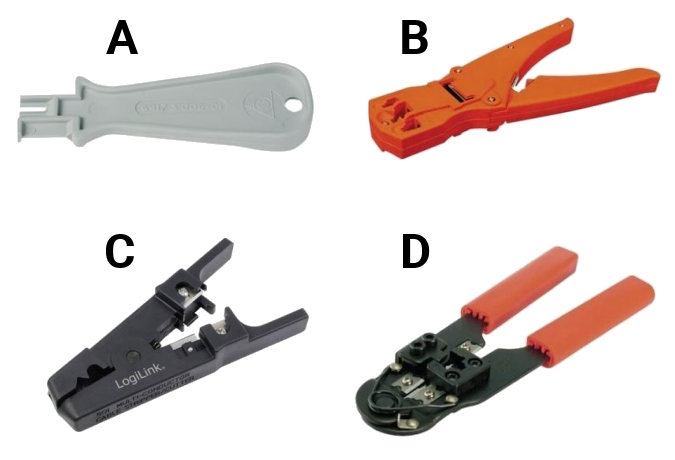

Który z przyrządów służy do usuwania izolacji?

Który z poniższych protokołów jest wykorzystywany do uzyskiwania dynamicznych adresów IP?

Interfejs UDMA to interfejs

Wskaż nazwę modelu przechowywania i przetwarzania danych opartego na użytkowaniu zasobów dyskowych, obliczeniowych i programowych, udostępnionych przez usługodawcę za pomocą sieci komputerowej.

W trakcie instalacji systemu Windows Serwer 2022 istnieje możliwość instalacji w trybie Core. Oznacza to, że system zostanie zainstalowany

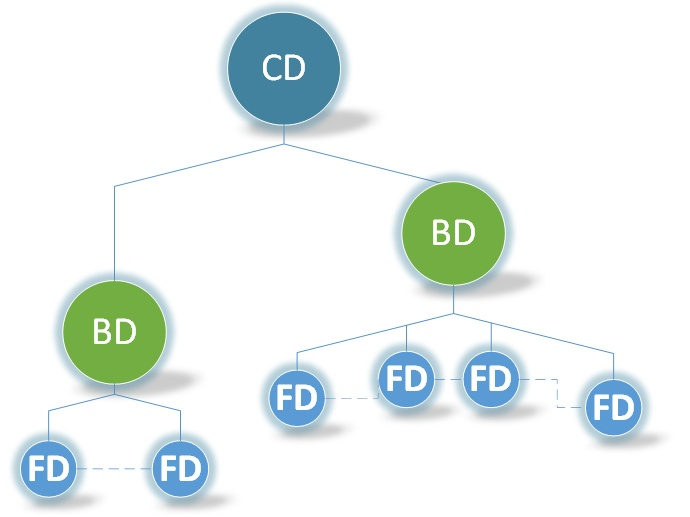

Przedstawiony schemat sieci kampusowej zawiera

Aby podczas prac montażowych zabezpieczyć szczególnie wrażliwe podzespoły elektroniczne komputera przed wyładowaniem elektrostatycznym, należy stosować