Pytanie 1

Ile pinów znajduje się w wtyczce SATA?

Wynik: 31/40 punktów (77,5%)

Wymagane minimum: 20 punktów (50%)

Ile pinów znajduje się w wtyczce SATA?

Thunderbolt jest typem interfejsu:

ACPI to interfejs, który pozwala na

Jak określamy atak na sieć komputerową, który polega na łapaniu pakietów przesyłanych w sieci?

W systemie Windows można przeprowadzić analizę wpływu uruchomionych aplikacji na wydajność komputera, korzystając z polecenia

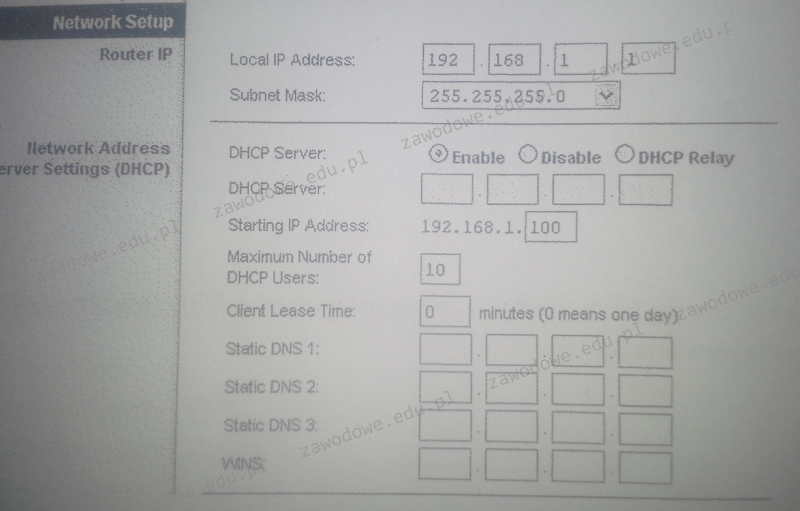

Na przedstawionym zrzucie panelu ustawień rutera można zauważyć, że serwer DHCP

Poprawność działania lokalnej sieci komputerowej po modernizacji powinna być potwierdzona

Do serwisu komputerowego przyniesiono laptopa, którego matryca wyświetla obraz w bardzo słabej jakości. Dodatkowo obraz jest znacząco ciemny i widoczny jedynie z niewielkiej odległości. Co może być przyczyną tej usterki?

Aby zmienić ustawienia konfiguracyjne Menu Start oraz paska zadań w systemie Windows, która przystawka powinna być wykorzystana?

Na podstawie oznaczenia pamięci DDR3 PC3-16000 można stwierdzić, że pamięć ta

Która struktura partycji pozwala na stworzenie do 128 partycji podstawowych na pojedynczym dysku?

Aby zapewnić, że komputer uzyska od serwera DHCP określony adres IP, należy na serwerze zdefiniować

Jaką funkcję pełni polecenie tee w systemie Linux?

Jakie polecenie jest wykorzystywane do odzyskiwania struktury kluczy rejestru z kopii zapasowej w systemie Windows?

Planowanie wykorzystania przestrzeni na dysku komputera do gromadzenia i udostępniania informacji takich jak pliki oraz aplikacje dostępne w sieci, a także ich zarządzanie, wymaga skonfigurowania komputera jako

Na ilustracji widoczne jest urządzenie służące do

Użytkownik systemu Windows napotyka komunikaty o zbyt małej ilości pamięci wirtualnej. W jaki sposób można rozwiązać ten problem?

SuperPi to aplikacja używana do testowania

Jaki procesor powinien być zastosowany podczas składania komputera stacjonarnego opartego na płycie głównej Asus M5A78L-M/USB3 AMD760G socket AM3+?

Aby umożliwić wymianę informacji pomiędzy sieciami VLAN, wykorzystuje się

Która z usług serwerowych oferuje automatyczne ustawienie parametrów sieciowych dla stacji roboczych?

Jaką liczbę hostów można podłączyć w sieci o adresie 192.168.1.128/29?

Na ilustracji pokazano część efektu działania programu przeznaczonego do testowania sieci. Sugeruje to użycie polecenia diagnostycznego w sieci

TCP 192.168.0.13:51614 bud02s23-in-f8:https ESTABLISHED TCP 192.168.0.13:51615 edge-star-mini-shv-01-ams3:https ESTABLISHED TCP 192.168.0.13:51617 93.184.220.29:http ESTABLISHED TCP 192.168.0.13:51619 93.184.220.29:http ESTABLISHED TCP 192.168.0.13:51620 93.184.220.29:http TIME_WAIT TCP 192.168.0.13:51621 bud02s23-in-f206:https TIME_WAIT TCP 192.168.0.13:51622 xx-fbcdn-shv-01-ams3:https ESTABLISHED TCP 192.168.0.13:51623 108.161.188.192:https ESTABLISHED TCP 192.168.0.13:51626 23.111.9.32:https TIME_WAIT TCP 192.168.0.13:51628 lg-in-f155:https ESTABLISHED TCP 192.168.0.13:51629 waw02s06-in-f68:https ESTABLISHED

Okablowanie wertykalne w sieci strukturalnej łączy

Wskaż poprawną wersję maski podsieci?

Jakiego protokołu używa się do ściągania wiadomości e-mail z serwera pocztowego na komputer użytkownika?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Aby zdalnie i jednocześnie bezpiecznie zarządzać systemem Linux, należy zastosować protokół

Każdy następny router IP na ścieżce pakietu

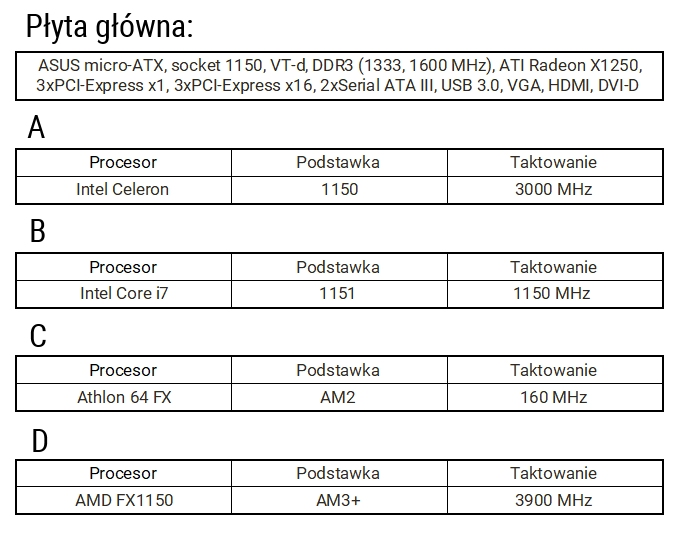

Jaki procesor pasuje do płyty głównej o podanej specyfikacji?

Zamieszczone atrybuty opisują rodzaj pamięci

| Maksymalne taktowanie | 1600 MHz |

| Przepustowość | PC12800 1600MHz |

| Opóźnienie | Cycle Latency CL 9,0 |

| Korekcja | Nie |

| Dual/Quad | Dual Channel |

| Radiator | Tak |

Zgodnie z normą Fast Ethernet 100Base-TX, maksymalna długość kabla miedzianego UTP kategorii 5e, który łączy bezpośrednio dwa urządzenia sieciowe, wynosi

Wskaż usługę, którą należy skonfigurować na serwerze aby blokować ruch sieciowy?

Sprzęt używany w sieciach komputerowych, posiadający dedykowane oprogramowanie do blokowania nieautoryzowanego dostępu do sieci, to

Jakie działanie może skutkować nieodwracalną utratą danych w przypadku awarii systemu plików?

Granice domeny kolizyjnej nie są określane przez porty takich urządzeń jak

Odmianą pamięci, która jest tylko do odczytu i można ją usunąć za pomocą promieniowania ultrafioletowego, jest pamięć

Który z poniższych systemów operacyjnych nie jest wspierany przez system plików ext4?

Jakie są przyczyny wyświetlenia na ekranie komputera komunikatu o wykryciu konfliktu adresów IP?

Aby zminimalizować wpływ zakłóceń elektromagnetycznych na przesyłany sygnał w projektowanej sieci komputerowej, co należy zastosować?