Pytanie 1

Tester strukturalnego okablowania umożliwia weryfikację

Wynik: 24/40 punktów (60,0%)

Wymagane minimum: 20 punktów (50%)

Tester strukturalnego okablowania umożliwia weryfikację

Technika określana jako rytownictwo dotyczy zasady funkcjonowania plotera

Oprogramowanie, które jest przypisane do konkretnego komputera lub jego komponentu i nie pozwala na reinstalację na nowszym sprzęcie zakupionym przez tego samego użytkownika, nosi nazwę

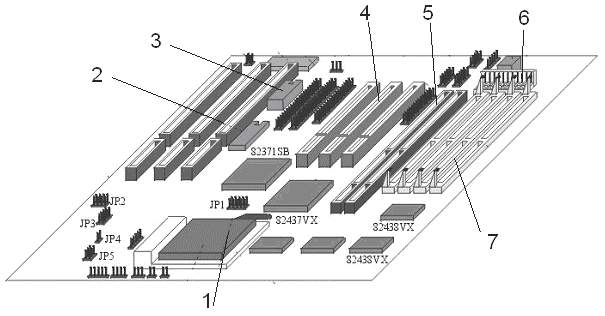

Na schemacie przedstawionej płyty głównej zasilanie powinno być podłączone do gniazda oznaczonego numerem

Aby sygnały pochodzące z dwóch routerów w sieci WiFi pracującej w standardzie 802.11g nie wpływały na siebie nawzajem, należy skonfigurować kanały o numerach

Jakim skrótem określa się połączenia typu punkt-punkt w ramach publicznej infrastruktury telekomunikacyjnej?

W jakiej warstwie modelu ISO/OSI wykorzystywane są adresy logiczne?

Na ilustracji widoczna jest pamięć operacyjna

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Zatrzymując pracę na komputerze, możemy szybko wznowić działania po wybraniu w systemie Windows opcji

Komputer powinien działać jako serwer w sieci lokalnej, umożliwiając innym komputerom dostęp do Internetu poprzez podłączenie do gniazda sieci rozległej za pomocą kabla UTP Cat 5e. Na chwilę obecną komputer jest jedynie połączony ze switchem sieci lokalnej również kablem UTP Cat 5e oraz nie dysponuje innymi portami 8P8C. Jakiego komponentu musi on koniecznie nabrać?

Jaki protokół służy do przesyłania plików bez konieczności tworzenia połączenia?

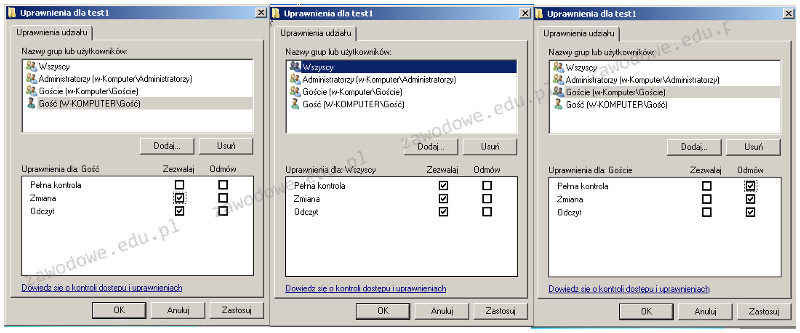

Użytkownik o nazwie Gość należy do grupy o nazwie Goście. Grupa Goście jest częścią grupy Wszyscy. Jakie ma uprawnienia użytkownik Gość w folderze test1?

Aby zwiększyć wydajność komputera, można zainstalować procesor obsługujący technologię Hyper-Threading, która pozwala na

Reprezentacja koloru RGB(255, 170, 129) odpowiada formatowi

Jakie złącze jest przypisane do kategorii 7?

Aktywacja opcji OCR podczas ustawiania skanera umożliwia

W sieciach bezprzewodowych Ad-Hoc (Independent Basic Service Set) wykorzystywana jest fizyczna struktura

Dane z HDD, którego sterownik silnika SM jest uszkodzony, można odzyskać

Liczby zapisane w systemie binarnym jako 10101010 oraz w systemie heksadecymalnym jako 2D odpowiadają następującym wartościom:

Jaką przepustowość określa standard Ethernet IEEE 802.3z?

Aby mieć możliwość tworzenia kont użytkowników, komputerów oraz innych obiektów, a także centralnego przechowywania informacji o nich, konieczne jest zainstalowanie na serwerze Windows roli

Jakim protokołem komunikacyjnym, który gwarantuje niezawodne przesyłanie danych, jest protokół

Zgodnie z zamieszczonym cennikiem, średni koszt wyposażenia stanowiska komputerowego wynosi:

| Nazwa sprzętu | Cena minimalna | Cena maksymalna |

|---|---|---|

| Jednostka centralna | 1300,00 zł | 4550,00 zł |

| Monitor | 650,00 zł | 2000,00 zł |

| Klawiatura | 28,00 zł | 100,00 zł |

| Myszka | 22,00 zł | 50,00 zł |

W sieciach bezprzewodowych typu Ad-Hoc IBSS (Independent Basic Service Set) wykorzystywana jest topologia fizyczna

Aby uniknąć uszkodzenia sprzętu podczas modernizacji komputera przenośnego polegającej na wymianie modułów pamięci RAM należy

Jakie medium transmisyjne stosują myszki bluetooth do łączności z komputerem?

Wskaż nazwę programu stosowanego w systemie Linux do przekrojowego monitorowania parametrów, między innymi takich jak obciążenie sieci, zajętość systemu plików, statystyki partycji, obciążenie CPU czy statystyki IO.

Na płycie głównej doszło do awarii zintegrowanej karty sieciowej. Komputer nie ma dysku twardego ani innych napędów, takich jak stacja dysków czy CD-ROM. Klient informuje, że w sieci firmowej komputery nie mają napędów, a wszystko "czyta" się z serwera. Aby przywrócić utraconą funkcjonalność, należy zainstalować

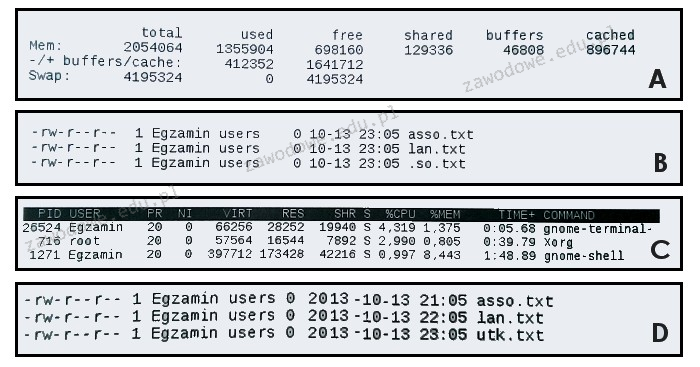

Wynik wykonania polecenia ```ls -l``` w systemie Linux przedstawia poniższy rysunek

Wskaż standard interfejsu stosowanego do przewodowego połączenia dwóch urządzeń.

W drukarce laserowej do utrwalenia wydruku na papierze stosuje się

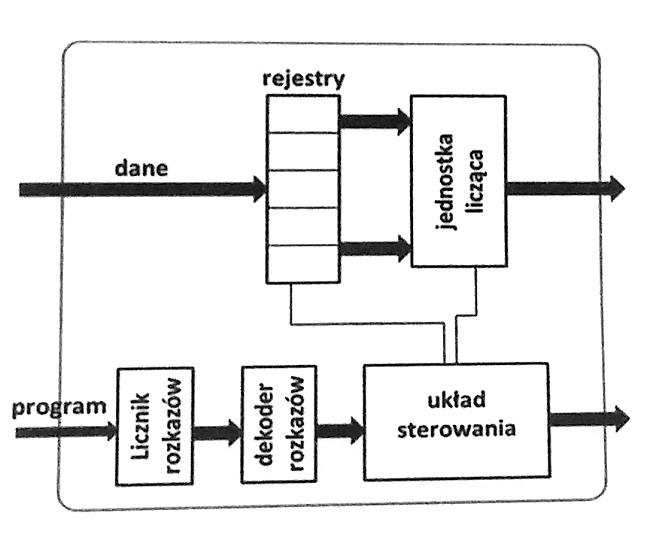

Rejestry przedstawione na diagramie procesora mają zadanie

Urządzenie, które łączy różne segmenty sieci i przekazuje ramki pomiędzy nimi, wybierając odpowiedni port docelowy dla przesyłanych ramek, to

Komputer wyposażony w BIOS firmy Award wygenerował komunikat o treści Primary/Secondary master/slave hard disk fail. Komunikat ten może oznaczać konieczność wymiany

W systemie Linux komenda cd ~ umożliwia

Jakie czynności należy wykonać, aby oczyścić zatkane dysze kartridża w drukarce atramentowej?

Liczba heksadecymalna 1E2F(16) w systemie oktalnym jest przedstawiana jako

Jaką funkcję pełni zarządzalny przełącznik, aby łączyć wiele połączeń fizycznych w jedno logiczne, co pozwala na zwiększenie przepustowości łącza?

Jakim interfejsem można uzyskać transmisję danych o maksymalnej przepustowości 6 Gb/s?