Pytanie 1

Narzędziem systemu Windows, służącym do sprawdzenia wpływu poszczególnych procesów i usług na wydajność procesora oraz tego, w jakim stopniu generują one obciążenie pamięci czy dysku, jest

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

Narzędziem systemu Windows, służącym do sprawdzenia wpływu poszczególnych procesów i usług na wydajność procesora oraz tego, w jakim stopniu generują one obciążenie pamięci czy dysku, jest

Najlepszą metodą ochrony danych przedsiębiorstwa, którego biura znajdują się w różnych, odległych miejscach, jest wdrożenie

Jaką maksymalną prędkość przesyłania danych osiągają urządzenia zgodne ze standardem 802.11g?

Narzędziem do monitorowania wydajności i niezawodności w systemach Windows 7, Windows Server 2008 R2 oraz Windows Vista jest

Jakie urządzenie stosuje technikę detekcji zmian w pojemności elektrycznej do sterowania kursorem na monitorze?

Jakie działanie nie przyczynia się do personalizacji systemu operacyjnego Windows?

Według normy PN-EN 50174 maksymalny rozplot kabla UTP powinien wynosić nie więcej niż

Jakie urządzenie powinno się zastosować do przeprowadzenia testu POST dla komponentów płyty głównej?

Jakie polecenie w systemie Windows przeznaczonym dla stacji roboczej umożliwia ustalenie wymagań logowania dla wszystkich użytkowników tej stacji?

Na zamieszczonym zdjęciu widać

Symbol błyskawicy pokazany na rysunku jest używany do oznaczania złącza

Jakim parametrem definiuje się stopień zmniejszenia mocy sygnału w danej parze przewodów po przejściu przez cały tor kablowy?

Najskuteczniejszym sposobem na wykonanie codziennego archiwizowania pojedynczego pliku o wielkości 4,8 GB, na jednym komputerze bez dostępu do Internetu jest

Które z urządzeń używanych w sieci komputerowej NIE WPŁYWA na liczbę domen kolizyjnych?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Podczas instalacji systemu operacyjnego Linux należy wybrać odpowiedni typ systemu plików

Lista sprzętu kompatybilnego z systemem operacyjnym Windows, publikowana przez firmę Microsoft to

Klient przyniósł do serwisu uszkodzony sprzęt komputerowy. W trakcie procedury odbioru sprzętu, przed rozpoczęciem jego naprawy, serwisant powinien

Typ profilu użytkownika w systemie Windows Serwer, który nie zapisuje zmian wprowadzonych na bieżącym pulpicie ani na serwerze, ani na stacji roboczej po wylogowaniu, to profil

Aby połączyć dwa przełączniki oddalone o 200 m i osiągnąć minimalną przepustowość 200 Mbit/s, jakie rozwiązanie należy zastosować?

Zjawisko przesłuchu w sieciach komputerowych polega na

Aby sprawdzić dysk twardy w systemie Linux na obecność uszkodzonych sektorów, użytkownik może zastosować program

Jak nazywa się serwer Windows, na którym zainstalowano usługę Active Directory?

W systemie Windows, po wydaniu komendy systeminfo, nie da się uzyskać danych o

Aby zidentyfikować, który program najbardziej obciąża CPU w systemie Windows, należy otworzyć program

Jakie polecenie powinien zastosować użytkownik systemu Linux, aby wydobyć zawartość archiwum o nazwie dane.tar?

Jakie oprogramowanie pełni rolę serwera DNS w systemie Linux?

Które systemy operacyjne są atakowane przez wirusa MS Blaster?

Jakie urządzenie powinno zostać wykorzystane do podłączenia komputerów, aby mogły funkcjonować w odrębnych domenach rozgłoszeniowych?

Jakie medium transmisyjne jest związane z adapterem przedstawionym na ilustracji?

Do usunięcia elementu Wszystkie programy z prostego Menu Start systemu Windows należy wykorzystać przystawkę

Okablowanie pionowe w sieci strukturalnej łączy się

Jakie polecenie należy wykorzystać w systemie Linux, aby zlokalizować wszystkie pliki z rozszerzeniem txt, które znajdują się w katalogu /home/user i mają w nazwie ciąg znaków abc?

Jakie właściwości topologii fizycznej sieci zostały przedstawione w poniższej ramce?

Który z wymienionych elementów stanowi część mechanizmu drukarki igłowej?

Industry Standard Architecture to norma magistrali, według której szerokość szyny danych wynosi

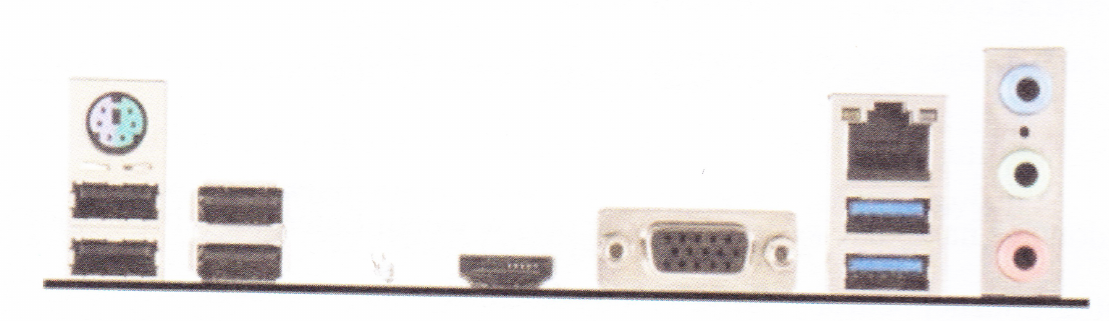

Zidentyfikuj interfejsy znajdujące się na panelu tylnym płyty głównej:

Zużyty sprzęt elektryczny lub elektroniczny, na którym znajduje się symbol zobrazowany na ilustracji, powinien być

Jaką maskę trzeba zastosować, aby podzielić sieć z adresem 192.168.1.0 na 4 podsieci?

Natychmiast po dostrzeżeniu utraty istotnych plików na dysku twardym, użytkownik powinien