Pytanie 1

Pracownik serwisu komputerowego podczas wykonywania konserwacji i czyszczenia drukarki laserowej, odłączonej od źródła zasilania, może wykorzystać jako środek ochrony indywidualnej

Wynik: 27/40 punktów (67,5%)

Wymagane minimum: 20 punktów (50%)

Pracownik serwisu komputerowego podczas wykonywania konserwacji i czyszczenia drukarki laserowej, odłączonej od źródła zasilania, może wykorzystać jako środek ochrony indywidualnej

Jakie urządzenie jest kluczowe dla połączenia pięciu komputerów w sieci o strukturze gwiazdy?

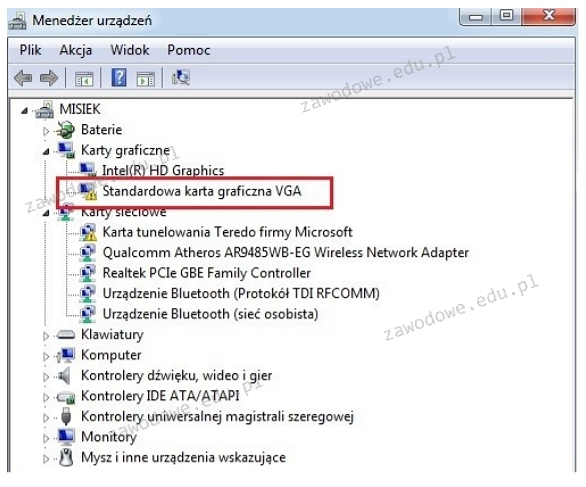

Na ilustracji ukazana jest karta

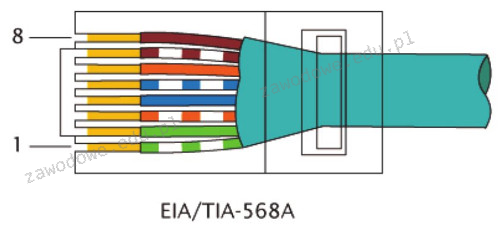

W standardzie Ethernet 100BaseTX do przesyłania danych używane są żyły kabla UTP podłączone do pinów

Organizacja zajmująca się normalizacją na świecie, która stworzyła 7-warstwowy Model Referencyjny Otwartej Architektury Systemowej, to

Osoba korzystająca z lokalnej sieci musi mieć możliwość dostępu do dokumentów umieszczonych na serwerze. W tym celu powinna

Przed przystąpieniem do modernizacji komputerów osobistych oraz serwerów, polegającej na dodaniu nowych modułów pamięci RAM, konieczne jest sprawdzenie

Która z usług odnosi się do centralnego zarządzania tożsamościami, uprawnieniami oraz obiektami w sieci?

Jakie urządzenie zapewnia zabezpieczenie przed różnorodnymi atakami z sieci i może również realizować dodatkowe funkcje, takie jak szyfrowanie danych przesyłanych lub automatyczne informowanie administratora o włamaniu?

Na którym standardowym porcie funkcjonuje serwer WWW wykorzystujący domyślny protokół HTTPS w typowym ustawieniu?

Jakie urządzenie powinno być użyte w sieci Ethernet, aby zredukować liczbę kolizji pakietów?

Jakim protokołem łączności, który gwarantuje pewne dostarczenie informacji, jest protokół

Technika określana jako rytownictwo dotyczy zasady funkcjonowania plotera

Który typ rekordu w bazie DNS (Domain Name System) umożliwia ustalenie aliasu dla rekordu A?

Jaką normę odnosi się do okablowania strukturalnego?

Elementem, który jest odpowiedzialny za utrwalanie tonera na kartce podczas drukowania z drukarki laserowej, jest

Jakiego portu używa protokół FTP (File transfer Protocol)?

Topologia fizyczna, w której wszystkie urządzenia końcowe są bezpośrednio połączone z jednym punktem centralnym, takim jak koncentrator lub switch, to topologia

Jakie ustawienia dotyczące protokołu TCP/IP zostały zastosowane dla karty sieciowej, na podstawie rezultatu uruchomienia polecenia IPCONFIG /ALL w systemie Windows?

Karta bezprzewodowej sieci LAN Połączenie sieci bezprzewodowej:

Sufiks DNS konkretnego połączenia :

Opis. . . . . . . . . . . . . . . : Atheros AR5006EG Wireless Network Adapter

Adres fizyczny. . . . . . . . . . : 00-15-AF-35-65-98

DHCP włączone . . . . . . . . . . : Tak

Autokonfiguracja włączona . . . . : Tak

Adres IPv6 połączenia lokalnego . : fe80::8c5e:5e80:f376:fbax9(Preferowane)

Adres IPv4. . . . . . . . . . . . : 192.168.1.102(Preferowane)

Maska podsieci. . . . . . . . . . : 255.255.255.0

Dzierżawa uzyskana. . . . . . . . : 16 lutego 2009 16:51:02

Dzierżawa wygasa. . . . . . . . . : 17 lutego 2009 16:51:01

Brama domyślna. . . . . . . . . . : 192.168.1.1

Serwer DHCP . . . . . . . . . . . : 192.168.1.1

Serwery DNS . . . . . . . . . . . : 194.204.159.1

194.204.152.34

NetBIOS przez Tcpip. . . . . . . : WłączonyNajbardziej nieinwazyjnym, a zarazem efektywnym sposobem naprawy komputera zainfekowanego wirusem typu rootkit jest

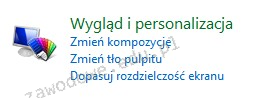

Na ilustracji ukazano narzędzie systemu Windows 7 służące do

Po przeprowadzeniu diagnostyki komputerowej ustalono, że temperatura pracy karty graficznej z wyjściami HDMI oraz D-SUB, zainstalowanej w gnieździe PCI Express komputera stacjonarnego, wynosi 87°C. W związku z tym, serwisant powinien

W systemie Windows, po wydaniu komendy systeminfo, nie da się uzyskać danych o

Cechą oprogramowania służącego do monitorowania zdarzeń metodą Out-Of-Band w urządzeniach sieciowych jest

Do ilu sieci należą komputery o adresach IP i maskach sieci przedstawionych w tabeli?

| Adres IPv4 | Maska |

|---|---|

| 10.120.16.10 | 255.255.0.0 |

| 10.120.18.16 | 255.255.0.0 |

| 10.110.16.18 | 255.255.255.0 |

| 10.110.16.14 | 255.255.255.0 |

| 10.130.16.12 | 255.255.255.0 |

O ile zwiększy się liczba dostępnych adresów IP w podsieci po zmianie maski z 255.255.255.240 (/28) na 255.255.255.224 (/27)?

Ikona błyskawicy widoczna na ilustracji służy do identyfikacji złącza

Równoległy interfejs, w którym magistrala składa się z 8 linii danych, 4 linii sterujących oraz 5 linii statusowych, nie zawiera linii zasilających i umożliwia transmisję na odległość do 5 metrów, pod warunkiem, że przewody sygnałowe są skręcane z przewodami masy; w przeciwnym razie limit wynosi 2 metry, nazywa się

Najefektywniejszym sposobem dodania skrótu do aplikacji na pulpitach wszystkich użytkowników w domenie będzie

Jak nazywa się protokół warstwy transportowej modelu TCP/IP, który nie gwarantuje dostarczenia danych?

W podejściu archiwizacji danych określanym jako Dziadek – Ojciec – Syn na poziomie Dziadek wykonuje się kopię danych na koniec

Na płycie głównej uszkodzona została zintegrowana karta sieciowa. Komputer nie ma możliwości uruchomienia systemu operacyjnego, ponieważ brakuje dysku twardego oraz napędów optycznych, a system operacyjny uruchamia się z lokalnej sieci. W celu odzyskania utraconej funkcjonalności należy zainstalować w komputerze

Po zauważeniu przypadkowego skasowania istotnych danych na dysku, najlepszym sposobem na odzyskanie usuniętych plików jest

Połączenia typu point-to-point, realizowane za pośrednictwem publicznej infrastruktury telekomunikacyjnej, oznacza się skrótem

Na ilustracji ukazany jest komunikat systemowy. Jakie kroki powinien podjąć użytkownik, aby naprawić błąd?

Na wyświetlaczu drukarki pojawił się komunikat „PAPER JAM”. Aby usunąć usterkę, należy w pierwszej kolejności

Jakie są zakresy częstotliwości oraz maksymalne prędkości przesyłu danych w standardzie 802.11g WiFi?

Najłatwiej zidentyfikować błędy systemu operacyjnego Windows wynikające z konfliktów sprzętowych, takich jak przydzielanie pamięci, przerwań IRQ oraz kanałów DMA, przy użyciu narzędzia

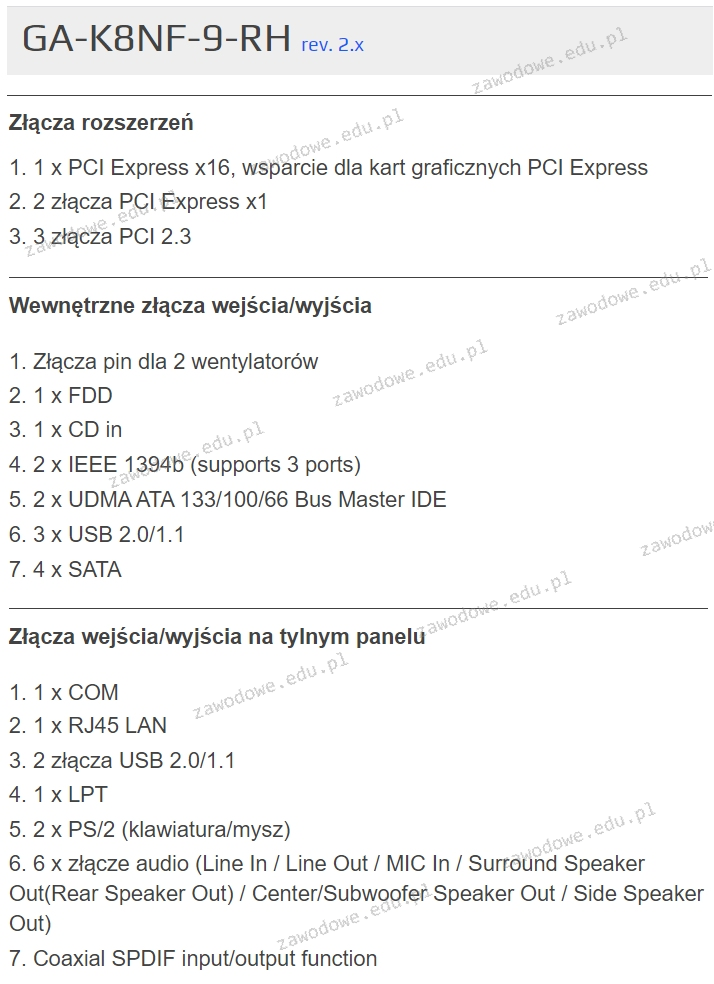

Na ilustracji ukazano fragment dokumentacji technicznej płyty głównej GA-K8NF-9-RH rev. 2.x. Z informacji wynika, że maksymalna liczba kart rozszerzeń, które można zainstalować (pomijając złącza USB), wynosi

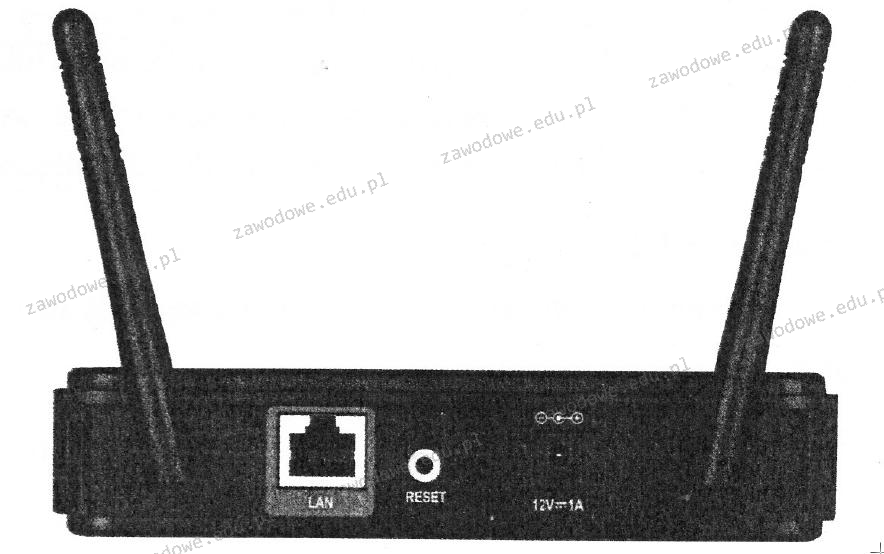

Jakie urządzenie zostało pokazane na ilustracji?