Pytanie 1

Jaką rolę pełni usługa NAT działająca na ruterze?

Wynik: 9/40 punktów (22,5%)

Wymagane minimum: 20 punktów (50%)

Jaką rolę pełni usługa NAT działająca na ruterze?

Na ilustracji zaprezentowano porty, które są częścią karty

Aby przeprowadzić instalację systemu operacyjnego z rodziny Windows na stacjach roboczych, konieczne jest dodanie na serwerze usług

Jaki sterownik drukarki jest uniwersalny dla różnych urządzeń oraz systemów operacyjnych i stanowi standard w branży poligraficznej?

Aby poprawić niezawodność i efektywność przesyłu danych na serwerze, należy

Liczba 5110 w zapisie binarnym wygląda jak

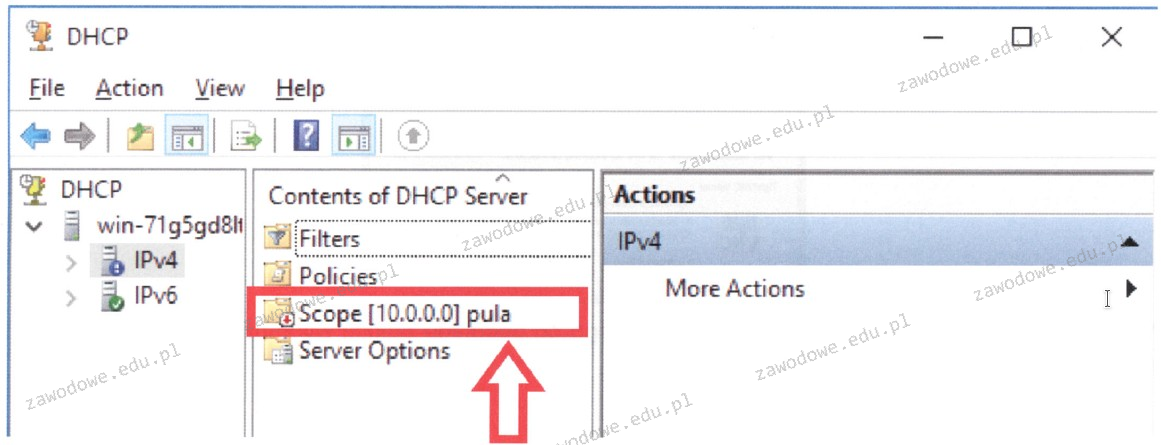

W systemie serwerowym Windows widoczny jest zakres adresów IPv4. Ikona umieszczona obok jego nazwy sugeruje, że

Aby w systemie Windows nadać użytkownikowi możliwość zmiany czasu systemowego, potrzebna jest przystawka

Na wydruku z drukarki laserowej występują jasne i ciemne fragmenty. Jakie działania należy podjąć, by poprawić jakość druku oraz usunąć problemy z nieciągłością?

Jakie urządzenia wykorzystuje się do porównywania liczb w systemie binarnym?

Głowica drukująca, składająca się z wielu dysz zintegrowanych z mechanizmem drukarki, wykorzystywana jest w drukarce

Interfejs, którego magistrala kończy się elementem przedstawionym na ilustracji, jest typowy dla

Podaj właściwe przyporządkowanie usługi z warstwy aplikacji oraz standardowego numeru portu, na którym ta usługa działa?

W specyfikacji głośników komputerowych producent mógł podać informację, że maksymalne pasmo przenoszenia wynosi

W systemie Linux do bieżącego monitorowania aktywnych procesów wykorzystuje się polecenie

Jak wiele urządzeń może być podłączonych do interfejsu IEEE1394?

Który z standardów korzysta z częstotliwości 5 GHz?

Aby stworzyć partycję w systemie Windows, należy skorzystać z narzędzia

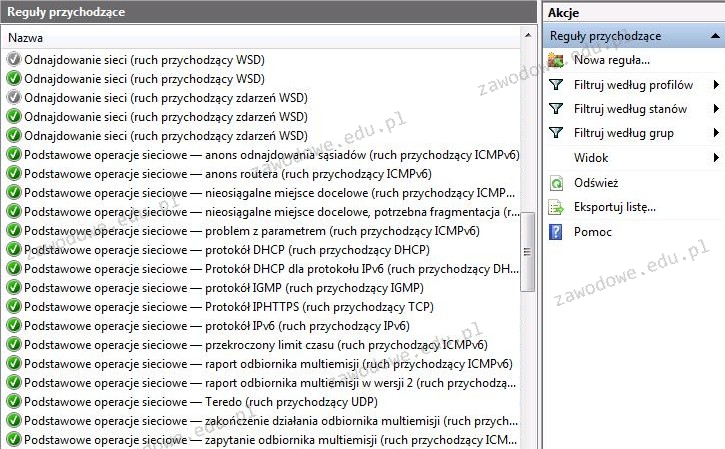

Zrzut ekranu ilustruje aplikację

Jaką maksymalną prędkość transferu danych umożliwia interfejs USB 3.0?

Jaką funkcję pełni punkt dostępowy, aby zabezpieczyć sieć bezprzewodową w taki sposób, aby jedynie urządzenia z wybranymi adresami MAC mogły się do niej łączyć?

W jakiej topologii sieci komputerowej każdy komputer jest połączony z dokładnie dwoma innymi komputerami, bez żadnych dodatkowych urządzeń aktywnych?

W klasycznym adresowaniu, adres IP 74.100.7.8 przynależy do

Usterka zaprezentowana na ilustracji, widoczna na monitorze, nie może być spowodowana przez

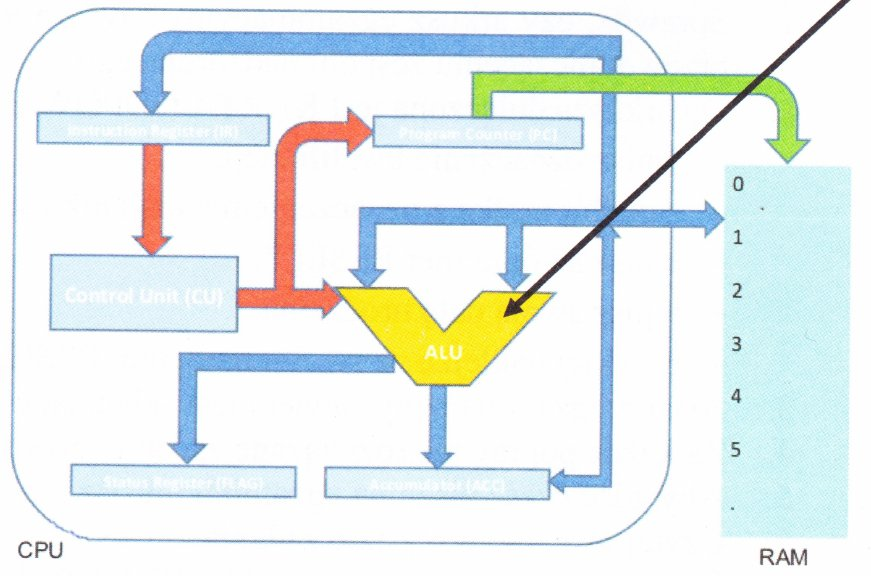

Na diagramie mikroprocesora zidentyfikowany strzałką blok odpowiada za

Który adres IP posiada maskę w postaci pełnej, zgodną z klasą adresu?

Przedstawione narzędzie jest przeznaczone do

Które z urządzeń używanych w sieci komputerowej NIE WPŁYWA na liczbę domen kolizyjnych?

Podaj domyślny port używany do przesyłania poleceń (command) w serwerze FTP

Narzędzie systemu Windows wykorzystywane do interpretacji poleceń, stosujące logikę obiektową oraz cmdlety, to

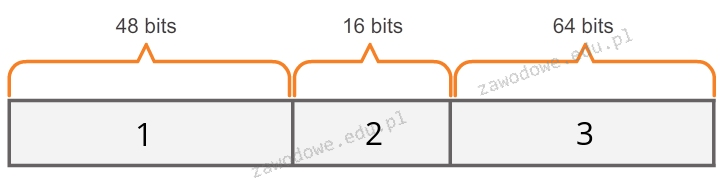

Jaką sekwencję mają elementy adresu globalnego IPv6 typu unicast ukazanym na diagramie?

Jak wiele domen kolizyjnych oraz rozgłoszeniowych można dostrzec na schemacie?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jakie polecenie służy do przeprowadzania aktualizacji systemu operacyjnego Linux korzystającego z baz RPM?

Płyta główna wyposażona w gniazdo G2 będzie współpracowała z procesorem

W architekturze sieci lokalnych opartej na modelu klient - serwer

Jaką topologię fizyczną charakteryzuje zapewnienie nadmiarowych połączeń między urządzeniami sieciowymi?

Ile maksymalnie kanałów z dostępnego pasma kanałów w standardzie 802.11b może być używanych w Polsce?

Analizując ruch w sieci, zauważono, że na adres serwera kierowano tysiące zapytań DNS na sekundę z różnych adresów IP, co doprowadziło do zawieszenia systemu operacyjnego. Przyczyną tego zjawiska był atak typu

Laptopy zazwyczaj są wyposażone w bezprzewodowe sieci LAN. Ograniczenia ich stosowania dotyczą emisji fal radiowych, które mogą zakłócać działanie innych, istotnych dla bezpieczeństwa, urządzeń?