Pytanie 1

Jakie polecenie w systemie operacyjnym Linux umożliwia sprawdzenie bieżącej konfiguracji interfejsu sieciowego na komputerze?

Wynik: 18/40 punktów (45,0%)

Wymagane minimum: 20 punktów (50%)

Jakie polecenie w systemie operacyjnym Linux umożliwia sprawdzenie bieżącej konfiguracji interfejsu sieciowego na komputerze?

Jaką ochronę zapewnia program antyspyware?

Który z poniższych programów nie jest wykorzystywany do zdalnego administrowania komputerami w sieci?

Jakie narzędzie służy do połączenia pigtaila z włóknami światłowodowymi?

Użytkownik pragnie ochronić dane na karcie pamięci przed przypadkowym usunięciem. Taką zabezpieczającą cechę oferuje karta

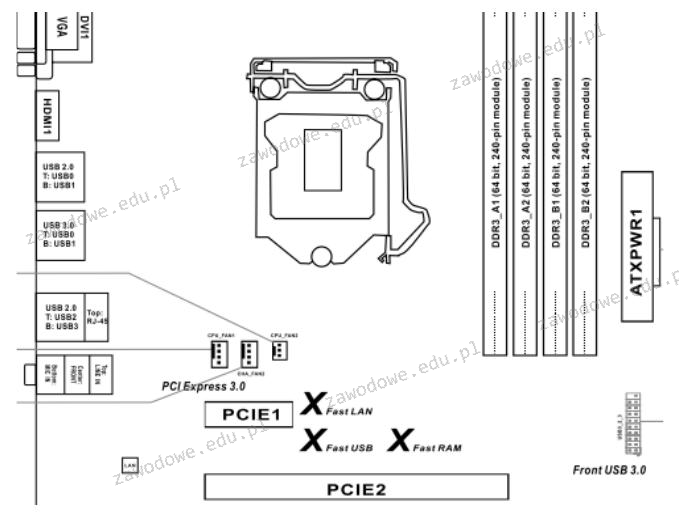

Który procesor jest kompatybilny z płytą główną o przedstawionej specyfikacji?

ASUS micro-ATX, socket 1150, VT-d, DDR3 `1333, 1600 MHz), ATI Radeon X1250, 3 x PCI-Express x1, 3 x PCI-Express x16, 2 x Serial ATA III, USB 3.0, VGA, HDMI, DVI-D

Który z protokołów jest używany w komunikacji głosowej przez internet?

Planując pierwsze uruchomienie i konfigurację rutera, należy w pierwszej kolejności

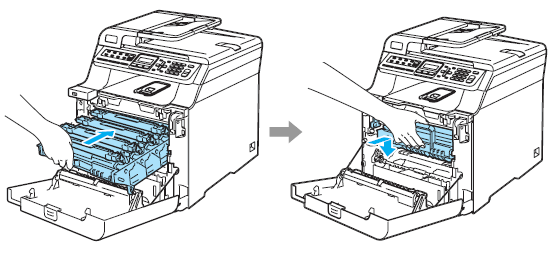

Czynność pokazana na rysunkach ilustruje mocowanie

Na jakich licencjach są dystrybuowane wersje systemu Linux Ubuntu?

Do weryfikacji integralności systemu plików w środowisku Linux trzeba zastosować polecenie

Równoległy interfejs, w którym magistrala składa się z 8 linii danych, 4 linii sterujących oraz 5 linii statusowych, nie zawiera linii zasilających i umożliwia transmisję na odległość do 5 metrów, pod warunkiem, że przewody sygnałowe są skręcane z przewodami masy; w przeciwnym razie limit wynosi 2 metry, nazywa się

GRUB, LILO oraz NTLDR to:

Jakie jest adres rozgłoszeniowy w podsieci o adresie IPv4 192.168.160.0/21?

Najmniejszymi kątami widzenia charakteryzują się matryce monitorów typu

Jaki jest główny cel stosowania maski podsieci?

W celu zrealizowania instalacji sieciowej na stacjach roboczych z systemem operacyjnym Windows, należy na serwerze zainstalować usługi

Dwie stacje robocze w tej samej sieci nie są w stanie się skomunikować. Która z poniższych okoliczności może być przyczyną opisanego problemu?

Przy realizacji projektu dotyczącego sieci LAN wykorzystano medium transmisyjne standardu Ethernet 1000Base-T. Które z poniższych stwierdzeń jest prawdziwe?

Jakiej klasy adresów IPv4 dotyczą adresy, które mają dwa najbardziej znaczące bity ustawione na 10?

Jaką topologię sieci przedstawia rysunek?

Najskuteczniejszym sposobem na wykonanie codziennego archiwizowania pojedynczego pliku o wielkości 4,8 GB, na jednym komputerze bez dostępu do Internetu jest

Urządzenie, które pozwala na połączenie hostów w jednej sieci z hostami w różnych sieciach, to

Sprzęt sieciowy umożliwiający połączenie pięciu komputerów w tej samej sieci, minimalizując ryzyko kolizji pakietów, to

Poprzez użycie polecenia ipconfig /flushdns można przeprowadzić konserwację urządzenia sieciowego, która polega na

Rodzajem złośliwego oprogramowania będącego programem rezydentnym, który działa, wykonując konkretną operację, nie powiela się przez sieć, a jedną z jego metod jest samoreplikacja aż do wyczerpania pamięci komputera, jest

Jakiego typu rozbudowa serwera wymaga zainstalowania dodatkowych sterowników?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Które z poniższych stwierdzeń na temat protokołu DHCP jest poprawne?

Komputer A, który musi wysłać dane do komputera B znajdującego się w sieci z innym adresem IP, najpierw przekazuje pakiety do adresu IP

Rozmiar pliku wynosi 2 KiB. Co to oznacza?

Na wskazanej płycie głównej możliwe jest zainstalowanie procesora w obudowie typu

W terminalu systemu Windows, do zarządzania parametrami konta użytkownika komputera, takimi jak okres ważności hasła, minimalna długość hasła, czas blokady konta i inne, wykorzystywane jest polecenie

Protokół transportowy bezpołączeniowy to

Urządzeniem wejściowym komputera, realizującym z najwyższą precyzją funkcje wskazujące w środowisku graficznym 3D, jest

Aby prawidłowo uzupełnić składnię przedstawionego polecenia, które udostępnia folder 'Dane' pod nazwą 'test', w miejsce kropek należy wpisać odpowiednie słowo:

net ... test=C:\Dane

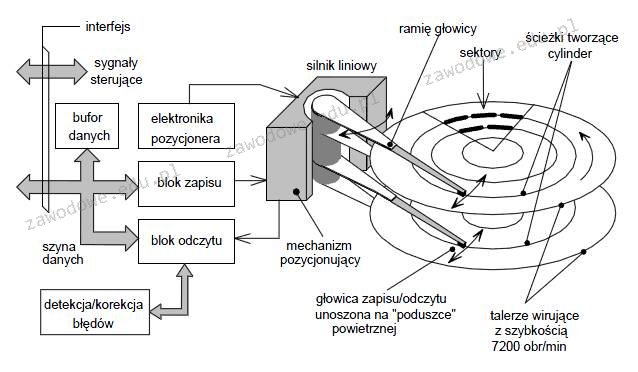

System S.M.A.R.T. jest wykorzystywany do nadzorowania działania oraz identyfikacji usterek

Zasadniczym sposobem zabezpieczenia danych przechowywanych na serwerze jest

Jakie polecenie w systemie Linux rozpoczyna weryfikację dysku oraz pozwala na usunięcie jego usterek?

Schemat blokowy ilustruje