Pytanie 1

Wskaż sygnał, który wskazuje na uszkodzenie karty graficznej w komputerze z BIOS POST od firmy AWARD?

Wynik: 21/40 punktów (52,5%)

Wymagane minimum: 20 punktów (50%)

Wskaż sygnał, który wskazuje na uszkodzenie karty graficznej w komputerze z BIOS POST od firmy AWARD?

Administrator Active Directory w domenie firma.local pragnie skonfigurować profil mobilny dla wszystkich użytkowników. Profil ma być zapisywany na serwerze serwer1, w folderze pliki, udostępnionym w sieci jako dane$. Który z parametrów w ustawieniach profilu użytkownika spełnia te wymagania?

Fast Ethernet to norma sieci przewodowej, która pozwala na przesył danych z maksymalną szybkością

Pliki specjalne urządzeń, tworzone podczas instalacji sterowników w systemie Linux, są zapisywane w katalogu

Dysk twardy IDE wewnętrzny jest zasilany przez połączenie typu

Jakie polecenie umożliwia śledzenie drogi datagramu IP do miejsca docelowego?

Jakie urządzenie jest używane do pomiaru wartości rezystancji?

Na ilustracji widoczny jest

W systemie Windows po wykonaniu polecenia systeminfo nie otrzyma się informacji o

Który z interfejsów stanowi port równoległy?

Termin "PIO Mode" odnosi się do trybu operacyjnego

W biurze rachunkowym znajduje się sześć komputerów w jednym pomieszczeniu, połączonych kablem UTP Cat 5e z koncentratorem. Pracownicy korzystający z tych komputerów muszą mieć możliwość drukowania bardzo dużej ilości dokumentów monochromatycznych (powyżej 5 tys. stron miesięcznie). Aby zminimalizować koszty zakupu i eksploatacji sprzętu, najlepszym wyborem będzie:

Klawiatura w układzie QWERTY, która pozwala na wpisywanie znaków typowych dla języka polskiego, jest znana jako klawiatura

Jakiego protokołu używa się do ściągania wiadomości e-mail z serwera pocztowego na komputer użytkownika?

Jakim standardem posługuje się komunikacja między skanerem a aplikacją graficzną?

Który standard Ethernet określa Gigabit Ethernet dla okablowania UTP?

Po wykonaniu instalacji z domyślnymi parametrami system Windows XP NIE OBSŁUGUJE formatu systemu plików

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Kluczowym mechanizmem zabezpieczającym dane przechowywane na serwerze jest

Analizując ruch w sieci, zauważono, że na adres serwera kierowano tysiące zapytań DNS na sekundę z różnych adresów IP, co doprowadziło do zawieszenia systemu operacyjnego. Przyczyną tego zjawiska był atak typu

Jakie są prędkości przesyłu danych w sieciach FDDI (ang. Fiber Distributed Data Interface) wykorzystujących technologię światłowodową?

Najmniejszymi kątami widzenia charakteryzują się matryce monitorów typu

Technologia opisana w systemach należących do rodziny Windows to

| Jest to technologia obsługująca automatyczną konfigurację komputera PC i wszystkich zainstalowanych w nim urządzeń. Umożliwia ona rozpoczęcie korzystania z nowego urządzenia (na przykład karty dźwiękowej lub modemu) natychmiast po jego zainstalowaniu bez konieczności przeprowadzania ręcznej jego konfiguracji. Technologia ta jest implementowana w warstwach sprzętowej i systemu operacyjnego, a także przy użyciu sterowników urządzeń i BIOS-u. |

Czynnikiem zagrażającym bezpieczeństwu systemu operacyjnego, który zmusza go do automatycznej aktualizacji, są

Wskaż urządzenie, które powinno być użyte do połączenia dwóch komputerów z siecią Internet poprzez lokalną sieć Ethernet, gdy dysponujemy jedynie jednym adresem IP

Jakie znaczenie ma skrót MBR w kontekście technologii komputerowej?

Do efektywnego zrealizowania macierzy RAID 1 wymagane jest minimum

Jaki element sieci SIP określamy jako telefon IP?

Aby zrealizować usługę zdalnego uruchamiania systemów operacyjnych na komputerach stacjonarnych, należy w Windows Server zainstalować rolę

Czym jest kopia różnicowa?

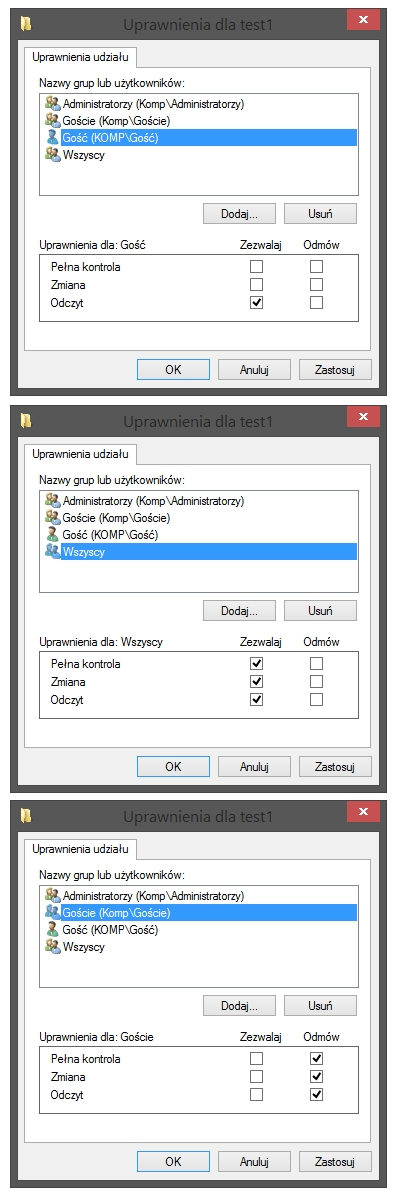

Użytkownik o nazwie Gość jest częścią grupy Goście, która z kolei należy do grupy Wszyscy. Jakie uprawnienia do folderu test1 ma użytkownik Gość?

Narzędzie systemów operacyjnych Windows używane do zmiany ustawień interfejsów sieciowych, na przykład przekształcenie dynamicznej konfiguracji karty sieciowej w konfigurację statyczną, to

Przy użyciu urządzenia zobrazowanego na rysunku możliwe jest sprawdzenie działania

Jakie polecenie w systemie Linux przyzna możliwość zapisu dla wszystkich obiektów w /usr/share dla wszystkich użytkowników, nie modyfikując innych uprawnień?

Poprawność działania lokalnej sieci komputerowej po modernizacji powinna być potwierdzona

Osoba pragnąca jednocześnie drukować dokumenty w wersji oryginalnej oraz trzech kopiach na papierze samokopiującym, powinna nabyć drukarkę

Jakie urządzenie powinno być użyte do połączenia komputerów w układzie gwiazdowym?

W schemacie logicznym okablowania strukturalnego, zgodnie z terminologią polską zawartą w normie PN-EN 50174, cechą kondygnacyjnego punktu dystrybucyjnego jest to, że

W architekturze sieci lokalnych opartej na modelu klient-serwer

Zainstalowanie gniazda typu keystone w serwerowej szafie jest możliwe w