Pytanie 1

Jakie polecenie służy do obserwowania lokalnych połączeń?

Wynik: 18/40 punktów (45,0%)

Wymagane minimum: 20 punktów (50%)

Jakie polecenie służy do obserwowania lokalnych połączeń?

Narzędziem systemu Linux OpenSUSE dedykowanym między innymi do zarządzania systemem jest

Czym jest OTDR?

Jakie są wartości zakresu częstotliwości oraz maksymalnej prędkości przesyłu danych w standardzie 802.11g WiFi?

Aby obserwować przesył danych w sieci komputerowej, należy wykorzystać program typu

Kabel typu skrętka, w którym każda para żył jest umieszczona w oddzielnym ekranie z folii, a wszystkie przewody znajdują się w jednym ekranie, ma oznaczenie

Jaką funkcję pełni protokół ARP (Address Resolution Protocol)?

Jak określamy atak na sieć komputerową, który polega na łapaniu pakietów przesyłanych w sieci?

W wyniku wykonania przedstawionych poleceń systemu Linux interfejs sieciowy eth0 otrzyma:

ifconfig eth0 10.0.0.100 netmask 255.255.255.0 broadcast 10.0.0.255 up route add default gw 10.0.0.10

Oprogramowanie komputerowe, które jest dostępne bezpłatnie i bez ograniczeń czasowych, jest dystrybuowane na podstawie licencji typu

Użytkownicy z grupy Pracownicy nie mają możliwości drukowania dokumentów za pomocą serwera wydruku w systemie Windows Server. Posiadają oni jedynie uprawnienia do „Zarządzania dokumentami”. Jakie kroki należy podjąć, aby naprawić ten problem?

Komputer z adresem IP 192.168.5.165 oraz maską podsieci 255.255.255.192 funkcjonuje w sieci o adresie

Na stabilność obrazu w monitorach CRT istotny wpływ ma

Aby zrealizować usługę zdalnego uruchamiania systemów operacyjnych na komputerach stacjonarnych, należy w Windows Server zainstalować rolę

Z informacji przedstawionych w tabeli wynika, że efektywna częstotliwość pamięci DDR SDRAM wynosi

| 184 styki |

| 64-bitowa szyna danych |

| Pojemność 1024 MB |

| Przepustowość 3200 MB/s |

Który standard Ethernet określa Gigabit Ethernet dla okablowania UTP?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Zamontowany w notebooku trackpoint jest urządzeniem wejściowym reagującym na

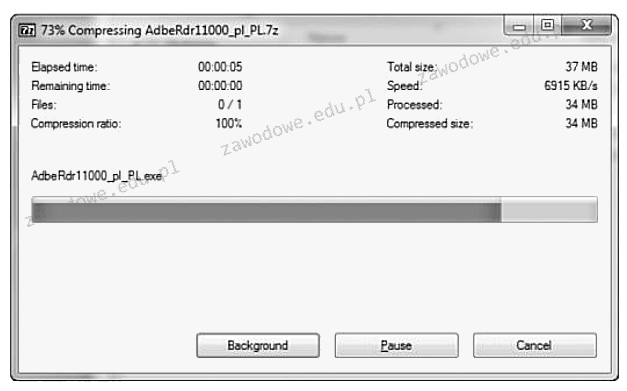

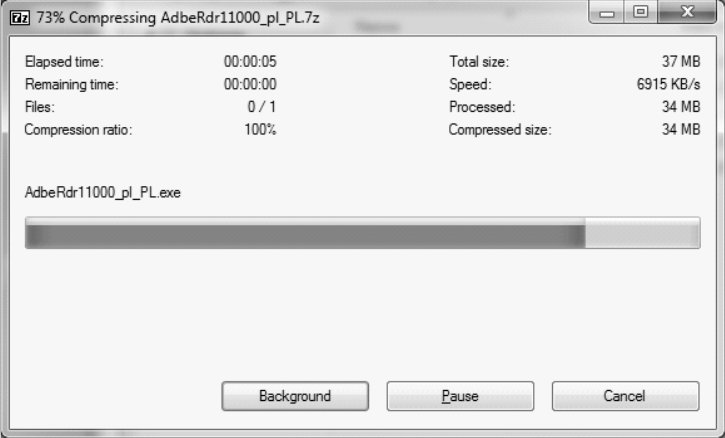

Na dołączonym obrazku ukazano proces

Po wykonaniu podanego polecenia w systemie Windows:

net accounts /MINPWLEN:11liczba 11 zostanie przydzielona dla:

Jaki rodzaj kabla powinien być użyty do połączenia komputera w obszarze podlegającym wpływom zakłóceń elektromagnetycznych?

Po zainstalowaniu systemu Windows 7 zmieniono konfigurację dysku SATA w BIOS-ie komputera z AHCI na IDE. Przy ponownym uruchomieniu komputera system będzie

Urządzenie funkcjonujące w warstwie łącza danych, które umożliwia połączenie segmentów sieci o różnych architekturach, to

Jaką topologię sieci przedstawia rysunek?

Który z protokołów jest wykorzystywany w telefonii VoIP?

Z jaką minimalną efektywną częstotliwością taktowania mogą działać pamięci DDR2?

Zadania systemu operacyjnego nie obejmują

Który interfejs bezprzewodowy, komunikacji krótkiego zasięgu pomiędzy urządzeniami elektronicznymi, korzysta z częstotliwości 2,4 GHz?

Zasilacz UPS o mocy rzeczywistej 480 W nie jest przeznaczony do podłączenia

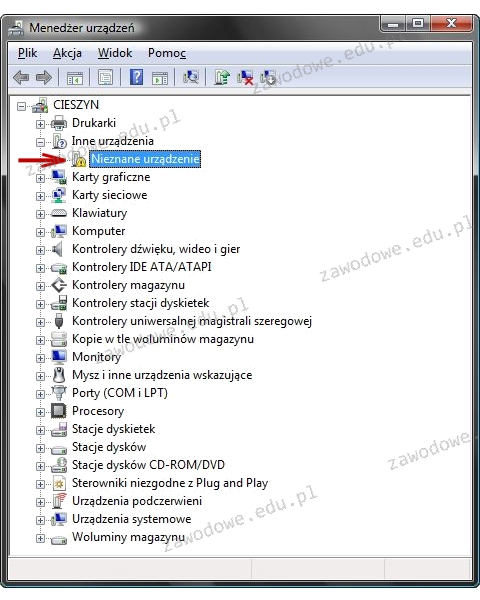

Ikona z wykrzyknikiem, pokazana na ilustracji, która pojawia się obok nazwy sprzętu w Menedżerze urządzeń, wskazuje, że to urządzenie

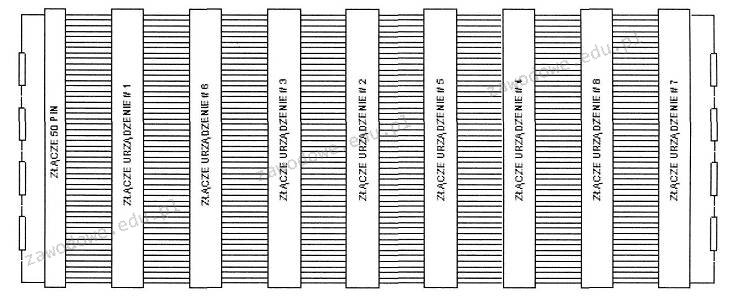

Za pomocą taśmy 60-pinowej pokazanej na ilustracji łączy się z płytą główną komputera

Obecnie pamięci podręczne drugiego poziomu procesora (ang. "L-2 cache") są zbudowane z układów pamięci

Jeśli w określonej przestrzeni będą funkcjonowały równocześnie dwie sieci WLAN w standardzie 802.11g, to aby zredukować ryzyko wzajemnych zakłóceń, należy przypisać im kanały o numerach różniących się o

W drukarce laserowej do utrwalenia wydruku na papierze stosuje się

Wtyk przedstawiony na ilustracji powinien być użyty do zakończenia kabli kategorii

W nowoczesnych panelach dotykowych prawidłowe działanie wyświetlacza zapewnia mechanizm rozpoznający zmianę

Wskaż błędny podział dysku MBR na partycje?

Wskaż tryb operacyjny, w którym komputer wykorzystuje najmniej energii

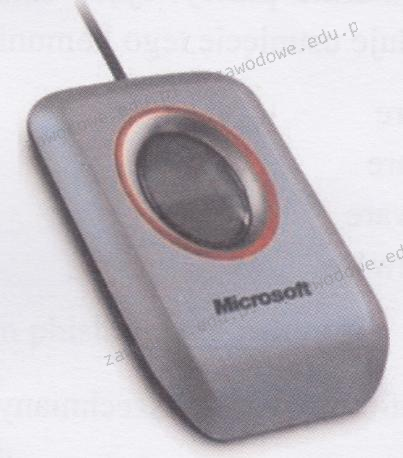

Urządzeniem peryferyjnym pokazanym na ilustracji jest skaner biometryczny, który wykorzystuje do identyfikacji

Na dołączonym obrazku pokazano działanie