Pytanie 1

W systemie Windows zastosowanie zaprezentowanego polecenia spowoduje chwilową modyfikację koloru

Microsoft Windows [Version 10.0.14393] (c) 2016 Microsoft Corporation. Wszelkie prawa zastrzeżone. C:\Users\ak>color 1

Wynik: 21/40 punktów (52,5%)

Wymagane minimum: 20 punktów (50%)

W systemie Windows zastosowanie zaprezentowanego polecenia spowoduje chwilową modyfikację koloru

Microsoft Windows [Version 10.0.14393] (c) 2016 Microsoft Corporation. Wszelkie prawa zastrzeżone. C:\Users\ak>color 1

Zastosowanie której zasady zwiększy bezpieczeństwo podczas korzystania z portali społecznościowych?

Licencja oprogramowania open source oraz wolnego, to rodzaj licencji

Na ilustracji ukazano narzędzie systemu Windows 7 służące do

Aby naprawić uszkodzony sektor rozruchowy dysku w systemie Windows 7, należy użyć polecenia

Natychmiast po dostrzeżeniu utraty istotnych plików na dysku twardym, użytkownik powinien

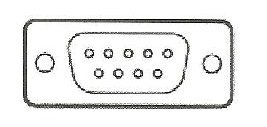

Na ilustracji przedstawiono złącze

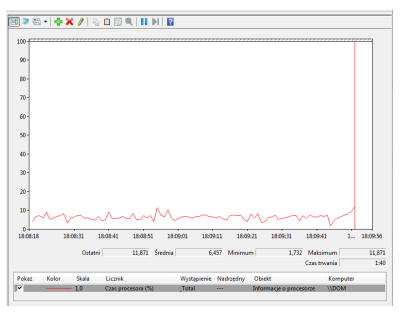

Aby zainicjować w systemie Windows oprogramowanie do monitorowania wydajności komputera przedstawione na ilustracji, należy otworzyć

Wyświetlony stan ekranu terminala został uzyskany podczas testu realizowanego w środowisku Windows. Techniczny pracownik zdobył w ten sposób informacje o:

Określ, jaki jest rezultat wykonania powyższego polecenia.

| netsh advfirewall firewall add rule name="Open" dir=in action=deny protocol=TCP localport=53 |

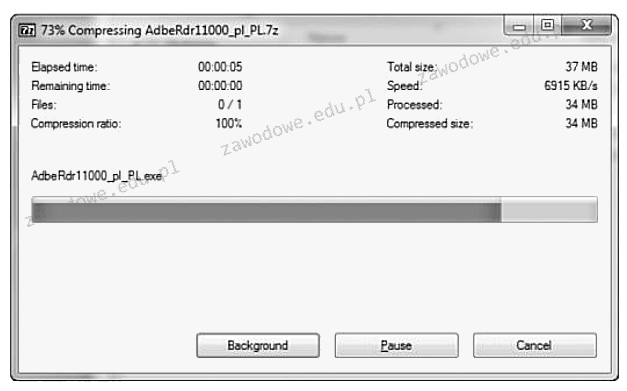

Na dołączonym obrazku pokazano działanie

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Funkcja System Image Recovery dostępna w zaawansowanych opcjach uruchamiania systemu Windows 7 pozwala na

Jakie funkcje realizuje system informatyczny?Kursy informatyczne

W systemie Windows po wykonaniu polecenia systeminfo nie otrzyma się informacji o

W jednostce ALU w akumulatorze zapisano liczbę dziesiętną 500. Jaką ona ma binarną postać?

Najskuteczniejszym sposobem na dodanie skrótu do konkretnego programu na pulpitach wszystkich użytkowników w domenie jest

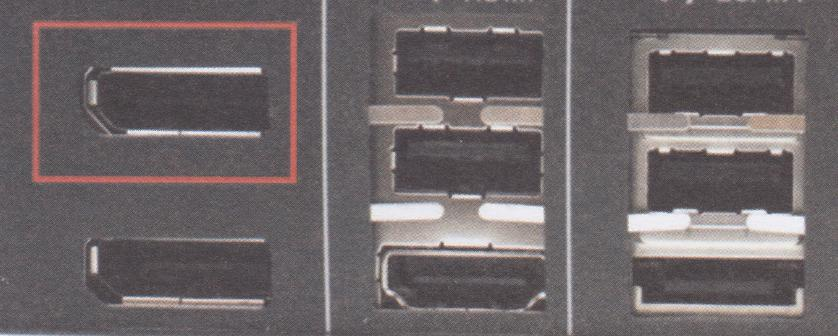

Na ilustracji, złącze monitora zaznaczone czerwoną ramką, będzie kompatybilne z płytą główną, która ma interfejs

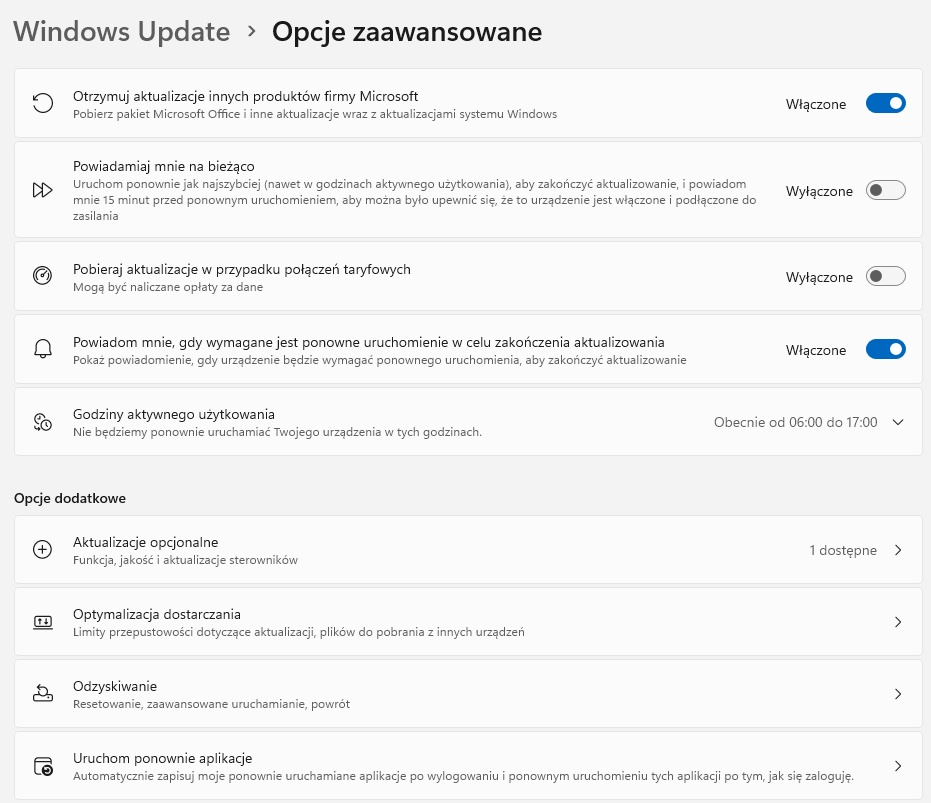

Biorąc pod uwagę konfigurację wykonywaną na ilustracji, administrator po zainstalowaniu systemu operacyjnego uznał za istotne, aby

W warstwie łącza danych modelu odniesienia ISO/OSI możliwą przyczyną błędów działania lokalnej sieci komputerowej jest

Jak wygląda konwencja zapisu ścieżki do udziału w sieci, zgodna z UNC (Universal Naming Convention)?

Administrator systemu Linux wydał polecenie mount /dev/sda2 /mnt/flash . Spowoduje ono

Aby system operacyjny był skutecznie chroniony przed atakami złośliwego oprogramowania, po zainstalowaniu programu antywirusowego należy

Jakie ustawienia dotyczące protokołu TCP/IP zostały zastosowane dla karty sieciowej, na podstawie rezultatu uruchomienia polecenia IPCONFIG /ALL w systemie Windows?

Karta bezprzewodowej sieci LAN Połączenie sieci bezprzewodowej:

Sufiks DNS konkretnego połączenia :

Opis. . . . . . . . . . . . . . . : Atheros AR5006EG Wireless Network Adapter

Adres fizyczny. . . . . . . . . . : 00-15-AF-35-65-98

DHCP włączone . . . . . . . . . . : Tak

Autokonfiguracja włączona . . . . : Tak

Adres IPv6 połączenia lokalnego . : fe80::8c5e:5e80:f376:fbax9(Preferowane)

Adres IPv4. . . . . . . . . . . . : 192.168.1.102(Preferowane)

Maska podsieci. . . . . . . . . . : 255.255.255.0

Dzierżawa uzyskana. . . . . . . . : 16 lutego 2009 16:51:02

Dzierżawa wygasa. . . . . . . . . : 17 lutego 2009 16:51:01

Brama domyślna. . . . . . . . . . : 192.168.1.1

Serwer DHCP . . . . . . . . . . . : 192.168.1.1

Serwery DNS . . . . . . . . . . . : 194.204.159.1

194.204.152.34

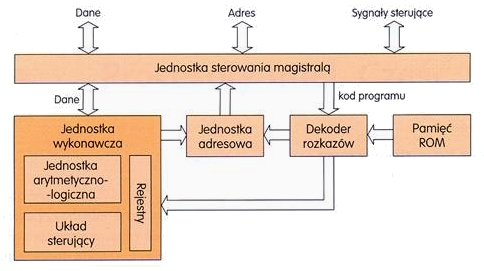

NetBIOS przez Tcpip. . . . . . . : WłączonyNa ilustracji przedstawiony jest schemat konstrukcji logicznej

Przedstawiona na diagramie strategia zapisu kopii zapasowych na nośnikach nosi nazwę

| Day | 1 | 2 | 3 | 4 | 5 | 6 | 7 | 8 | 9 | 10 | 11 | 12 | 13 | 14 | 15 | 16 |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| Media Set | A | A | A | A | A | A | A | A | ||||||||

| B | B | B | B | |||||||||||||

| C | C | C | ||||||||||||||

| E |

Jaki typ routingu jest najbardziej odpowiedni w złożonych, szybko ewoluujących sieciach?

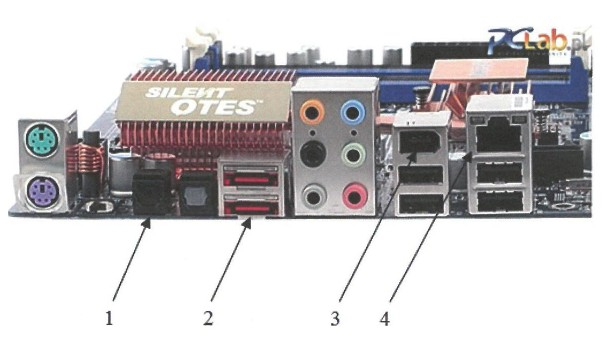

Który z portów na zaprezentowanej płycie głównej umożliwia podłączenie zewnętrznego dysku przez interfejs e-SATA?

Polecenie chmod +x test

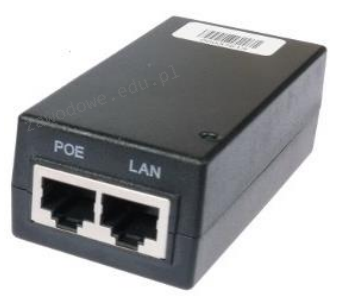

Urządzenie pokazane na ilustracji służy do

Jakim systemem operacyjnym jest system czasu rzeczywistego?

Drukarka została zainstalowana w systemie z rodziny Windows. Aby skonfigurować m.in. domyślną orientację druku, ilość stron na arkusz oraz kolory, w trakcie jej ustawiania należy skorzystać z opcji

Firma zamierza zrealizować budowę lokalnej sieci komputerowej, która będzie zawierać serwer, drukarkę oraz 10 stacji roboczych, które nie mają kart bezprzewodowych. Połączenie z Internetem umożliwia ruter z wbudowanym modemem ADSL oraz czterema portami LAN. Które z poniższych urządzeń sieciowych jest konieczne, aby sieć działała prawidłowo i miała dostęp do Internetu?

Jakie urządzenie powinno się zastosować do przeprowadzenia testu POST dla komponentów płyty głównej?

Narzędzie chroniące przed nieautoryzowanym dostępem do lokalnej sieci, to

Jak nazywa się licencja w systemie Windows Server, która pozwala użytkownikom komputerów stacjonarnych na korzystanie z usług serwera?

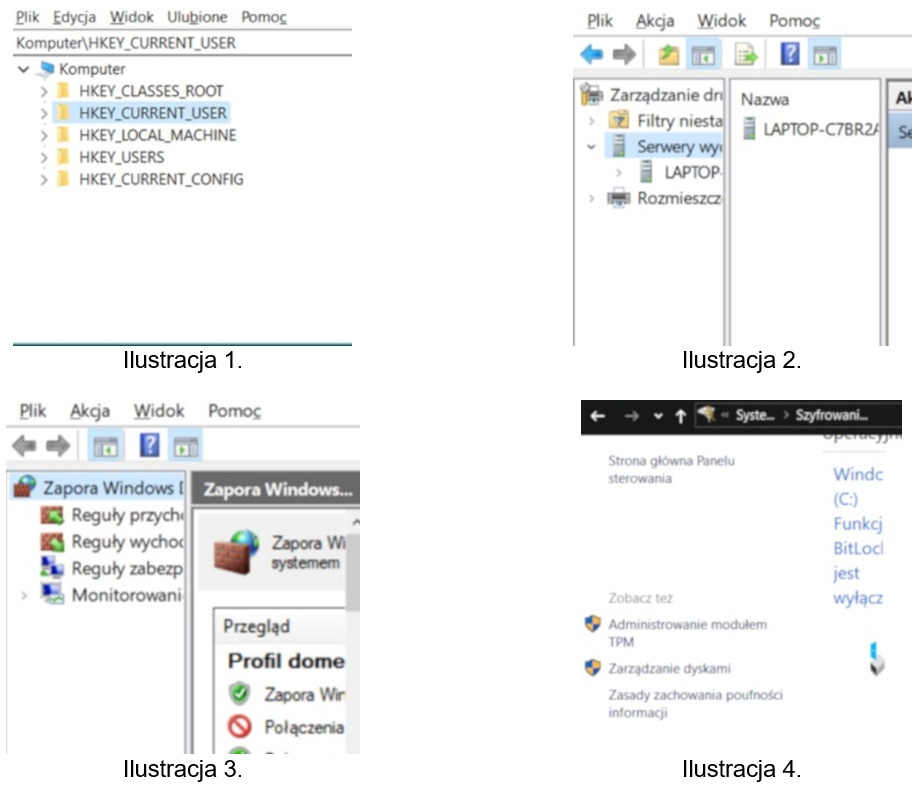

Na której ilustracji przedstawiono Edytor rejestru w systemie Windows?

W systemie Linux plik messages zawiera

Które polecenie pozwala na mapowanie zasobów sieciowych w systemie Windows Serwer?

Aby sprawdzić statystyki użycia pamięci wirtualnej w systemie Linux, należy sprawdzić zawartość pliku