Pytanie 1

Co to jest Event Loop w JavaScript?

Wynik: 36/40 punktów (90,0%)

Wymagane minimum: 20 punktów (50%)

Co to jest Event Loop w JavaScript?

Który z paradygmatów programowania najbardziej akcentuje dziedziczenie oraz polimorfizm?

Który z dokumentów stosowanych w metodologii Agile zawiera listę funkcjonalności produktu uporządkowanych według ich ważności?

Przedstawione w filmie działania wykorzystują narzędzie

Jakie stwierdzenie najlepiej tłumaczy cel podziału programu na funkcje (metody)?

Jaki będzie wynik działania poniższego kodu w języku Python?

def fun(x, l=[]): l.append(x) return l print(fun(1)) print(fun(2)) print(fun(3, [])) print(fun(4))

W jakich sytuacjach zastosowanie rekurencji może być bardziej korzystne niż użycie iteracji?

W jakim modelu Cyklu Życia Projektu Informatycznego znajduje się etap analizy ryzyka?

Teoria wyznaczania celów definiuje właściwie sformułowany cel jako SMART, od pierwszych liter słów: specyficzny, Mierzalny, Ambitny, Realny oraz Terminowy. Wskaź, który cel wymaga wysiłku i stanowi wyzwanie dla pracownika?

Które narzędzie najlepiej nadaje się do analizy wydajności aplikacji JavaScript?

Podana deklaracja zmiennych w języku JAVA zawiera

String imie = "Anna"; short wiek = 12; int i = 0; char plec = 'K'; boolean jestUczniem = true;

Jakie informacje zawiera zestaw instrukcji (ISA) danego procesora?

Klasa Mieszkaniec zawiera atrybuty: imie, nazwisko, ulica, nrDomu, rokUrodzenia. W tej klasie umieszczono opisane poniżej konstruktory (zapisano jedynie typy argumentów). Do tworzenia obiektu za pomocą konstruktora kopiującego wykorzystany będzie konstruktor określony w punkcie

Jakie narzędzie najlepiej wykorzystać do testowania API REST?

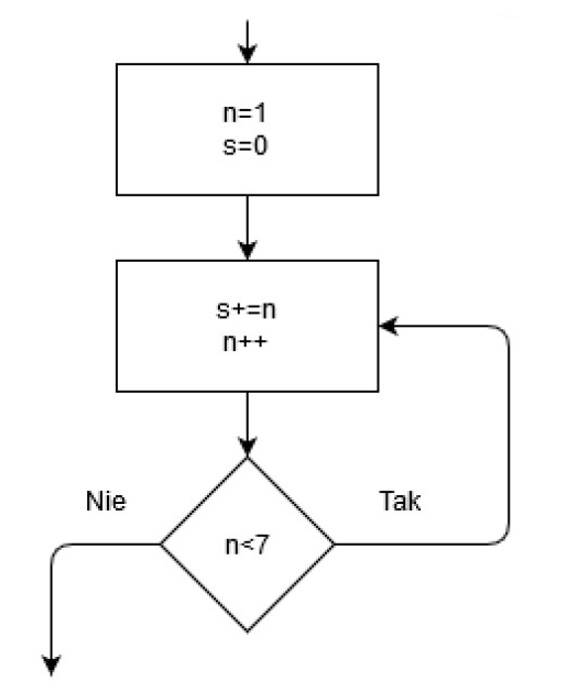

Na schemacie widoczny jest fragment diagramu blokowego pewnego algorytmu. Ile razy zostanie zweryfikowany warunek n<7?

Jakie narzędzie umożliwia testowanie API w aplikacjach internetowych?

Jakie środowisko deweloperskie jest najczęściej używane do programowania w C#?

Który z wymienionych aktów prawnych odnosi się do ochrony danych osobowych w krajach Unii Europejskiej?

Testy mające na celu identyfikację błędów w interfejsach między modułami bądź systemami nazywane są testami

Metoda tworzenia algorytmu polegająca na dzieleniu go na dwa lub więcej mniejszych podproblemów, aż do momentu, gdy ich rozwiązanie stanie się proste, jest techniką

W jakim celu wykorzystuje się diagram Gantta?

Jaka jest składnia komentarza jednoliniowego w języku Python?

Co oznacza pojęcie 'hoisting' w JavaScript?

W zestawieniu przedstawiono doświadczenie zawodowe członków zespołu IT. Osobą odpowiedzialną za stworzenie aplikacji front-end powinna być:

| Pracownik | Znajomość technologii/programów |

|---|---|

| Anna | Inscape, Corel Draw |

| Krzysztof | Angular |

| Patryk | HTML, CSS |

| Ewa | Django, .NET |

Zamieszczony fragment kodu w Android Studio wdraża metodę nasłuchującą dla obsługi zdarzenia:

przycisk = (Button) findViewById(R.id.yes_button); przycisk.setOnClickListener(new View.OnClickListener() { ... });

Co należy do zadań interpretera?

Jakie narzędzie programowe jest odpowiedzialne za konwersję kodu źródłowego na formę zrozumiałą dla maszyny, weryfikuje wszystkie polecenia pod kątem ewentualnych błędów, a następnie generuje moduł do wykonania?

W klasie o nazwie samochod przypisano atrybuty: marka, rocznik, parametry[]. Atrybuty te powinny zostać zdefiniowane jako

Jakie z wymienionych czynności można zrealizować przy pomocy składnika statycznego danej klasy?

Celem mechanizmu obietnic (ang. promises) w języku JavaScript jest

Jakie oznaczenie posiada norma krajowa w Polsce?

Który z komponentów interfejsu użytkownika umożliwia użytkownikowi wprowadzanie danych tekstowych?

Co to jest ORM w kontekście programowania?

W jaki sposób można załadować tylko komponent z biblioteki React?

Co to jest CORS (Cross-Origin Resource Sharing)?

Które z wymienionych działań zwiększa bezpieczeństwo transakcji online?

Który z języków programowania jest powszechnie wykorzystywany do tworzenia aplikacji na komputery stacjonarne?

Dlaczego w wyniku działania tego kodu w języku C++ na ekranie pojawiła się wartość 0 zamiast 50?

int oblicz(int x) { int i = 50; x = x + i; return i; } int main() { int x = 0; int wynik = oblicz(x); std::cout << x; }

Jakie jest fundamentalne zagadnienie w projektowaniu aplikacji w architekturze klient-serwer?

Złośliwe oprogramowanie stworzone w celu przyznania hakerom uprawnień administracyjnych do komputera ofiary bez jej świadomości, to