Pytanie 1

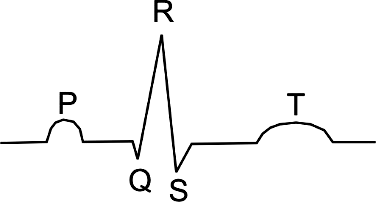

W sygnale elektrokardiograficznym za repolaryzację mięśnia komór odpowiada załamek

Wynik: 37/40 punktów (92,5%)

Wymagane minimum: 20 punktów (50%)

W sygnale elektrokardiograficznym za repolaryzację mięśnia komór odpowiada załamek

Podczas wymiany podzespołów elektronicznych czułych na wyładowania elektrostatyczne należy zastosować

Programowanie obiektowe wykorzystuje dziedziczenie, które polega na

Który sterownik odpowiada za bezpośredni dostęp do pamięci?

Technologia dual channel dotyczy pracy dwóch takich samych

Pierwszym krokiem podczas prac serwisowych wymagających modyfikowania rejestru w systemie Windows jest wykonanie

Do zaktualizowania rekordu tabeli należy zastosować polecenie

Ile elektrod wykorzystuje się podczas wykonywania standardowego badania EKG przy pomocy 12 odprowadzeń?

Jak nazywa się terapia stosowana w przypadku niewydolności nerek, polegająca na oczyszczaniu krwi ze zbędnych składników przemiany materii?

Technika diagnostyki obrazowej polegająca na badaniu struktur serca i dużych naczyń krwionośnych za pomocą ultradźwięków jest określana skrótem

Którą metodę montażu należy zastosować w celu zakończenia przewodu zasilającego końcówkami przedstawionymi na fotografii?

Zapisana w ramce funkcja zawiera

| Funkcja oblicz(n) Jeżeli n=0 oblicz=1 W przeciwnym wypadku oblicz=(n-1)*oblicz(n-1) |

Organizm człowieka ma zakłóconą zdolność do termoregulacji, gdy wartość temperatury wewnętrznej organizmu spada poniżej

Technologie SLI i CrossFire pozwalają na podłączenie dwóch kart

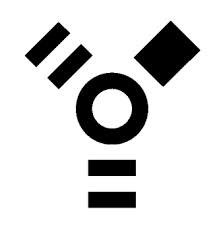

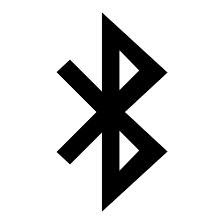

Moduł EKG do badań wysiłkowych został wyposażony w interfejs Bluetooth w celu przesyłania wyników badań. Aby połączyć moduł z stanowiskiem komputerowym, należy wybrać interfejs oznaczony symbolem

Jeżeli procesor graficzny wykonuje także operacje arytmetyczne, oznacza to, że pracuje w architekturze

Pod wpływem bodźca świetlnego, dźwiękowego lub czuciowego mózg generuje elektryczne potencjały wywołane rejestrowane przez

Na rysunku przedstawiono badanie za pomocą

Konserwacja oprogramowania nie obejmuje

Badanie obrazujące fizyczny rozwój płodu wykonywane jest przy użyciu

Jak nazywa się w programowaniu obiektowym instancję klasy?

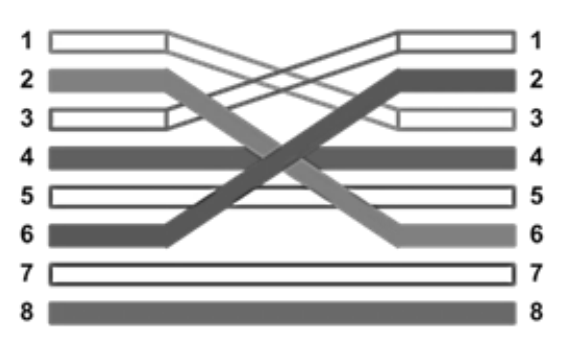

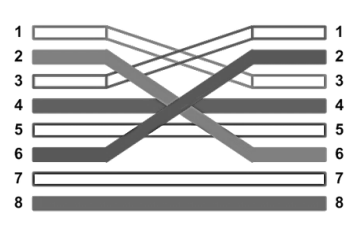

Przedstawiony na rysunku kabel krosowany jest wykorzystany do połączenia

W dokumentacji sieci centralnego monitoringu zapisano, że sieć jest wykonana w standardzie 802.11 Do montażu takiej sieci są wymagane urządzenia wykorzystujące

Procesor GPU jest odpowiedzialny za wykonywanie operacji obliczeniowych w karcie

W programowaniu, aby przerwać wykonywanie pętli i wyjść z niej, należy użyć polecenia

W dokumentacji Medycznego Systemu Informatycznego zapisano, że „przed użyciem programów instalacyjnych należy się upewnić, że niektóre porty w środowisku są dostępne do użycia z instalowanym oprogramowaniem pośrednim.” W celu sprawdzenia dostępności portu należy użyć programu narzędziowego

Rysunek przedstawia raport sprawdzający połączenie pomiędzy stacjami monitorującymi informatycznego systemu medycznego. Którego polecenia należy użyć aby go uzyskać?

Jaki wpływ na organizm ludzki ma krioterapia?

W opisanym programie zostaną wykonane 4

for (i=0;i<=3;i++) suma=suma+i; |

Materiałem eksploatacyjnym w drukarce laserowej jest

Urządzenie, które w specyfikacji technicznej posiada zapis: „Urządzenie współpracuje z komputerem klasy PC poprzez złącze USB”, należy podłączyć do złącza oznaczonego piktogramem

Wynikiem działania funkcji F(n) będzie

funkcja F(n) jeżeli n>1 F(n)=3*F(n-1) w przeciwnym wypadku F(n)=3 |

Płyta jednostronna dwuwarstwowa DVD pozwala na przechowanie danych o pojemności około

Który interfejs nie umożliwia podłączenia urządzeń peryferyjnych w standardzie „plug and play”?

Podstawowym elementem sztucznej nerki jest pompa do przetłaczania krwi, zwana

Pod wpływem zwiększenia natężenia promieniowania widzialnego (bodźca świetlnego) źrenica zdrowego oka ludzkiego

Którego nośnika pamięci należy użyć w komputerze, aby zapewnić najszybsze ładowanie się systemu operacyjnego podczas jego uruchamiania?

Kabel krosowany jest wykorzystany do połączenia

W tabeli przedstawiono fragment dokumentacji testera

| Zakres | ±500 mm Hg 20 °C |

| Dokładność | ±1% odczytu + 0.5 mm Hg) |

| Zakres | 80, 94 bpm (synch. z EKG) |

| Dokładność sygnału | ±1% |

| Inwazyjne: | |

| Statyczne ciśnienie | -10, -5, 0, 20, 40, 50, 60, 80, 100, 150, 160, 200, 240, 250, 300, 320, 400 mm Hg |

| Dokładność | ±(1% zakresu ±1mm Hg) or ±(2% nastawy + 2mm Hg) |

| Impedancja | 300 Ohm (±10% dokładności) |

| Czułość | 5 do 40 μV/V/mm Hg |

Który aparat, za pomocą poleceń głosowych i wizualnych, prowadzi ratownika przez procedurę bezpiecznej defibrylacji w zatrzymaniu krążenia?