Pytanie 1

Jak nazywa się system, który pozwala na konwersję nazwy komputera na adres IP w danej sieci?

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

Jak nazywa się system, który pozwala na konwersję nazwy komputera na adres IP w danej sieci?

Regulacje dotyczące konstrukcji systemu okablowania strukturalnego, parametry kabli oraz procedury testowania obowiązujące w Polsce są opisane w normach

Jaki adres IP został przypisany do hosta na interfejsie sieciowym eth0?

[root@ipv6 tspc]# ifconfig

eth0 Link encap:Ethernet HWaddr 00:A0:C9:89:02:F8

inet addr:128.171.104.26 Bcast:128.171.104.255 Mask:255.255.255.0

inet6 addr: fe80::2a0:c9ff:fe89:2f8/10 Scope:Link

UP BROADCAST RUNNING MULTICAST MTU:1500 Metric:1

RX packets:663940 errors:0 dropped:0 overruns:0 frame:0

TX packets:67717 errors:0 dropped:0 overruns:0 carrier:0

collisions:7797 txqueuelen:100

RX bytes:234400485 (223.5 Mb) TX bytes:17743338 (16.9 Mb)

Interrupt:10 Base address:0xef80

lo Link encap:Local Loopback

inet addr:127.0.0.1 Mask:255.0.0.0

inet6 addr: ::1/128 Scope:Host

UP LOOPBACK RUNNING MTU:16436 Metric:1

RX packets:3070 errors:0 dropped:0 overruns:0 frame:0

TX packets:3070 errors:0 dropped:0 overruns:0 carrier:0

collisions:0 txqueuelen:0

RX bytes:153813 (150.2 Kb) TX bytes:153813 (150.2 Kb)

sit1 Link encap:IPv6-in-IPv4

inet6 addr: 3ffe:b80:2:482::2/64 Scope:Global

inet6 addr: fe80::80ab:681a/10 Scope:Link

UP POINTOPOINT RUNNING NOARP MTU:1480 Metric:1

RX packets:82 errors:0 dropped:0 overruns:0 frame:0

TX packets:78 errors:0 dropped:0 overruns:0 carrier:0

collisions:0 txqueuelen:0

RX bytes:8921 (8.7 Kb) TX bytes:8607 (8.4 Kb)Kable światłowodowe nie są powszechnie używane w lokalnych sieciach komputerowych z powodu

Urządzeniem, które chroni przed różnorodnymi atakami sieciowymi oraz może wykonywać dodatkowe zadania, takie jak szyfrowanie przesyłanych informacji lub automatyczne informowanie administratora o próbie włamania, jest

Aby podłączyć kabel w module Keystone, jakie narzędzie należy zastosować?

Jakie jest zastosowanie maty antystatycznej oraz opaski podczas instalacji komponentu?

Która z wymienionych technologii pamięci RAM wykorzystuje oba zbocza sygnału zegarowego do przesyłania danych?

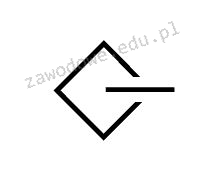

Zapisany symbol dotyczy urządzeń

Wskaż standard protokołu wykorzystywanego do kablowego połączenia dwóch urządzeń

Ile par kabli w standardzie 100Base-TX jest używanych do transmisji danych w obie strony?

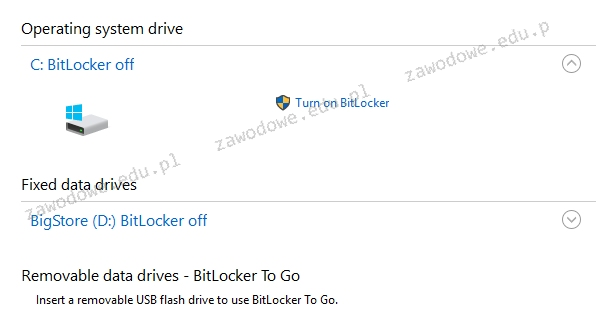

Prezentowane wbudowane narzędzie systemów Windows w wersji Enterprise lub Ultimate jest przeznaczone do

Które z zaleceń jest nieodpowiednie dla konserwacji skanera płaskiego?

Na ilustracji przedstawiony jest tylny panel jednostki komputerowej. Jakie jest nazewnictwo dla złącza oznaczonego strzałką?

Grupa, w której uprawnienia przypisane członkom mogą dotyczyć tylko tej samej domeny, co nadrzędna grupa lokalna domeny, to grupa

Gniazdo LGA umieszczone na płycie głównej komputera stacjonarnego pozwala na zamontowanie procesora

Jakie parametry otrzyma interfejs sieciowy eth0 po wykonaniu poniższych poleceń w systemie Linux?

Na komputerze, na którym zainstalowane są dwa systemy – Windows i Linux, po przeprowadzeniu reinstalacji systemu Windows drugi system przestaje się uruchamiać. Aby ponownie umożliwić uruchamianie systemu Linux oraz aby zachować wszystkie dane i ustawienia w nim zawarte, co należy zrobić?

Na ilustracji zobrazowano okno ustawień rutera. Wprowadzone parametry sugerują, że

Jaki akronim odnosi się do przepustowości sieci oraz usług, które mają między innymi na celu nadawanie priorytetów przesyłanym pakietom?

Który z wymienionych adresów należy do klasy C?

Wskaż błędny podział dysku MBR na partycje?

Interfejs równoległy, który ma magistralę złożoną z 8 linii danych, 4 linii sterujących oraz 5 linii statusowych, nie zawiera linii zasilających i umożliwia transmisję na dystans do 5 metrów, gdy kable sygnałowe są skręcone z przewodami masy, a w przeciwnym razie na dystans do 2 metrów, jest określany mianem

Ile elektronów jest zgromadzonych w matrycy LCD?

Jakie informacje można uzyskać na temat konstrukcji skrętki S/FTP?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Główną metodą ochrony sieci komputerowej przed zewnętrznymi atakami jest wykorzystanie

Aby oczyścić zablokowane dysze kartridża drukarki atramentowej, co należy zrobić?

Które urządzenie należy zainstalować, w celu zwiększenia obszaru zasięgu sieci bezprzewodowej?

Jakiego typu kopię zapasową należy wykonać, aby zarchiwizować wszystkie informacje, niezależnie od daty ich ostatniej archiwizacji?

Aby wyświetlić listę wszystkich zainstalowanych urządzeń w systemie Windows lub zmienić ich właściwości, należy skorzystać z narzędzia

W tabeli przedstawiono dane katalogowe procesora AMD Athlon 1333 Model 4 Thunderbird. Jaka jest częstotliwość przesyłania danych między rejestrami?

| General information | |

|---|---|

| Type | CPU / Microprocessor |

| Market segment | Desktop |

| Family | AMD Athlon |

| CPU part number | A1333AMS3C |

| Stepping codes | AYHJA AYHJAR |

| Frequency (MHz) | 1333 |

| Bus speed (MHz) | 266 |

| Clock multiplier | 10 |

| Gniazdo | Socket A (Socket 462) |

| Notes on AMD A1333AMS3C | |

| ○ Actual bus frequency is 133 MHz. Because the processor uses Double Data Rate bus the effective bus speed is 266 MHz. | |

Program o nazwie dd, którego przykład zastosowania przedstawiono w systemie Linux, umożliwia

Przed rozpoczęciem instalacji sterownika dla urządzenia peryferyjnego system Windows powinien weryfikować, czy dany sterownik ma podpis

Jaki procesor powinien być zastosowany podczas składania komputera stacjonarnego opartego na płycie głównej Asus M5A78L-M/USB3 AMD760G socket AM3+?

Najwyższą prędkość przesyłania danych w sieci bezprzewodowej można osiągnąć używając urządzeń o standardzie

Jaką maksymalną prędkość danych można osiągnąć w sieci korzystającej z skrętki kategorii 5e?

Jakie protokoły przesyłają cykliczne kopie tablic routingu do sąsiadującego rutera i NIE ZAWIERAJĄ pełnych informacji o dalekich ruterach?

Jaka usługa musi być aktywna na serwerze, aby stacja robocza mogła automatycznie otrzymywać adres IP?

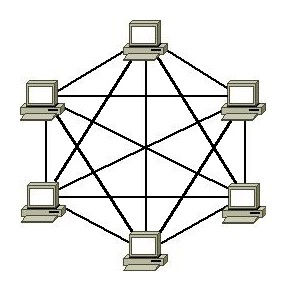

Jakiego rodzaju fizyczna topologia sieci komputerowej jest zobrazowana na rysunku?