Pytanie 1

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

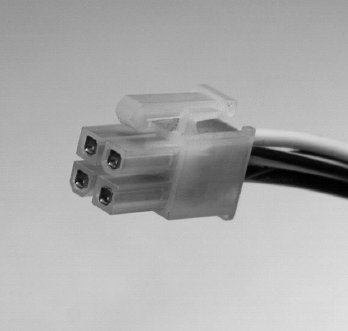

Wtyczka zaprezentowana na fotografie stanowi element obwodu elektrycznego zasilającego

Jaki rodzaj portu może być wykorzystany do podłączenia zewnętrznego dysku do laptopa?

Interfejs SLI (ang. Scalable Link Interface) jest używany do łączenia

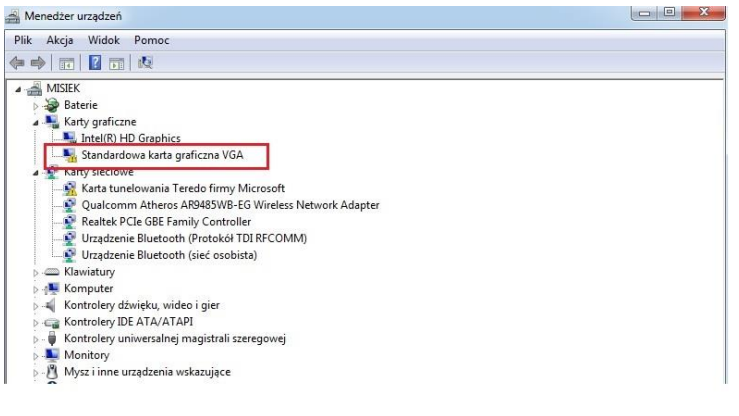

Jakie kroki powinien podjąć użytkownik, aby wyeliminować błąd zaznaczony na rysunku ramką?

Transmisja w standardzie 100Base-T korzysta z kabli skrętkowych, które mają

Która funkcja przełącznika zarządzalnego umożliwia kontrolę przepustowości każdego z wbudowanych portów?

Najłatwiej zidentyfikować błędy systemu operacyjnego Windows wynikające z konfliktów sprzętowych, takich jak przydzielanie pamięci, przerwań IRQ oraz kanałów DMA, przy użyciu narzędzia

Wskaż symbol umieszczany na urządzeniach elektrycznych, które są przeznaczone do obrotu i sprzedaży na terenie Unii Europejskiej?

Który z protokołów przesyła datagramy użytkownika BEZ GWARANCJI ich dostarczenia?

Które systemy operacyjne są atakowane przez wirusa MS Blaster?

Jaki protokół stworzony przez IBM służy do udostępniania plików w architekturze klient-serwer oraz do współdzielenia zasobów z sieciami Microsoft w systemach operacyjnych LINUX i UNIX?

Laptopy zazwyczaj są wyposażone w bezprzewodowe sieci LAN. Ograniczenia ich stosowania dotyczą emisji fal radiowych, które mogą zakłócać działanie innych, istotnych dla bezpieczeństwa, urządzeń?

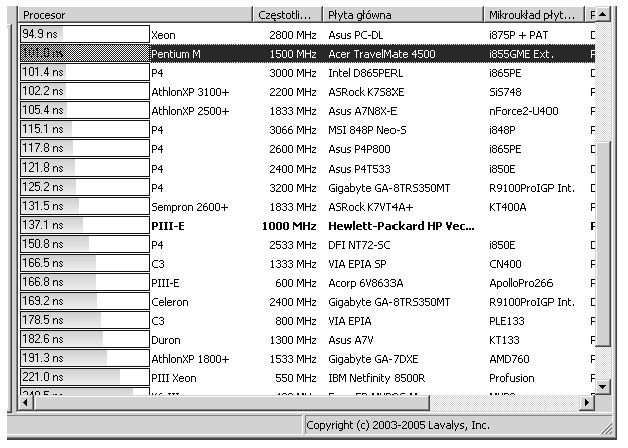

Na ilustracji zaprezentowano zrzut ekranu z wykonanej analizy

Jakie znaczenie ma zaprezentowany symbol graficzny?

Skaner antywirusowy zidentyfikował niechciane oprogramowanie. Z opisu wynika, że jest to dialer, który pozostawiony w systemie

Który z dynamicznych protokołów rutingu został stworzony jako protokół bramy zewnętrznej do łączenia różnych dostawców usług internetowych?

Kluczowym mechanizmem zabezpieczającym dane przechowywane na serwerze jest

Norma PN-EN 50173 rekomenduje montaż przynajmniej

Aby zweryfikować schemat połączeń kabla UTP Cat 5e w sieci lokalnej, należy zastosować

Pracownik serwisu komputerowego podczas wykonywania konserwacji i czyszczenia drukarki laserowej, odłączonej od źródła zasilania, może wykorzystać jako środek ochrony indywidualnej

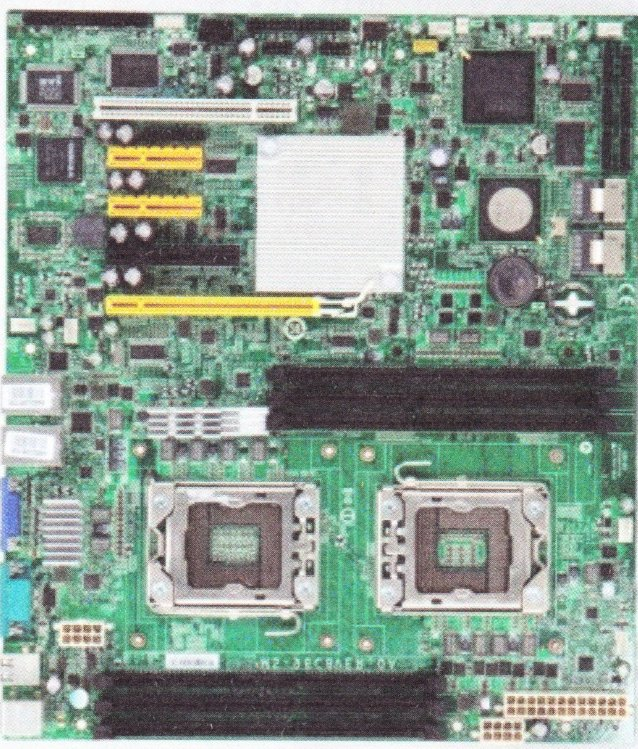

W komputerze użyto płyty głównej widocznej na obrazku. Aby podnieść wydajność obliczeniową maszyny, zaleca się

W systemie Linux, żeby ustawić domyślny katalog domowy dla nowych użytkowników na katalog /users/home/new, konieczne jest użycie polecenia

Użytkownicy sieci Wi-Fi zauważyli zakłócenia oraz częste przerwy w połączeniu. Przyczyną tej sytuacji może być

W ustawieniach haseł w systemie Windows Server została dezaktywowana możliwość wymogu dotyczącego złożoności hasła. Z jakiej minimalnej liczby znaków powinno składać się hasło użytkownika?

Aby zapewnić największe bezpieczeństwo danych przy wykorzystaniu dokładnie 3 dysków, powinny one być zapisywane w macierzy dyskowej

Rodzaj połączenia VPN obsługiwany przez system Windows Server, w którym użytkownicy są uwierzytelniani za pomocą niezabezpieczonych połączeń, a szyfrowanie zaczyna się dopiero po wymianie uwierzytelnień, to

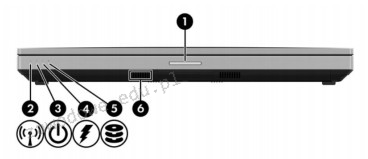

Na ilustracji zaprezentowane jest oznaczenie sygnalizacji świetlnej w dokumentacji technicznej laptopa. Podaj numer kontrolki, która świeci się w czasie ładowania akumulatora?

Jaka usługa sieciowa domyślnie wykorzystuje port 53?

Jak określa się technologię stworzoną przez firmę NVIDIA, która pozwala na łączenie kart graficznych?

Jakie jest tworzywo eksploatacyjne w drukarce laserowej?

Podstawowy rekord uruchamiający na dysku twardym to

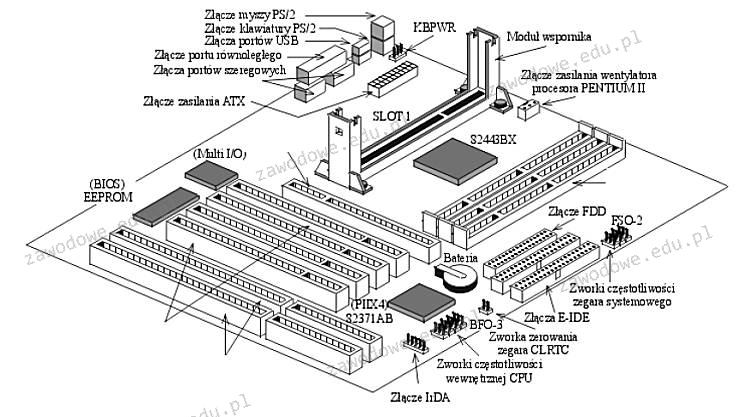

Jakie komponenty są obecne na zaprezentowanej płycie głównej?

Jakie funkcje pełni protokół ARP (Address Resolution Protocol)?

Aby uzyskać listę procesów aktualnie działających w systemie Linux, należy użyć polecenia

Co umożliwia połączenie trunk dwóch przełączników?

Jaką maksymalną długość może mieć kabel miedziany UTP kategorii 5e łączący bezpośrednio dwa urządzenia w sieci, według standardu Fast Ethernet 100Base-TX?

W celu kontrolowania przepustowości sieci, administrator powinien zastosować aplikację typu

Wynikiem dodawania liczb \( 33_{(8)} \) oraz \( 71_{(8)} \) jest liczba

Na dysku obok systemu Windows zainstalowano system Linux Ubuntu. W celu dostosowania kolejności uruchamiania systemów operacyjnych, należy zmienić zawartość