Pytanie 1

Jakie narzędzie w systemie Windows służy do przeglądania informacji dotyczących problemów z systemem?

Wynik: 13/40 punktów (32,5%)

Wymagane minimum: 20 punktów (50%)

Jakie narzędzie w systemie Windows służy do przeglądania informacji dotyczących problemów z systemem?

Jak nazywa się system, który pozwala na konwersję nazwy komputera na adres IP w danej sieci?

Głównym celem realizowanej przez program antywirusowy funkcji ochrony przed ransomware jest zapewnienie zabezpieczenia systemu przed zagrożeniami

Aby przywrócić dane, które zostały usunięte dzięki kombinacji klawiszy Shift+Delete, trzeba

Która operacja może skutkować nieodwracalną utratą danych w przypadku awarii systemu plików?

W systemie Linux plik messages zawiera

W systemie Linux dane dotyczące haseł użytkowników są zapisywane w pliku:

Czym są programy GRUB, LILO, NTLDR?

Który system plików powinien być wybrany podczas instalacji Linuxa, aby umożliwić ustalanie uprawnień dla plików i katalogów?

Aby komputery mogły udostępniać swoje zasoby w sieci, muszą mieć przypisane różne

Jak ustawić w systemie Windows Server 2008 parametry protokołu TCP/IP karty sieciowej, aby komputer mógł jednocześnie funkcjonować w dwóch sieciach lokalnych o różnych adresach IP?

W systemie Windows odpowiednikiem macierzy RAID1 jest wolumin

Podaj polecenie w systemie Windows Server, które umożliwia usunięcie jednostki organizacyjnej z katalogu.

Aby system operacyjny był skutecznie chroniony przed atakami złośliwego oprogramowania, po zainstalowaniu programu antywirusowego należy

Która usługa opracowana przez Microsoft, pozwala na konwersję nazw komputerów na adresy URL?

Aby możliwe było przekierowanie drukowanego dokumentu na dysk twardy, należy w opcjach konfiguracyjnych drukarki wybrać drukowanie do portu

W systemie Linux narzędzie iptables jest wykorzystywane do

Po wydaniu polecenia route skonfigurowano ```route add 192.168.35.0 MASK 255.255.255.0 192.168.0.2```

/dev/sda: Czas odczytu z pamięci podręcznej: 18100 MB w 2.00 sekundy = 9056.95 MB/sek. Przedstawiony wynik wykonania polecenia systemu Linux jest używany do diagnostyki

Aby zrealizować usługę zdalnego uruchamiania systemów operacyjnych na komputerach stacjonarnych, należy w Windows Server zainstalować rolę

Oprogramowanie OEM (Original Equipment Manufacturer) jest związane z

Aby wykonać ręczne ustawienie interfejsu sieciowego w systemie LINUX, należy użyć polecenia

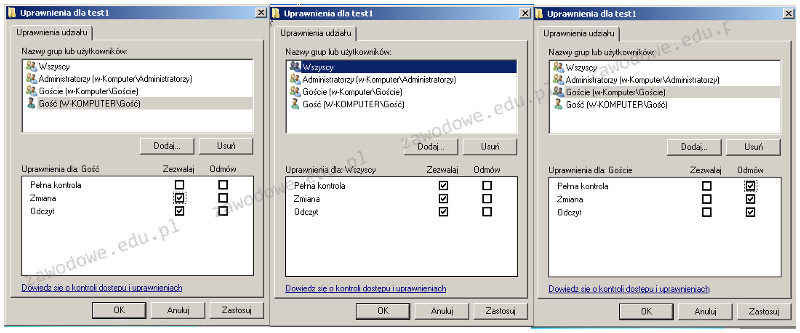

Użytkownik o nazwie Gość należy do grupy o nazwie Goście. Grupa Goście jest częścią grupy Wszyscy. Jakie ma uprawnienia użytkownik Gość w folderze test1?

Jaki sterownik drukarki jest uniwersalny dla różnych urządzeń oraz systemów operacyjnych i stanowi standard w branży poligraficznej?

Wykonanie polecenia perfmon w terminalu systemu Windows spowoduje

Trzech użytkowników komputera z systemem operacyjnym Windows XP Pro posiada swoje foldery z dokumentami w głównym katalogu dysku C:. Na dysku znajduje się system plików NTFS. Użytkownicy mają utworzone konta z ograniczonymi uprawnieniami. Jak można zabezpieczyć folder każdego z użytkowników, aby inni nie mieli możliwości modyfikacji jego zawartości?

W systemie DNS, aby powiązać nazwę hosta z adresem IPv4, konieczne jest stworzenie rekordu

W systemie Linux dane dotyczące okresu ważności hasła są przechowywane w pliku

Jakie polecenie w systemie operacyjnym Linux służy do monitorowania komunikacji pakietów TCP/IP lub protokołów wysyłanych lub odbieranych w sieci komputerowej, do której podłączony jest komputer użytkownika?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jakie polecenie należy wydać, aby skonfigurować statyczny routing do sieci 192.168.10.0?

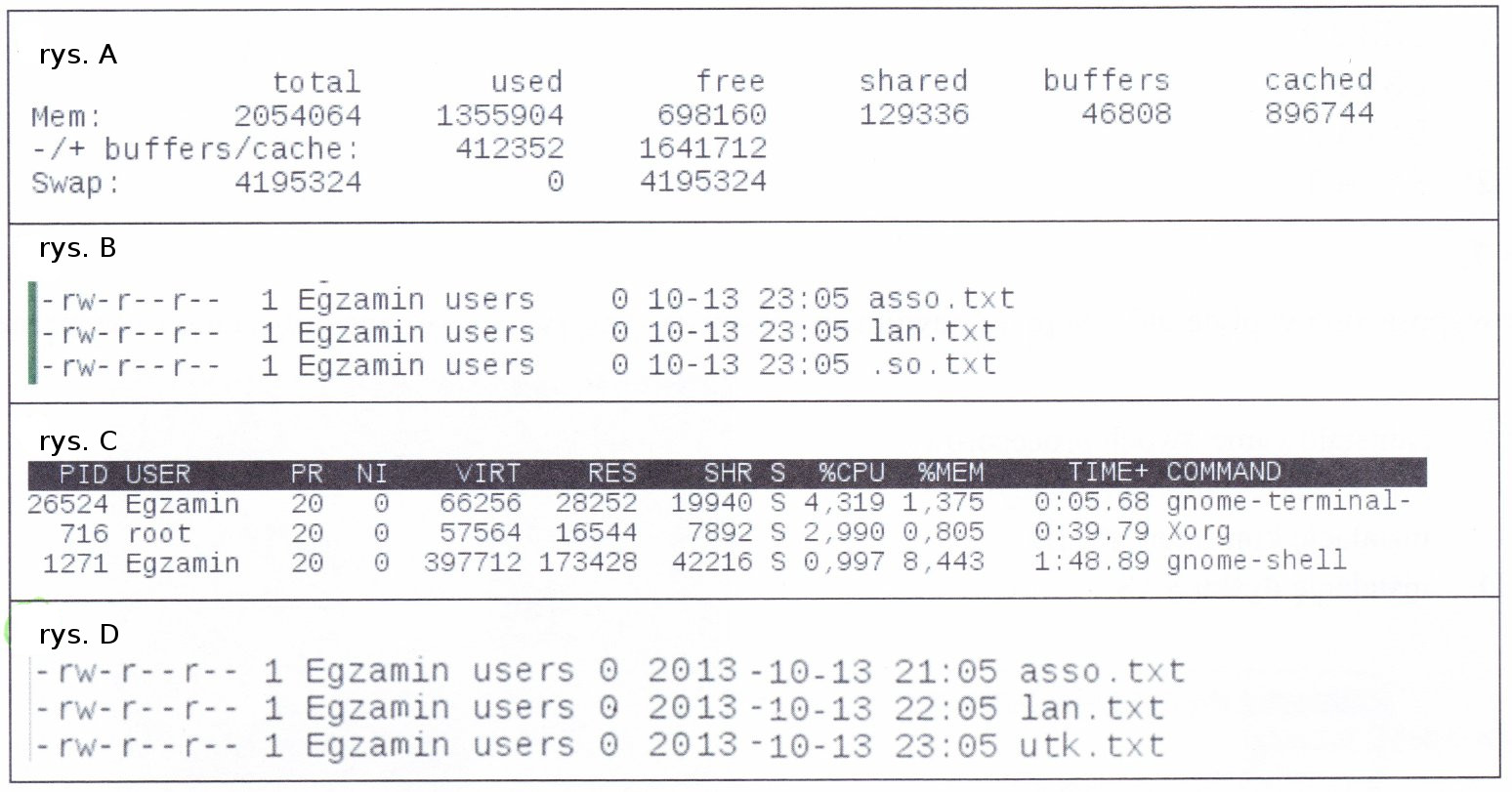

Rezultat wykonania komendy ls -l w systemie Linux ilustruje poniższy rysunek

W systemie Windows przypadkowo zlikwidowano konto użytkownika, lecz katalog domowy pozostał nietknięty. Czy możliwe jest odzyskanie nieszyfrowanych danych z katalogu domowego tego użytkownika?

Aby utworzyć kolejną partycję w systemie Windows, można skorzystać z narzędzia

W wyniku wykonania komendy: net user w terminalu systemu Windows, pojawi się

Który interfejs pozwala na korzystanie ze sterowników oraz oprogramowania systemu operacyjnego, umożliwiając m.in. przesył danych pomiędzy pamięcią systemową a dyskiem SATA?

Aby stworzyć las w strukturze AD DS (Active Directory Domain Services), konieczne jest utworzenie przynajmniej

Jaką minimalną ilość pamięci RAM powinien mieć komputer, aby zainstalować 32-bitowy system operacyjny Windows 7 i móc efektywnie korzystać z trybu graficznego?

Wykonując w konsoli systemu Windows Server komendę convert, co można zrealizować?

Złośliwe programy komputerowe, które potrafią replikować się same i wykorzystują luki w systemie operacyjnym, a także mają zdolność modyfikowania oraz uzupełniania swojej funkcjonalności, nazywamy