Pytanie 1

W jakim miejscu są zapisane dane dotyczące kont użytkowników domenowych w systemach Windows Server?

Wynik: 18/40 punktów (45,0%)

Wymagane minimum: 20 punktów (50%)

W jakim miejscu są zapisane dane dotyczące kont użytkowników domenowych w systemach Windows Server?

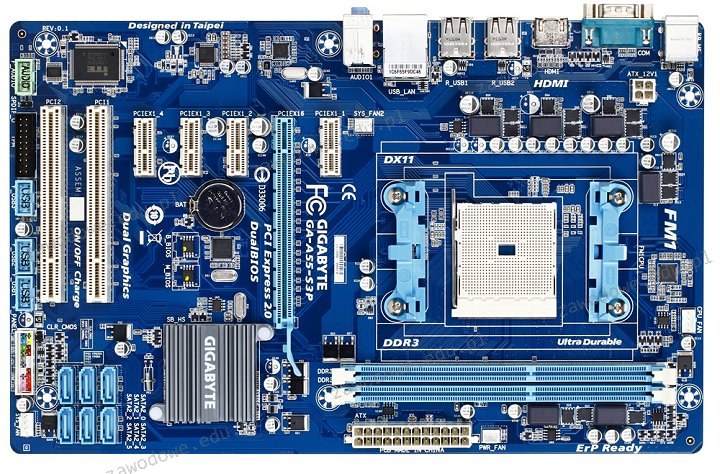

Jakim interfejsem można przesyłać dane między płyta główną, przedstawioną na ilustracji, a urządzeniem zewnętrznym, nie zasilając jednocześnie tego urządzenia przez ten interfejs?

Podaj standard interfejsu wykorzystywanego do przewodowego łączenia dwóch urządzeń.

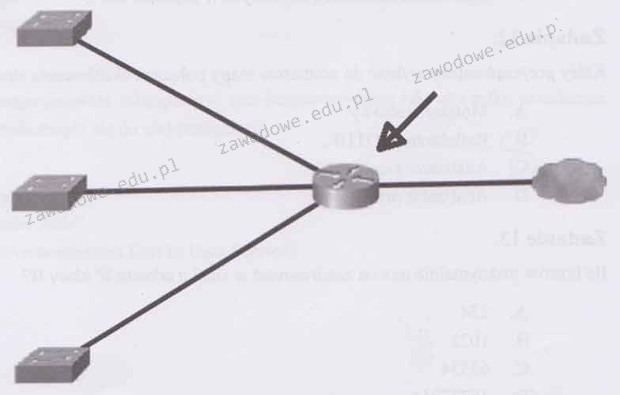

Którego urządzenia dotyczy strzałka na rysunku?

Jaka liczba hostów może być podłączona w sieci o adresie 192.168.1.128/29?

Metoda przesyłania danych między urządzeniem CD/DVD a pamięcią komputera w trybie bezpośredniego dostępu do pamięci to

Nie wykorzystuje się do zdalnego kierowania stacjami roboczymi

Aby zabezpieczyć komputery w lokalnej sieci przed nieautoryzowanym dostępem oraz atakami typu DoS, konieczne jest zainstalowanie i skonfigurowanie

Jaki protokół stosują komputery, aby informować rutera o przynależności do konkretnej grupy multicastowej?

Korzystając z polecenia taskmgr, użytkownik systemu Windows może

Jakie medium transmisyjne w sieciach LAN rekomenduje się do użycia w historycznych obiektach?

Gdy użytkownik systemu Windows nie ma możliwości skorzystania z drukarki, może skorzystać z opcji druku do pliku. Plik utworzony w ten sposób posiada rozszerzenie

Czym wyróżniają się procesory CISC?

Na zdjęciu widnieje

Aby przyznać użytkownikowi w systemie Windows możliwość zmiany czasu systemowego, należy skorzystać z narzędzia

Wynikiem przeprowadzenia polecenia arp -a 192.168.1.1 w systemie MS Windows jest pokazanie

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Zjawisko, w którym pliki przechowywane na dysku twardym są zapisywane w klastrach, które nie sąsiadują ze sobą, określane jest mianem

Co to jest urządzenie sieciowe most (ang. bridge)?

W nowoczesnych panelach dotykowych prawidłowe działanie wyświetlacza zapewnia mechanizm rozpoznający zmianę

Hosty A i B nie mają możliwości komunikacji z hostem C. Natomiast komunikacja między hostami A i B przebiega poprawnie. Jakie może być źródło problemu w komunikacji pomiędzy hostami A i C oraz B i C?

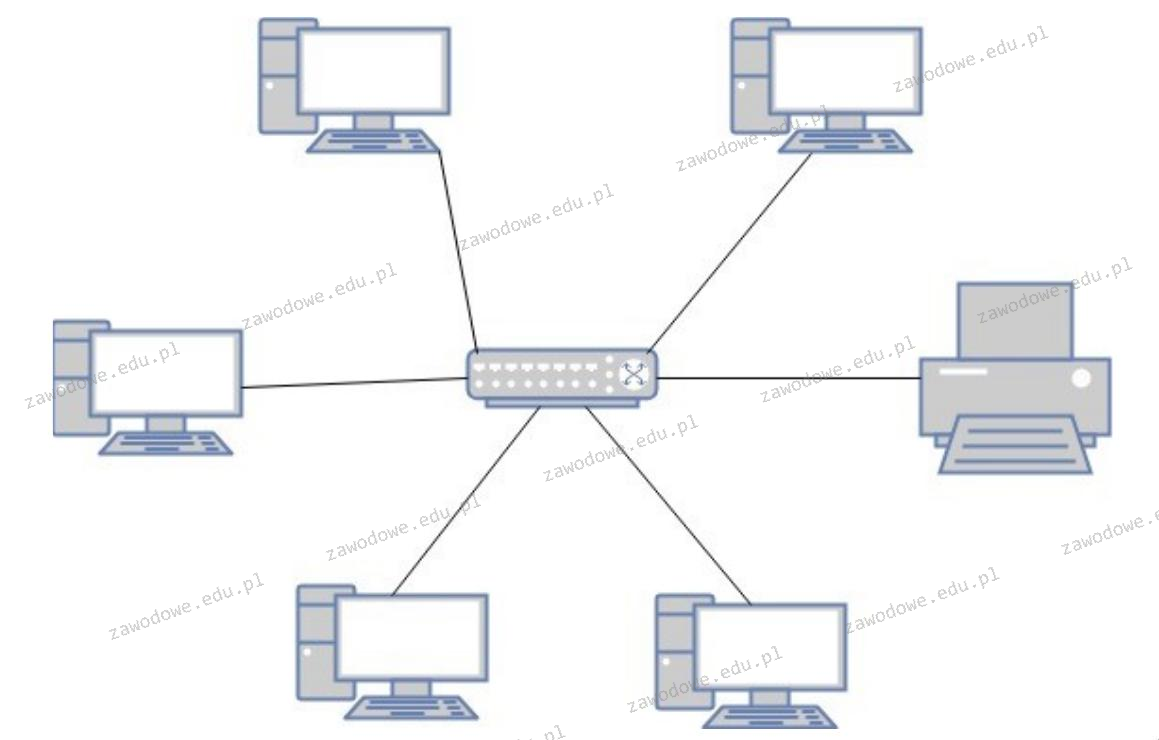

Który symbol przedstawia przełącznik?

Narzędzie zaprezentowane na rysunku jest wykorzystywane do przeprowadzania testów

W wierszu poleceń systemu Windows polecenie md jest używane do

Jakie polecenie umożliwia wyświetlanie oraz modyfikację tabel translacji adresów IP do adresów fizycznych?

Atak informatyczny, który polega na wyłudzaniu wrażliwych danych osobowych poprzez udawanie zaufanej osoby lub instytucji, nazywamy

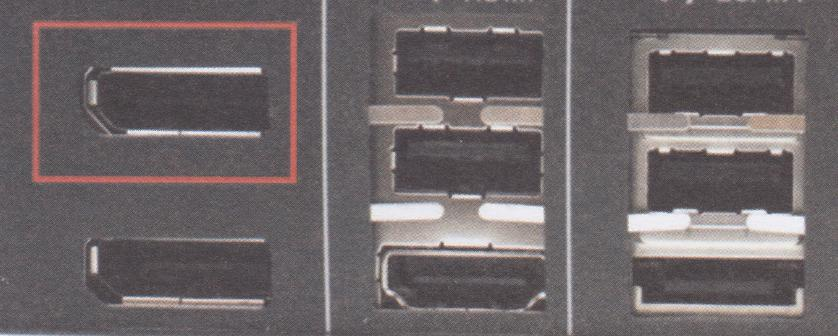

Przedstawiony skaner należy podłączyć do komputera przy użyciu złącza

Zamieszczone atrybuty opisują rodzaj pamięci

| Maksymalne taktowanie | 1600 MHz |

| Przepustowość | PC12800 1600MHz |

| Opóźnienie | Cycle Latency CL 9,0 |

| Korekcja | Nie |

| Dual/Quad | Dual Channel |

| Radiator | Tak |

Program typu recovery, w warunkach domowych, pozwala na odzyskanie danych z dysku twardego w przypadku

Podczas uruchamiania komputera wyświetla się komunikat CMOS checksum error press F1 to continue, press Del to setup) naciśnięcie klawisza Del skutkuje

Aby przeprowadzić instalację systemu operacyjnego z rodziny Windows na stacjach roboczych, konieczne jest dodanie na serwerze usług

Zgodnie z podanym cennikiem, przeciętny koszt zakupu wyposażenia stanowiska komputerowego wynosi:

| Nazwa sprzętu | Cena minimalna | Cena maksymalna |

|---|---|---|

| Jednostka centralna | 1300,00 zł | 4550,00 zł |

| Monitor | 650,00 zł | 2000,00 zł |

| Klawiatura | 28,00 zł | 100,00 zł |

| Myszka | 22,00 zł | 50,00 zł |

Administrator systemu Windows zauważył znaczne spowolnienie działania komputera spowodowane niską ilością dostępnej pamięci RAM. W celu zidentyfikowania programu, który zużywa jej najwięcej, powinien skorzystać z narzędzia

Jaką usługę trzeba zainstalować na serwerze, aby umożliwić korzystanie z nazw domen?

Aby zainstalować openSUSE oraz dostosować jego ustawienia, można skorzystać z narzędzia

Każdy następny router IP na drodze pakietu

Jaką fizyczną topologię sieci komputerowej przedstawia ilustracja?

Na ilustracji, złącze monitora zaznaczone czerwoną ramką, będzie kompatybilne z płytą główną, która ma interfejs

DB-25 służy jako złącze

Wymogi działalności przedsiębiorstwa nakładają konieczność używania systemów plików, które zapewniają wysoki poziom zabezpieczeń oraz umożliwiają szyfrowanie informacji. W związku z tym należy wybrać system operacyjny Windows