Pytanie 1

Aby system operacyjny mógł szybciej uzyskiwać dostęp do plików na dysku twardym, należy wykonać

Wynik: 17/40 punktów (42,5%)

Wymagane minimum: 20 punktów (50%)

Aby system operacyjny mógł szybciej uzyskiwać dostęp do plików na dysku twardym, należy wykonać

Serwisant zrealizował w ramach zlecenia działania przedstawione w poniższej tabeli. Całkowity koszt zlecenia obejmuje wartość usług wymienionych w tabeli oraz koszt pracy serwisanta, którego stawka za godzinę wynosi 60,00 zł netto. Oblicz całkowity koszt zlecenia brutto. Stawka VAT na usługi wynosi 23%.

| LP | Czynność | Czas wykonania w minutach | Cena usługi netto w zł |

|---|---|---|---|

| 1. | Instalacja i konfiguracja programu | 35 | 20,00 |

| 2. | Wymiana płyty głównej | 80 | 50,00 |

| 3. | Wymiana karty graficznej | 30 | 25,00 |

| 4. | Tworzenie kopii zapasowej i archiwizacja danych | 65 | 45,00 |

| 5. | Konfiguracja rutera | 30 | 20,00 |

Za pomocą przedstawionego urządzenia można przeprowadzić diagnostykę działania

Jaki jest poprawny adres podsieci po odjęciu 4 bitów od części hosta w adresie klasowym 192.168.1.0?

Graficzny symbol ukazany na ilustracji oznacza

W systemie Linux do obserwacji aktywnych procesów wykorzystuje się polecenie

Jakiego rodzaju złącze powinna mieć płyta główna, aby użytkownik był w stanie zainstalować kartę graficzną przedstawioną na rysunku?

Jakie znaczenie ma skrót MBR w kontekście technologii komputerowej?

Który z wymienionych składników stanowi element pasywny w sieci?

Jaki akronim oznacza wydajność sieci oraz usługi, które mają na celu między innymi priorytetyzację przesyłanych pakietów?

Według specyfikacji JEDEC, napięcie zasilania dla modułów pamięci RAM DDR3L wynosi

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Podczas analizy ruchu sieciowego przy użyciu sniffera zauważono, że urządzenia przesyłają dane na portach 20 oraz 21. Przyjmując standardową konfigurację, oznacza to, że analizowanym protokołem jest protokół

Jakie czynniki nie powodują utraty danych z dysku twardego HDD?

W dokumentacji technicznej procesora Intel Xeon Processor E3-1220, producent przedstawia następujące dane: # rdzeni: 4 # wątków: 4 Częstotliwość zegara: 3.1 GHz Maksymalna częstotliwość Turbo: 3.4 GHz Intel Smart Cache: 8 MB DMI: 5 GT/s Zestaw instrukcji: 64 bit Rozszerzenia zestawu instrukcji: SSE4.1/4.2, AVX Opcje wbudowane: Nie Litografia: 32 nm Maksymalne TDP: 80 W. Co to oznacza dla Menedżera zadań systemu Windows, jeśli chodzi o historię użycia?

| # of Cores: | 4 |

| # of Threads: | 4 |

| Clock Speed: | 3.1 GHz |

| Max Turbo Frequency: | 3.4 GHz |

| Intel® Smart Cache: | 8 MB |

| DMI: | 5 GT/s |

| Instruction Set: | 64-bit |

| Instruction Set Extensions: | SSE4.1/4.2, AVX |

| Embedded Options Available: | No |

| Lithography: | 32 nm |

| Max TDP: | 80 W |

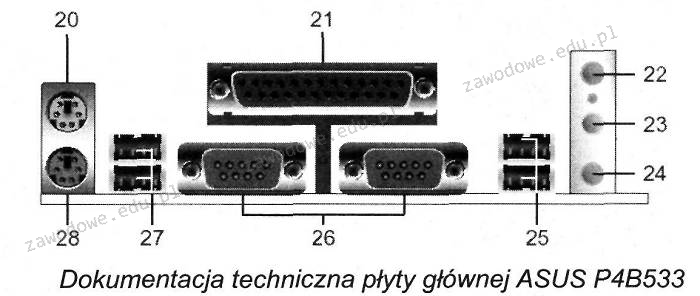

Na zaprezentowanej płycie głównej komputera złącza oznaczono cyframi 25 i 27

Jakie polecenie powinien wydać root w systemie Ubuntu Linux, aby przeprowadzić aktualizację wszystkich pakietów (całego systemu) do najnowszej wersji z zainstalowaniem nowego jądra?

Który sterownik drukarki jest niezależny od urządzenia i systemu operacyjnego oraz jest standardem w urządzeniach poligraficznych?

Jaka jest maksymalna liczba komputerów, które mogą być zaadresowane w podsieci z adresem 192.168.1.0/25?

Jaki system operacyjny funkcjonuje w trybie tekstowym i umożliwia uruchomienie środowiska graficznego KDE?

Jakie materiały są używane w kolorowej drukarce laserowej?

Gdy komputer się uruchamia, na ekranie wyświetla się komunikat "CMOS checksum error press F1 to continue press DEL to setup". Naciśnięcie klawisza DEL spowoduje

Port AGP służy do łączenia

Informacja tekstowa KB/Interface error, widoczna na wyświetlaczu komputera podczas BIOS POST od firmy AMI, wskazuje na problem

Jak nazywa się licencja oprogramowania, która pozwala na bezpłatne rozpowszechnianie aplikacji?

Nie wykorzystuje się do zdalnego kierowania stacjami roboczymi

Komputer, którego naprawa ma zostać przeprowadzona u klienta, nie reaguje na wciśnięcie przycisku POWER. Pierwszą czynnością harmonogramu prac związanych z lokalizacją i usunięciem tej usterki powinno być

Jednym z programów ochronnych, które zabezpieczają system przed oprogramowaniem, które bez zgody użytkownika zbiera i przesyła jego dane osobowe, numery kart kredytowych, informacje o odwiedzanych stronach WWW, hasła oraz używane adresy e-mail, jest aplikacja

Urządzenie sieciowe nazywane mostem (ang. bridge) to:

Tryb użytkownika w przełączniku CISCO (User EXEC Mode) umożliwia

Na zdjęciu ukazano złącze zasilające

Jaki parametr powinien być użyty do wywołania komendy netstat, aby pokazać statystykę interfejsu sieciowego (ilość wysłanych oraz odebranych bajtów i pakietów)?

Natychmiast po dostrzeżeniu utraty istotnych plików na dysku twardym, użytkownik powinien

Aby odzyskać dane ze sformatowanego dysku twardego, należy wykorzystać program

Aby zabezpieczyć komputery w lokalnej sieci przed nieautoryzowanym dostępem oraz atakami typu DoS, konieczne jest zainstalowanie i skonfigurowanie

Po wykonaniu eksportu klucza HKCU zostanie zapisana kopia rejestru zawierająca informacje, dotyczące konfiguracji

Na płycie głównej doszło do awarii zintegrowanej karty sieciowej. Komputer nie ma dysku twardego ani innych napędów, takich jak stacja dysków czy CD-ROM. Klient informuje, że w sieci firmowej komputery nie mają napędów, a wszystko "czyta" się z serwera. Aby przywrócić utraconą funkcjonalność, należy zainstalować

Kable łączące poziome punkty dystrybucyjne z centralnym punktem dystrybucyjnym określa się jako

Co robi polecenie Gpresult?

Użytkownicy dysków SSD powinni unikać wykonywania następujących działań konserwacyjnych