Pytanie 1

Martwy piksel, który jest defektem w monitorach LCD, to punkt, który ciągle ma ten sam kolor

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

Martwy piksel, który jest defektem w monitorach LCD, to punkt, który ciągle ma ten sam kolor

Komputer wyposażony w BIOS firmy Award wygenerował komunikat o treści Primary/Secondary master/slave hard disk fail. Komunikat ten może oznaczać konieczność wymiany

Który z parametrów czasowych w pamięci RAM określany jest jako czas dostępu?

Usługi na serwerze są konfigurowane za pomocą

W strukturze sieciowej zaleca się umiejscowienie jednego punktu abonenckiego na powierzchni wynoszącej

Program do diagnostyki komputera pokazał komunikat NIC ERROR. Co oznacza ten komunikat w kontekście uszkodzenia karty?

Aby sprawdzić statystyki użycia pamięci wirtualnej w systemie Linux, należy sprawdzić zawartość pliku

Który z portów znajdujących się na tylnej części komputera jest oznaczony podanym symbolem?

W jakiej topologii sieci fizycznej każdy komputer jest połączony z dokładnie dwoma sąsiadującymi komputerami, bez użycia dodatkowych urządzeń aktywnych?

Każdorazowo automatycznie szyfrowany staje się plik, który został zaszyfrowany przez użytkownika za pomocą systemu NTFS 5.0, w momencie

Kiedy dysze w drukarce atramentowej wyschną z powodu długotrwałych przerw w użytkowaniu, co powinno się najpierw wykonać?

Aby skanera działał prawidłowo, należy

Czym jest OTDR?

Zamiana baterii jest jedną z czynności związanych z użytkowaniem

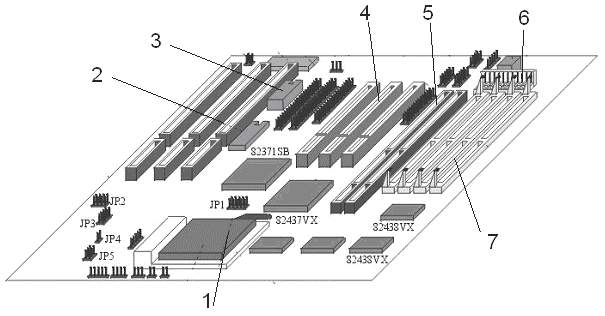

Na schemacie przedstawionej płyty głównej zasilanie powinno być podłączone do gniazda oznaczonego numerem

Jakie informacje można uzyskać za pomocą polecenia uname -s w systemie Linux?

Jakim poleceniem w systemie Linux można ustalić trasę pakietu do celu?

Korzystając z polecenia taskmgr, użytkownik systemu Windows może

Które z tych określeń nie odpowiada charakterystyce kabla światłowodowego?

Zdiagnostykowane wyniki wykonania polecenia systemu Linux odnoszą się do ```/dev/sda: Timing cached reads: 18100 MB in 2.00 seconds = 9056.95 MB/sec```

Jaką rolę pełni serwer plików w sieciach komputerowych LAN?

Pamięć, która nie traci danych, może być elektrycznie kasowana i programowana, znana jest pod skrótem

Jakie urządzenie łączy sieć lokalną z siecią rozległą?

Jaki procesor powinien być zastosowany przy składaniu komputera osobistego z płytą główną Asus M5A78L-M/USB3 AMD760G socket AM3+?

Aby ocenić stabilność systemu Windows Server, należy użyć narzędzia

W systemach Windows, aby określić, w którym miejscu w sieci zatrzymał się pakiet, stosuje się komendę

Jakie z podanych urządzeń stanowi część jednostki centralnej?

Można przywrócić pliki z kosza, korzystając z polecenia

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Która z licencji ma charakter grupowy i pozwala instytucjom komercyjnym oraz organizacjom edukacyjnym, państwowym i charytatywnym na zakup większej ilości oprogramowania firmy Microsoft na korzystnych zasadach?

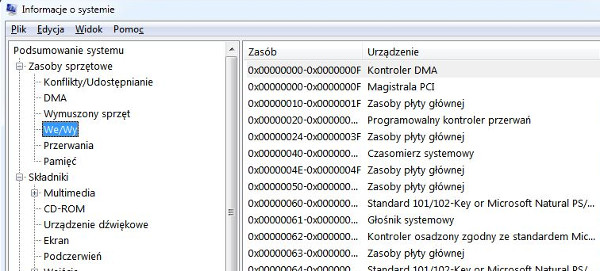

W jakim systemie numerycznym przedstawione są zakresy We/Wy na ilustracji?

Aby podłączyć dysk z interfejsem SAS, należy użyć kabla przedstawionego na diagramie

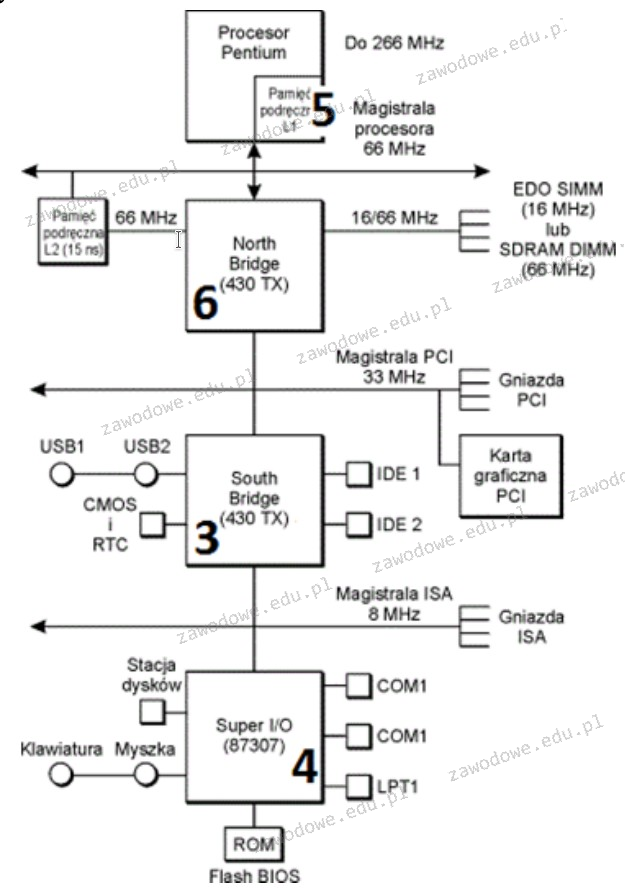

Część płyty głównej, która odpowiada za transmisję danych pomiędzy mikroprocesorem a pamięcią operacyjną RAM oraz magistralą karty graficznej, jest oznaczona na rysunku numerem

Jakie polecenie oprócz ls może być użyte przez użytkownika systemu Linux do wyświetlenia zawartości katalogu, w tym plików i podkatalogów?

Które z urządzeń używanych w sieci komputerowej NIE WPŁYWA na liczbę domen kolizyjnych?

Jaką maksymalną prędkość transferu danych umożliwia interfejs USB 3.0?

Jakie oprogramowanie jest wykorzystywane do kontrolowania stanu dysków twardych?

Jakie jest oznaczenie sieci, w której funkcjonuje host o IP 10.10.10.6 klasy A?

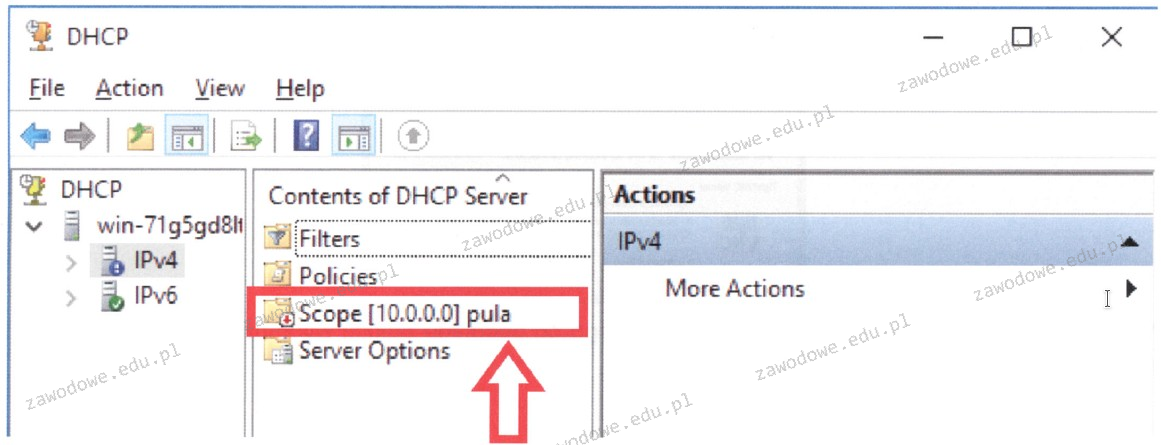

W systemie serwerowym Windows widoczny jest zakres adresów IPv4. Ikona umieszczona obok jego nazwy sugeruje, że

Które z poleceń systemu Linux nie umożliwia przeprowadzenia diagnostyki sprzętu komputerowego?