Pytanie 1

Jakie urządzenie w sieci lokalnej nie wydziela segmentów sieci komputerowej na kolizyjne domeny?

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

Jakie urządzenie w sieci lokalnej nie wydziela segmentów sieci komputerowej na kolizyjne domeny?

Które polecenie w systemie Linux służy do zakończenia procesu?

Urządzenia wykorzystujące port USB 2.0 są zasilane napięciem, którego wartość znajduje się w przedziale

Jakie polecenie w systemie Linux umożliwia wyświetlenie listy zawartości katalogu?

Aby połączyć dwa przełączniki oddalone o 200 m i osiągnąć minimalną przepustowość 200 Mbit/s, jakie rozwiązanie należy zastosować?

Po przeprowadzeniu diagnostyki komputerowej ustalono, że temperatura pracy karty graficznej z wyjściami HDMI oraz D-SUB, zainstalowanej w gnieździe PCI Express komputera stacjonarnego, wynosi 87°C. W związku z tym, serwisant powinien

Aby przetestować funkcjonowanie serwera DNS w systemach Windows Server, można skorzystać z narzędzia nslookup. Jeśli w poleceniu podamy nazwę komputera, np. nslookup host.domena.com, to dojdzie do weryfikacji

Metoda przekazywania tokena (ang. token) jest wykorzystywana w strukturze

W systemie Windows można przeprowadzić analizę wpływu uruchomionych aplikacji na wydajność komputera, korzystając z polecenia

Jakie urządzenie sieciowe umożliwia połączenie sieci LAN z WAN?

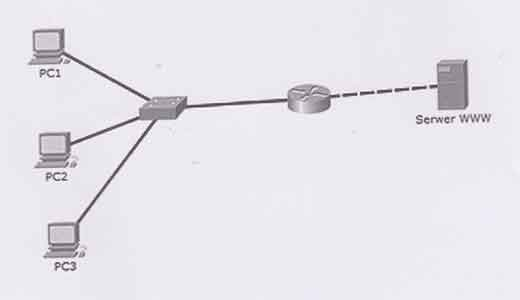

Użytkownicy w sieci lokalnej mogą się komunikować między sobą, lecz nie mają możliwości połączenia z serwerem WWW. Wynik polecenia ping z komputerów do bramy jest pozytywny. Który element sieci nie może być źródłem problemu?

Czym jest prefetching?

Podczas pracy wskaźnik przewodowej myszy optycznej nie reaguje na przesuwanie urządzenia po padzie, dopiero po odpowiednim ułożeniu myszy kursor zaczyna zmieniać położenie. Objawy te wskazują na uszkodzenie

Jakie urządzenie pracuje w warstwie łącza danych i umożliwia integrację segmentów sieci o różnych architekturach?

Aby w edytorze Regedit przywrócić stan rejestru systemowego za pomocą wcześniej utworzonej kopii zapasowej, należy użyć funkcji

Złącze SC stanowi standard w cablach

Na zdjęciu ukazano złącze zasilające

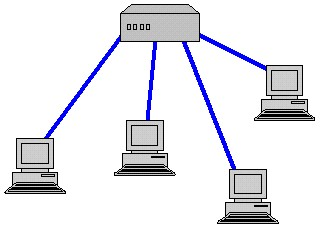

Jaką topologię fizyczną sieci ukazuje przedstawiony rysunek?

Który z poniższych protokołów należy do warstwy aplikacji w modelu ISO/OSI?

Minimalna odległość toru nieekranowanego kabla sieciowego od instalacji oświetleniowej powinna wynosić

Jaki jest główny cel stosowania maski podsieci?

Dana jest sieć o adresie 172.16.0.0/16. Które z adresów sieci 172.16.0.0/16 są prawidłowe, jeśli zostaną wydzielone cztery podsieci o masce 18 bitowej?

Jaką rolę pełni serwer plików w sieciach komputerowych LAN?

Które z poleceń systemu Linux nie umożliwia przeprowadzenia diagnostyki sprzętu komputerowego?

W wyniku wykonania przedstawionych poleceń systemu Linux interfejs sieciowy eth0 otrzyma:

ifconfig eth0 10.0.0.100 netmask 255.255.255.0 broadcast 10.0.0.255 up route add default gw 10.0.0.10

Na podstawie jakiego adresu przełącznik podejmuje decyzję o przesyłaniu ramek?

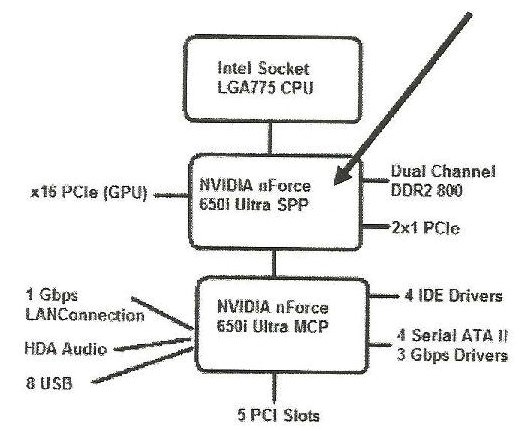

Jaką rolę pełni komponent wskazany strzałką na schemacie chipsetu płyty głównej?

Jaką maksymalną długość może mieć kabel miedziany UTP kategorii 5e łączący bezpośrednio dwa urządzenia w sieci, według standardu Fast Ethernet 100Base-TX?

Jaką maksymalną liczbę podstawowych partycji na dysku twardym z tablicą MBR można utworzyć za pomocą narzędzia Zarządzanie dyskami dostępnego w systemie Windows?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

W systemie adresacji IPv6 adres ff00::/8 definiuje

Komenda uname -s w systemie Linux służy do identyfikacji

Jak można zaktualizować wprowadzone zmiany w konfiguracji systemu operacyjnego Windows, korzystając z edytora zasad grup?

Jakim systemem operacyjnym jest system czasu rzeczywistego?

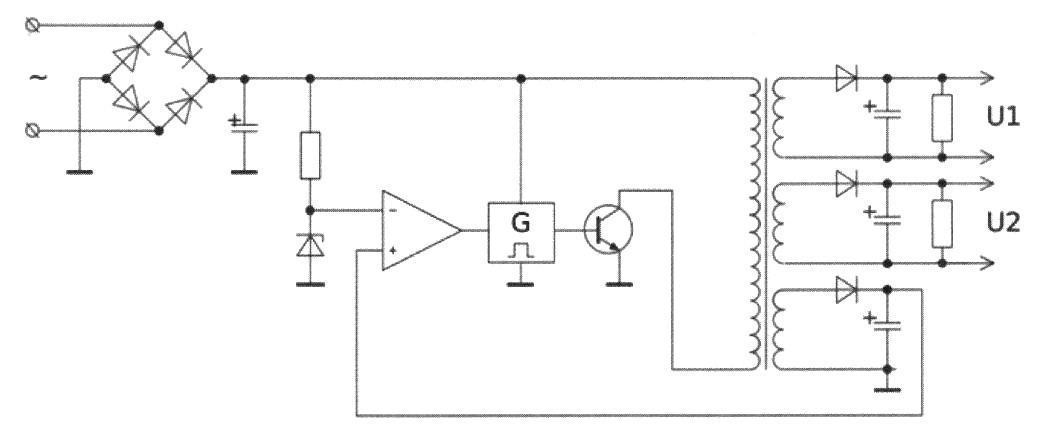

Na rysunku zobrazowano schemat

W systemie operacyjnym wystąpił problem z sterownikiem TWAIN, co może wpływać na nieprawidłowe działanie

Zasada dostępu do medium CSMA/CA jest wykorzystywana w sieci o specyfikacji

Dysk z systemem plików FAT32, na którym regularnie przeprowadza się operacje usuwania starych plików oraz dodawania nowych, staje się:

Której aplikacji należy użyć, aby sprawdzić parametry S.M.A.R.T.?

Jakie urządzenie pozwala na połączenie lokalnej sieci komputerowej z Internetem?