Pytanie 1

Programy antywirusowe mogą efektywnie zabezpieczać komputer. Istotne jest, aby wybrać możliwość uruchamiania aplikacji razem z komputerem oraz opcję

Wynik: 31/40 punktów (77,5%)

Wymagane minimum: 20 punktów (50%)

Programy antywirusowe mogą efektywnie zabezpieczać komputer. Istotne jest, aby wybrać możliwość uruchamiania aplikacji razem z komputerem oraz opcję

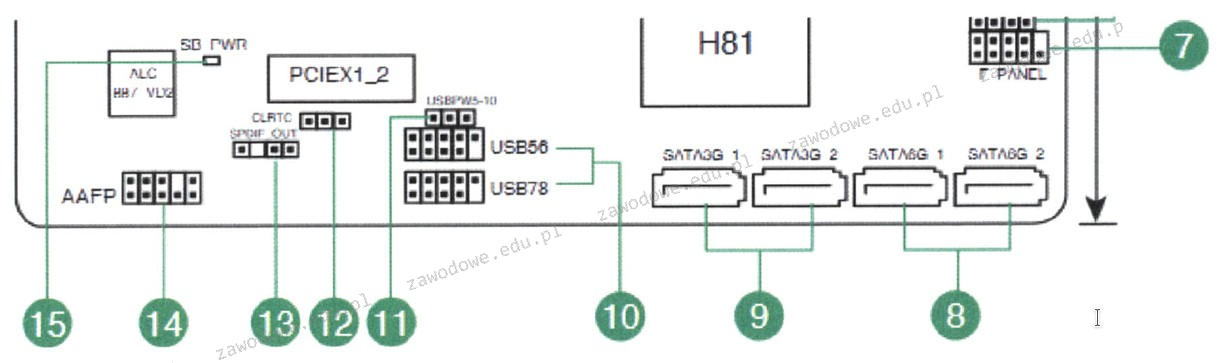

Na diagramie płyty głównej, który znajduje się w dokumentacji laptopa, złącza oznaczone numerami 8 i 9 to

Który z wymienionych komponentów jest częścią mechanizmu drukarki igłowej?

Aby osiągnąć optymalną prędkość przesyłu danych, gdy domowy ruter działa w paśmie 5 GHz, do laptopa należy zainstalować kartę sieciową bezprzewodową obsługującą standard

Symbol graficzny zaprezentowany na rysunku oznacza opakowanie

Pierwszym krokiem koniecznym do ochrony rutera przed nieautoryzowanym dostępem do jego panelu konfiguracyjnego jest

Wyższą efektywność aplikacji multimedialnych w systemach z rodziny Windows zapewnia technologia

Podczas skanowania reprodukcji obrazu z czasopisma, na skanie obrazu pojawiły się regularne wzory, tak zwana mora. Z jakiej funkcji skanera należy skorzystać, aby usunąć morę?

Użytkownik drukarki samodzielnie i prawidłowo napełnił pojemnik z tonerem. Po jego zamontowaniu drukarka nie podejmuje próby drukowania. Przyczyną tej usterki może być

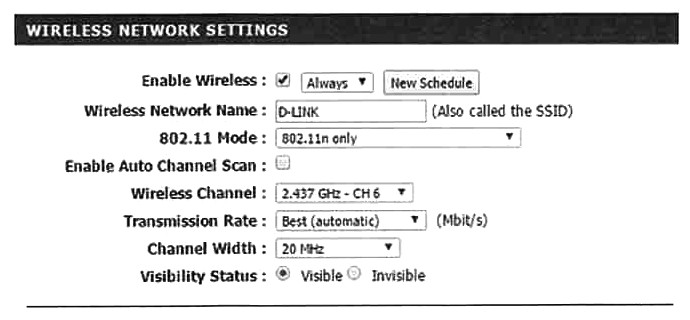

Który z parametrów w ustawieniach punktu dostępowego jest odpowiedzialny za login używany podczas próby połączenia z bezprzewodowym punktem dostępu?

Protokół, który pozwala na ściąganie wiadomości e-mail z serwera, to

Użytkownik napotyka trudności z uruchomieniem systemu Windows. W celu rozwiązania tego problemu skorzystał z narzędzia System Image Recovery, które

Metoda zwana rytownictwem dotyczy zasady działania plotera

Aktualizacja systemów operacyjnych to proces, którego głównym zadaniem jest

W procedurze Power-On Self-Test w pierwszej kolejności wykonywane jest sprawdzanie

Jakiego rodzaju złącze powinna mieć płyta główna, aby użytkownik był w stanie zainstalować kartę graficzną przedstawioną na rysunku?

Który z standardów Gigabit Ethernet pozwala na stworzenie segmentów sieci o długości 550 m/5000 m przy szybkości przesyłu danych 1 Gb/s?

Transmisja w standardzie 100Base-T korzysta z kabli skrętkowych, które mają

Technologia procesorów z serii Intel Core, wykorzystywana w układach i5, i7 oraz i9, umożliwiająca podniesienie częstotliwości w sytuacji, gdy komputer potrzebuje większej mocy obliczeniowej, to

Które z poniższych stwierdzeń jest prawdziwe w odniesieniu do przedstawionej konfiguracji serwisu DHCP w systemie Linux?

Jaki adres IPv6 jest stosowany jako adres link-local w procesie autokonfiguracji urządzeń?

Na stabilność obrazu w monitorach CRT istotny wpływ ma

Na rysunku widoczny jest symbol graficzny

Jakie urządzenie powinno być użyte do segmentacji domeny rozgłoszeniowej?

Do obserwacji stanu urządzeń w sieci wykorzystywane jest oprogramowanie operujące na podstawie protokołu

Norma EN 50167 odnosi się do systemów okablowania

Aby zasilić najbardziej wydajne karty graficzne, konieczne jest dodatkowe 6-pinowe gniazdo zasilacza PCI-E, które dostarcza napięcia

Instalacja serwera stron www w rodzinie systemów Windows Server jest możliwa dzięki roli

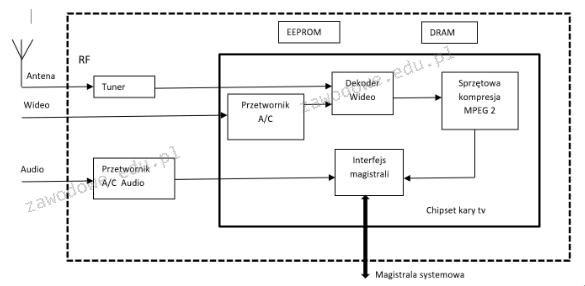

Na ilustracji przedstawiono diagram blokowy karty

Do czego służy oprogramowanie Microsoft Hyper-V?

Które urządzenie poprawi zasięg sieci bezprzewodowej?

Do akumulatora w jednostce ALU wprowadzono liczbę dziesiętną 253. Jak wygląda jej reprezentacja binarna?

Jakie polecenie w systemach operacyjnych Windows służy do prezentacji konfiguracji interfejsów sieciowych?

Adres IP 192.168.2.0/24 podzielono na cztery różne podsieci. Jaką maskę mają te nowe podsieci?

W zestawieniu przedstawiono istotne parametry techniczne dwóch typów interfejsów. Z powyższego wynika, że SATA w porównaniu do ATA charakteryzuje się

| Table Comparison of parallel ATA and SATA | ||

|---|---|---|

| Parallel ATA | SATA 1.5 Gb/s | |

| Bandwidth | 133 MB/s | 150 MB/s |

| Volts | 5V | 250 mV |

| Number of pins | 40 | 7 |

| Cable length | 18 in. (45.7 cm) | 39 in. (1 m) |

Aby poprawić bezpieczeństwo zasobów sieciowych, administrator sieci komputerowej w firmie otrzymał zadanie podziału aktualnej lokalnej sieci komputerowej na 16 podsieci. Obecna sieć posiada adres IP 192.168.20.0 i maskę 255.255.255.0. Jaką maskę sieci powinien zastosować administrator?

Polecenie chmod +x test

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Aby zrealizować sieć komputerową w pomieszczeniu zastosowano 25 metrów skrętki UTP, 5 gniazd RJ45 oraz odpowiednią ilość wtyków RJ45 niezbędnych do stworzenia 5 kabli połączeniowych typu patchcord. Jaki jest całkowity koszt użytych materiałów do budowy sieci? Ceny jednostkowe stosowanych materiałów można znaleźć w tabeli.

| Materiał | Cena jednostkowa | Koszt |

|---|---|---|

| Skrętka UTP | 1,00 zł/m | 25 zł |

| Gniazdo RJ45 | 5,00 zł/szt. | 25 zł |

| Wtyk RJ45 | 3,00 zł/szt. | 30 zł |

Na dysku obok systemu Windows zainstalowano system Linux Ubuntu. W celu ustawienia kolejności uruchamiania systemów operacyjnych, konieczna jest modyfikacja zawartości