Pytanie 1

Termin określający zdolność do rozbudowy sieci to

Wynik: 33/40 punktów (82,5%)

Wymagane minimum: 20 punktów (50%)

Termin określający zdolność do rozbudowy sieci to

Jakie polecenie w środowisku Linux pozwala na modyfikację uprawnień dostępu do pliku lub katalogu?

Jaka jest maksymalna liczba hostów, które można przypisać w sieci o adresie IP klasy B?

Zanim zainstalujesz sterownik dla urządzenia peryferyjnego, system operacyjny Windows powinien weryfikować, czy sterownik ma ważny podpis

Jaką prędkość przesyłu danych określa standard sieci Ethernet IEEE 802.3z?

Jaką kwotę trzeba będzie zapłacić za wymianę karty graficznej w komputerze, jeśli koszt karty wynosi 250 zł, czas wymiany to 80 minut, a cena za każdą rozpoczętą roboczogodzinę to 50 zł?

Aby zrealizować wymianę informacji między dwoma odmiennymi sieciami, konieczne jest użycie

Jakie narzędzie wraz z odpowiednimi parametrami należy zastosować w systemie Windows, aby uzyskać przedstawione informacje o dysku twardym?

ST9500420AS Identyfikator dysku : A67B7C06 Typ : ATA Stan : Online Ścieżka : 0 Element docelowy : 0 Identyfikator jednostki LUN: 0 Ścieżka lokalizacji : PCIROOT(0)#ATA(C00T00L00) Bieżący stan tylko do odczytu : Nie Tylko do odczytu: Nie Dysk rozruchowy : Tak Dysk plików stronicowania: Tak Dysk plików hibernacji: Nie Dysk zrzutów awaryjnych: Tak Dysk klastrowany: Nie Wolumin ### Lit Etykieta Fs Typ Rozmiar Stan Info ----------- --- ----------- ----- ------------ ------- ------- -------- Wolumin 1 SYSTEM NTFS Partycja 300 MB Zdrowy System Wolumin 2 C NTFS Partycja 445 GB Zdrowy Rozruch Wolumin 3 D HP_RECOVERY NTFS Partycja 15 GB Zdrowy Wolumin 4 E HP_TOOLS FAT32 Partycja 5122 MB Zdrowy

Czym jest procesor Athlon 2800+?

W jakim systemie występuje jądro hybrydowe (kernel)?

Jaki zakres adresów IPv4 jest prawidłowo przypisany do danej klasy?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Komputer dysponuje adresem IP 192.168.0.1, a jego maska podsieci wynosi 255.255.255.0. Który adres stanowi adres rozgłoszeniowy dla podsieci, do której ten komputer przynależy?

Jakim standardem posługuje się komunikacja między skanerem a aplikacją graficzną?

Na zdjęciu widać kartę

W systemie Linux, aby uzyskać informację o nazwie aktualnego katalogu roboczego, należy użyć polecenia

W systemach Windows XP Pro/ Windows Vista Bizness/Windows 7 Pro/Windows 8 Pro, rozwiązaniem zapewniającym poufność danych dla użytkowników korzystających z jednego komputera, których informacje mogą być wykorzystywane wyłącznie przez nich, jest

Jakie porty powinny zostać zablokowane w firewallu, aby nie pozwolić na łączenie się z serwerem FTP?

Jaką operację można wykonać podczas konfiguracji przełącznika CISCO w interfejsie CLI, nie przechodząc do trybu uprzywilejowanego, w zakresie dostępu widocznym w ramce?

| Switch> |

Na rysunku ukazany jest diagram blokowy zasilacza

Które z urządzeń nie powinno być serwisowane podczas korzystania z urządzeń antystatycznych?

Jakie polecenie w systemach Windows należy użyć, aby ustawić statyczny adres IP w konsoli poleceń?

Wskaż efekt działania przedstawionego polecenia.

net user Test /expires:12/09/20

Złącze widoczne na obrazku pozwala na podłączenie

Aby poprawić wydajność procesora serii Intel za pomocą 'podkręcania' (ang. overclocking), należy użyć procesora oznaczonego

Przedstawione na ilustracji narzędzie jest przeznaczone do

Której aplikacji należy użyć, aby sprawdzić parametry S.M.A.R.T.?

W architekturze ISO/OSI protokoły TCP oraz UDP funkcjonują w warstwie

Jaką szerokość ma magistrala pamięci DDR SDRAM?

Farad to jednostka

To narzędzie może być wykorzystane do

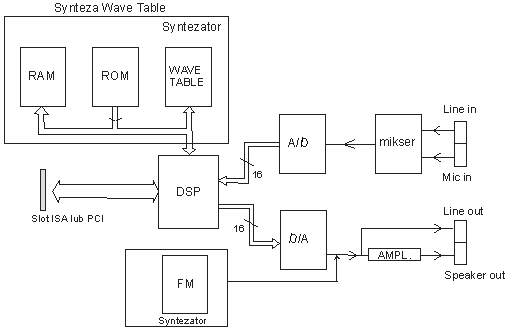

Który z elementów przedstawionych na diagramie karty dźwiękowej na rysunku jest odpowiedzialny za cyfrowe przetwarzanie sygnałów?

Które narzędzie systemu Windows służy do zdefiniowania polityki haseł dostępowych do kont użytkowników?

W systemie Windows, aby uruchomić usługę związaną z wydajnością komputera, należy użyć polecenia

Jak nazywa się współpracujące z monitorami CRT urządzenie wskazujące z końcówką wyposażoną w światłoczuły element, która poprzez dotknięcie ekranu monitora powoduje przesłanie sygnału do komputera, umożliwiając w ten sposób lokalizację kursora?

Który z pakietów powinien być zainstalowany na serwerze Linux, aby komputery z systemem Windows mogły udostępniać pliki oraz drukarki z tego serwera?

Do wykonania obrazu dysku twardego można użyć programu

Protokół User Datagram Protocol (UDP) należy do

Program testujący wydajność sprzętu komputerowego to

Symbol umieszczony na obudowie komputera stacjonarnego informuje o zagrożeniu przed