Pytanie 1

Co należy zrobić, gdy podczas uruchamiania komputera procedura POST zgłosi błąd odczytu lub zapisu w pamięci CMOS?

Wynik: 19/40 punktów (47,5%)

Wymagane minimum: 20 punktów (50%)

Co należy zrobić, gdy podczas uruchamiania komputera procedura POST zgłosi błąd odczytu lub zapisu w pamięci CMOS?

Jak nazywa się urządzenie wskazujące, które współpracuje z monitorami CRT i ma końcówkę z elementem światłoczułym, a jego dotknięcie ekranu monitora skutkuje przesłaniem sygnału do komputera, co umożliwia lokalizację kursora?

W systemie SI jednostką do mierzenia napięcia jest

Prawo osobiste twórcy do oprogramowania komputerowego

Użytkownik systemu Windows może skorzystać z polecenia taskmgr, aby

Interfejs UDMA to typ interfejsu

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jakiego rodzaju wkręt powinno się zastosować do przymocowania napędu optycznego o szerokości 5,25" w obudowie, która wymaga użycia śrub do mocowania napędów?

Jaki jest standard 1000Base-T?

Wydruk z drukarki igłowej realizowany jest z zastosowaniem zestawu stalowych igieł w liczbie

Jeśli w określonej przestrzeni będą funkcjonowały równocześnie dwie sieci WLAN w standardzie 802.11g, to aby zredukować ryzyko wzajemnych zakłóceń, należy przypisać im kanały o numerach różniących się o

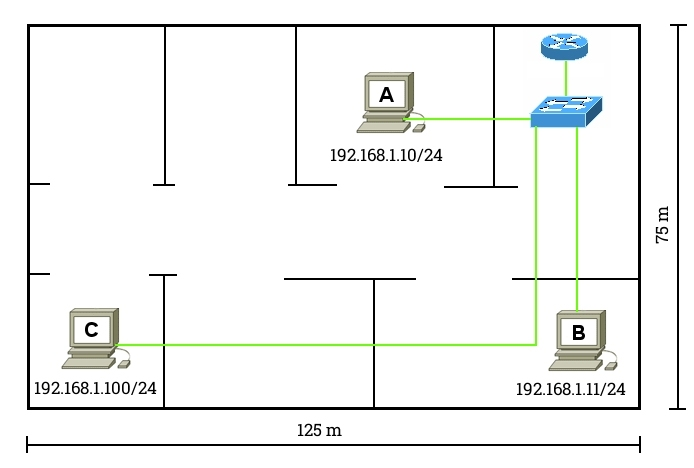

Na schemacie pokazano sieć LAN wykorzystującą okablowanie kategorii 6. Stacja robocza C nie może nawiązać połączenia z siecią. Jaki problem warstwy fizycznej może być przyczyną braku komunikacji?

Jakie narzędzie powinno się wykorzystać w systemie Windows, aby uzyskać informacje o problemach z systemem?

Zarządzaniem czasem procesora dla różnych zadań zajmuje się

Jakie polecenie w systemie Windows powinno być użyte do obserwacji listy bieżących połączeń karty sieciowej w komputerze?

Jakie urządzenie jest pokazane na ilustracji?

Jakie urządzenie powinno być użyte w sieci Ethernet, aby zredukować liczbę kolizji pakietów?

Niskopoziomowe formatowanie dysku IDE HDD polega na

Czym wyróżniają się procesory CISC?

Do podłączenia projektora multimedialnego do komputera, nie można użyć złącza

Który z materiałów eksploatacyjnych nie jest stosowany w ploterach?

Jaką usługą można pobierać i przesyłać pliki na serwer?

Wskaż zewnętrzny protokół rutingu?

Które urządzenie należy wykorzystać do podłączenia urządzenia peryferyjnego, wyposażonego w bezprzewodowy interfejs wykorzystujący do komunikacji fale świetlne w zakresie podczerwieni, z laptopem, który nie ma takiego interfejsu, a ma natomiast interfejs USB?

Jaką kwotę trzeba będzie zapłacić za wymianę karty graficznej w komputerze, jeśli koszt karty wynosi 250 zł, czas wymiany to 80 minut, a cena za każdą rozpoczętą roboczogodzinę to 50 zł?

Informacje ogólne na temat zdarzeń systemowych w systemie Linux są zapisywane w

Aby sprawdzić dostępną przestrzeń na dysku twardym w systemie Linux, można wykorzystać polecenie

Do pomiaru wartości mocy pobieranej przez zestaw komputerowy służy

Jakie medium transmisyjne jest związane z adapterem przedstawionym na ilustracji?

Na jakich nośnikach pamięci masowej jednym z najczęstszych powodów uszkodzeń jest zniszczenie powierzchni?

Jeśli rozdzielczość myszy wynosi 200dpi, a monitor ma rozdzielczość Full HD, to aby przesunąć kursor wzdłuż ekranu, należy przesuń mysz o

Jaką liczbę dziesiętną reprezentuje liczba 11110101U2)?

Wykonanie polecenia fsck w systemie Linux będzie skutkować

Które z poniższych stwierdzeń dotyczących konta użytkownika Active Directory w systemie Windows jest prawdziwe?

Gniazdo LGA umieszczone na płycie głównej komputera stacjonarnego pozwala na zamontowanie procesora

Urządzenie komputerowe, które powinno być koniecznie podłączone do zasilania za pomocą UPS, to

Jakie działanie może skutkować nieodwracalną utratą danych w przypadku awarii systemu plików?

Jakie polecenie w systemie operacyjnym Linux służy do monitorowania komunikacji protokołów TCP/IP lub innych przesyłanych lub odbieranych w sieci komputerowej, do której jest podłączony komputer użytkownika?

Moduł Mini-GBiCSFP pełni funkcję

Co wskazuje oznaczenie danego procesora?